Ваши синтетические данные прошли все тесты, но всё равно сломали вашу модель.

Скрытые пробелы в синтетических данных, которые проявляются только тогда, когда ваша модель уже находится в рабочем режиме.

Конвейер обработки данных выглядел надежным. Дивергенция Кульбака-Лейблера находилась в пределах допустимых значений. В тесте Train on Synthetic, Test on Real (TSTR) модель достигла точности 91% при обучении на синтетических данных и тестировании на реальных данных, что немного ниже 93%, полученных при использовании реальных данных, — разница, находящаяся в пределах допусков, установленных командой. Кроме того, риск ложного вывода был относительно низким. Синтетический набор данных был сертифицирован как безопасный для использования в обучении моделей машинного обучения; реальные данные хранились в безопасности; и модель была обучена.

Однако три месяца спустя модель обнаружения мошенничества перестала выявлять те типы транзакций, которые ранее безотказно обнаруживала, причем не просто ухудшилась в производительности, а полностью вышла из строя. Целая группа нестандартных сценариев поведения фактически была исключена из действительности модели.

В ходе расследования команда не обнаружила технических ошибок в синтетических данных. Все проведенные командой тесты показали хорошие результаты.

Но проблема заключалась в том, что ни один из этих показателей на самом деле не измерял то, что действительно имело значение.

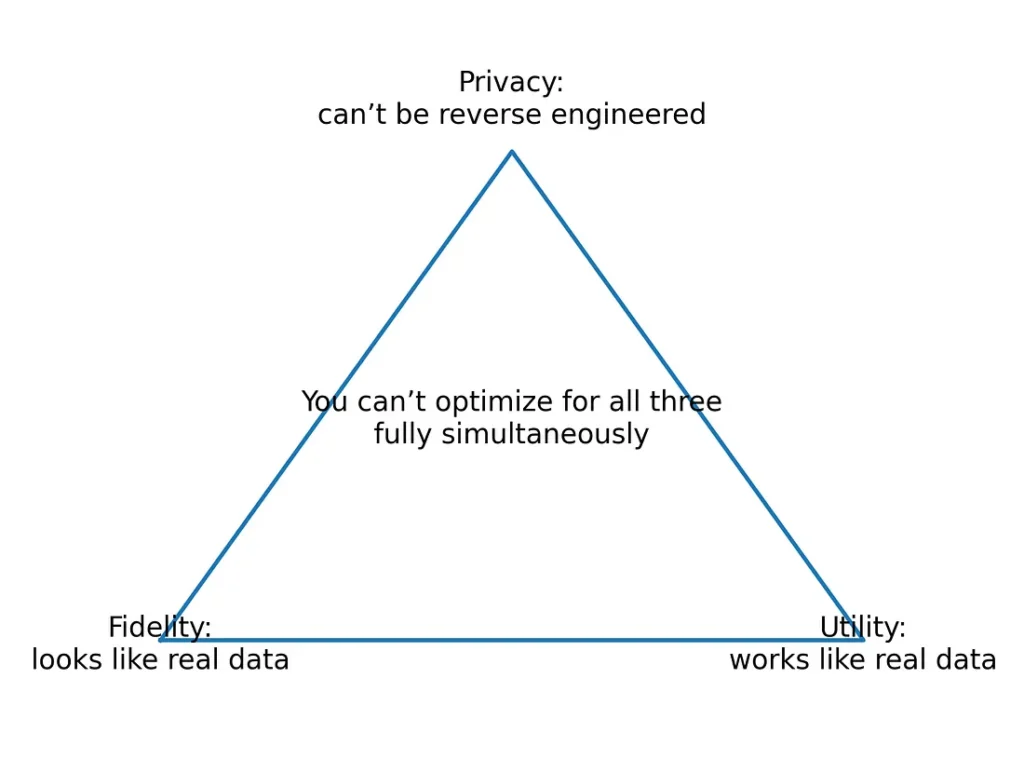

Трехмерная метрическая модель и почему она вводит в заблуждение специалистов-практиков

Треугольник «точность-полезность-конфиденциальность» стал стандартным термином для оценки качества синтетических данных, и это неспроста. Он отражает три аспекта качества, которых вы действительно хотите достичь: похожи ли синтетические данные на реальные данные (точность); обучают ли синтетические данные модели, которые ведут себя аналогично моделям, обученным на реальных данных (полезность); и защищают ли синтетические данные личность лиц, от которых эти данные получены (конфиденциальность)?

Сама по себе структура хороша. Однако проблемы возникают при её реализации.

Большинство специалистов оценивают три показателя качества последовательно, считая успешное выполнение каждого из них достаточным для внедрения. Такой подход ошибочен по трем взаимосвязанным причинам, которые требуют подробного объяснения:

Проблема №1: Метрики точности оценивают маргинальные распределения, а не взаимодействия между признаками.

Наиболее часто используемые метрики точности, такие как дивергенция Кульбака-Лейблера, критерий Колмогорова-Смирнова, расстояние полной вариации и расстояние Вассерштейна, измеряют степень соответствия распределения отдельных признаков в синтетическом наборе данных исходному.

Ни один из этих методов не позволяет оценить, как характеристики коррелируют друг с другом.

Это тонкое, но критически важное различие. Например, рассмотрим набор данных из сферы здравоохранения, где синтетическая версия точно воспроизводит маргинальные распределения возраста пациентов и тяжести заболевания — маргинальные распределения кажутся практически неразличимыми. Но существует небольшое расхождение в корреляции между этими двумя признаками в синтетических данных. В результате, когда на них обучается модель, она идентифицирует соответствующие сигналы по отдельности, но неправильно определяет взаимодействие между сигналами.

В 2025 году в рецензируемом исследовании, посвященном синтетическим данным пациентов, была проведена оценка пяти генеративных моделей на трех наборах клинических данных. Результаты показали, что, хотя маргинальные распределения почти всегда были очень похожи, показатели корреляции различались на 20 пунктов и более. Последствия были впечатляющими: на одном наборе данных модели, обученные на синтетических данных, показали значения площади под кривой (AUC) приблизительно 0,80, тогда как при использовании реальных данных были получены значения AUC приблизительно 0,88. Переменной, определяющей, был ли это первый или второй результат, было сохранение корреляции, а не точность маргинального распределения.

Для решения этой проблемы: проведите тесты Колмогорова-Смирнова и Кульбака-Лейблера в качестве базового показателя для подтверждения сходства маргинальных распределений. Всегда включайте сравнение корреляционных матриц. Вычислите норму Фробениуса разности, чтобы получить единое значение, представляющее собой степень потери корреляционной структуры. Установите пороговое значение потери корреляционной структуры до синтеза данных, а не после.

Одно число. Запускайте его каждый раз. Если оно превышает пороговое значение, вернитесь к генератору, прежде чем что-либо еще делать.

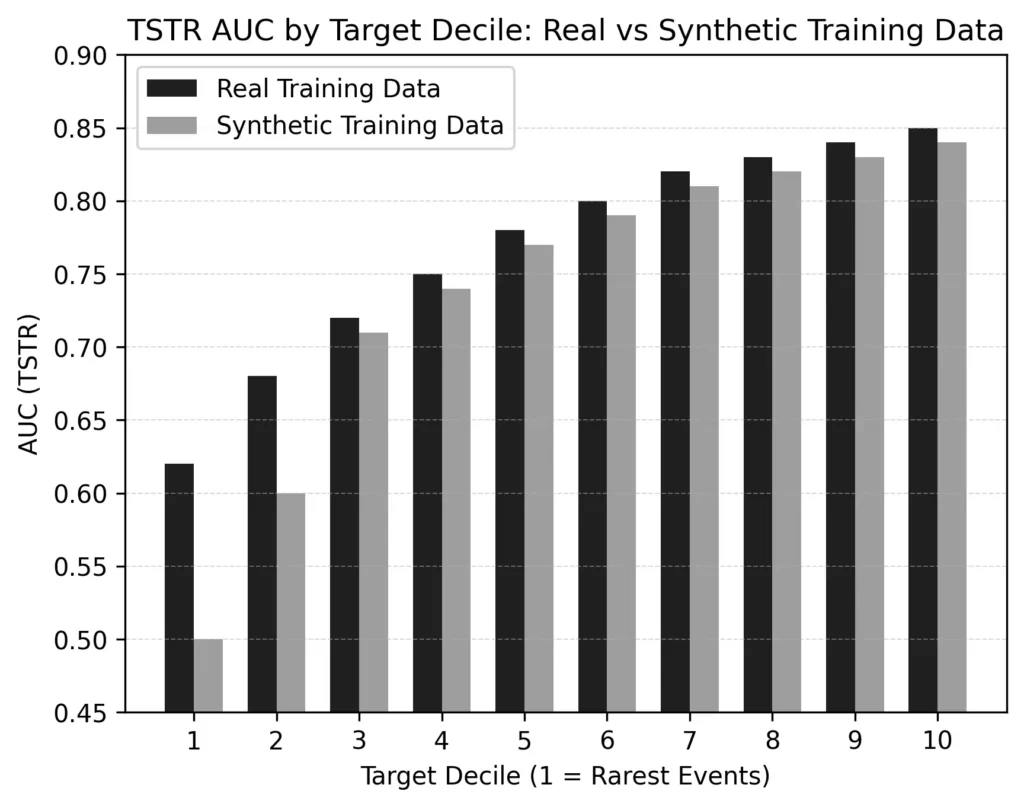

Проблема 2: Показатели полезности TSTR скрывают неравномерность распределения, когда они отражают только среднюю производительность.

Обучение на синтетических данных, тестирование на реальных данных — это один из «золотых стандартов» оценки полезности модели, и он по праву заслуживает свою репутацию. Обучение модели на синтетических данных и её хорошие результаты на реальных данных, безусловно, являются значимым доказательством её полезности.

Однако показатели TSTR основаны на средних значениях. Таким образом, они скрывают то, что именно даст сбой в производственной среде. В примере обнаружения мошенничества в начале этой статьи общий показатель AUC для TSTR составил 91%, но при разбивке производительности по децилям объема транзакций, самый низкий показатель (самые редкие и дорогостоящие транзакции) упал до 67% (синтетические данные очень точно воспроизводили распространенные транзакции; однако синтетические данные не так точно отражали самые редкие или необычные сценарии). Следовательно, модель, обученная на синтетических данных, с высокой точностью усваивала наиболее распространенные модели поведения, а с низкой точностью — наименее распространенные.

Это проблема потери данных в хвосте распределения. Она формально рассматривается в литературе, посвященной коллапсу моделей (Alemohammad et al., 2024, ICLR), и может быть применена к любому типу процесса генерации синтетических данных: генеративные модели, оптимизированные для генерации областей распределения с высокой вероятностью, постепенно недооценивают редкие события. Генератор синтетических данных не пытается недооценивать редкие события — он просто представляет математический механизм обучения этих моделей.

Исправление: Не сообщайте TSTR в агрегированном виде. Сообщайте TSTR отдельно для каждого из децилей, на которые вы разделили целевую переменную. Децили, в которых производительность, полученная с помощью синтетических данных, наиболее резко снижается по сравнению с производительностью, полученной с помощью реальных данных, точно укажут вам, какие децили ваши синтетические данные представляют неточно.

Проблема 3: Метрики конфиденциальности должны рассматривать все функции одинаково, хотя это не так.

Риск определения принадлежности записи к группе является наиболее распространенным показателем конфиденциальности. Риск определения принадлежности записи к группе задает один вопрос: может ли злоумышленник определить, существует ли конкретная запись в обучающем наборе данных? Низкие значения — это действительно хорошая новость.

Однако это измеряется на уровне записи, поэтому оценивается риск идентификации записи в целом. Более рискованный тип атаки — это вывод атрибутов; может ли злоумышленник, имея общедоступную информацию о характеристиках человека, идентифицировать конфиденциальный атрибут в синтетических данных? Именно эта модель атаки вызывает обеспокоенность у регулирующих органов в соответствии со стандартом повторной идентификации GDPR, и она работает на уровне комбинации (а не на уровне записи).

В рамках концепции консенсусных метрик конфиденциальности (Pilgram et al., 2025) определены три различных типа рисков: выделение (идентификация отдельного лица), связываемость (связывание записей между наборами данных) и вывод (выведение конфиденциальных атрибутов из комбинаций квазиидентификаторов). Практики почти исключительно измеряют первый тип (выделение). Третий тип риска (вывод) — это область, где происходит фактическая утечка конфиденциальных данных, которая совершенно невидима для стандартной оценки принадлежности к группе.

Решение: Перед синтезом определите приоритетность признаков на основе их конфиденциальности. Разделите их на категории: общедоступные (признаки, которые могут быть включены в синтетические данные без ограничений), квази-идентификаторы (комбинации общедоступных признаков, которые могут обеспечить связь) и конфиденциальные (атрибуты, которые вы пытаетесь защитить). Измеряйте риск определения принадлежности только для конфиденциальных признаков и не включайте весь набор данных. Затем проведите тест на определение атрибутов: обучите внешнюю модель прогнозировать каждый конфиденциальный признак на основе квази-идентификаторов, используя синтетические данные. Сравните точность обученной модели с моделью, обученной прогнозировать каждый конфиденциальный признак на основе тех же квази-идентификаторов, но с использованием отложенных данных. Если разница в точности невелика, значит, ваши синтетические данные содержат утечку информации.

Когда вы видите значение «выше 0,10» (или любое другое число) для показателя «подъем», это означает, что ваш синтетический набор данных лучше подходит для выявления конфиденциальных атрибутов пользователей, чем случайность. Неважно, ниже ли ваш показатель «вывода членства» (MIS) 0,10 или какой бы ни был пороговый уровень; это не имеет значения.

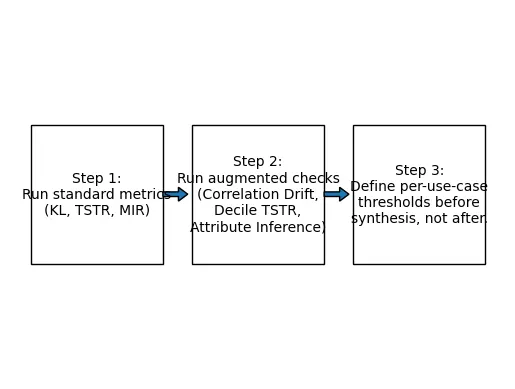

Единая система оценки

Как уже говорилось ранее, эти три проблемы по сути являются одной проблемой: каждая из них вытекает из использования метрик, предназначенных для оценки характеристик набора данных, и последующего использования тех же метрик в качестве основы для сертификации набора данных для развертывания в производственной среде. Это две совершенно разные задачи.

Ниже приведён полный контрольный список оценок, которые устраняют каждый из пробелов в оценке:

Размерность, стандартная метрика, чего не хватает и расширенная проверка.

Верность

- Дивергенция КЛ, тест КС

- Корреляционная структура между признаками

- Показатель дрейфа корреляции (норма Фробениуса)

Полезные функции

- Среднее значение AUC для TSTR

- Показатели хвостовой части хвоста на редких событиях

- TSTR, стратифицированный по целевому децилю

Конфиденциальность

- Риск вывода о членстве

- Вывод атрибутов с помощью квазиидентификаторов

- Тест на повышение эффективности вывода атрибутов

Оптимальный пороговый уровень зависит от конкретного сценария использования.

Наиболее упущенный из виду аспект круглого стола FCA-ICO-Института Алана Тьюринга по проверке синтетических данных заключался в следующем: «Нулевой риск = нулевая полезность». Синтетические данные не могут быть одновременно полностью конфиденциальными и полезными. Вопрос больше не в том, «Проходят ли данные проверку?», а в том, «Соответствуют ли компромиссы потребностям конкретных сценариев использования?»

Синтетические данные, используемые для внутреннего тестирования качества приложения, требуют высокой точности и структурной достоверности. Однако, поскольку доступ к данным контролируется, вопросам конфиденциальности уделяется меньше внимания.

С другой стороны, данные, которые вы предоставляете внешним пользователям, организациям, регулирующим органам или для исследовательских целей, должны иметь более высокие гарантии конфиденциальности. В таких случаях вы можете смириться с более низкой статистической точностью синтетических данных.

Поэтому при разработке системы оценки определите сценарий использования до того, как будете оценивать синтетические данные. Ответьте на следующие вопросы, прежде чем создавать синтетические данные:

1) Кто будет иметь доступ к этому синтетическому набору данных и при каких условиях? Это определяет ваш порог конфиденциальности.

2) Для каких последующих задач будут использоваться эти данные для обучения или тестирования? Это определяет показатели полезности, которые являются основными, а какие — шумовыми.

3) Требуются ли какие-либо характеристики для последующей задачи? Если да, то это определяет, где необходимо сохранять точность, а где допустимы отклонения.

Установите эти пороговые значения на основе ваших ответов на вышеуказанные вопросы, прежде чем запускать синтез. Проведите оценку, используя установленные вами пороговые значения (а не пороговые значения, сообщаемые инструментом по умолчанию).

В заключение: Разрыв в качестве — это разрыв в измерениях.

Модель обнаружения мошенничества потерпела неудачу не из-за низкого качества синтетических данных. Модель провалилась из-за того, что команда оценила неверные характеристики и сделала неверные выводы, основываясь на правильных измерениях. Точность, полезность и конфиденциальность являются правильными параметрами.

Стандартные метрики в рамках каждого измерения являются хорошей отправной точкой. Однако они были разработаны для измерения и описания данных, а не для сертификации данных для использования в производственных целях. Для устранения этого пробела в измерении необходимы три дополнительных оценки, которые выявляют пробелы в стандартных метриках: дрейф корреляции, полезность хвоста распределения по децилям и риск вывода атрибутов.

Для этих трех оценок не требуются специальные инструменты. Три описанные в этой статье реализации работают в рамках стандартных библиотек scikit-learn и NumPy. Сложность заключается не в написании кода, а в том, чтобы задавать правильные вопросы перед внедрением модели в производство.

Источник: towardsdatascience.com

notion теперь позволяет создавать веб-сайты из документов всего в один клик.

Добавить комментарий

Для отправки комментария вам необходимо авторизоваться.