DeepSeek-V4 обладает практически самыми современными интеллектуальными функциями и стоит в 6 раз дешевле, чем Opus 4.7 и GPT-5.5.

Карл Франзен

Опубликовано

Обновлено

Кит снова всплыл на поверхность.

Китайский стартап DeepSeek, занимающийся разработкой искусственного интеллекта и являющийся подразделением компании High-Flyer Capital Management, специализирующейся на количественном анализе, в январе 2025 года практически в одночасье стал мировой сенсацией после выпуска своей модели R1 с открытым исходным кодом, которая сравнялась с проприетарными моделями американских гигантов.

С тех пор в сфере искусственного интеллекта произошла целая эпоха, и хотя DeepSeek выпустила несколько обновлений для этой модели и других своих серий V3, международное сообщество, занимающееся ИИ и бизнесом, в основном с замиранием сердца ждало продолжения успеха модели R1.

И вот, вчера вечером вышел DeepSeek-V4, модель смешанного экспертного анализа (Mixture-of-Experts, MoE) с 1,6 триллионами параметров, доступная бесплатно под коммерчески выгодной открытой лицензией MIT, которая приближается к производительности самых передовых в мире систем с закрытым исходным кодом, а по некоторым показателям даже превосходит её, при этом стоимость интерфейса прикладного программирования (API) составляет примерно 1/6 от стоимости самого API.

Этот релиз, который исследователь DeepSeek AI Дели Чен описал на X как «дело всей жизни», спустя 484 дня после запуска V3, называют «вторым моментом DeepSeek».

Как отметил Чен в своем посте, «AGI принадлежит всем». Он уже доступен в сообществе по обмену кодом в области ИИ Hugging Face и через API DeepSeek.

Искусственный интеллект передового уровня вытесняется в более низкий ценовой сегмент.

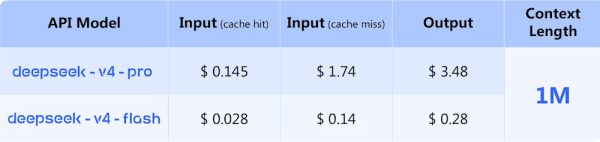

Наиболее непосредственное влияние запуска DeepSeek-V4 носит экономический характер. Исправленная таблица цен показывает, что DeepSeek не устанавливает цену на свою новую модель Pro на уровне, близком к нулю, но всё же обеспечивает доступ к высококлассным моделям по гораздо более низкой цене, чем ведущие американские модели.

Цена DeepSeek-V4-Pro через API составляет 1,74 доллара США за 1 миллион входных токенов при промахе кэша и 3,48 доллара США за миллион выходных токенов .

Это позволяет провести простое сравнение миллиона входных и миллиона выходных данных по цене 5,22 доллара . При использовании кэшированных входных данных цена снижается до 0,145 доллара за миллион токенов , что приводит к тому, что в результате того же комбинированного сравнения цена составляет 3,625 доллара .

Это значительно дешевле, чем нынешние премиальные цены от OpenAI и Anthropic. Цена GPT-5.5 составляет 5 долларов за миллион входных токенов и 30 долларов за миллион выходных токенов , что в сумме составляет 35 долларов при том же простом сравнении.

Стоимость Claude Opus 4.7 составляет 5,00 долларов США на входе и 25,00 долларов США на выходе , что в сумме составляет 30,00 долларов США .

|

Модель |

Вход |

Выход |

Общая стоимость |

Источник |

|

Grok 4.1 Fast |

0,20 доллара |

0,50 доллара |

0,70 доллара |

xAI |

|

Минимакс М2.7 |

0,30 доллара |

1,20 доллара |

1,50 доллара |

МиниМакс |

|

Gemini 3 Flash |

0,50 доллара |

3,00 доллара |

3,50 доллара |

|

|

Кими-К2.5 |

0,60 доллара |

3,00 доллара |

3,60 доллара |

Лунный выстрел |

|

MiMo-V2-Pro (≤256K) |

1,00 долл. |

3,00 доллара |

4,00 доллара |

Сяоми МиМо |

|

ГЛМ-5 |

1,00 долл. |

3,20 доллара |

4,20 доллара |

З.ай |

|

GLM-5-Turbo |

1,20 доллара |

4,00 доллара |

5,20 долларов |

З.ай |

|

DeepSeek-V4-Pro |

1,74 доллара |

3,48 доллара |

5,22 доллара |

DeepSeek |

|

GLM-5.1 |

1,40 доллара |

4,40 доллара |

5,80 долларов |

З.ай |

|

Клод Хайку 4.5 |

1,00 долл. |

5,00 долларов |

6,00 долларов |

Антропический |

|

Qwen3-Max |

1,20 доллара |

6,00 долларов |

7,20 долларов |

Alibaba Cloud |

|

Gemini 3 Pro |

2,00 доллара |

12,00 долларов |

14,00 долларов |

|

|

ГПТ-5.2 |

1,75 доллара |

14,00 долларов |

15,75 долларов |

OpenAI |

|

ГПТ-5.4 |

2,50 доллара |

15,00 долларов |

17,50 долларов |

OpenAI |

|

Клод Сонет 4.5 |

3,00 доллара |

15,00 долларов |

18,00 долларов |

Антропический |

|

Клод Опус 4.7 |

5,00 долларов |

25,00 долларов |

30,00 долларов |

Антропический |

|

ГПТ-5.5 |

5,00 долларов |

30,00 долларов |

35,00 долларов |

OpenAI |

|

GPT-5.4 Pro |

30,00 долларов |

180,00 долларов США |

210,00 долларов США |

OpenAI |

В стандартном ценообразовании с учетом промахов кэша DeepSeek-V4-Pro стоит примерно одну седьмую часть от стоимости GPT-5.5 и около одной шестой (1/6) от стоимости Claude Opus 4.7 .

При использовании кэшированного ввода разрыв увеличивается: DeepSeek-V4-Pro стоит примерно в десять раз дешевле, чем GPT-5.5 , и примерно в восемь раз дешевле, чем Claude Opus 4.7 .

Наиболее экстремальная ситуация с почти нулевым кэшированием относится к DeepSeek-V4-Flash , а не к модели Pro. Цена Flash составляет 0,14 доллара за миллион входных токенов при промахе кэша и 0,28 доллара за миллион выходных токенов , что в сумме составляет 0,42 доллара .

При использовании кэшированного ввода эта сумма снижается до 0,308 доллара . В этом случае более дешевая модель DeepSeek более чем на 98% уступает GPT-5.5 и Claude Opus 4.7 при простом сравнении ввода и вывода, или почти в 100 раз дешевле — хотя производительность значительно снижается.

DeepSeek сжимает экономику сложных моделей в гораздо более низкий диапазон, вынуждая разработчиков и предприятия пересматривать соотношение затрат и выгод, связанных с премиальными закрытыми моделями.

Для компаний, обрабатывающих большие объемы задач машинного обучения, эта разница в цене может изменить представление о том, что стоит автоматизировать. Задачи, которые кажутся слишком дорогостоящими на GPT-5.5 или Claude Opus 4.7, могут стать экономически целесообразными на DeepSeek-V4-Pro, и тем более на DeepSeek-V4-Flash. Запуск не делает интеллектуальные решения бесплатными, но он затрудняет защиту рынка для поставщиков премиум-класса исключительно за счет производительности.

Тестирование производительности на переднем крае технологий: DeepSeek-V4-Pro показывает близкие результаты, но GPT-5.5 и Opus 4.7 по-прежнему лидируют в большинстве общих тестов.

DeepSeek-V4-Pro-Max лучше всего рассматривать как значительный скачок в производительности в открытом ценовом сегменте, а не как безоговорочную победу над новейшими системами закрытого типа.

Наиболее убедительные результаты тестов этой модели получены в собственных сравнительных таблицах DeepSeek, где она сравнивается с GPT-5.4 xHigh, Claude Opus 4.6 Max и Gemini 3.1 Pro High и превосходит их в нескольких тестах, включая Codeforces и Apex Shortlist.

Но это не то же самое, что прямое сравнение с более новой версией GPT-5.5 от OpenAI или более новой версией Claude Opus 4.7 от Anthropic.

Если рассматривать только DeepSeek-V4 в сравнении с новейшими проприетарными моделями, картина выглядит более сдержанной.

В этом общем наборе GPT-5.5 и Claude Opus 4.7 по-прежнему лидируют в большинстве категорий.

Наилучший результат DeepSeek-V4-Pro-Max показал в BrowseComp , бенчмарке, измеряющем возможности веб-серфинга с помощью агентного ИИ (особенно в отношении сильно контейнеризированной информации), где он набрал 83,4%, немного уступив GPT-5.5 с 84,4% и опередив Claude Opus 4.7 с 79,3%.

В тесте Terminal-Bench 2.0 DeepSeek показывает результат 67,9% , что близко к 69,4% у Claude Opus 4.7, но значительно отстает от 82,7% у GPT-5.5.

|

Бенчмарк |

DeepSeek-V4-Pro-Max |

ГПТ-5.5 |

GPT-5.5 Pro, где показано |

Клод Опус 4.7 |

Лучший результат среди них |

|

GPQA Diamond |

90,1% |

93,6% |

— |

94,2% |

Клод Опус 4.7 |

|

Последний экзамен человечества, без инструментов. |

37,7% |

41,4% |

43,1% |

46,9% |

Клод Опус 4.7 |

|

Последний экзамен человечества с использованием инструментов |

48,2% |

52,2% |

57,2% |

54,7% |

GPT-5.5 Pro |

|

Терминальный стенд 2.0 |

67,9% |

82,7% |

— |

69,4% |

ГПТ-5.5 |

|

SWE-Bench Pro / SWE Pro |

55,4% |

58,6% |

— |

64,3% |

Клод Опус 4.7 |

|

BrowseComp |

83,4% |

84,4% |

90,1% |

79,3% |

GPT-5.5 Pro |

|

MCP Atlas / MCPAtlas Public |

73,6% |

75,3% |

— |

79,1% |

Клод Опус 4.7 |

Результаты, полученные в ходе академического анализа, свидетельствуют в пользу закрытых моделей: на GPQA Diamond DeepSeek-V4-Pro-Max набирает 90,1%, GPT-5.5 достигает 93,6%, а Claude Opus 4.7 — 94,2%.

В тесте Humanity's Last Exam без использования инструментов DeepSeek показал результат 37,7%, уступив GPT-5.5 (41,4%), GPT-5.5 Pro (43,1%) и Claude Opus 4.7 (46,9%). С включенными инструментами DeepSeek показал результат 48,2%, но все еще отстает от GPT-5.5 (52,2%), GPT-5.5 Pro (57,2%) и Claude Opus 4.7 (54,7%).

Результаты, полученные с помощью агентных и программно-инженерных методов, более неоднозначны, но все же показывают, что DeepSeek-V4-Pro-Max уступает GPT-5.5 и Opus 4.7.

В тесте Terminal-Bench 2.0 показатель DeepSeek в 67,9% сопоставим с 69,4% у Claude Opus 4.7, но GPT-5.5 значительно превосходит его, показав результат в 82,7%.

В тесте SWE-Bench Pro DeepSeek показал результат 55,4%, уступая GPT-5.5 (58,6%) и Claude Opus 4.7 (64,3%). В тесте MCP Atlas DeepSeek показал результат 73,6%, немного отставая от GPT-5.5 (75,3%) и Claude Opus 4.7 (79,1%).

BrowseComp демонстрирует лучшие результаты: показатель DeepSeek в 83,4% превосходит 79,3% у Claude Opus 4.7 и почти совпадает с показателем GPT-5.5 в 84,4%, хотя 90,1% у GPT-5.5 Pro по-прежнему значительно опережает его.

В конечном итоге, DeepSeek-V4-Pro-Max, похоже, не смещает GPT-5.5 или Claude Opus 4.7 в тестах, которые можно напрямую сравнить по опубликованным таблицам компаний. Но он достаточно близок к ним в нескольких из них — особенно в BrowseComp, Terminal-Bench 2.0 и MCP Atlas — поэтому его значительно более низкая цена API становится главной новостью.

На практике DeepSeek не обязательно выигрывать каждый пункт в рейтинге, чтобы иметь значение. Если он сможет обеспечить производительность, близкую к передовой, во многих актуальных для корпоративного сектора задачах построения агентов и логического мышления, при этом стоимость его API будет примерно в шесть-семь раз ниже, чем у GPT-5.5 или Claude Opus 4.7, это все равно заставит серьезно переосмыслить экономику внедрения передовых решений в области ИИ.

DeepSeek-V4-Pro-Max, несомненно, является самой мощной моделью открытого типа на данный момент, и по ряду практических показателей она необычайно близка к передовым закрытым системам.

Хотя GPT-5.5 и Claude Opus 4.7 по-прежнему лидируют в большинстве прямых сравнительных тестов компании, DeepSeek V4 Pro приближается к ним по производительности, при этом будучи значительно дешевле и имея открытый доступ.

Значительный скачок по сравнению с DeepSeek V3.2.

Чтобы понять масштаб этого релиза, необходимо взглянуть на прирост производительности базовых моделей. DeepSeek-V4-Pro-Base представляет собой значительный шаг вперед по сравнению с предыдущим поколением, DeepSeek-V3.2-Base. В тесте World Knowledge модель V4-Pro-Base достигла показателя 90,1 на MMLU (5-shot) по сравнению с 87,8 у V3.2, а также произошел огромный скачок на MMLU-Pro с 65,5 до 73,5.

Улучшение в рассуждениях высокого уровня и подтверждении фактов еще более заметно: в тесте SuperGPQA версия V4-Pro-Base достигла 53,9 балла по сравнению с 45,0 баллами в версии V3.2, а в бенчмарке FACTS Parametric она более чем вдвое превзошла своего предшественника, подскочив с 27,1 до 62,6 баллов. Показатели подтверждения в тесте Simple-QA также значительно выросли — с 28,3 до 55,2 баллов.

Возможности анализа длинного контекста также были усовершенствованы. В тесте LongBench-V2 версия V4-Pro-Base набрала 51,5 балла, что значительно превосходит результат V3.2-Base (40,2 балла). В тестах Code and Math версия V4-Pro-Base достигла 76,8 балла на HumanEval (Pass@1), что выше показателя V3.2-Base (62,8 балла).

Эти цифры подчеркивают, что DeepSeek не просто оптимизировал вычислительные ресурсы, но и принципиально повысил плотность интеллекта своей базовой архитектуры. Эффективность также впечатляет для варианта Flash. DeepSeek-V4-Flash-Base, несмотря на использование значительно меньшего количества параметров, превосходит более крупный V3.2-Base в широком диапазоне тестов, особенно в сценариях с длительным контекстом.

Новый «контроллер информационного потока» — гиперсоединения с ограниченными многообразиями (mHC).

Возможность DeepSeek предлагать такие цены и показатели производительности основана на радикальных архитектурных инновациях, подробно описанных в техническом отчете компании, также опубликованном сегодня, под названием «К высокоэффективному контекстному анализу на основе миллионов токенов».

Главным техническим достижением V4 является встроенное контекстное окно в миллион токенов. Исторически сложилось так, что поддержание такого большого контекста требовало огромного объема памяти (кэш ключ-значение или кэш ключ-значение).

DeepSeek решил эту проблему, внедрив гибридную архитектуру внимания, которая сочетает в себе сжатое разреженное внимание (CSA) для уменьшения исходной размерности токенов и сильно сжатое внимание (HCA) для агрессивного сжатия объема памяти, используемой для зависимостей на больших расстояниях.

На практике модель V4-Pro требует всего 10% кэша ключ-значение и 27% операций с плавающей запятой для вывода одного токена по сравнению со своим предшественником, DeepSeek-V3.2, даже при работе в контексте 1 миллиона токенов.

Для стабилизации сети из 1,6 триллиона параметров DeepSeek вышла за рамки традиционных остаточных связей. Исследователи компании внедрили гиперсвязи с ограничениями на многообразие (mHC), чтобы усилить распространение сигнала между слоями, сохраняя при этом выразительность модели.

mHC позволяет ИИ получать гораздо более широкий поток информации (что позволяет ему изучать более сложные вещи) без риска нестабильности или «сбоя» модели во время обучения. Это как если бы в городе была 10-полосная автомагистраль, но с идеальным ИИ-диспетчером, который бы гарантировал, что никто никогда не нажмет на тормоз.

В сочетании с оптимизатором Muon это позволило команде добиться более быстрой сходимости и большей стабильности обучения на этапе предварительного обучения с использованием более чем 32 ТБ разнообразных и высококачественных токенов.

Предварительные обучающие данные были доработаны для удаления автоматически сгенерированного контента с штриховкой, что снизило риск сбоя модели и позволило отдать приоритет уникальным академическим значениям. Модель с 1,6T параметрами использует схему «смешанных экспертов» (Mixture-of-Experts, MoE), где на каждый токен активируется всего 49B параметров, что еще больше снижает вычислительные требования.

Обучение группы экспертов работе в качестве единого целого.

DeepSeek-V4 не просто обучался; он был «культивирован» с помощью уникальной двухэтапной парадигмы.

-

Во-первых, в рамках программы независимого развития экспертов, специалисты в конкретных областях были обучены с помощью контролируемой тонкой настройки (SFT) и обучения с подкреплением (RL) с использованием алгоритма GRPO (Group Relative Policy Optimization). Это позволило каждому эксперту освоить специализированные навыки, такие как математическое мышление или анализ кодовой базы.

-

Во-вторых, в рамках концепции унифицированной консолидации моделей эти различные компетенции были объединены в единую модель посредством дистилляции на основе политики, где унифицированная модель выступает в роли ученика, обучающегося оптимизации обратной функции потерь KL с помощью моделей-учителей. Этот процесс дистилляции гарантирует, что модель сохраняет специализированные возможности каждого эксперта, функционируя при этом как единое целое.

Способности модели к рассуждению дополнительно подразделяются на три возрастающих режима «усилий».

-

Режим «Без размышлений» обеспечивает быстрые и интуитивно понятные ответы на рутинные задачи.

-

Книга «Think High» предлагает осознанный логический анализ для решения сложных задач.

-

Наконец, «Think Max» расширяет границы моделирования, преодолевая разрыв с передовыми моделями в сложных задачах рассуждения и агентного управления. Такая гибкость позволяет пользователям соотносить вычислительные затраты со сложностью задачи, что еще больше повышает экономическую эффективность.

Преодоление монополии Nvidia на графические процессоры с помощью локальных китайских NPU Huawei Ascend.

Хотя весовые коэффициенты модели являются главным преимуществом, программный комплекс, выпущенный одновременно с ними, имеет, пожалуй, еще большее значение для будущего «суверенного ИИ».

Аналитик Руи Ма выделил одно предложение из пресс-релиза как наиболее важное: DeepSeek подтвердила работоспособность своей схемы экспертного параллелизма (EP) с высокой степенью детализации на нейронных процессорах Huawei Ascend.

Достигнув ускорения в 1,50–1,73 раза на платформах, отличных от Nvidia, DeepSeek представила план высокопроизводительного развертывания ИИ, устойчивого к западным цепочкам поставок графических процессоров и экспортному контролю.

Однако важно отметить, что DeepSeek по-прежнему утверждает, что для обучения DeepSeek V4 использовала официально лицензированные, легальные графические процессоры Nvidia, а также нейронные процессоры Huawei.

Компания DeepSeek также открыла исходный код мегаядра MegaMoE в качестве компонента своей библиотеки DeepGEMM. Эта реализация на базе CUDA обеспечивает ускорение до 1,96 раз для задач, чувствительных к задержкам, таких как развертывание RL-процессов и высокоскоростное обслуживание агентов.

Этот шаг гарантирует, что разработчики смогут с высокой эффективностью запускать эти масштабные модели на существующем оборудовании, что еще больше укрепит роль DeepSeek как основного разработчика инфраструктуры искусственного интеллекта с открытым исходным кодом.

В техническом отчете подчеркивается, что эти оптимизации имеют решающее значение для поддержки стандартного контекста 1M во всех официальных сервисах.

Лицензирование и локальное развертывание

DeepSeek-V4 распространяется под лицензией MIT, самой либеральной в отрасли. Это позволяет разработчикам использовать, копировать, изменять и распространять веса в коммерческих целях без выплаты роялти — в отличие от «ограниченных» лицензий на открытые веса, которые предпочитают другие компании.

Для локального развертывания DeepSeek рекомендует установить параметры выборки на temperature = 1.0 и top_p = 1.0. Для тех, кто использует режим рассуждений «Think Max», команда рекомендует установить контекстное окно не менее чем на 384 тыс. токенов, чтобы избежать усечения внутренних цепочек рассуждений модели.

В релиз включена специальная папка encoding со скриптами Python, демонстрирующими, как кодировать сообщения в формате, совместимом с OpenAI, и анализировать выходные данные модели, включая содержание рассуждений.

DeepSeek-V4 также легко интегрируется с ведущими агентами искусственного интеллекта, такими как Claude Code, OpenClaw и OpenCode. Эта встроенная интеграция подчеркивает его роль как основы для инструментов разработчиков, предоставляя альтернативу с открытым исходным кодом проприетарным экосистемам крупных облачных провайдеров.

Реакция сообщества и что будет дальше

Реакция сообщества была одновременно шокирующей и подтверждающей правильность решения. Hugging Face официально приветствовал возвращение «кита», заявив, что наступила эра экономически выгодной длины контекста в 1 миллион символов.

Эксперты отрасли отметили, что «второй момент DeepSeek» фактически изменил траекторию развития всей области, оказав огромное давление на поставщиков закрытого программного обеспечения, таких как OpenAI и Anthropic, с целью оправдать их высокие цены.

Компания Vals AI, занимающаяся оценкой искусственного интеллекта, отметила, что DeepSeek-V4 теперь является «моделью с самым высоким открытым весом в нашем бенчмарке Vibe Code Benchmark, и ей нет равных».

DeepSeek быстро переходит на устаревшие архитектуры. Компания объявила, что устаревшие конечные точки deepseek-chat и deepseek-reasoner будут полностью выведены из эксплуатации 24 июля 2026 года. Весь трафик в настоящее время перенаправляется на архитектуру V4-Flash, что означает полный переход на стандарт с миллионом токенов.

DeepSeek-V4 — это больше, чем просто новая модель; это вызов существующему положению вещей. Доказав, что архитектурные инновации могут заменить чрезмерный максимализм в вычислительных мощностях, DeepSeek сделал самые высокие уровни искусственного интеллекта доступными для мирового сообщества разработчиков по гораздо более низкой цене — это может принести пользу всему миру, даже в то время, когда законодатели и лидеры в Вашингтоне выражают обеспокоенность по поводу того, что китайские лаборатории «перерабатывают» данные из проприетарных моделей американских гигантов для обучения моделей с открытым исходным кодом, и опасаются, что эти модели с открытым исходным кодом или взломанные проприетарные модели могут быть использованы для создания оружия и совершения террористических актов.

Правда в том, что, хотя все это потенциальные риски — как это было и есть с предыдущими технологиями, расширившими доступ к информации, такими как поиск и сам интернет, — преимущества, похоже, намного перевешивают их, и стремление DeepSeek сохранить открытыми передовые модели ИИ приносит пользу всей планете потенциальных пользователей ИИ, особенно предприятиям, стремящимся внедрить передовые технологии с минимальными затратами.

Подпишитесь, чтобы получать самые свежие новости!

Подробные аналитические данные для руководителей предприятий в области искусственного интеллекта, данных и безопасности.

Отправляя свой адрес электронной почты, вы соглашаетесь с нашими Условиями использования и Политикой конфиденциальности.

Получайте обновления ! Вы подписаны! Наши последние новости скоро поступят на вашу электронную почту.

Источник: venturebeat.com

Добавить комментарий

Для отправки комментария вам необходимо авторизоваться.