Система DisCIPL с функцией «самоуправления» направляет небольшие модели на совместную работу над задачами с ограничениями, такими как планирование маршрута и составление бюджета.  Новый подход, разработанный исследователями из MIT CSAIL, использует языковую модель (LLM) для планирования решения сложных задач логического мышления, а затем распределяет работу по реализации этой стратегии между меньшими языковыми моделями. Их метод помогает языковым моделям давать более точные ответы, чем ведущие LLM, и приближаться к точности лучших систем логического мышления, будучи при этом более эффективными, чем обе эти модели. Изображение: Алекс Шиппс/MIT CSAIL

Новый подход, разработанный исследователями из MIT CSAIL, использует языковую модель (LLM) для планирования решения сложных задач логического мышления, а затем распределяет работу по реализации этой стратегии между меньшими языковыми моделями. Их метод помогает языковым моделям давать более точные ответы, чем ведущие LLM, и приближаться к точности лучших систем логического мышления, будучи при этом более эффективными, чем обе эти модели. Изображение: Алекс Шиппс/MIT CSAIL

По мере того, как языковые модели (ЯМ) улучшают свои навыки в таких задачах, как генерация изображений, ответы на викторины и простые математические вычисления, можно подумать, что рассуждения, подобные человеческим, уже не за горами. В действительности же они по-прежнему значительно отстают от нас в решении сложных задач. Попробуйте, например, сыграть в судоку с помощью такой модели, где нужно заполнить числа от одного до девяти таким образом, чтобы каждое число встречалось только один раз в столбцах, строках и секциях сетки 9 на 9. Ваш противник-ИИ либо не сможет самостоятельно заполнить ячейки, либо сделает это неэффективно, хотя и сможет проверить, правильно ли вы заполнили свои ячейки.

Независимо от того, пытается ли языковая модель решить сложные задачи, спроектировать молекулы или написать математические доказательства, система с трудом справляется с открытыми запросами, требующими соблюдения строгих правил. Модель лучше подсказывает пользователям, как решать эти задачи, чем пытается сделать это самостоятельно. Более того, для решения практических задач языковым моделям необходимо учитывать широкий спектр вариантов, соблюдая при этом ограничения. Небольшие языковые модели не могут делать это надежно самостоятельно; большие языковые модели (БЯМ) иногда могут, особенно если они оптимизированы для задач рассуждения, но им требуется время для ответа, и они потребляют много вычислительной мощности.

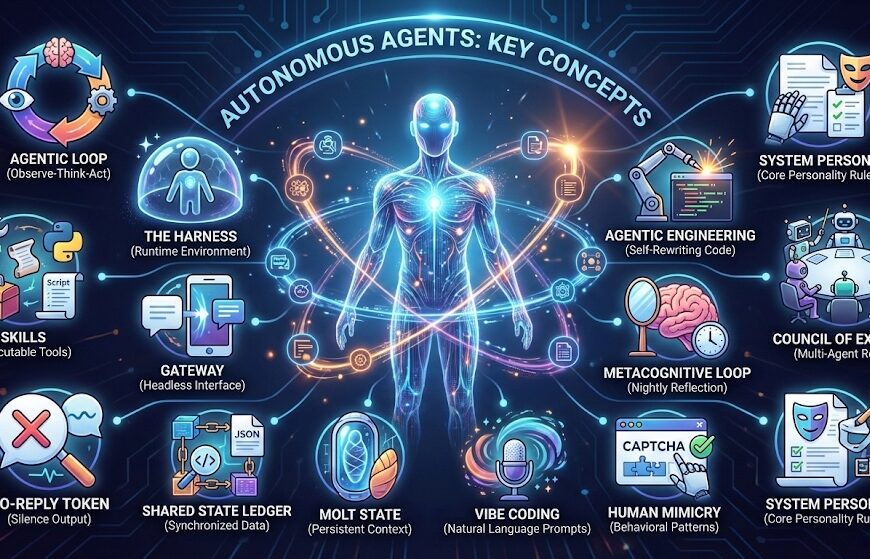

Эта сложная ситуация побудила исследователей из Лаборатории компьютерных наук и искусственного интеллекта Массачусетского технологического института (CSAIL) разработать подход, основанный на сотрудничестве, при котором языковая модель (LLM) занимается планированием, а затем распределяет работу по реализации этой стратегии между более мелкими моделями. Их метод помогает небольшим языковым моделям предоставлять более точные ответы, чем ведущие LLM, такие как GPT-4o от OpenAI, и приближаться к точности лучших систем рассуждений, таких как o1, будучи при этом более эффективными, чем обе эти системы. Их структура, называемая «Распределительные ограничения посредством программирования вывода с использованием языковых моделей» (или «DisCIPL»), позволяет большой модели направлять меньшие «последовательные» модели к точным ответам при написании таких вещей, как текстовые заметки, списки покупок с бюджетом и маршруты путешествий.

Внутренний механизм DisCIPL во многом похож на заключение контракта с компанией на выполнение конкретной работы. Вы предоставляете модели-«начальнику» запрос, и она тщательно обдумывает, как выполнить этот проект. Затем модель-лидер (LLM) в понятной форме передает эти инструкции и указания более мелким моделям. Она корректирует результаты работы моделей-последователей там, где это необходимо — например, заменяет формулировку одной модели, не подходящую для стихотворения, на более подходящий вариант из другой.

Язык LLM взаимодействует со своими последователями, используя язык, понятный всем, — язык программирования для управления языковыми моделями, называемый «LLaMPPL». Разработанный в 2023 году проектом MIT по вероятностным вычислениям, этот язык позволяет пользователям кодировать определенные правила, которые направляют модель к желаемому результату. Например, LLaMPPL можно использовать для создания безошибочного кода путем включения правил определенного языка в его инструкции. Такие указания, как «напишите восемь строк стихотворения, где каждая строка содержит ровно восемь слов», закодированы в LLaMPPL, что ставит в очередь более мелкие модели для участия в различных частях ответа.

Аспирант Массачусетского технологического института Габриэль Гранд, ведущий автор статьи, представляющей эту работу, говорит, что DisCIPL позволяет языковым моделям направлять друг друга к наилучшим ответам, что повышает их общую эффективность. «Мы работаем над повышением эффективности вывода языковых моделей, особенно в многочисленных современных приложениях этих моделей, которые включают генерацию результатов с учетом ограничений», — добавляет Гранд, который также является исследователем CSAIL. «Языковые модели потребляют все больше энергии по мере того, как люди все чаще их используют, а это значит, что нам нужны модели, которые могут давать точные ответы, используя при этом минимальные вычислительные мощности».

«Очень интересно видеть новые альтернативы стандартному выводу языковых моделей», — говорит доцент Калифорнийского университета в Беркли Алейн Сур, которая не принимала участия в исследовании. «Эта работа открывает новые подходы к языковому моделированию и языковым моделям, которые значительно сокращают задержку вывода за счет распараллеливания, требуют значительно меньшего количества параметров, чем существующие языковые модели, и даже улучшают производительность по сравнению со стандартным сериализованным выводом. Работа также предоставляет возможности для изучения прозрачности, интерпретируемости и управляемости выходных данных модели, что по-прежнему является огромной нерешенной проблемой при внедрении этих технологий».

История о том, как кто-то добился успеха, а кто-то нет.

Вы можете считать, что более крупные языковые модели «лучше» справляются со сложными задачами, чем более мелкие, с точки зрения точности и эффективности. DisCIPL предлагает неожиданный контраргумент для этих задач: если вы сможете объединить сильные стороны более мелких моделей, вы можете увидеть повышение эффективности при аналогичных результатах.

Исследователи отмечают, что теоретически в рамках DisCIPL можно подключить десятки языковых программирования (ЛМ) для совместной работы, независимо от их размера. В экспериментах по написанию и рассуждениям они использовали GPT-4o в качестве «планирующего ЛМ», одной из моделей, помогающих ChatGPT генерировать ответы. Она разработала план для нескольких моделей «Llama-3.2-1B» (меньшие системы, разработанные Meta), в которых эти ЛМ заполняли каждое слово (или токен) ответа.

Этот коллективный подход конкурировал с тремя аналогичными: базовым подходом, основанным только на использовании функции «последователя» и работающим на базе Llama-3.2-1B, автономным GPT-4o и ведущей в отрасли системой логического мышления o1, которая помогает ChatGPT решать более сложные задачи, такие как запросы на программирование и математические задачи.

В DisCIPL впервые была продемонстрирована возможность написания предложений и абзацев, следующих четким правилам. Модели получали очень конкретные подсказки — например, написать предложение, состоящее ровно из 18 слов, где четвертое слово должно быть «Глазго», восьмое — «в», а одиннадцатое — «и». Система удивительно хорошо справлялась с этим запросом, создавая связные результаты, достигая при этом точности и связности, сравнимых с o1.

Быстрее, дешевле, лучше

Этот эксперимент также показал, что ключевые компоненты DisCIPL значительно дешевле, чем современные системы. Например, в то время как существующие модели рассуждений, такие как o1 от OpenAI, выполняют рассуждения в текстовом формате, DisCIPL «рассуждает», используя код на Python, что делает его более компактным. На практике исследователи обнаружили, что DisCIPL обеспечивает сокращение времени рассуждений на 40,1% и экономию средств на 80,2% по сравнению с o1.

Повышение эффективности DisCIPL частично обусловлено использованием небольших моделей Llama в качестве последователей, которые в 1000–10000 раз дешевле в расчете на токен, чем сопоставимые модели рассуждений. Это означает, что DisCIPL более «масштабируем» — исследователи смогли запускать десятки моделей Llama параллельно за гораздо меньшую стоимость.

По словам исследователей CSAIL, это были не единственные неожиданные результаты. Их система также показала хорошие результаты по сравнению с o1 в реальных задачах, таких как составление списков ингредиентов, планирование маршрута путешествия и написание заявок на гранты с ограничением по количеству слов. В то же время GPT-4o испытывала трудности с этими запросами, а при тестировании навыков письма часто не могла правильно расставить ключевые слова в предложениях. Базовая модель, использующая только подчинённых, по сути, заняла последнее место по всем параметрам, поскольку испытывала трудности с выполнением инструкций.

«За последние несколько лет мы наблюдали впечатляющие результаты, полученные с помощью подходов, использующих языковые модели для «автоматической формализации» задач в математике и робототехнике путем их представления в виде кода», — говорит ведущий автор исследования Джейкоб Андреас, доцент кафедры электротехники и информатики Массачусетского технологического института и главный исследователь CSAIL. «Что меня больше всего радует в этой статье, так это то, что теперь мы можем использовать языковые модели для автоматической формализации самой генерации текста, что обеспечивает те же преимущества в эффективности и гарантии, которые мы наблюдали в других областях».

В будущем исследователи планируют расширить эту структуру, превратив её в более рекурсивный подход, где можно использовать одну и ту же модель как для лидера, так и для последователей. Гранд добавляет, что DisCIPL можно расширить до задач математического мышления, где ответы сложнее проверить. Они также намерены проверить систему на её способность удовлетворять нечётким предпочтениям пользователей, в отличие от следования жёстким ограничениям, которые нельзя так явно описать в коде. Заглядывая ещё дальше в будущее, команда надеется использовать максимально возможные модели, хотя и отмечает, что такие эксперименты требуют больших вычислительных затрат.

Гранд и Андреас написали статью совместно с руководителем проекта CSAIL и профессором Массачусетского технологического института Джошуа Тенебаумом, а также ведущим научным сотрудником кафедры нейробиологии и когнитивных наук Массачусетского технологического института Викашем Мансингхкой и доцентом Йельского университета Алексом Лью (выпускник 2020 года, доктор философии, выпускник 2025 года). Исследователи CSAIL представили свою работу на конференции по языковому моделированию в октябре и на семинаре IVADO «Развертывание автономных агентов: уроки, риски и влияние на реальный мир» в ноябре.

Их работа частично финансировалась программой MIT Quest for Intelligence, фондом Siegel Family Foundation, лабораторией MIT-IBM Watson AI Lab, стипендией Sloan Research Fellowship, компанией Intel, Управлением научных исследований ВВС США, Агентством перспективных оборонных исследований, Управлением военно-морских исследований и Национальным научным фондом.

Источник: news.mit.edu