Хотя разрыв Вашингтона с компанией Anthropic выявил полное отсутствие каких-либо последовательных правил, регулирующих искусственный интеллект, двухпартийная коалиция мыслителей разработала то, что правительство до сих пор отказывалось представить: концептуальную основу для того, как должна выглядеть ответственная разработка ИИ.

Декларация в защиту прав человека была окончательно оформлена до противостояния Пентагона и антропологов на прошлой неделе, но совпадение этих двух событий не осталось незамеченным ни для кого из участников.

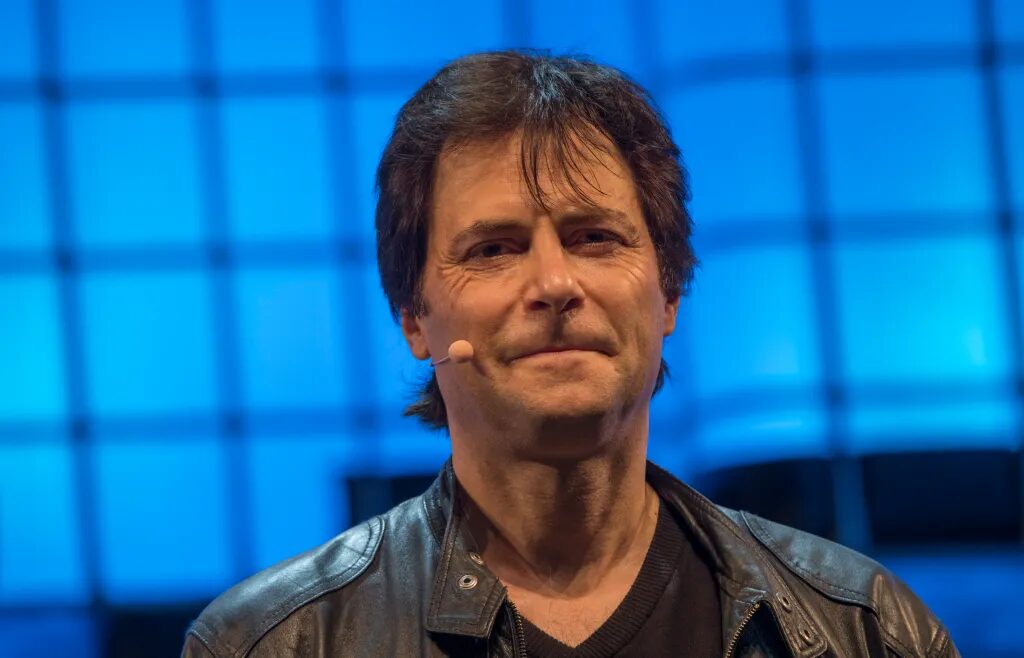

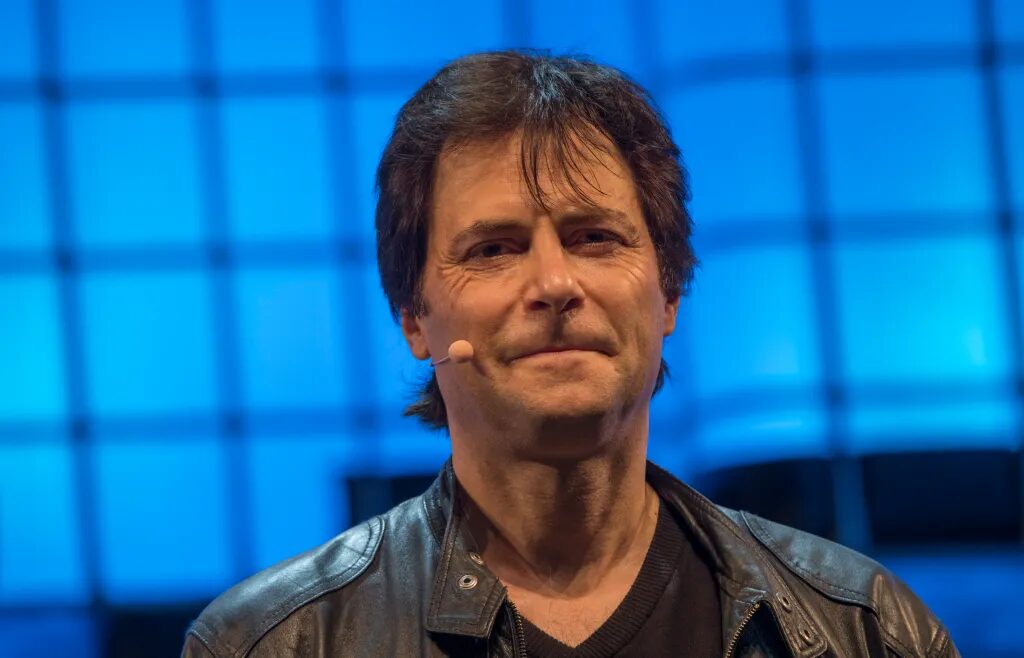

«За последние четыре месяца в Америке произошло нечто совершенно примечательное», — сказал в беседе с редактором Макс Тегмарк, физик из Массачусетского технологического института и исследователь в области искусственного интеллекта, который помог организовать эту инициативу. «Опросы внезапно показали, что 95% всех американцев выступают против неконтролируемой гонки за сверхинтеллектом».

В недавно опубликованном документе, подписанном сотнями экспертов, бывших чиновников и общественных деятелей, говорится о том, что человечество находится на распутье. Один путь, который в декларации называется «гонкой за замену», ведет к тому, что люди сначала будут вытеснены с должности рабочих, а затем и лиц, принимающих решения, в то время как власть сосредоточится в руках неподотчетных институтов и их машин. Другой путь ведет к искусственному интеллекту, который значительно расширит человеческий потенциал.

Последний сценарий основан на пяти ключевых принципах: сохранение контроля со стороны людей, предотвращение концентрации власти, защита человеческого опыта, сохранение индивидуальной свободы и привлечение компаний, занимающихся искусственным интеллектом, к юридической ответственности. Среди его наиболее жестких положений — полный запрет на разработку сверхинтеллекта до тех пор, пока не будет достигнут научный консенсус относительно возможности его безопасного осуществления при подлинной демократической поддержке; обязательное отключение мощных систем; и запрет на архитектуры, способные к самовоспроизведению, автономному самосовершенствованию или сопротивлению отключению.

Публикация декларации совпадает с периодом, который значительно облегчает понимание ее срочности. В последнюю пятницу февраля министр обороны Пит Хегсет присвоил компании Anthropic — чей ИИ уже работает на засекреченных военных платформах — статус «риска для цепочки поставок» после того, как компания отказалась предоставить Пентагону неограниченное использование своей технологии. Этот статус обычно присваивается фирмам, связанным с Китаем. Несколько часов спустя OpenAI заключила собственное соглашение с Министерством обороны, которое, по мнению юристов, будет трудно обеспечить сколько-нибудь значимым образом. Все это наглядно показало, насколько дорогостоящим стало бездействие Конгресса в отношении ИИ.

Как заявил позже Дин Болл, старший научный сотрудник Фонда американских инноваций, в интервью газете The New York Times: «Это не просто спор по поводу контракта. Это первый разговор, который мы как страна вели о контроле над системами искусственного интеллекта».

Мероприятие Techcrunch

Disrupt 2026: Технологическая экосистема в одном месте

Ваш следующий раунд финансирования. Ваш следующий сотрудник. Ваша следующая возможность прорыва. Найдите это на TechCrunch Disrupt 2026, где более 10 000 основателей, инвесторов и лидеров технологической отрасли соберутся на три дня, чтобы принять участие в более чем 250 практических сессиях, установить полезные контакты и познакомиться с инновациями, определяющими рынок. Зарегистрируйтесь сейчас и сэкономьте до 400 долларов.

Сэкономьте до 300 долларов или 30% на посещении TechCrunch Founder Summit.

Более 1000 основателей и инвесторов соберутся на TechCrunch Founder Summit 2026 на целый день, посвященный росту, реализации и масштабированию в реальных условиях. Учитесь у основателей и инвесторов, которые сформировали отрасль. Общайтесь с коллегами, проходящими аналогичные этапы роста. Получите тактические приемы, которые можно применить немедленно.

Предложение действительно до 13 марта.

Сан-Франциско, Калифорния | 13-15 октября 2026 г. ЗАРЕГИСТРИРУЙТЕСЬ СЕЙЧАС

В ходе нашего разговора Тегмарк привёл аналогию, понятную большинству людей. «Вам никогда не придётся беспокоиться о том, что какая-нибудь фармацевтическая компания выпустит ещё один препарат, причиняющий огромный вред, прежде чем люди поймут, как сделать его безопасным, — сказал он, — потому что FDA не позволит им выпустить ничего, пока это не станет достаточно безопасным».

В Вашингтоне редко возникают конфликты на почве личных связей, которые приводят к изменению законов. Вместо этого Тегмарк считает безопасность детей наиболее перспективным фактором для преодоления нынешнего тупика. Действительно, в декларации содержится призыв к обязательному предварительному тестированию продуктов на основе ИИ — особенно чат-ботов и сопутствующих приложений, предназначенных для юных пользователей, — охватывающему такие риски, как усиление суицидальных мыслей, обострение психических расстройств и эмоциональное манипулирование.

«Если какой-нибудь мерзкий старик переписывается с 11-летней девочкой, притворяясь ею, и пытается склонить мальчика к самоубийству, то за это его могут посадить в тюрьму», — сказал Тегмарк. «У нас уже есть законы. Это незаконно. Так почему же, если это делает машина, ситуация другая?»

Он считает, что как только будет установлен принцип предварительного тестирования детской продукции, его масштабы почти неизбежно расширятся. «Люди начнут говорить: давайте добавим еще несколько требований. Возможно, нам следует также проверить, что это не может помочь террористам создавать биологическое оружие. Возможно, нам следует проверить, что сверхразведка не способна свергнуть правительство США».

Примечательно, что бывший советник Трампа Стив Бэннон и советник президента Обамы по национальной безопасности Сьюзан Райс подписали один и тот же документ — наряду с бывшим председателем Объединенного комитета начальников штабов Майком Малленом и прогрессивными религиозными лидерами.

«Конечно, все они сходятся во мнении, что все они люди, — говорит Тегмарк. — Если дело дойдет до вопроса о том, хотим ли мы будущего для людей или будущего для машин, то, конечно же, они будут на одной стороне».

Источник: techcrunch.com