Маск не может убедить судью в том, что общественности безразлично, откуда берутся данные для обучения ИИ.

Источник: Icon Sportswire / Участник | Icon Sportswire Источник: Icon Sportswire / Участник | Icon Sportswire Настройки текстаТекст рассказа Размер Маленький Стандартный Большой Ширина * Стандартный Широкий Ссылки Стандартный Оранжевый * Только для подписчиков

Источник: Icon Sportswire / Участник | Icon Sportswire Источник: Icon Sportswire / Участник | Icon Sportswire Настройки текстаТекст рассказа Размер Маленький Стандартный Большой Ширина * Стандартный Широкий Ссылки Стандартный Оранжевый * Только для подписчиков

Узнать больше Свернуть в навигацию

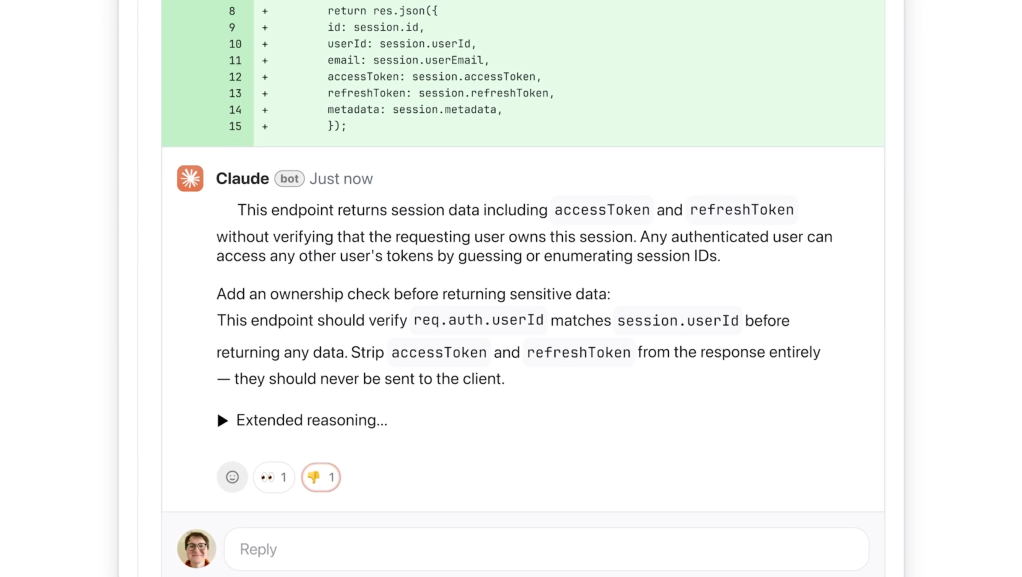

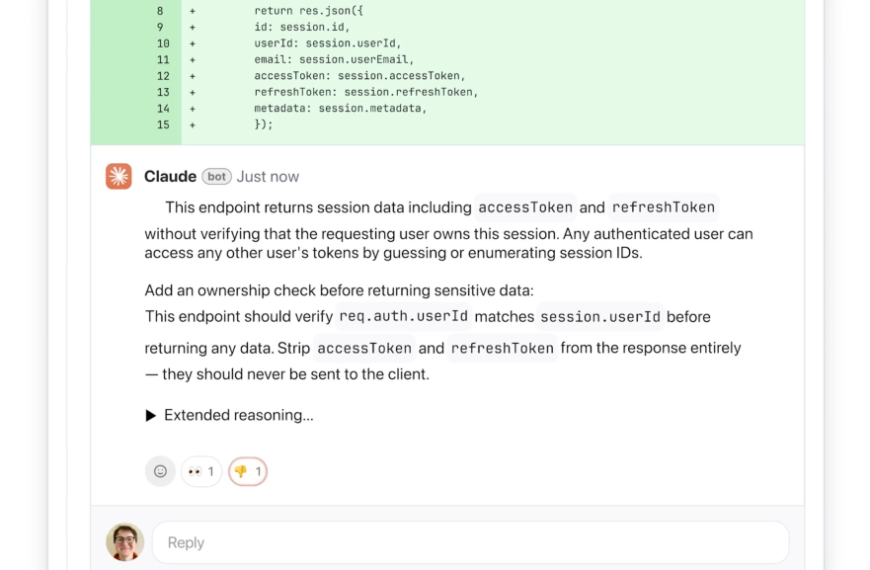

Компания xAI Илона Маска проиграла попытку добиться предварительного судебного запрета, который временно заблокировал бы действие закона штата Калифорния, требующего от компаний, занимающихся искусственным интеллектом, публично делиться информацией о своих обучающих данных.

Компания xAI пыталась доказать, что принятый в Калифорнии законопроект AB 2013 (Assembly Bill 2013) обязывает компании, занимающиеся разработкой искусственного интеллекта, раскрывать тщательно охраняемые коммерческие секреты.

Закон требует от разработчиков ИИ, чьи модели доступны в штате, четко объяснять, какие источники данных использовались для обучения моделей, когда данные были собраны, продолжается ли сбор данных и содержат ли наборы данных какие-либо данные, защищенные авторскими правами, товарными знаками или патентами. Раскрытие информации также позволило бы уточнить, лицензировали ли компании или приобретали обучающие данные, и содержали ли обучающие данные какую-либо личную информацию. Это также помогло бы потребителям оценить, какой объем синтетических данных был использован для обучения модели, что могло бы служить показателем качества.

Однако именно эта информация делает xAI ценным, поскольку, как утверждает xAI, интенсивный сбор данных отличает его от крупнейших конкурентов. Разрешение на принудительное исполнение может оказаться «экономически губительным» для xAI, утверждала компания Маска, фактически сведя «ценность коммерческих секретов xAI к нулю», говорится в жалобе xAI. Кроме того, xAI настаивал, что эти разглашения «никак не могут быть полезны потребителям», одновременно представляя реальный риск уничтожения всей индустрии ИИ.

В частности, компания xAI утверждала, что источники данных, размеры наборов данных и методы их очистки являются коммерческой тайной.

«Если бы конкуренты могли видеть источники всех наборов данных xAI или даже размер этих наборов данных, они могли бы оценить как то, какими данными располагает xAI, так и то, каких данных ей не хватает», — утверждала xAI. В одном из гипотетических примеров xAI предположила, что «если бы OpenAI (другая ведущая компания в области ИИ) обнаружила, что xAI использует важный набор данных для обучения своих моделей, который OpenAI не использует, OpenAI почти наверняка приобрела бы этот набор данных для обучения своей собственной модели, и наоборот».

Однако в постановлении, вынесенном в среду, окружной судья США Хесус Бернал заявил, что компания xAI не смогла доказать, что закон Калифорнии, вступивший в силу в январе, обязывает компанию раскрывать какие-либо коммерческие секреты.

Судья заявил, что главная проблема xAI заключалась в чрезмерной расплывчатости в отношении вреда, который компания понесет, если закон не будет приостановлен. Вместо того чтобы объяснить, почему раскрытие информации может напрямую навредить xAI, компания предложила лишь «множество общих утверждений о важности наборов данных для разработки моделей ИИ и о том, почему они держатся в секрете», — написал Бернал, описывая X как компанию, которая часто использует «абстракции и гипотетические рассуждения».

Он отклонил ходатайство xAI о предварительном судебном запрете, поддержав при этом заинтересованность правительства в оказании помощи общественности в оценке того, как были обучены новейшие модели ИИ.

Судебное разбирательство продолжится, но тем временем xAI придется соблюдать законы Калифорнии. Это может привести к тому, что Маск поделится информацией, о которой он предпочел бы не сообщать OpenAI, в то время как сам он вовлечен в несколько судебных процессов против ведущей компании в области искусственного интеллекта, о создании которой он теперь сожалеет.

Хотя это и не положило конец борьбе за то, чтобы OpenAI не имела доступа к обучающим данным xAI, решение суда на этой неделе стало еще одним поражением для Маска после того, как в прошлом месяце судья отклонил один из его исков против OpenAI, постановив, что у Маска нет доказательств того, что OpenAI украла коммерческие секреты.

Компания xAI утверждает, что Калифорния хочет заставить замолчать Грока.

В своем иске компания xAI утверждала, что закон Калифорнии является неконституционным, поскольку данные могут считаться коммерческой тайной в соответствии с Пятой поправкой к Конституции США. Компания также утверждала, что штат пытается регулировать результаты работы спорного чат-бота xAI, Grok, и несправедливо принуждает xAI к высказываниям, в то время как другие фирмы освобождаются от этого требования по соображениям безопасности.

На данном этапе судебного разбирательства Бернал не согласился с тем, что xAI может быть нанесен непоправимый ущерб, если действие закона не будет приостановлено.

В отношении иска, основанного на Пятой поправке, судья заявил, что дело не в том, что обучающие данные никогда не могут считаться коммерческой тайной. Дело в том, что xAI «не выявила ни одного набора данных или подхода к очистке и использованию наборов данных, который отличался бы от подходов конкурентов таким образом, чтобы это оправдывало защиту коммерческой тайны».

«Суд понимает важную роль наборов данных в обучении и разработке ИИ, а также то, что, гипотетически, наборы данных и информация о них могут являться коммерческой тайной», — написал Бернал. Но xAI «не утверждала, что фактически использует уникальные наборы данных, что у нее есть значительно большие или меньшие наборы данных, чем у конкурентов, или что она очищает свои наборы данных уникальными способами».

Следовательно, у xAI мало шансов добиться успеха по существу своего иска, основанного на Пятой поправке к Конституции США.

То же самое относится и к аргументам, основанным на Первой поправке. xAI не удалось доказать, что закон неправомерно «заставляет разработчиков публично раскрывать свои источники данных в попытке выявить то, что Калифорния считает «данными, полными скрытых и явных предубеждений»», — написал Бернал.

По мнению компании xAI, создавалось впечатление, что государство пытается использовать закон для влияния на результаты работы чат-бота Grok, что должно рассматриваться как защищенная коммерческая речь.

В течение последнего года Grok все чаще привлекал к себе внимание мировой общественности своими антисемитскими высказываниями, а также созданием интимных изображений, полученных без согласия, и материалов, содержащих сцены сексуального насилия над детьми. Но, несмотря на эти скандалы, которые привели к расследованию в Калифорнии, Бернал опроверг заявления xAI, сказав, что Калифорния, по всей видимости, не пытается регулировать спорные или предвзятые материалы, как опасалась xAI.

«Ничто в формулировке закона не указывает на то, что Калифорния пытается повлиять на результаты моделей истца, требуя раскрытия данных о наборах данных», — написал Бернал.

Обращаясь к другим замечаниям xAI относительно свободы слова, он отметил, что «закон фактически не требует от истца делиться своим мнением о роли определенных наборов данных в разработке моделей ИИ или делать идеологические заявления о полезности различных наборов данных или методов очистки».

«Ни одна часть закона не указывает на какие-либо планы по регулированию или цензуре моделей, основанных на наборах данных, на которых они разрабатываются и обучаются», — написал Бернал.

Общественность «абсолютно не заинтересована» в данных для обучения ИИ.

Пожалуй, больше всего для xAI, продолжающей бороться за блокирование этого закона, расстраивает и заявление Бернала о том, что общественность не заинтересована в раскрытии данных обучения.

«Чрезвычайно невероятно утверждать, что ни один потребитель не способен дать полезную оценку моделям ИИ истца, изучив информацию об используемых для их обучения наборах данных, и что, следовательно, данный закон о раскрытии информации не преследует существенных государственных интересов», — написал Бернал.

Он отметил, что закон просто обязывает компании информировать общественность о данных, которые могут быть использованы для принятия решения о том, какую модель лучше использовать.

Судья отметил, что в требуемой информации нет ничего политического по своей сути, хотя некоторые потребители могут выбирать или избегать определенные модели, которые, по их мнению, имеют политические предубеждения. В качестве примера Бернал высказал мнение, что потребители могут захотеть знать, «использовались ли определенные медицинские данные или научная информация для обучения модели», чтобы решить, могут ли они доверять модели, «насколько она всесторонне обучена и надежна для целей потребителя».

«На рынке моделей ИИ законопроект AB 2013 требует от разработчиков моделей ИИ предоставлять информацию об обучающих наборах данных, тем самым предоставляя общественности информацию, необходимую для определения того, будут ли они использовать — или полагаться на информацию, полученную с помощью — модели истца по сравнению с другими вариантами на рынке», — написал Бернал.

В дальнейшем xAI, похоже, предстоит непростая борьба за победу в этой битве. Компании потребуется собрать больше доказательств, чтобы продемонстрировать, что ее наборы данных или методы очистки достаточно уникальны, чтобы считаться коммерческой тайной, дающей компании конкурентное преимущество.

Бернал предположил, что правительству, вероятно, также придется усилить свои аргументы о том, что потребителям безразлична информация, раскрываемая в государственных органах, и что правительство не изучило менее обременительные альтернативы, которые могли бы «достичь цели прозрачности для потребителей».

Один из возможных путей к победе — доказать, что закон Калифорнии настолько расплывчат, что потенциально может возложить на xAI ответственность за раскрытие данных обучения своих клиентов для отдельных лицензий Grok. Но Бернал подчеркнул, что xAI «должна столкнуться с такой сложной проблемой, а не поднимать абстрактный возможный вопрос среди разработчиков систем ИИ, чтобы суд смог вынести решение по этому вопросу».

Компания xAI не ответила на запрос Ars о комментарии.

Представитель Министерства юстиции Калифорнии заявил агентству Reuters, что ведомство «приветствует эту важную победу и по-прежнему привержено продолжению защиты» этого закона.

Источник: arstechnica.com