100 млн токенов — прощай RAG или просто новый уровень памяти?

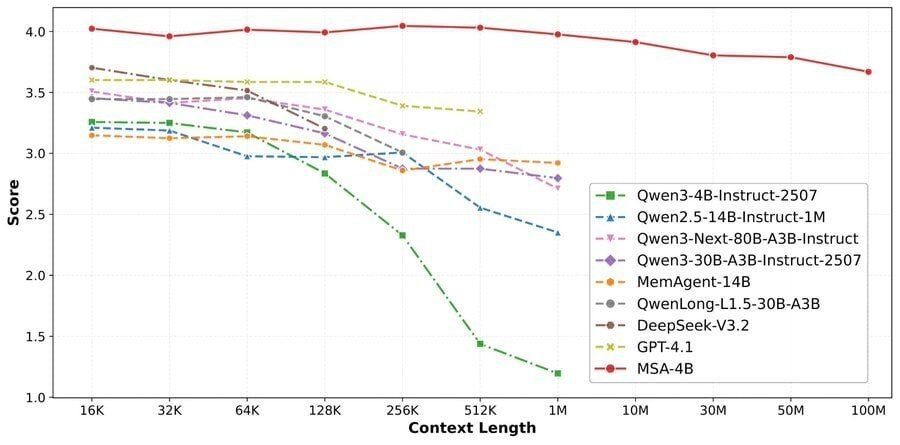

Китайский стартап EverMind AI показал архитектуру MSA — и цифры выглядят как перебор: до 100 млн токенов контекста. Это примерно 200 книг в одной сессии.

Разберём без восторгов.

Что меняется:

— Трансформеры раньше «забывали» начало по мере роста контекста

— RAG решал это через поиск по базе, но часто терял связность

— MSA пытается держать всё сразу и доставать нужное по ходу

Фактически — попытка сделать память нативной, а не внешней.

Как это работает:

— Sparse Attention + KV Compression — сжатие памяти и фокус только на важном

— Document-wise RoPE + Interleave — понимание структуры документов и связей между ними

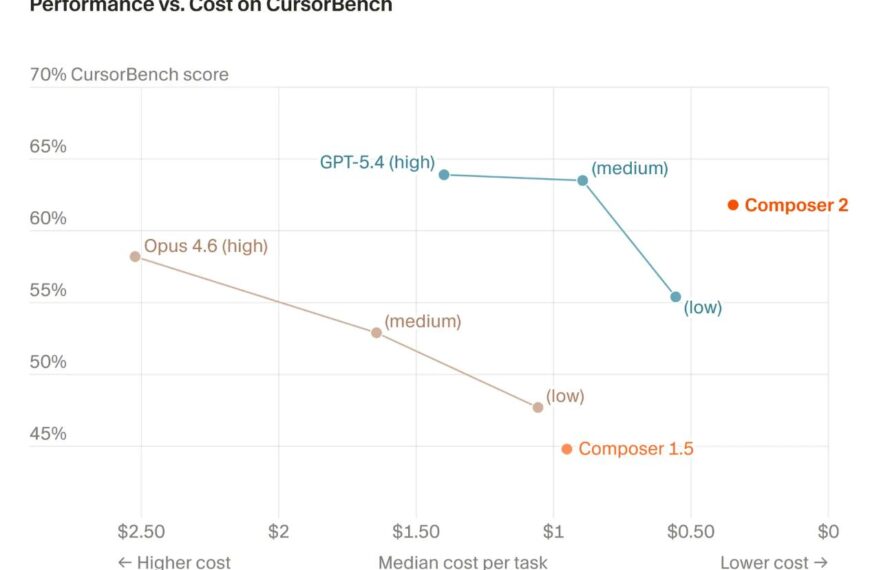

И всё это — на 2× A800 (80 ГБ VRAM), без безумных кластеров.

По заявлениям, при росте контекста с 16K до 100M точность падает менее чем на 9% — для таких объёмов это почти аномалия.

Но главный вопрос не в цифрах.

RAG — это не только про память, а про обновляемость и контроль источников.

А гигантский контекст — это всё ещё «загруженный мир», а не живые данные.

Вывод: MSA не убивает RAG, а двигает границу.

Теперь выбор — либо искать, либо помнить. И скоро эти подходы сольются в одно.