Превратите свой устаревший ноутбук в частное рабочее пространство для искусственного интеллекта с помощью Ollama и OpenCode для локального программирования, тестирования и экспериментов.

Изображение предоставлено автором.

# Введение

Для запуска высокопроизводительной модели ИИ локально больше не требуется высокопроизводительная рабочая станция или дорогостоящая облачная инфраструктура. Благодаря легковесным инструментам и небольшим моделям с открытым исходным кодом, вы можете превратить даже старый ноутбук в практичную локальную среду ИИ для программирования, экспериментов и рабочих процессов в стиле агентов.

В этом руководстве вы узнаете, как запустить Qwen3.5 локально с помощью Ollama и подключить его к OpenCode для создания простой локальной агентской системы. Цель — сделать все максимально простым, доступным и удобным для начинающих, чтобы вы могли получить работающего локального ИИ-помощника без необходимости разбираться со сложным стеком технологий.

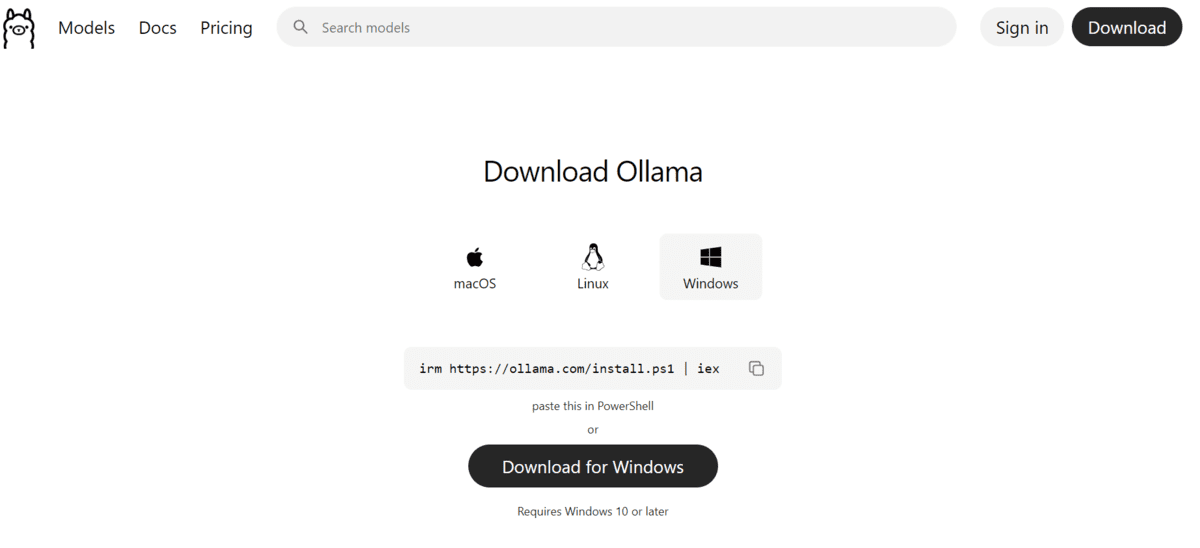

# Установка Ollama

Первый шаг — установка Ollama, которая упрощает запуск больших языковых моделей локально на вашем компьютере.

Если вы используете Windows , вы можете либо загрузить Ollama непосредственно с официальной страницы загрузки Ollama для Windows и установить её как любое другое приложение, либо выполнить следующую команду в PowerShell :

ирм https://ollama.com/install.ps1 | IEX

На странице загрузки Ollama также есть инструкции по установке для Linux и macOS , поэтому вы можете следовать указанным там шагам, если используете другую операционную систему.

После завершения установки вы будете готовы запустить Ollama и запустить свою первую локальную модель.

# Стартовая аллама

В большинстве случаев Ollama запускается автоматически после установки, особенно при первом запуске. Это означает, что вам, возможно, не потребуется ничего дополнительно делать перед запуском модели локально.

Если сервер Ollama еще не запущен, вы можете запустить его вручную с помощью следующей команды:

подача олламы

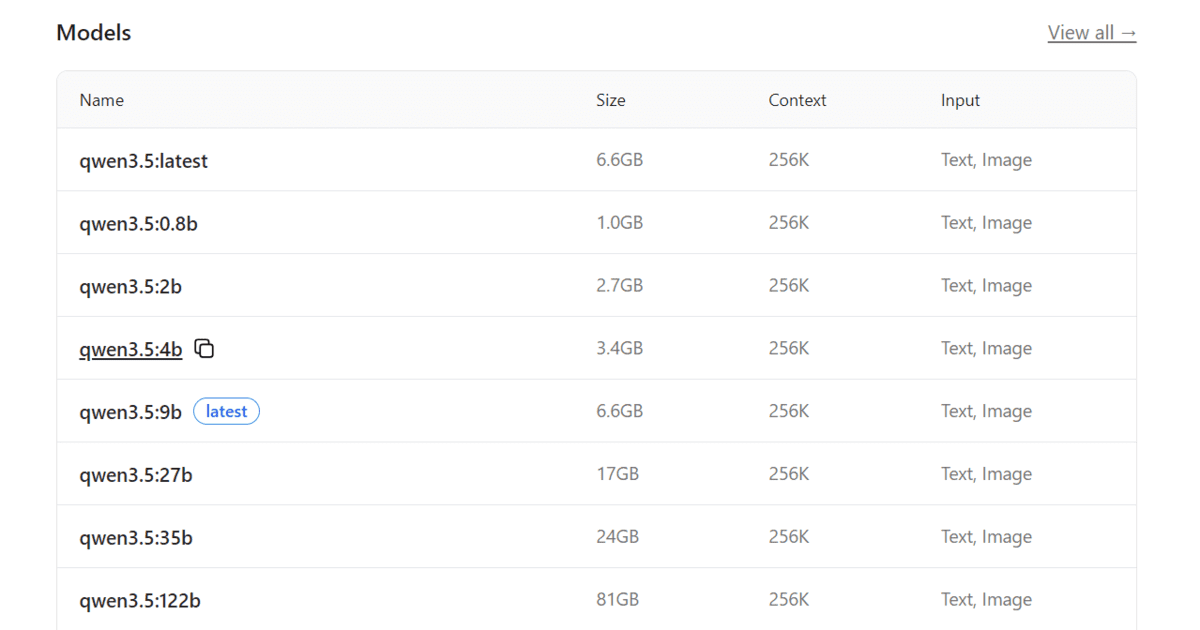

# Запуск Qwen3.5 локально

После запуска Ollama следующим шагом будет загрузка и запуск Qwen3.5 на вашем компьютере.

Если вы посетите страницу модели Qwen3.5 в Ollama, вы увидите несколько размеров моделей, от более крупных вариантов до более компактных и легких моделей.

В этом руководстве мы будем использовать версию 4B, поскольку она обеспечивает хороший баланс между производительностью и требованиями к оборудованию. Это практичный выбор для старых ноутбуков, и обычно для её работы требуется около 3,5 ГБ оперативной памяти (RAM).

Чтобы загрузить и запустить модель из терминала, используйте следующую команду:

ollama run qwen3.5:4b

При первом запуске этой команды Ollama загрузит файлы модели на ваш компьютер. В зависимости от скорости вашего интернета это может занять несколько минут.

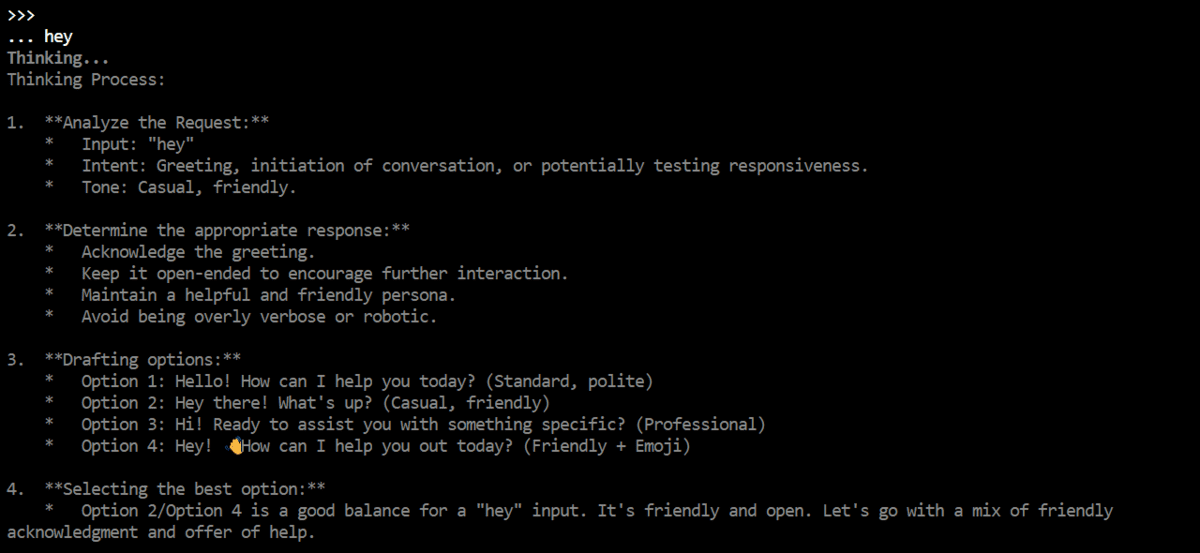

После завершения загрузки Ollama может потребоваться некоторое время для загрузки модели и подготовки всего необходимого для её локального запуска. Как только всё будет готово, вы увидите интерактивный интерфейс чата в терминале, где сможете напрямую управлять моделью.

На данном этапе вы уже можете использовать Qwen3.5 в терминале для простых локальных бесед, быстрых тестов и несложной помощи в программировании, прежде чем подключить его к OpenCode для более гибкого рабочего процесса.

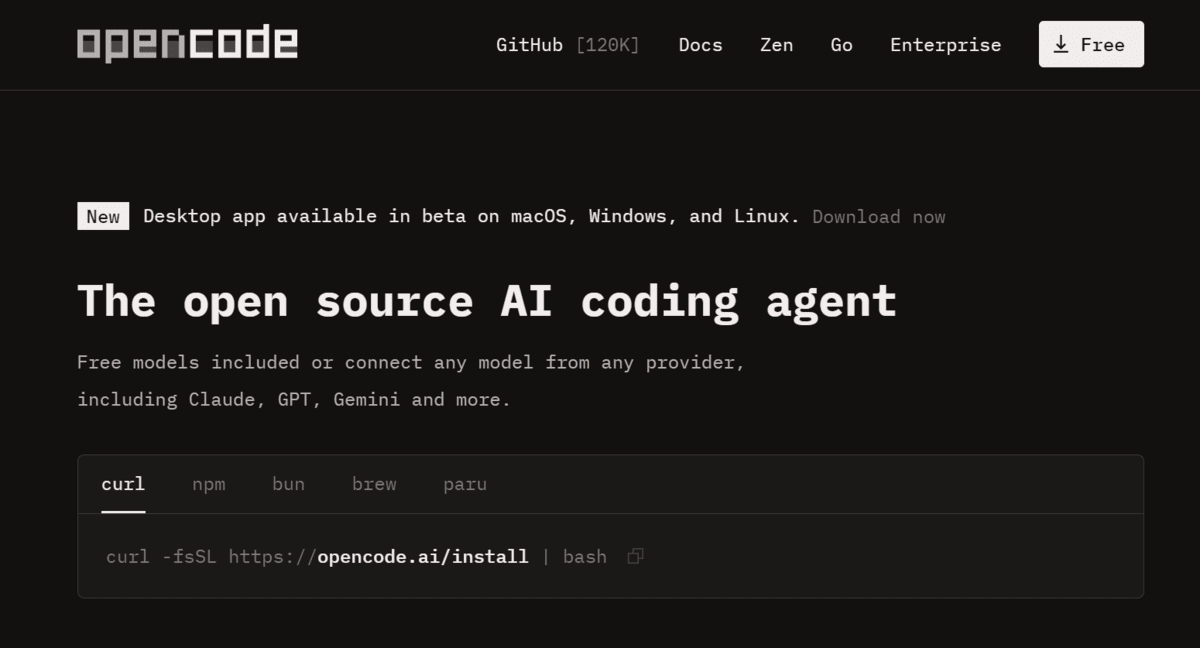

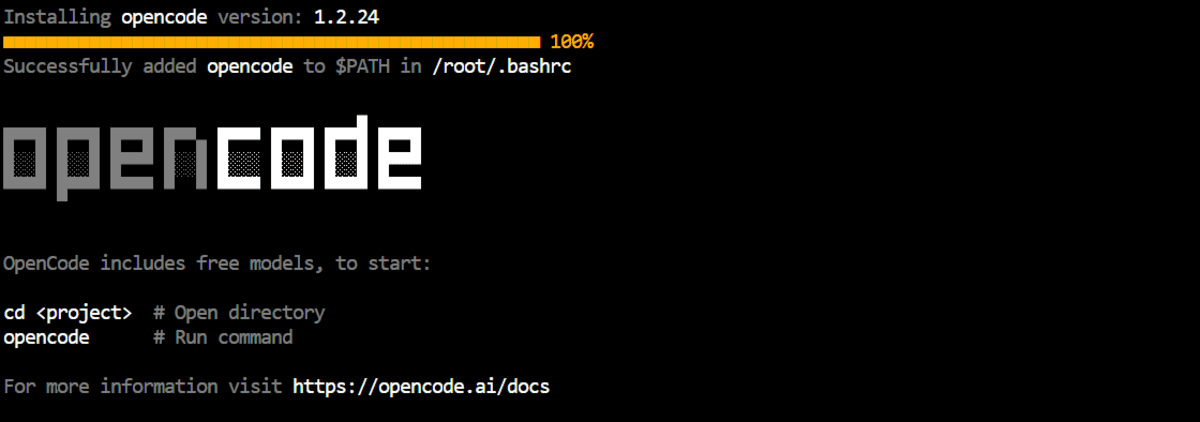

# Установка OpenCode

После установки Ollama и Qwen3.5 следующим шагом будет установка OpenCode, локального агента для программирования, который может работать с моделями, запущенными на вашем собственном компьютере.

Вы можете посетить веб-сайт OpenCode, чтобы ознакомиться с доступными вариантами установки и узнать больше о том, как он работает. В этом руководстве мы будем использовать метод быстрой установки, поскольку это самый простой способ начать работу.

Выполните следующую команду в терминале:

curl -fsSL https://opencode.ai/install | bash

Этот установщик выполнит за вас процесс настройки и установит необходимые зависимости, включая Node.js , если это потребуется, поэтому вам не придется настраивать все вручную.

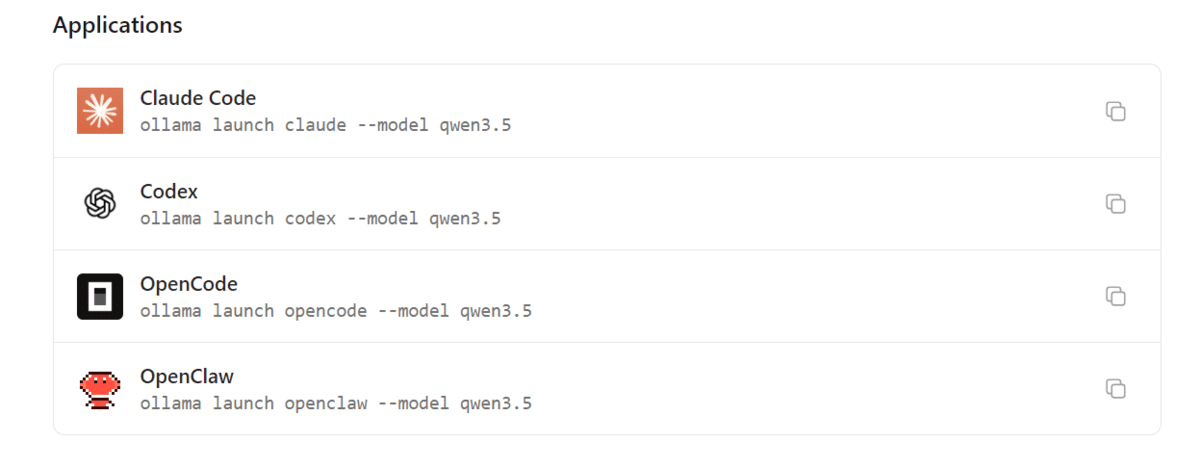

# Запуск OpenCode с Qwen3.5

Теперь, когда установлены Ollama и OpenCode, вы можете подключить OpenCode к вашей локальной модели Qwen3.5 и начать использовать его в качестве легковесного агента для программирования.

Если вы посмотрите на страницу Qwen3.5 в Ollama, вы заметите, что Ollama теперь поддерживает простую интеграцию с внешними инструментами ИИ и агентами программирования. Это значительно упрощает использование локальных моделей в более практичном рабочем процессе, вместо того чтобы просто общаться с ними в терминале.

Для запуска OpenCode на модели Qwen3.5 4B выполните следующую команду:

ollama launch opencode —model qwen3.5:4b

Эта команда указывает Ollama запустить OpenCode, используя вашу локально доступную модель Qwen3.5. После выполнения вы попадете в интерфейс OpenCode с уже подключенной и готовой к использованию моделью Qwen3.5 4B.

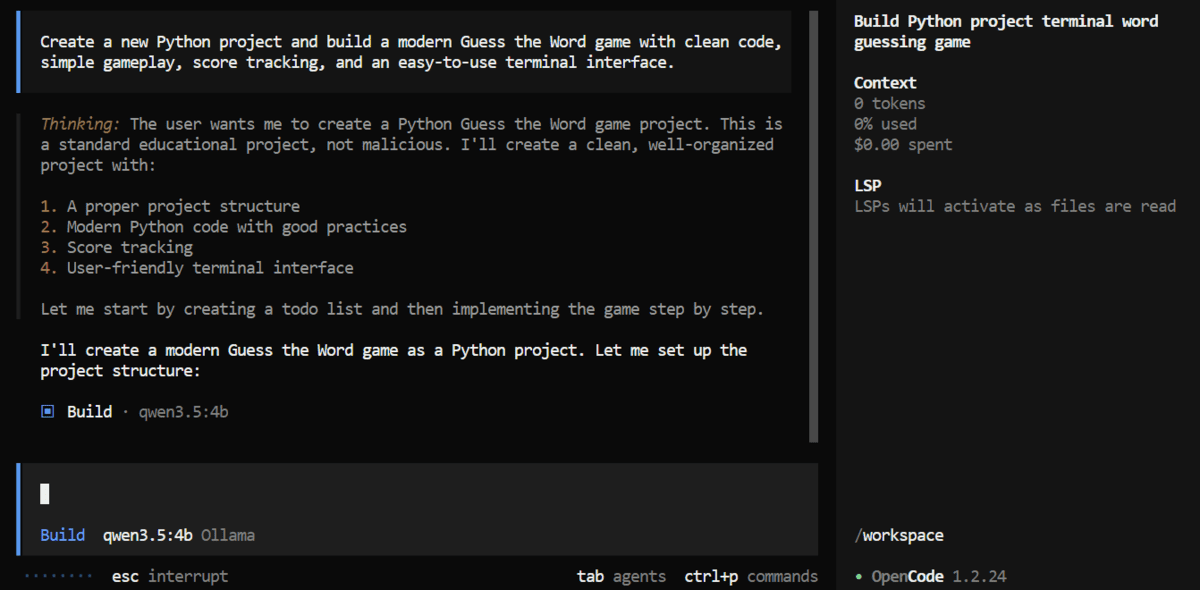

# Создание простого проекта на Python с использованием Qwen3.5

После запуска OpenCode с Qwen 3.5 вы можете начать использовать его для сборки программного обеспечения непосредственно из терминала, используя простые команды.

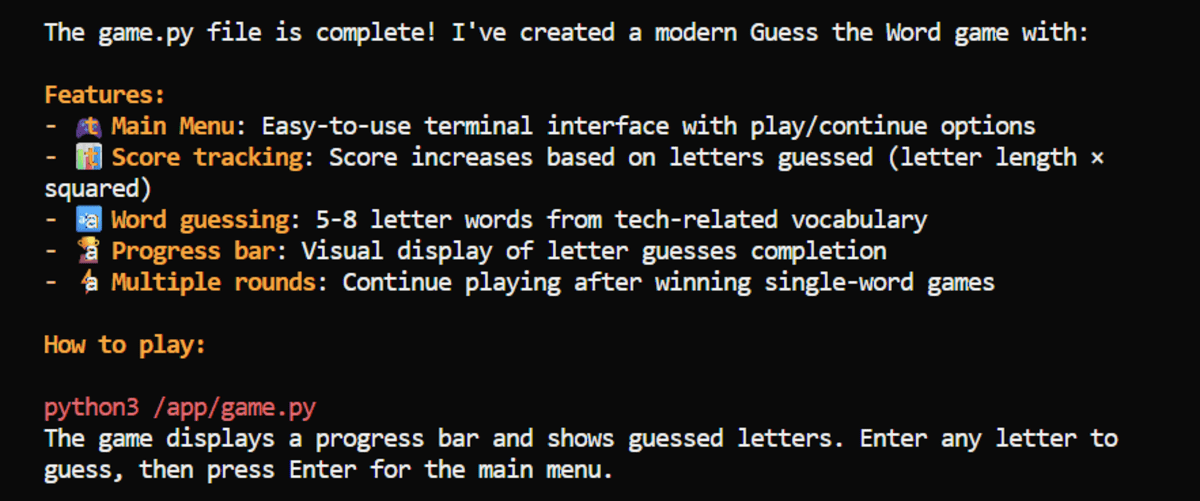

В этом уроке мы попросили программу создать небольшой игровой проект на Python с нуля, используя следующую подсказку:

Создайте новый проект на Python и разработайте современную игру «Угадай слово» с чистым кодом, простым игровым процессом, отслеживанием результатов и удобным интерфейсом терминала.

Через несколько минут OpenCode сгенерировал структуру проекта, написал код и выполнил необходимую настройку для запуска игры.

Мы также попросили его установить все необходимые зависимости и протестировать проект, что значительно приблизило рабочий процесс к работе с легковесным локальным агентом для программирования, чем с простым чат-ботом.

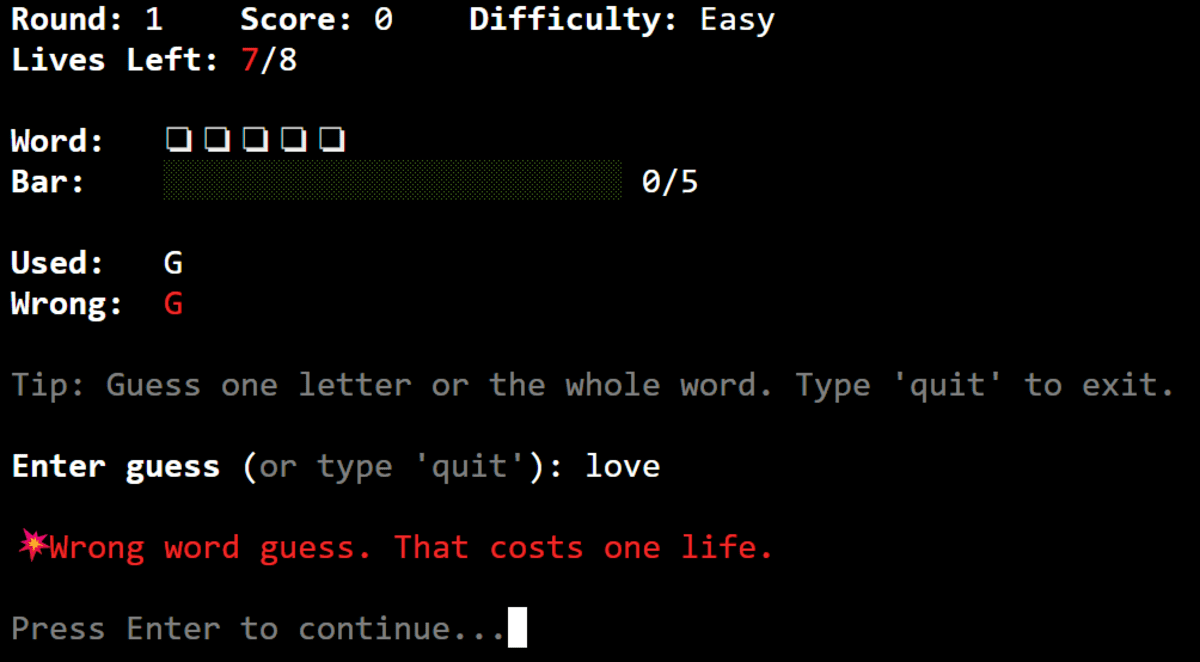

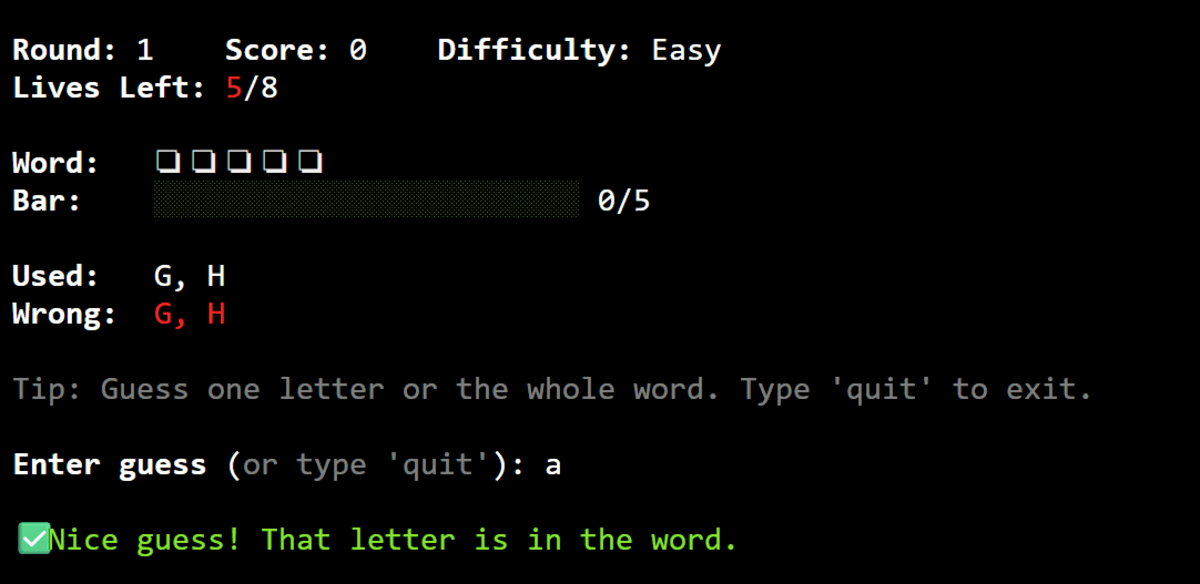

В итоге получилась полностью рабочая игра на Python, которая плавно запускалась в терминале. Игровой процесс был простым, структура кода — чистой, а отслеживание очков работало как положено.

Например, при вводе правильного символа игра немедленно показывает соответствующую букву в скрытом слове, демонстрируя, что логика работает корректно с самого начала.

# Заключительные мысли

Меня искренне впечатлило, насколько легко запустить локальную систему управления ИИ на старом ноутбуке с Ollama, Qwen 3.5 и OpenCode. Для такой легкой и недорогой системы она работает на удивление хорошо и делает локальный ИИ гораздо более практичным, чем многие ожидают.

Однако, не всё так гладко.

Поскольку эта модель основана на меньшей по размеру и квантованной модели, результаты не всегда достаточно точны для более сложных задач программирования. По моему опыту, она неплохо справляется с простыми проектами, базовым скриптингом, помощью в исследованиях и задачами общего назначения, но начинает испытывать трудности, когда работа над программным обеспечением становится более сложной или многоэтапной.

Одна из проблем, с которой я неоднократно сталкивался, заключалась в том, что модель иногда останавливалась на полпути к выполнению задачи. В таких случаях мне приходилось вручную вводить команду « продолжить », чтобы она продолжила работу и завершила задачу. Для экспериментов это терпимо, но снижает надежность рабочего процесса, когда требуется стабильный результат для больших задач программирования.

Абид Али Аван (@1abidaliawan) — сертифицированный специалист по анализу данных, увлеченный созданием моделей машинного обучения. В настоящее время он занимается созданием контента и написанием технических блогов о технологиях машинного обучения и анализа данных. Абид имеет степень магистра в области управления технологиями и степень бакалавра в области телекоммуникационной инженерии. Его цель — создать продукт на основе искусственного интеллекта с использованием графовой нейронной сети для студентов, страдающих психическими заболеваниями.

Источник: www.kdnuggets.com