Код, который считывает ваше разочарование, — наименее интересная часть истории этой случайной утечки из Anthropic. Утечка показывает, что инструменты искусственного интеллекта также скрывают свою роль в работе, которую они помогают создавать

Присоединяйтесь к нашему сообществу любителей науки!

Подпишитесь на нашу бесплатную ежедневную рассылку новостейВведите свой адрес электронной почтыЯ соглашаюсь с тем, что моя информация будет обрабатываться в соответствии с Политикой конфиденциальности Scientific American и Springer Nature Limited. Мы используем сторонние сервисы как для проверки, так и для доставки электронной почты. Предоставляя свой адрес электронной почты, вы также даете согласие на передачу этого адреса третьим лицам для этих целей.Зарегистрируйтесь

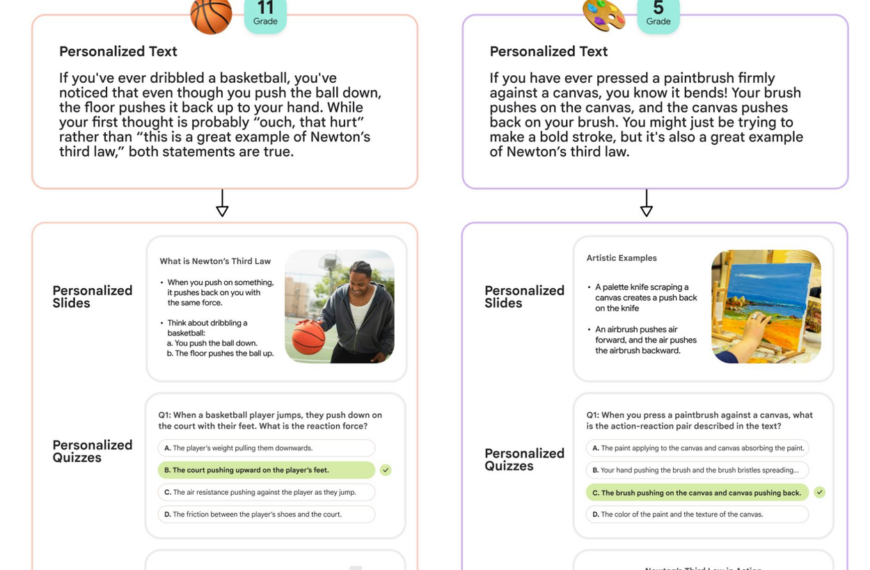

31 марта компания, занимающаяся искусственным интеллектом, Anthropic случайно опубликовала около 512 000 строк кода, и в течение нескольких часов разработчики корпели над ним. Среди сюрпризов был code inside Claude Code, помощник Anthropic по программированию с использованием искусственного интеллекта, который, похоже, сканирует запросы пользователей на предмет признаков разочарования. Он помечает ненормативную лексику, оскорбления и такие фразы, как «так расстраивает» и «это отстой», и, похоже, регистрирует, что пользователь выразил негатив.

Разработчики также обнаружили код, предназначенный для удаления ссылок на антропные имена — даже на фразу «Код Клода» — когда инструмент используется для создания общедоступного кода хранилища программного обеспечения, благодаря чему последний код выглядит так, как будто он был полностью написан человеком. Алекс Ким, независимый разработчик, опубликовал технический анализ просочившегося кода, в котором назвал его «дверью в один конец» — функцией, которую можно принудительно включить, но не отключить. «Сокрытие внутренних кодовых имен является разумным», — написал он. «Другое дело, когда ИИ активно притворяется человеком». Компания Anthropic не ответила на запрос о комментариях от Scientific American.

Компания Anthropic не ответила на запрос о комментариях от Scientific American.

полученные результаты выявляют проблему, возникающую в индустрии искусственного интеллекта: инструменты, которые призваны быть полезными и интимными, также незаметно оценивают людей, которые их используют, и скрывают их собственное участие в работе, которую они помогают создавать. Компания Anthropic, которая сделала ставку на безопасность искусственного интеллекта, предлагает первое практическое исследование того, как сбор поведенческих данных может опередить управление.

О поддержке научной журналистики

Если вам понравилась эта статья, подумайте о том, чтобы поддержать наш отмеченный наградами журнал. журналистика по подписке. Приобретая подписку, вы помогаете обеспечить будущее впечатляющих историй об открытиях и идеях, формирующих наш современный мир.

Технически детектор разочарований прост. В нем используются регулярные выражения, проверенный десятилетиями метод сопоставления с образцом, а не искусственный интеллект. «Компания LLM, использующая регулярные выражения для анализа настроений, — это ирония судьбы», — написала Ким. Но выбор, как он отмечает в интервью Scientific American, был прагматичным: «Регулярное выражение не требует вычислений, в то время как использование LLM для его обнаружения было бы дорогостоящим в масштабах глобального использования Claude Code». Сигнал, он добавляет: «это не меняет поведения или реакций модели». Это всего лишь показатель работоспособности продукта: разочаровываются ли пользователи, и растет ли этот показатель в разных версиях?»

Миранда Боген, директор лаборатории управления искусственным интеллектом в Центр демократии и технологий (Center for Democracy & Technology) говорит, что более насущной проблемой является то, что происходит с такой информацией, когда она оказывается в распоряжении компании. «Даже если это очень четкая и очень простая схема прогнозирования, то, как вы используете эту информацию, является отдельным вопросом управления», — сказала она. говорит. Сигнал, собранный для одной цели, может мигрировать в другие части продукта способами, которых пользователи не ожидают и с которыми не соглашаются.

Боген говорит, что эта схема знакома по старым интернет-платформам, где небольшие поведенческие сигналы становились сигналами это сформировало то, что видели пользователи и как они были классифицированы. Компании, занимающиеся искусственным интеллектом, сталкиваются с аналогичной проблемой конфиденциальности: пользователи передают этим системам огромные объемы информации именно потому, что инструменты разработаны таким образом, чтобы знать их достаточно хорошо и быть полезными. «Кто отслеживает информацию о пользователях?» — спрашивает Боген. “И как эта информация используется для принятия решений о них?” Утечка данных из Anthropic показала, что, по крайней мере, в одной компании такой учет уже прописан в коде.