Представляем VaultGemma, самую эффективную модель, обученную с нуля с использованием дифференциальной конфиденциальности.

Быстрые ссылки

- Бумага

- Обнимающее лицо

- Kaggle

- Технический отчет

- Делиться

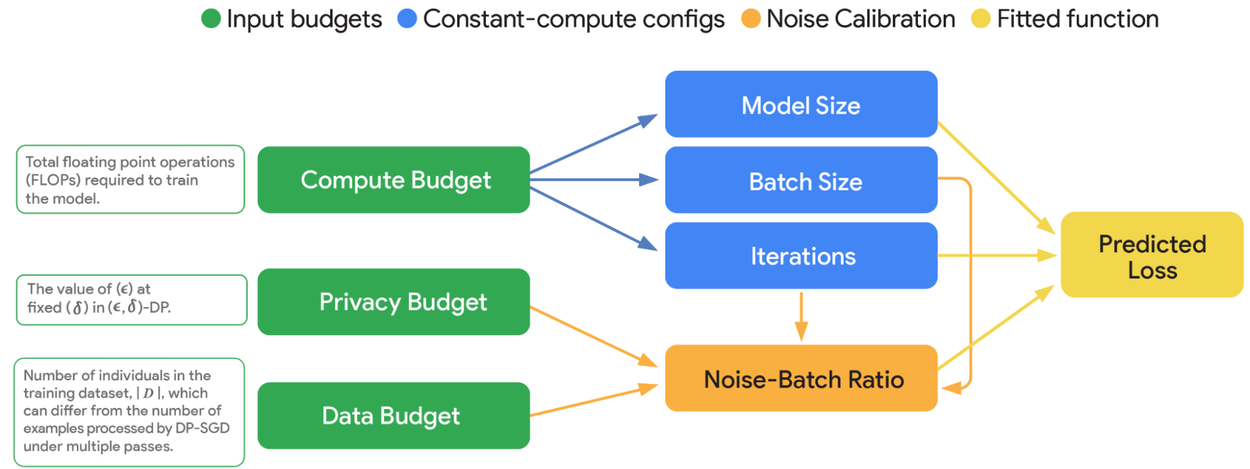

По мере того как ИИ все больше интегрируется в нашу жизнь, создание моделей с учетом конфиденциальности становится критически важной задачей для этой области. Дифференцированная конфиденциальность (ДП) предлагает математически обоснованное решение, добавляя калиброванный шум для предотвращения запоминания. Однако применение ДП к линейным моделям обучения (ЛМ) влечет за собой компромиссы. Понимание этих компромиссов имеет решающее значение. Применение шума ДП изменяет традиционные законы масштабирования — правила, описывающие динамику производительности, — за счет снижения стабильности обучения (способности модели обучаться последовательно, не сталкиваясь с катастрофическими событиями, такими как скачки потерь или расхождение) и значительного увеличения размера пакета (набора обучающих примеров, одновременно отправляемых модели для обработки) и вычислительных затрат.

Наше новое исследование «Законы масштабирования для языковых моделей с дифференциальной приватностью», проведенное в партнерстве с Google DeepMind, устанавливает законы, которые точно моделируют эти сложности, предоставляя полную картину компромиссов между вычислительными ресурсами, приватностью и полезностью. Руководствуясь этим исследованием, мы рады представить VaultGemma, крупнейшую (1 миллиард параметров) открытую модель, обученную с нуля с использованием дифференциальной приватности. Мы публикуем веса на Hugging Face и Kaggle вместе с техническим отчетом, чтобы продвинуть разработку следующего поколения приватного ИИ.

Понимание законов масштабирования

Используя тщательно продуманную экспериментальную методологию, мы стремились количественно оценить преимущества увеличения размеров модели, размеров пакетов и итераций в контексте обучения DP. Наша работа потребовала некоторых упрощающих предположений, чтобы преодолеть экспоненциальное количество комбинаций, которые можно было бы попробовать. Мы предположили, что качество обучения модели в основном зависит от «отношения шума к пакету», которое сравнивает количество случайного шума, добавляемого для обеспечения конфиденциальности, с размером групп данных (пакетов), используемых для обучения. Это предположение работает, потому что добавляемый нами шум для обеспечения конфиденциальности намного больше, чем любая естественная случайность, возникающая при выборке данных.

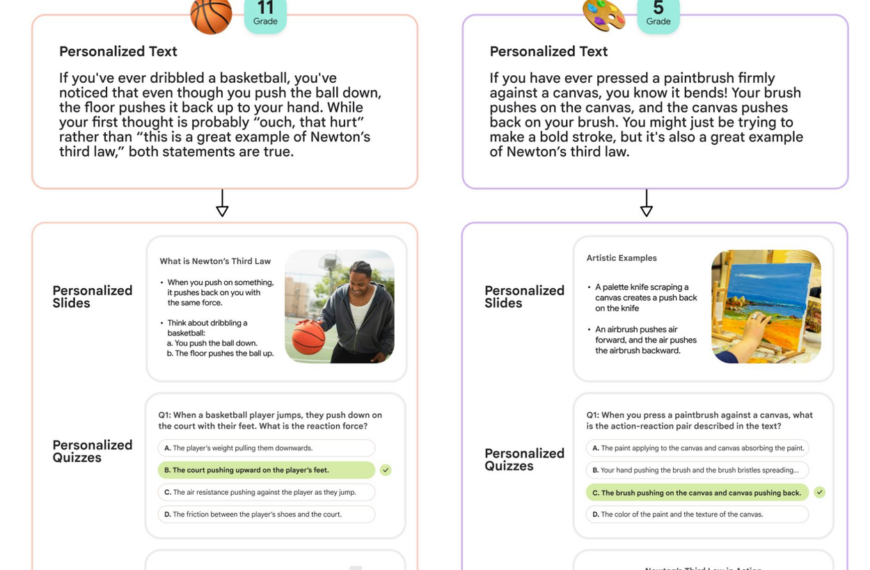

Для установления закона масштабирования DP мы провели всесторонний набор экспериментов по оценке производительности при различных размерах моделей и соотношениях шумовых пакетов. Полученные эмпирические данные, наряду с известными детерминированными зависимостями между другими переменными, позволяют нам ответить на множество интересных вопросов, связанных с законами масштабирования, например: «Для заданного вычислительного бюджета, бюджета конфиденциальности и бюджета данных, какова оптимальная конфигурация обучения для достижения минимально возможной ошибки обучения?»

Структура наших законов масштабирования DP. Мы устанавливаем, что прогнозируемые потери могут быть точно смоделированы с использованием в основном размера модели, итераций и отношения шумовых пакетов, что упрощает сложные взаимодействия между вычислительными ресурсами, конфиденциальностью и бюджетом данных.

Основные выводы: Мощная синергия

Прежде чем углубляться в законы масштабирования, полезно понять динамику и синергию между вычислительным бюджетом, бюджетом конфиденциальности и бюджетом данных с точки зрения учета конфиденциальности — то есть понять, как эти факторы влияют на соотношение шумовых пакетов для фиксированного размера модели и количества итераций. Этот анализ значительно дешевле, поскольку не требует обучения модели, но при этом дает ряд полезных выводов. Например, увеличение бюджета конфиденциальности само по себе приводит к снижению эффективности, если не сопровождается соответствующим увеличением либо вычислительного бюджета (FLOPs), либо бюджета данных (токенов).

Предельная выгода от увеличения бюджета конфиденциальности (эпсилон) и вычислительного бюджета (размер пакета) с точки зрения их влияния на отношение шума к пакету.

Чтобы подробнее изучить эту синергию, приведенная ниже визуализация показывает, как оптимальная конфигурация обучения меняется в зависимости от различных ограничений. Обратите внимание, как рекомендации меняются в зависимости от бюджета конфиденциальности и вычислительных ресурсов: от инвестиций в более крупную модель до обучения с использованием больших размеров пакетов или большего количества итераций.

воспроизведение видео без звука зацикливание пауза видео без звука зацикливание включение звука видео выключение звука

Прогнозируемые потери при обучении для различных настроек бюджета данных/конфиденциальности/вычислительных ресурсов, а также более подробное описание в зависимости от количества итераций, размера пакета и размера модели. На графиках показаны как минимально достижимые потери для различных настроек бюджета, так и оптимальные конфигурации гиперпараметров.

Эти данные предоставляют множество полезных сведений для практиков. Хотя все выводы изложены в статье, ключевой момент заключается в том, что следует обучать гораздо меньшую модель с гораздо большим размером пакета данных, чем это было бы возможно без защиты данных. Этот общий вывод не должен удивлять эксперта по защите данных, учитывая важность больших размеров пакетов. Хотя этот общий вывод справедлив для многих условий, оптимальные конфигурации обучения меняются в зависимости от бюджета конфиденциальности и бюджета данных. Понимание точного компромисса имеет решающее значение для обеспечения разумного использования как вычислительного бюджета, так и бюджета конфиденциальности в реальных сценариях обучения. Приведенные выше визуализации также показывают, что часто существует определенная свобода выбора в конфигурациях обучения — то есть, диапазон размеров модели может обеспечить очень схожую полезность при правильном количестве итераций и/или размере пакета данных.

Применение законов масштабирования для построения VaultGemma

В основе разработки моделей Gemma лежат ответственность и безопасность. Это делает их естественной основой для создания высококачественной, обученной с помощью DP модели, такой как VaultGemma.

Алгоритмические достижения: обучение в больших масштабах

Выведенные нами выше законы масштабирования представляют собой важный первый шаг к обучению полезной модели Gemma с использованием динамического программирования. Мы использовали эти законы масштабирования для определения того, сколько вычислительных ресурсов нам потребуется для обучения оптимальной по вычислительным ресурсам модели Gemma 2 с 1B параметрами и использованием динамического программирования, а также для распределения этих вычислительных ресурсов между размером пакета, итерациями и длиной последовательности для достижения наилучшей эффективности.

Одним из существенных пробелов между исследованиями, лежащими в основе законов масштабирования, и фактической подготовкой VaultGemma была наша обработка выборки Пуассона , которая является центральным компонентом DP-SGD. Первоначально мы использовали простой метод загрузки данных равномерными партиями, но затем перешли к выборке Пуассона, чтобы получить наилучшие гарантии конфиденциальности при минимальном уровне шума. Этот метод представлял две основные проблемы: он создавал партии разного размера и требовал определенного, случайного порядка обработки данных. Мы решили эту проблему, используя нашу недавнюю работу над масштабируемым DP-SGD, который позволяет нам обрабатывать данные партиями фиксированного размера — либо добавляя дополнительное заполнение, либо обрезая их — при этом сохраняя надежную защиту конфиденциальности.

Результаты

Вооружившись нашими новыми законами масштабирования и передовыми алгоритмами обучения, мы создали VaultGemma, на сегодняшний день крупнейшую (1 миллиард параметров) открытую модель, полностью предварительно обученную с использованием дифференциальной конфиденциальности, с подходом, позволяющим создавать высокоэффективные модели.

В ходе обучения модели VaultGemma мы обнаружили, что наши законы масштабирования оказались очень точными. Итоговая функция потерь VaultGemma оказалась удивительно близка к тому, что предсказывали наши уравнения, что подтверждает правильность нашего исследования и предоставляет сообществу надежный план для будущей разработки частных моделей.

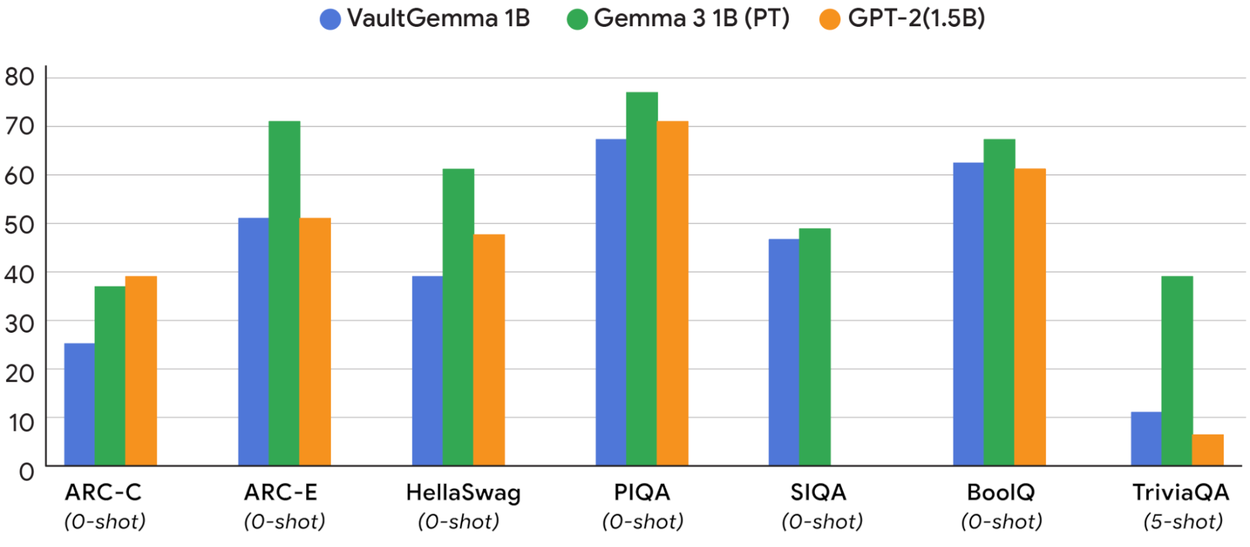

Сравнительный анализ производительности VaultGemma 1B (с дифференциальной приватностью) по сравнению с его не приватным аналогом (Gemma3 1B) и более старой базовой моделью (GPT-2 1.5B). Результаты количественно оценивают текущие затраты ресурсов, необходимые для обеспечения приватности, и демонстрируют, что современное обучение с использованием дифференциальной приватности обеспечивает полезность, сопоставимую с не приватными моделями примерно пятилетней давности.

Мы также сравниваем производительность нашей модели с ее неконфиденциальным аналогом на ряде стандартных академических бенчмарков (например, HellaSwag, BoolQ, PIQA, SocialIQA, TriviaQA, ARC-C, ARC-E). Чтобы оценить эту производительность в перспективе и количественно определить текущие затраты ресурсов, необходимые для обеспечения конфиденциальности, мы также включаем сравнение с более старой моделью GPT-2 аналогичного размера, которая показывает схожие результаты на этих бенчмарках. Это сравнение показывает, что современные методы обучения с использованием конфиденциальных данных создают модели с полезностью, сопоставимой с полезностью неконфиденциальных моделей примерно пятилетней давности, подчеркивая важный пробел, который наша работа поможет систематически заполнить сообществу.

Наконец, модель обеспечивает надежную теоретическую и эмпирическую защиту конфиденциальности.

Официальная гарантия конфиденциальности

В целом, как параметры конфиденциальности (ε, δ), так и единица конфиденциальности являются важными факторами при обучении дифференциальной конфиденциальности, поскольку они вместе определяют, чему может научиться обученная модель. VaultGemma обучалась с гарантией дифференциальной конфиденциальности на уровне последовательности (ε ≤ 2,0, δ ≤ 1,1e-10), где последовательность состоит из 1024 последовательных токенов, извлеченных из разнородных источников данных. В частности, мы использовали ту же обучающую смесь, что и для обучения модели Gemma 2, состоящую из ряда документов различной длины. В процессе предварительной обработки длинные документы разбиваются и токенизируются на несколько последовательностей, а более короткие документы объединяются в одну последовательность. Хотя единица конфиденциальности на уровне последовательности была естественным выбором для нашей обучающей смеси, в ситуациях, когда существует четкое соответствие между данными и пользователями, дифференциальная конфиденциальность на уровне пользователя была бы лучшим выбором.

Что это означает на практике? Неформально говоря, поскольку мы обеспечиваем защиту на уровне последовательности, если информация, относящаяся к какому-либо (потенциально конфиденциальному) факту или выводу, встречается в одной последовательности, то VaultGemma, по сути, не знает этого факта: ответ на любой запрос будет статистически похож на результат модели, которая никогда не обучалась на рассматриваемой последовательности. Однако, если множество обучающих последовательностей содержат информацию, относящуюся к конкретному факту, то в целом VaultGemma сможет предоставить эту информацию.

Эмпирическое запоминание

В дополнение к нашей гарантии защиты данных на уровне последовательности, мы проводим дополнительные тесты эмпирических свойств конфиденциальности обученной модели. Для этого мы задали модели префикс из 50 токенов из обучающего документа, чтобы проверить, сгенерирует ли она соответствующий суффикс из 50 токенов. VaultGemma 1B не демонстрирует заметного запоминания обучающих данных и успешно показывает эффективность обучения с защитой данных.

Заключение

VaultGemma представляет собой значительный шаг вперед на пути к созданию ИИ, который по своей сути является мощным и конфиденциальным. Разработав и применив новое, надежное понимание законов масштабирования для динамического программирования, мы успешно обучили и выпустили крупнейшую на сегодняшний день открытую языковую модель, обученную на динамическом программировании.

Хотя между моделями, обученными с использованием динамического программирования, и моделями, не обученными с его использованием, всё ещё существует разрыв в полезности, мы считаем, что этот разрыв можно систематически сократить с помощью дополнительных исследований в области проектирования механизмов обучения с использованием динамического программирования. Мы надеемся, что VaultGemma и наши сопутствующие исследования позволят сообществу создать следующее поколение безопасного, ответственного и конфиденциального ИИ для всех.

Благодарности

Мы хотели бы поблагодарить всю команду Gemma и команду Google Privacy за их вклад и поддержку на протяжении всего этого проекта, в частности, Питера Кайруза, Брендана Макмахана и Дэна Рамаджа за отзывы к публикации в блоге, Марка Симборга и Кимберли Шведе за помощь в визуализации, а также команды Google, которые помогли с разработкой алгоритмов, внедрением инфраструктуры и обслуживанием в производственной среде. В представленной здесь работе непосредственно участвовали следующие люди (в алфавитном порядке): Борха Балле, Закари Чарльз, Кристофер А. Чокетт-Чу, Линн Чуа, Прем Эрувбетин, Бадих Гази, Стив Хе, Янсибо Хуан, Арманд Жулен, Джордж Кассис, Притиш Камат, Рави Кумар, Даогао Лю, Руибо Лю, Пасин Манурангси, Томас Меснар, Андреас Терзис, Трис Варкентин, Да Ю и Чиюань Чжан.

Источник: research.google