Мы исследуем и совершенствуем алгоритмы для тонкой настройки больших моделей с дифференциальной конфиденциальностью на уровне пользователя.

Быстрые ссылки

- Бумага

- Делиться

Сообщество специалистов по машинному обучению постоянно обнаруживает, что, хотя современные модели машинного обучения (МО) обладают высокой эффективностью, для достижения максимальной производительности их часто необходимо дорабатывать на данных, специфичных для конкретной предметной области. Это может быть проблематично или даже невозможно, поскольку информативные данные часто являются конфиденциальными. Дифференцированная конфиденциальность (ДП) позволяет обучать модели МО, строго гарантируя, что обученная модель соблюдает конфиденциальность своих обучающих данных, путем внесения шума в процесс обучения.

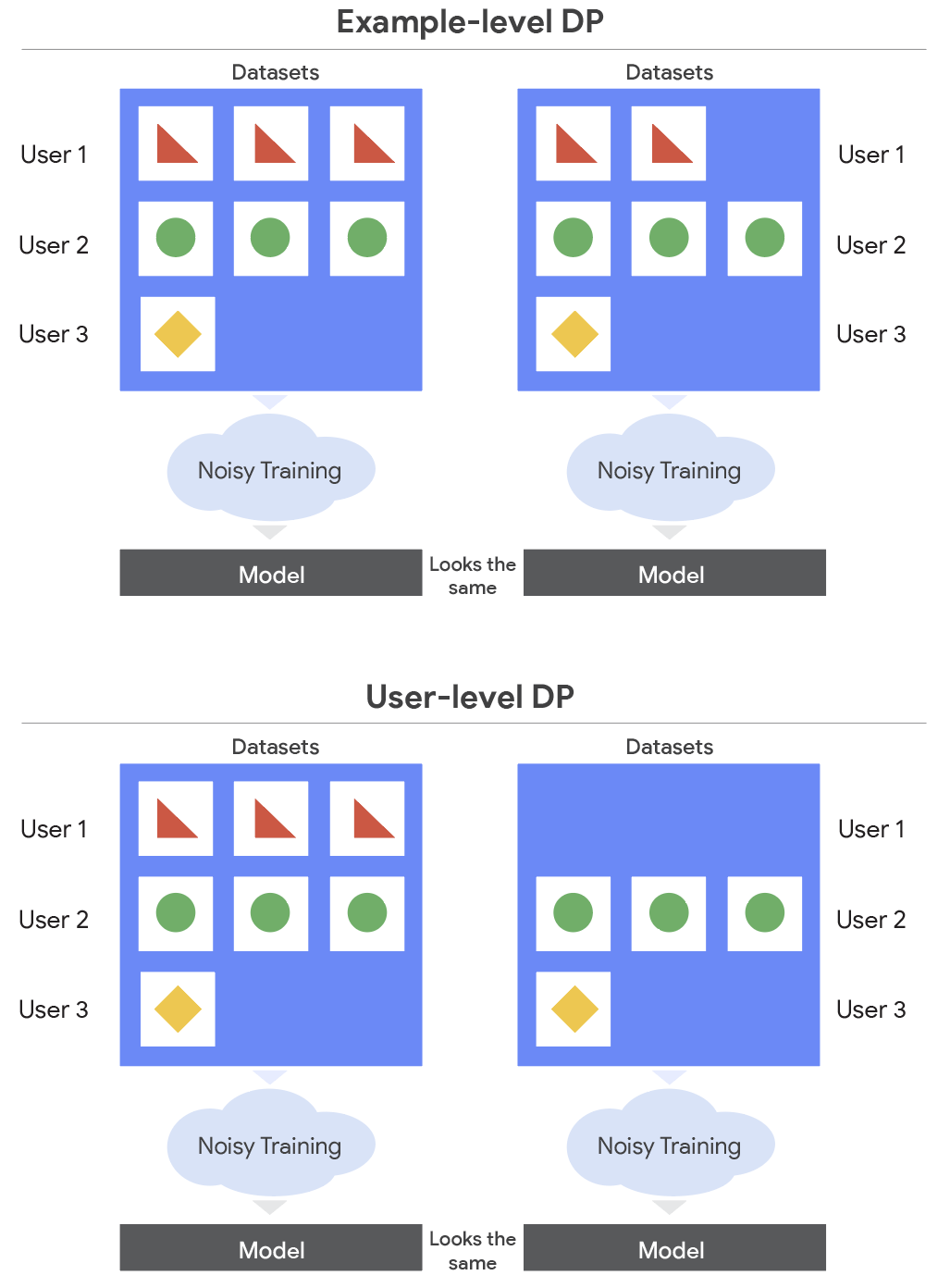

Большинство работ по защите данных сосредоточено на конфиденциальности отдельных примеров (т.е. на защите данных на уровне примеров). Это имеет свои недостатки. Если у конкретного пользователя много примеров для обучения модели, злоумышленники могут получить информацию об этом пользователе, даже если они не могут получить информацию о его отдельных примерах.

Защита конфиденциальности на уровне пользователя — это более строгая форма защиты, гарантирующая, что злоумышленник, использующий модель, не сможет узнать что-либо о пользователе, например, включены ли его данные в обучающий набор данных. Защита конфиденциальности на уровне пользователя лучше отражает реальное положение дел с данными в современном обществе. Она часто используется в федеративном обучении для обучения моделей на распределенных устройствах, таких как мобильные телефоны. На этих устройствах часто находится множество примеров, принадлежащих одному пользователю, и они требуют более строгих гарантий конфиденциальности.

DP на уровне пользователя не позволяет определить, были ли все данные пользователя включены в обучение или нет, а только один их фрагмент.

Обучение с использованием динамического программирования на уровне пользователя значительно сложнее, чем обучение на уровне примера, и требует добавления значительно большего количества шума. Эта проблема усугубляется по мере увеличения размера модели!

В работе «Обучение с использованием дифференциальной конфиденциальности на уровне пользователя при фиксированных вычислительных бюджетах» мы поставили перед собой задачу масштабировать дифференциальную конфиденциальность на уровне пользователя для больших языковых моделей (LLM), обученных в центре обработки данных. Обучение в центре обработки данных гораздо гибче, чем федеративное обучение. В федеративном обучении можно выполнять запросы только к пользователям, а не к отдельным примерам, и невозможно выбрать, какие пользователи доступны для запроса. При обучении в центре обработки данных можно запрашивать как отдельные примеры, так и целых пользователей, и можно выбирать, к каким из них обращаться на каждом этапе. Наш главный вопрос: как мы можем использовать эту повышенную гибкость для достижения лучших результатов обучения?

Вместо обучения полной модели LLM с использованием динамического программирования (DP), мы фокусируемся на тонкой настройке LLM с помощью DP, поскольку DP требует больших вычислительных ресурсов, что может быть непозволительно дорого для обучения полной модели LLM, а тонкая настройка, скорее всего, потребует использования частных данных, специфичных для конкретной предметной области. Мы определяем, какие алгоритмы показали наилучшие результаты и как использовать гибкость обучения в центре обработки данных для их дальнейшей оптимизации. Эта оптимизация важна для моделей LLM, поскольку даже небольшое снижение уровня шума может привести к значительному повышению качества. Мы также показываем, что даже с учетом дополнительной гибкости в центре обработки данных, предложенная нами стратегия обучения больше похожа на алгоритм для федеративного обучения.

Обучение моделей с учетом конфиденциальности на уровне пользователя.

Стохастический градиентный спуск (SGD) — это распространённый алгоритм обучения моделей, который случайным образом делит обучающие данные на небольшие пакеты, вычисляет обновления модели, называемые «градиентами», для каждого примера в пакете и применяет их к модели. Для обучения с использованием DP мы немного модифицируем этот алгоритм, добавляя случайный шум к градиентам, по сути, объединяя DP с SGD в процессе, называемом DP-SGD. Шум приводит к тому, что модель получает неполную информацию о примерах во время обучения, что хорошо для обеспечения конфиденциальности! Но поскольку мы предоставляем модели неполную информацию, её способность учиться на примерах неизбежно слабее, чем если бы мы предоставили ей полную информацию. Тем не менее, DP является необходимым условием для использования конфиденциальных данных, и неполная информация о конфиденциальных данных лучше, чем её полное отсутствие.

Визуализация этапов (DP-)SGD.

DP-SGD отлично подходит для достижения динамического программирования на уровне примеров, поскольку напрямую ограничивает влияние каждого примера на модель. Он широко изучался в Google, в том числе в таких областях применения, как моделирование рекламы и генерация синтетических данных.

Как изменить DP-SGD, если мы хотим использовать динамический программный код на уровне пользователя? Нам нужно убедиться, что влияние каждого пользователя на модель ограничено.

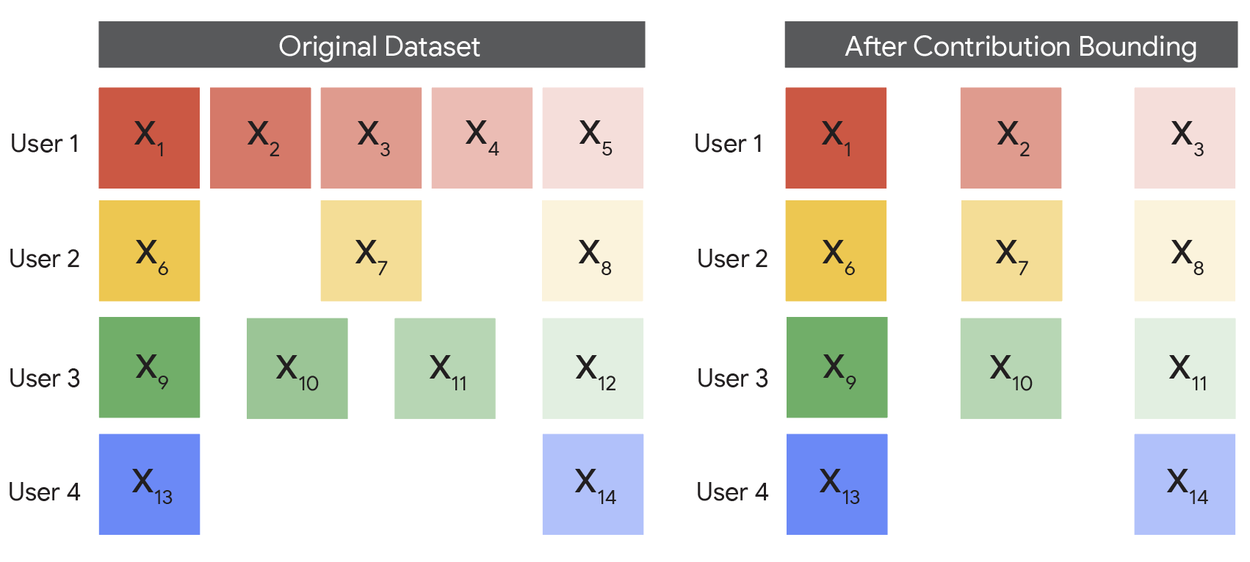

Достичь этого можно двумя способами. В обоих случаях мы сначала предварительно обрабатываем набор данных таким образом, чтобы каждый пользователь добавлял в обучающий набор данных только ограниченное количество примеров. Затем мы либо:

- Примените DP-SGD как есть. Добавив больше шума, чем раньше, мы можем превратить нашу гарантию динамического программирования на уровне примера в гарантию динамического программирования на уровне пользователя (это самая сложная часть!).

- Вместо того чтобы в DP-SGD выбирать случайные примеры для формирования пакетов, следует выбирать случайных пользователей, а затем брать все примеры от выбранных пользователей для формирования пакета.

Основное различие между этими методами заключается в выборке данных. Первый метод выбирает случайные примеры, поэтому мы называем его «выборкой на уровне примеров» (Example-Level Sampling, ELS). Второй метод выбирает случайных пользователей, поэтому мы называем его «выборкой на уровне пользователей» (User-Level Sampling, ULS). ULS очень похож на федеративное обучение в центрах обработки данных (и фактически используется в реальных условиях федеративного обучения, но без случайной выборки). Следует отметить, что из-за этапа случайной выборки оба алгоритма неприменимы в федеративном обучении, поскольку устройства не обязательно доступны для каждого раунда обучения!

Пример набора данных до и после ограничения вклада каждого пользователя максимум тремя.

Визуальное сравнение способов формирования партий в системах ELS и ULS.

Как в методе ELS, так и в методе ULS есть ключевой параметр для оптимизации: ограничение на количество примеров, которые каждый пользователь может добавить в набор данных, которое мы называем «границей вклада», и которое мы используем на этапе предварительной обработки. Как мы обсудим позже, этот параметр необходимо тщательно выбирать для оптимизации производительности.

Какой из этих алгоритмов работает лучше, особенно в больших масштабах? Это не очевидно, и мы не нашли ответа на этот вопрос в литературе. Именно это мы и решили выяснить.

Применение этих алгоритмов в программах магистратуры по гуманитарным и прикладным наукам

Если мы запустим эти алгоритмы «из коробки» для LLM, всё пойдёт не так. Поэтому мы разработали оптимизации для алгоритмов, которые устраняют ключевые проблемы, возникающие при их запуске «из коробки».

Для ELS нам пришлось перейти от гарантий защиты данных на уровне примеров к гарантиям защиты данных на уровне пользователей. Мы обнаружили, что в предыдущих работах добавлялось на порядки больше шума, чем было необходимо. Мы смогли доказать, что можем добавить значительно меньше шума, значительно улучшив модель при сохранении тех же гарантий конфиденциальности.

Как для ELS, так и для ULS нам пришлось выяснить, как оптимизировать границу вклада. «Выбор по умолчанию» — это выбор границы вклада, которой уже удовлетворяют все пользователи; то есть, мы не выполняем никакой предварительной обработки. Однако некоторые пользователи могут предоставлять большой объем данных, и нам потребуется добавить большое количество шума, чтобы обеспечить конфиденциальность для этих пользователей. Установка меньшей границы вклада уменьшает количество добавляемого шума, но платой за это является необходимость отбрасывания большого количества данных. Поскольку обучение LLM обходится дорого, мы не можем позволить себе пытаться обучить множество моделей с разными границами вклада и выбрать лучшую — нам нужна эффективная стратегия выбора границы вклада до начала обучения.

После длительных экспериментов в больших масштабах мы обнаружили, что для ELS эффективной стратегией является установление границы вклада равной медианному числу примеров, хранящихся у каждого пользователя. Для ULS мы приводим прогноз общего добавленного шума как функцию границы вклада и обнаружили, что выбор границы вклада, минимизирующей этот прогноз, является эффективной стратегией.

Результаты

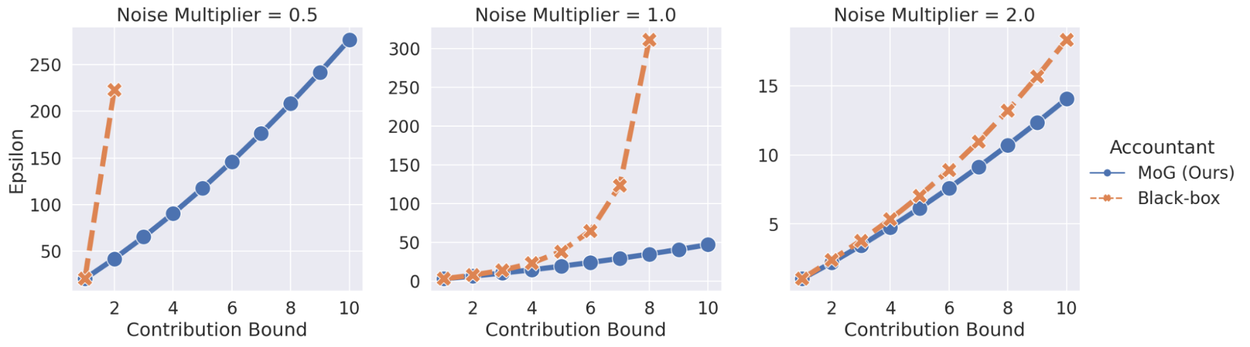

Сначала мы сравнили уровень шума, который, как мы доказали, необходим для ELS, с уровнем шума, который, согласно предыдущим исследованиям, также был необходим. Уровни шума, определенные нами в результате анализа, отражали экспоненциальное снижение необходимого уровня шума:

Расчеты методом «черного ящика» показывают, что гарантии конфиденциальности (ε) экспоненциально убывают в пределах границы вклада. Наша новая граница показывает, что гарантия конфиденциальности убывает почти линейно только в пределах границы вклада!

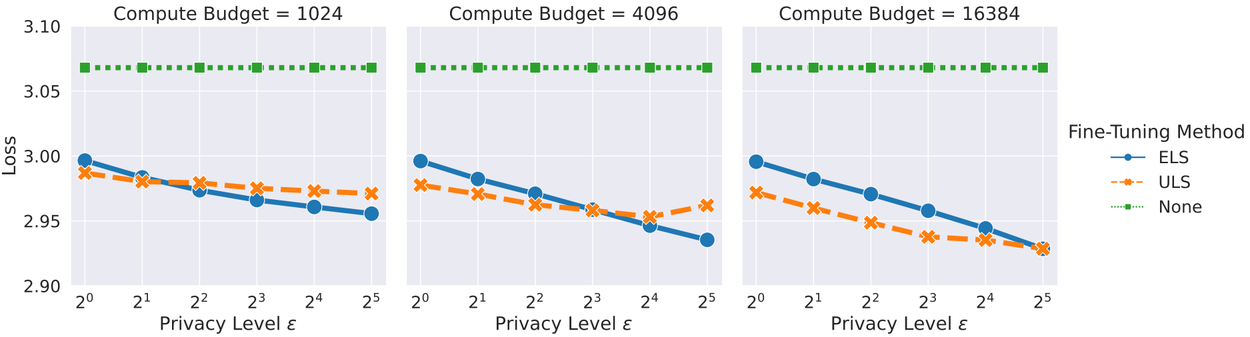

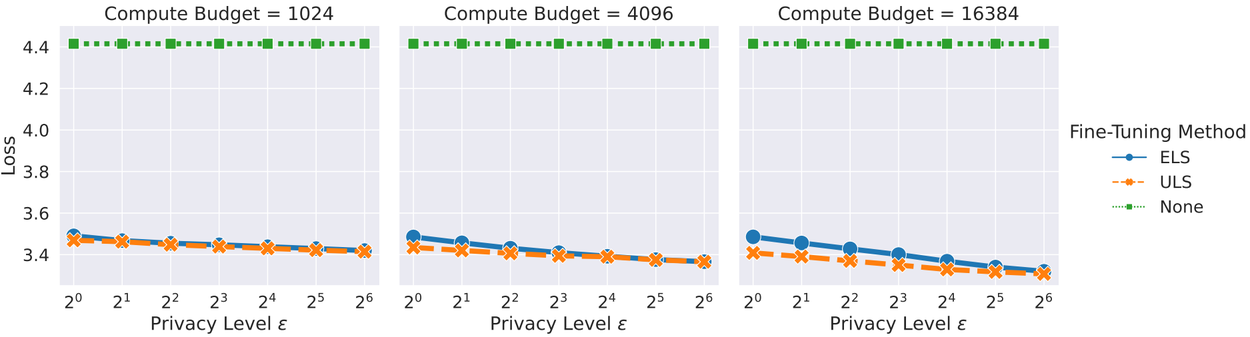

Далее мы сравнили ELS и ULS, используя наши оптимизации, в задачах тонкой настройки языковых моделей, где каждый алгоритм обрабатывал одинаковое общее количество примеров за раунд обучения. Мы выполнили тонкую настройку модели трансформера с 350 миллионами параметров на наборах данных StackOverflow и CC-News — двух стандартных исследовательских наборах данных для изучения динамического программирования на уровне пользователя.

Сравнение ELS, ULS и отсутствия тонкой настройки на CCNews и StackOverflow.

Мы обнаружили, что в большинстве случаев ULS является лучшим алгоритмом. Исключением (по крайней мере, для CC-News) были случаи, когда нам требовалась большая конфиденциальность или мы не использовали много вычислительных ресурсов. Примечательно, что отчасти благодаря нашим оптимизациям оба метода показали лучшие результаты, чем предварительно обученная модель, несмотря на строгие требования к конфиденциальности.

Заключение

В данной работе мы оптимизировали производительность ELS и ULS, двух вариантов DP-SGD, которые обеспечивают защиту данных на уровне пользователя и активируются путем обучения в центре обработки данных. Мы оптимизировали ELS, предоставив для него новые гарантии конфиденциальности и разработав эвристику для установки границы вклада без необходимости проведения многократных запусков обучения. Аналогичным образом мы оптимизировали ULS, разработав эвристику для установки границы вклада, также без необходимости проведения запусков обучения. Наши оптимизации обеспечивают обоснованный выбор важных параметров, которые ранее выбирались произвольно .

Несмотря на то, что защита персональных данных на уровне пользователя является строгим определением конфиденциальности, и на сложности обучения больших моделей с защитой персональных данных, наши эксперименты показали, что тонкая настройка моделей LLM с защитой персональных данных на уровне пользователя является как осуществимой, так и более выгодной, чем использование предварительно обученных моделей, благодаря нашим оптимизациям. Таким образом, наша работа позволяет разработчикам моделей точно настраивать свои модели под конфиденциальные наборы данных, обеспечивая при этом надежную защиту пользователей.

Источник: research.google