Новичок в науке о данных? Разберитесь во всём этом с помощью стартового набора 2026 года. Какие основы Python, SQL и машинного обучения важны, а что можно игнорировать?

Изображение предоставлено автором.

# Введение

Если вы читаете эту статью, вы, вероятно, немного знакомы с Python и интересуетесь наукой о данных. Возможно, вы уже написали несколько циклов, может быть, даже использовали библиотеку типа Pandas. Но теперь вы столкнулись с распространенной проблемой. Область науки о данных обширна, и понять, с чего начать и, что более важно, что следует игнорировать, может быть утомительно.

Этот учебный материал написан именно для вас. Он отсеивает лишнее и предлагает четкий, структурированный путь обучения. В основе науки о данных лежит извлечение знаний и идей из данных для принятия решений и действий. В ходе изучения этой статьи вы научитесь преобразовывать необработанные данные в полезную информацию для принятия решений.

Мы ответим на самый фундаментальный вопрос: «Что мне следует изучить в первую очередь для работы с данными?» Мы также рассмотрим концепции, которые можно смело отложить, сэкономив сотни часов на путанице. К концу статьи у вас будет практичный, целенаправленный план на 2026 год, разработанный для того, чтобы подготовить вас к работе.

# Понимание основной философии науки о данных

Прежде чем перейти к описанию конкретных инструментов, важно понять принцип, лежащий в основе большей части науки о данных, например, как правило 80/20 применяется в науке о данных. Это правило, также известное как принцип Парето, гласит, что 80% результатов достигаются за счет 20% причин.

В контексте вашего обучения это означает, что 20% концепций и инструментов будут использоваться для 80% реальных задач, с которыми вы столкнетесь. Многие новички совершают ошибку, пытаясь изучить каждый алгоритм, каждую библиотеку и каждое математическое доказательство. Это приводит к выгоранию.

Вместо этого успешный специалист по анализу данных сначала сосредотачивается на основных, наиболее эффективных навыках. Для эксперта в отрасли формула успеха проста: создать 2 запущенных проекта, написать 3 поста в LinkedIn и отправлять 50 заявок в неделю, что приведет к 3-5 собеседованиям в месяц. Это правило 80/20 в действии. Сосредоточьтесь на нескольких важных действиях, которые приносят большинство результатов.

Ключевой момент — это изучение навыков в той последовательности, в которой вы будете применять их на работе, подтверждая каждый навык небольшим, поддающимся проверке проектом. Именно такой подход отличает тех, кто просто получает сертификаты, от тех, кого принимают на работу.

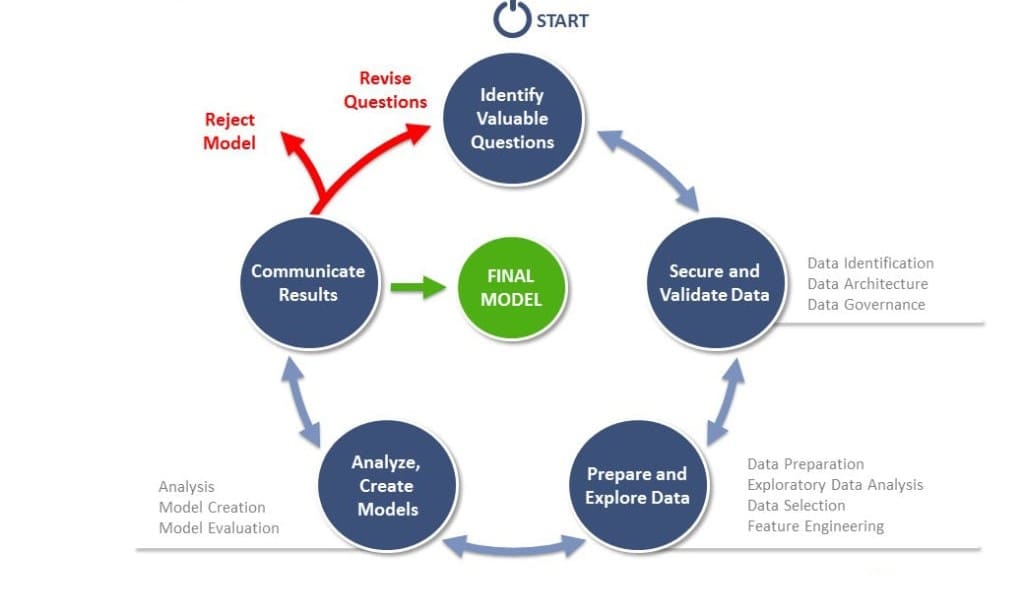

Основная философия науки о данных | Изображение предоставлено автором

# Изучение четырех типов науки о данных

Чтобы заложить прочный фундамент, необходимо понимать масштаб проблемы. Когда спрашивают: «Какие существуют 4 типа науки о данных?» или «Каковы 4 столпа анализа данных?», обычно имеют в виду четыре уровня зрелости аналитики. Эти четыре столпа представляют собой последовательность в том, как мы извлекаем ценность из данных.

Понимание этих основных принципов даст вам основу для решения любой проблемы, с которой вы столкнетесь.

// Понимание первого столпа: описательная аналитика

Это отвечает на вопрос о том, что произошло. Это включает в себя обобщение исторических данных для понимания тенденций. Например, расчет среднего объема продаж в месяц или коэффициента конверсии клиентов за последний квартал относится к описательной аналитике. Она дает представление о «общей картине».

// Понимание второго компонента: Диагностическая аналитика

Это отвечает на вопрос, почему это произошло. Здесь же вы углубляетесь в изучение первопричины произошедшего. Если отток клиентов увеличился, диагностическая аналитика помогает выявить проблему и определить, сосредоточено ли это увеличение в конкретном географическом регионе, типе продукции или сегменте клиентов.

// Понимание третьего столпа: прогнозная аналитика

Здесь вы можете узнать, что, скорее всего, произойдет. Именно здесь вступает в игру машинное обучение. Находя закономерности в исторических данных, вы можете создавать модели для прогнозирования будущих событий. Например, расчет вероятности того, что конкретный клиент покинет ваш бренд в ближайшие несколько месяцев, — это классическая задача прогнозирования.

// Понимание четвертого столпа: Прескриптивная аналитика

На этом этапе вы отвечаете на вопрос, что нам следует с этим делать. Это самый продвинутый этап. Он использует моделирование и оптимизацию для выработки рекомендаций по конкретным действиям. Например, прескриптивная аналитика может подсказать, какое рекламное предложение с наибольшей вероятностью убедит клиента, рискующего отказаться от услуг вашей компании, остаться с вами.

По мере обучения вы начнете с описательной аналитики и постепенно перейдете к задачам прогнозирования и предписывания.

# Определение важных навыков, которые следует освоить в первую очередь

Теперь перейдем к сути вопроса. Что мне следует изучить в первую очередь для работы в области анализа данных? Согласно текущим отраслевым планам, первые два месяца следует посвятить развитию «навыков выживания».

// Освоение программирования и обработки данных

- Начните с основ Python. Поскольку у вас уже есть некоторые знания Python, вам следует углубить свои знания о функциях, модулях и виртуальных средах. Python является доминирующим языком в отрасли благодаря своим обширным библиотекам и масштабируемости.

- Изучите Pandas для обработки данных. Это обязательное условие. Вы должны уверенно владеть загрузкой данных (read_csv), обработкой пропущенных значений, объединением наборов данных и преобразованием данных с помощью groupby и pivot_table.

- Разберитесь в NumPy. Изучите основы массивов и векторизованных операций, поскольку многие другие библиотеки построены на их основе.

// Выполнение анализа и визуализации данных

- Исследовательский анализ данных (EDA). EDA — это процесс анализа наборов данных для обобщения их основных характеристик, часто с использованием визуальных методов. Вам следует научиться проверять распределения, корреляции и основные взаимодействия признаков.

- Визуализация с помощью Matplotlib и Plotly. Начните с простых, понятных диаграмм. Хорошее эмпирическое правило: каждая диаграмма должна иметь четкий заголовок, в котором указывается результат.

// Изучение SQL и гигиены данных

- Изучите SQL (Structured Query Language), потому что даже в 2026 году SQL останется языком данных. Вам необходимо освоить операторы SELECT, WHERE, JOIN, GROUP BY и оконные функции.

- Изучите Git и правила работы с данными. Научитесь использовать Git для контроля версий. Ваши репозитории должны быть аккуратными, с понятным файлом README.md, который объясняет другим, «как запустить» ваш код.

// Создание статистической основы

Часто начинающие беспокоятся о необходимости знания математики. Сколько статистики нужно для работы в области анализа данных? Ответ обнадеживает. Вам не нужна докторская степень. Однако вам необходимо иметь прочное понимание трех ключевых областей.

- Описательная статистика, включающая среднее значение, медиану, стандартное отклонение и корреляцию. Эти показатели помогают увидеть «общую картину» ваших данных.

- Вероятность — это наука, изучающая вероятность. Она помогает количественно оценить неопределенность и делать обоснованные прогнозы.

- Понимание распределений включает в себя знание того, как данные распределены (например, в случае нормального распределения), что помогает выбрать правильные статистические методы для анализа.

Статистическое мышление важно, потому что данные не «говорят сами за себя»; им нужен интерпретатор, способный учесть роль случайности и изменчивости.

# Оценка того, что лучше подходит для анализа данных: Python или R

Это один из самых часто задаваемых вопросов новичками. Краткий ответ: оба варианта превосходны, но по разным причинам.

- Python стал основным языком для производственных и масштабируемых задач. Он легко интегрируется с технологиями обработки больших данных, такими как Spark, и является основным языком для фреймворков глубокого обучения, таких как TensorFlow. Если вас интересует развертывание моделей в приложениях или работа с крупномасштабными системами, Python — более предпочтительный выбор.

- Язык R исторически был языком статистики и остается невероятно мощным инструментом для углубленного статистического анализа и визуализации (с такими библиотеками, как ggplot2). Он по-прежнему широко используется в академической среде и отдельных областях исследований.

Для тех, кто начинает обучение в 2026 году, Python — рекомендуемый путь. Хотя R подходит для анализа небольших объемов данных, его производительность может стать слабым местом в реальных крупномасштабных приложениях. Поскольку у вас уже есть некоторые знания Python, углубленное изучение этого языка — наиболее эффективное использование вашего времени.

# Реализация 6-месячного плана действий для повышения конкурентоспособности на рынке труда

В основе подхода «Стартовый набор для специалистов по науке о данных 2026» лежит помесячный план, адаптированный из успешных отраслевых разработок.

// Закладка фундамента (1-2 месяцы)

- Цель : Самостоятельная обработка реальных данных.

- Навыки : углубленное изучение Python (Pandas, NumPy), освоение SQL-запросов на объединение таблиц и агрегирование, изучение Git и создание базовых знаний в области описательной статистики.

- Проект : Создать «анализ городских поездок». Собрать данные об общественном транспорте за месяц, очистить их, обобщить и ответить на бизнес-вопрос (например, «Какие три остановки вызывают самые большие задержки в часы пик?»). Опубликовать код на GitHub.

// Освоение основ машинного обучения (3-4 месяцы)

- Цель : Создать и оценить прогностическую модель.

- Навыки : Изучение алгоритмов обучения с учителем (логистическая регрессия, случайный лес), разделения данных на обучающую и тестовую выборки, перекрестной проверки и ключевых метрик (точность, прецизия, полнота, ROC-AUC). Помните, что разработка признаков часто составляет 70% работы.

- Проект : Разработать модель прогнозирования удержания клиентов. Цель – модель с показателем AUC выше 85%. Создать простую карточку модели, объясняющую её использование и ограничения.

// В центре внимания – развертывание (5-й месяц)

- Цель : Сделать вашу модель доступной для других.

- Навыки : Научиться использовать Streamlit или Gradio для создания простого веб-интерфейса для вашей модели. Понять, как сохранять и загружать модель с помощью pickle или joblib.

- Проект : Разработать приложение для сопоставления резюме и вакансий. Пользователь загружает свое резюме, а приложение оценивает его на соответствие описанию вакансии.

// Создание портфолио, готового к трудоустройству (6-й месяц)

- Цель : показать работодателям, что вы можете принести пользу.

- Действия :

- Убедитесь, что у вас есть 3 хорошо проработанных проекта на GitHub с понятными файлами README.

- Перепишите свое резюме, поставив цифры на первое место (например, «Разработал модель оттока клиентов, которая с точностью до 85% выявляла пользователей, подверженных риску»).

- Размещайте информацию о своих проектах в LinkedIn, чтобы расширить свою сеть контактов.

- Начните подавать заявки на вакансии, уделяя особое внимание стартапам, где часто требуются специалисты широкого профиля.

# Как понять, что следует игнорировать в процессе обучения

Чтобы по-настоящему оптимизировать процесс обучения, необходимо знать, что следует игнорировать. Этот раздел избавит вас от « более 300 часов » отвлечений, в которые попадают многие новички.

// 1. Откладываем глубокое обучение… Пока что

Если вы не нацелены на работу в сфере компьютерного зрения или обработки естественного языка, вы можете смело игнорировать глубокое обучение. Трансформеры, нейронные сети и обратное распространение ошибки — это интересные вещи, но они не требуются для 80% вакансий начального уровня в области анализа данных. Сначала освойте Scikit-learn.

// 2. Пропуск сложных математических доказательств

Хотя концептуальное понимание градиентов полезно, вам не нужно доказывать их с нуля. Современные библиотеки берут на себя математические вычисления. Сосредоточьтесь на применении, а не на выводе.

// 3. Избегание переключения между фреймворками

Не пытайтесь изучить десять разных фреймворков. Освойте основной: scikit-learn. Как только вы поймете основы подгонки моделей и прогнозирования, освоение XGBoost или других библиотек станет элементарным делом.

// 4. Приостановка соревнований Kaggle (для начинающих)

Участие в соревнованиях на Kaggle может быть заманчивым, но многие новички неделями гонятся за попаданием в 0,01% лучших результатов в таблице лидеров, создавая ансамбли из десятков моделей. Это не соответствует реальной работе в бизнесе. Чистый, готовый к внедрению проект, решающий четкую задачу, гораздо ценнее для работодателя, чем высокое место в таблице лидеров.

// 5. Освоение всех облачных платформ

Вам не обязательно быть экспертом одновременно в AWS, Azure и GCP. Если для работы требуются навыки работы с облачными технологиями, вы можете освоить их в процессе работы. В первую очередь сосредоточьтесь на своем основном наборе инструментов для анализа данных.

# Заключительные замечания

Начать свой путь в области анализа данных в 2026 году не обязательно должно быть сложно. Применяя правило 80/20, вы сосредотачиваетесь на наиболее важных навыках: Python, SQL, основы статистики и четкая коммуникация в рамках проектов. Вы понимаете четыре столпа аналитики как основу для своей работы и имеете четкий 6-месячный план действий, который будет направлять ваши усилия.

Помните, главная цель науки о данных — превратить данные в действия. Следуя этому стартовому набору, вы не просто собираете знания; вы развиваете способность предоставлять аналитические данные, которые помогают принимать решения. Начните свой первый проект сегодня вечером. Скачайте набор данных, создайте простой анализ и опубликуйте его на GitHub. Путь тысячи моделей начинается с одной строки кода.

// Ссылки

- NIIT. (2025). Карьерная карта в области науки о данных: от новичка до эксперта. Получено с сайта niit.com

- OpenDSA. (без даты). Самоорганизующиеся списки. Получено с сайта opendsa-server.cs.vt.edu

- Институт ангевандте Arbeitswissenschaft. (2024). Наука о данных. Получено с сайта arbeitswissenschaft.net.

- Рашка, С. (2026). Широко ли используется R сегодня в науке о данных? (Получено с сайта sebastianraschka.com)

- NIELIT. (2025). Большие данные и наука о данных. Получено с сайта nielit.gov.in

- EdgeVerve. (2017). Аналитика: от пророчеств Дельфи до прогнозирования на основе научных данных. Получено с сайта edgeverve.com

- KNIME. (2024). Сколько статистики достаточно для проведения анализа данных? Источник: knime.com

- Блог инженерного факультета Пенсильванского университета. (2022). Наука о данных: преобразование данных в знания, превращение знаний в действия. Источник: blog.seas.upenn.edu

Шитту Олумиде — инженер-программист и технический писатель, увлеченный использованием передовых технологий для создания захватывающих повествований, обладающий острым вниманием к деталям и умением упрощать сложные концепты. Шитту также можно найти в Твиттере.

Источник: www.kdnuggets.com