Мы исследуем подход, использующий локализацию с помощью нескольких микрофонов для улучшения субтитров на мобильных устройствах с помощью диаризации говорящих и направленного указания направления.

Быстрые ссылки

- Бумага

- Делиться

Возможности преобразования речи в текст на мобильных устройствах, такие как Live Transcribe, стали бесценными для обеспечения доступности речи и слуха, перевода языков, ведения заметок и стенограмм совещаний. Однако, когда в разговоре участвует несколько человек, существующие мобильные приложения автоматического распознавания речи (ASR) обычно объединяют всю расшифрованную речь, что затрудняет отслеживание того, кто что говорит. Это ограничение создает когнитивную перегрузку для пользователей, которым необходимо одновременно обрабатывать расшифровку, идентифицировать говорящих и участвовать в разговоре. Были разработаны решения, но в настоящее время их непрактично внедрять в мобильные сценарии. Например, для аудиовизуального разделения речи требуется, чтобы говорящие были видны камере, а подходы к встраиванию голоса говорящего требуют модели для определения и регистрации уникального голосового отпечатка каждого говорящего.

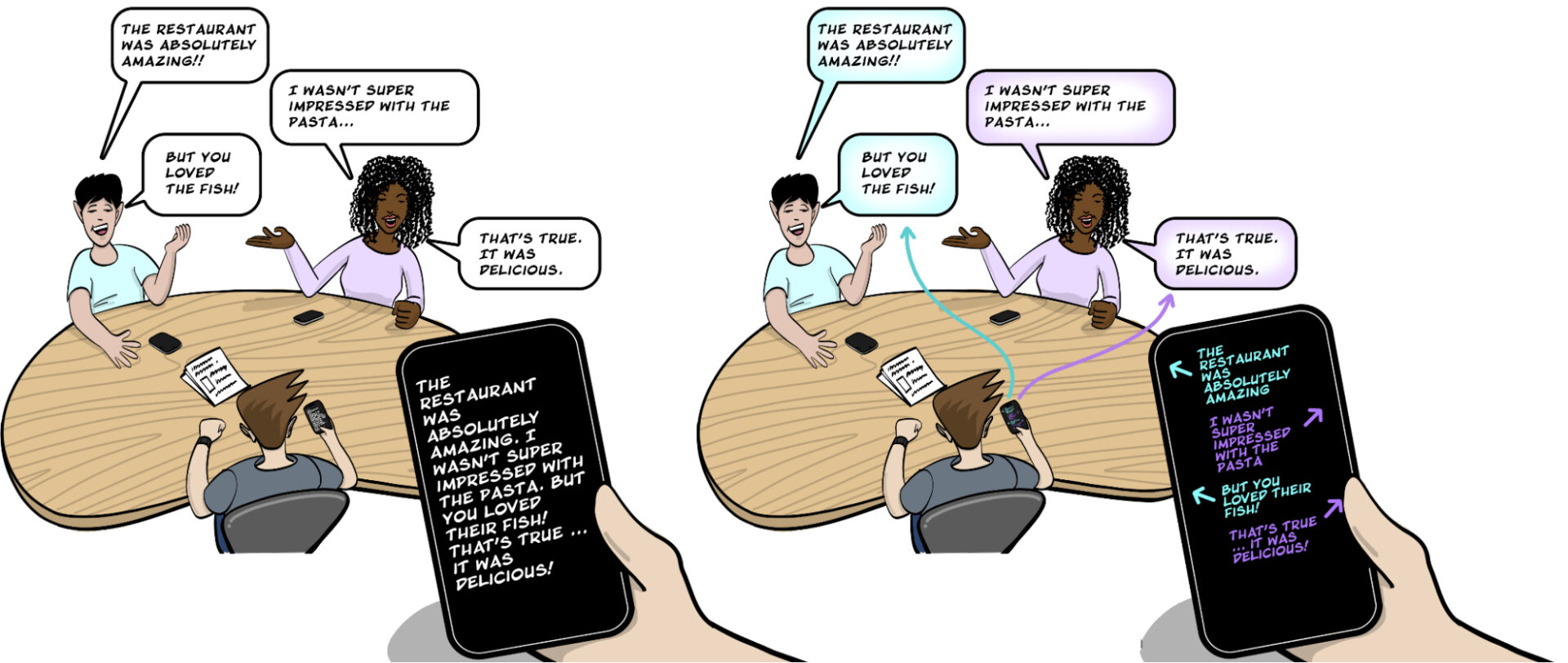

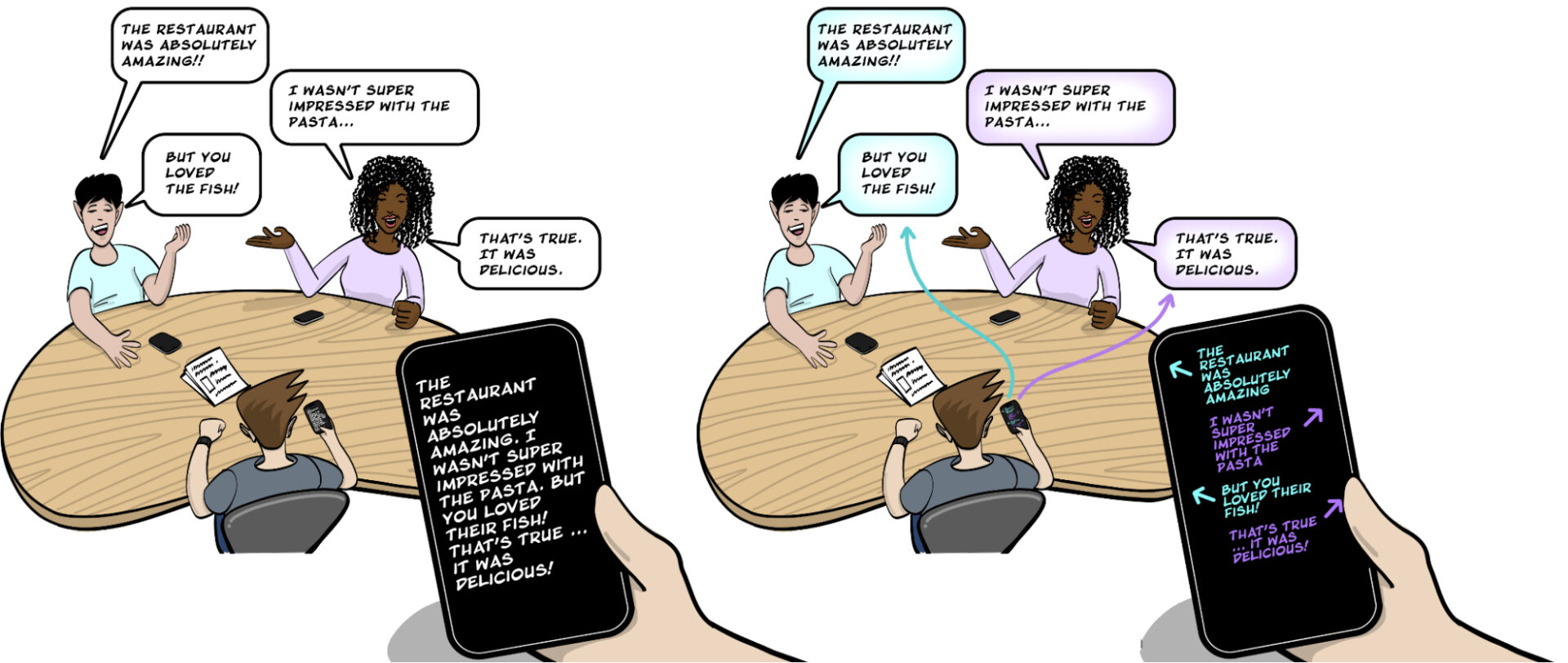

В статье «SpeechCompass: Улучшение мобильных субтитров с помощью диаризации и направленного ориентирования посредством многомикрофонной локализации», получившей награду за лучшую статью на конференции CHI 2025, мы исследуем подход, который улучшает мобильные субтитры с помощью диаризации говорящих (разделение говорящих в транскрипте автоматического распознавания речи) и локализации входящего звука в реальном времени. SpeechCompass создает удобные для пользователя транскрипты для групповых разговоров, предоставляя цветовую кодировку визуального разделения для каждого говорящего и указатели направления (стрелки), чтобы помочь пользователям определить направление, откуда исходит речь. Этот многомикрофонный подход снижает вычислительные затраты, уменьшает задержку и повышает уровень конфиденциальности.

Слева : Существующие мобильные приложения для транскрипции объединяют транскрибированный текст. Справа : SpeechCompass указывает направление входящей речи, позволяя визуально разделять транскрипции с помощью цветов и указателей направления (например, стрелок) в пользовательском интерфейсе.

Эффективная локализация звука в реальном времени

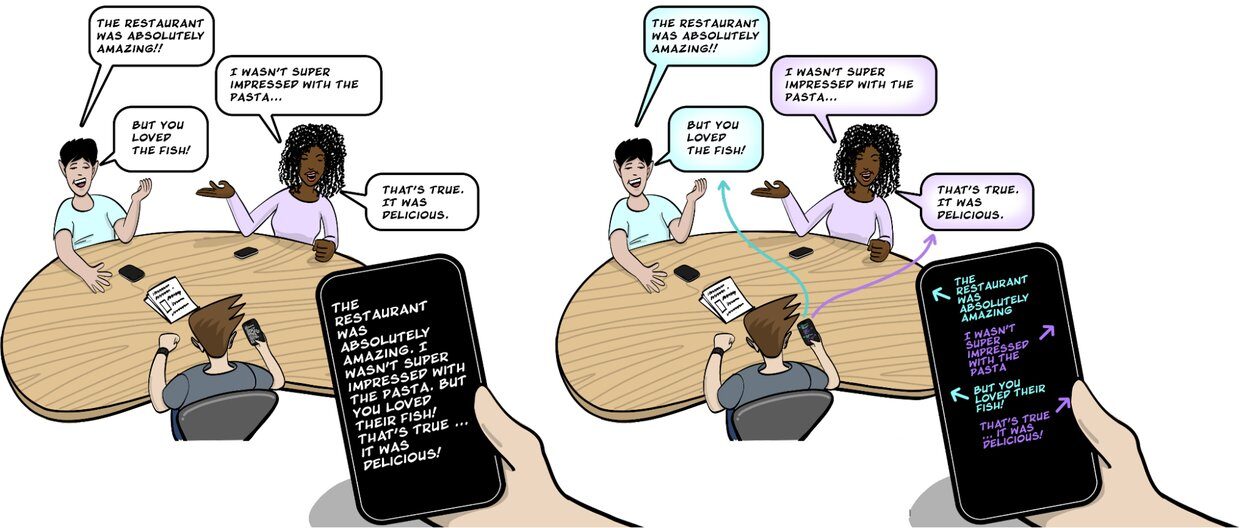

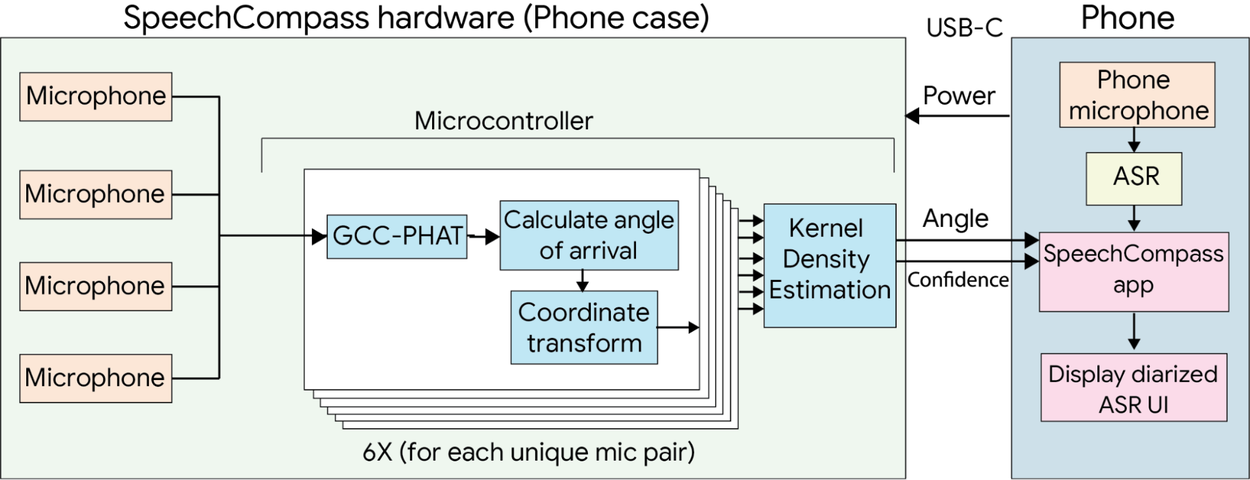

Мы реализуем SpeechCompass в двух различных формах: в виде прототипа чехла для телефона с четырьмя микрофонами, подключенными к маломощному микроконтроллеру, и в виде программного обеспечения для существующих телефонов с двумя микрофонами. Конструкция чехла для телефона обеспечивает оптимальное размещение микрофонов для обеспечения 360-градусной локализации звука. Программная реализация обеспечивает локализацию только на 180 градусов на устройствах с двумя и более микрофонами, таких как телефон Pixel. В обеих реализациях телефон используется для распознавания речи, а расшифровка текста визуализируется с помощью мобильного приложения.

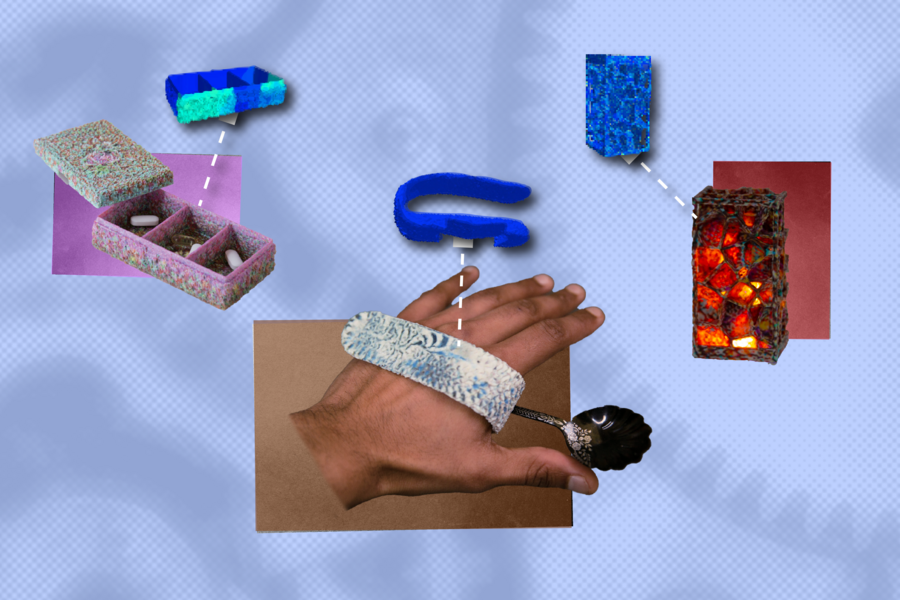

Реализация прототипа корпуса для телефона и его внутренней электроники. A ) Интерфейс мобильного приложения с установленным прототипом корпуса. B ) Прототип корпуса с гибкой печатной платой для крепления микрофона и основной печатной платой. C ) Вид сверху и снизу основной печатной платы ( STM32 ).

Поскольку звук имеет низкую частоту, он отражается от стен помещений, вызывая реверберацию и затрудняя точную локализацию звука, особенно речи. Для решения этой проблемы мы применяем алгоритм локализации, основанный на разности времени прихода (TDOA). Аудиосигналы поступают на каждый микрофон в немного разное время, поэтому алгоритм оценивает TDOA между парами микрофонов с помощью кросс-корреляции, чтобы предсказать угол прихода звука. В частности, мы используем обобщенную кросс-корреляцию с фазовым преобразованием (GCC-PHAT) для повышения устойчивости к шуму и увеличения скорости вычислений. Затем мы применяем статистические оценки, такие как оценка плотности ядра, для повышения точности локализации. Использование двух всенаправленных микрофонов всегда будет приводить к путанице «спереди-сзади» (т.е. когда сигналы перед или за массивом кажутся идентичными сигналам от массива микрофонов), что позволяет локализовать только на 180 градусов. Эта проблема решается использованием трех или более микрофонов, что делает возможной локализацию на 360 градусов.

Схема системы SpeechCompass, включая аппаратную часть чехла для телефона и приложение для телефона.

В отличие от подходов машинного обучения к диаризации речи на основе одного источника, многомикрофонный подход SpeechCompass предлагает ряд преимуществ:

- Снижение вычислительных затрат и затрат памяти: поскольку в алгоритме отсутствуют модель и веса, он может работать на небольших микроконтроллерах с ограниченным объемом памяти и вычислительных ресурсов.

- Сниженная задержка: SpeechCompass не полагается на захват отличительных характеристик голоса. Вместо этого он извлекает информацию о направлении из основных свойств звука, что позволяет ему работать в режиме реального времени с минимальной задержкой.

- Более высокая степень защиты конфиденциальности: SpeechCompass предполагает, что разные говорящие физически находятся в разных местах, и не требует видеозаписи или какой-либо уникальной информации, позволяющей идентифицировать личность, например, векторных представлений голоса (уникальной идентификации голоса отдельного человека).

- Работает независимо от языка: SpeechCompass анализирует различия между звуковыми волнами, не делая предварительных предположений о содержании, и работает со звуками, выходящими за рамки речи.

- Мгновенная перенастройка : SpeechCompass можно мгновенно перенастроить, переместив телефон.

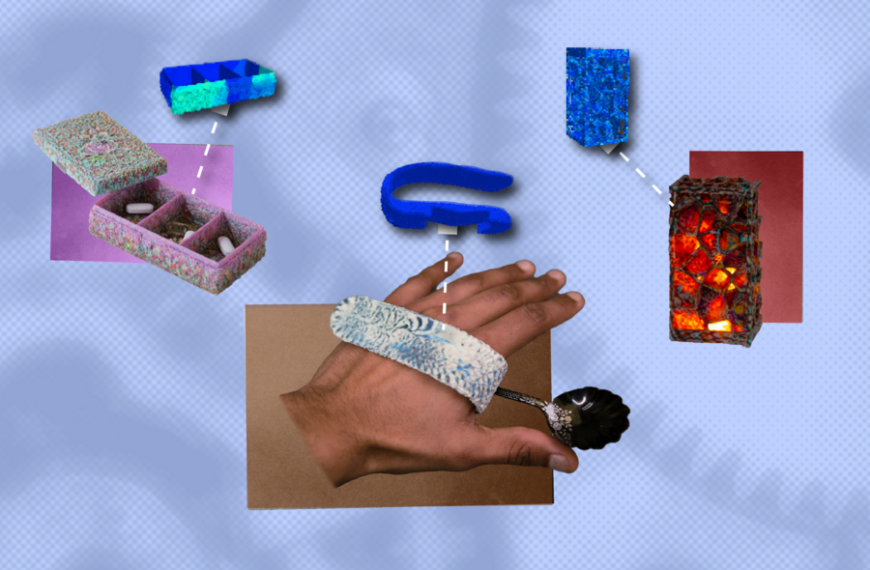

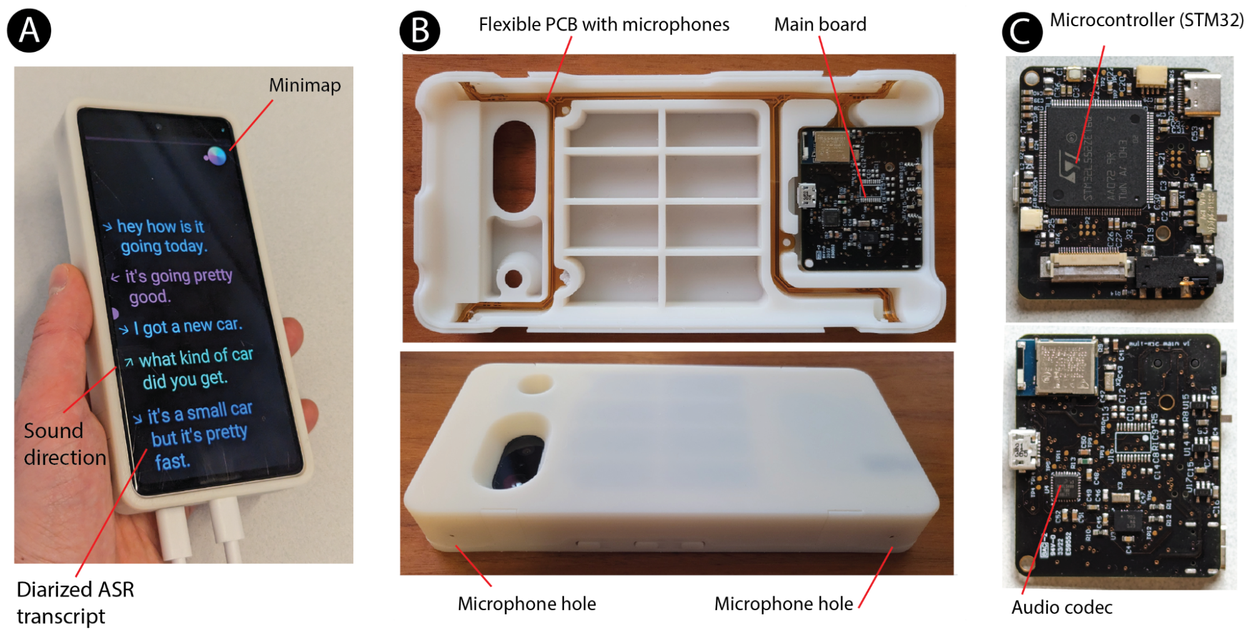

Пользовательский интерфейс для визуализации направления говорящего

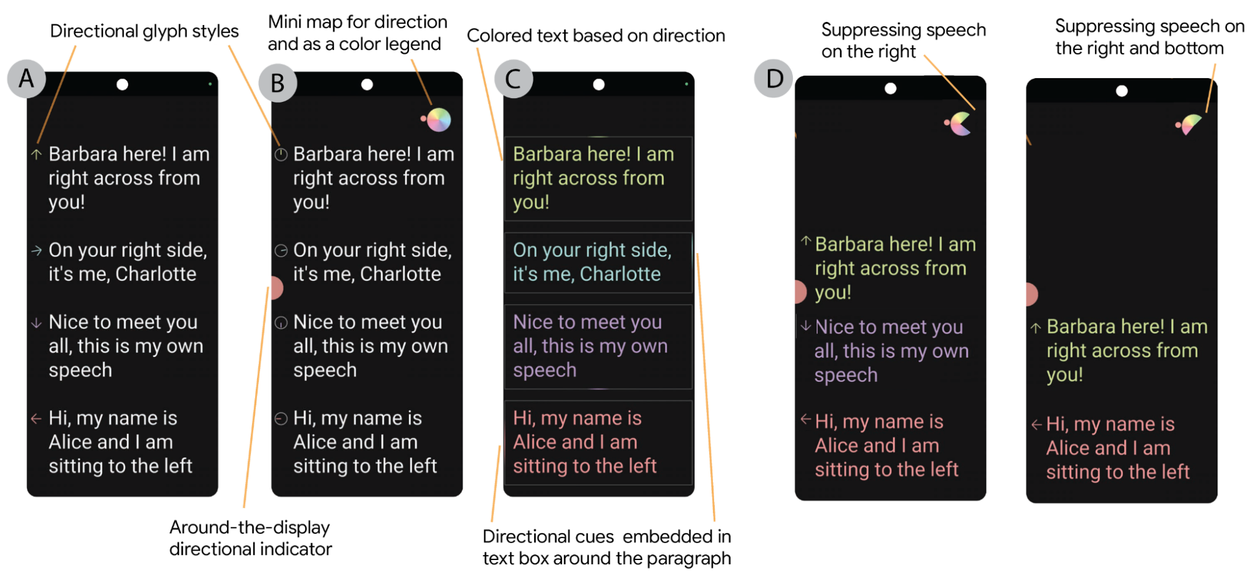

Мы использовали возможности преобразования речи в текст в Android для разработки мобильного приложения, которое дополняет текстовые расшифровки речи данными о местоположении, передаваемыми через USB с микрофонов прототипа чехла для телефона. Приложение для Android предлагает несколько стилей визуализации для указания направления говорящего:

- Цветной текст : Выступающие разделены текстом разного цвета.

- Указательные символы : стрелки, циферблаты в круге и цветовые выделения на рамках вокруг текста указывают на местоположение каждого говорящего.

- Мини-карта : Небольшой радарный дисплей отображает текущее местоположение говорящего.

- Индикаторы по краям : Визуальные подсказки по краям экрана указывают направление голоса говорящего.

- Подавление нежелательной речи : пользователь может щелкать по краям экрана, чтобы подавить речь, исходящую из этих направлений. Это можно использовать и для удаления собственной речи. Ненужные разговоры поблизости могут быть удалены из стенограммы, что повышает конфиденциальность говорящих рядом.

Различные стили визуализации дополняют стенограммы речи.

Техническая оценка

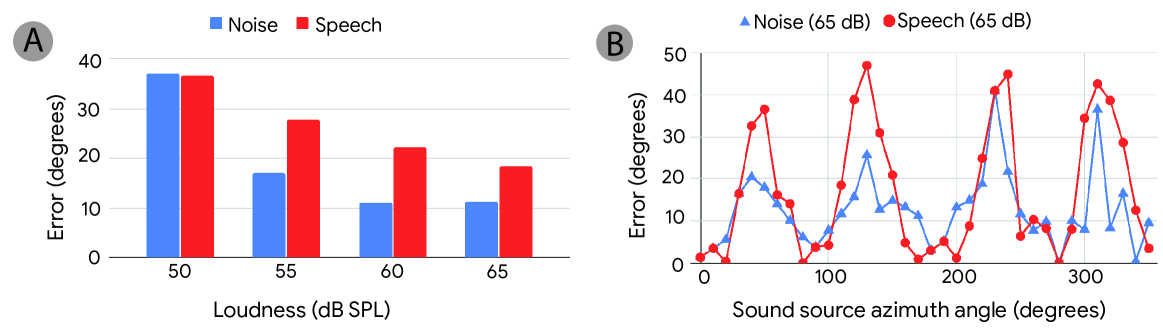

Для оценки программного обеспечения SpeechCompass мы поместили чехол для телефона на вращающуюся платформу, на которой стоял стационарный динамик, воспроизводящий речь или шум. Платформа поворачивалась с шагом в 10 градусов, и для каждого угла измерялся угол прихода звука. Наша оценка показывает, что SpeechCompass может точно определять направление звука со средней погрешностью 11°–22° при нормальной громкости разговора (60–65 дБ). Точность примерно сопоставима с возможностями определения местоположения человеком. Например, если бы человека спросили, где слышен звук позади него, его ответ обычно имел бы погрешность до 20 градусов. Система SpeechCompass хорошо работает с различными материалами и в различных условиях окружающего шума; более подробная информация приведена в статье.

Ошибка в локализации при разных уровнях громкости и ракурсах источника звука.

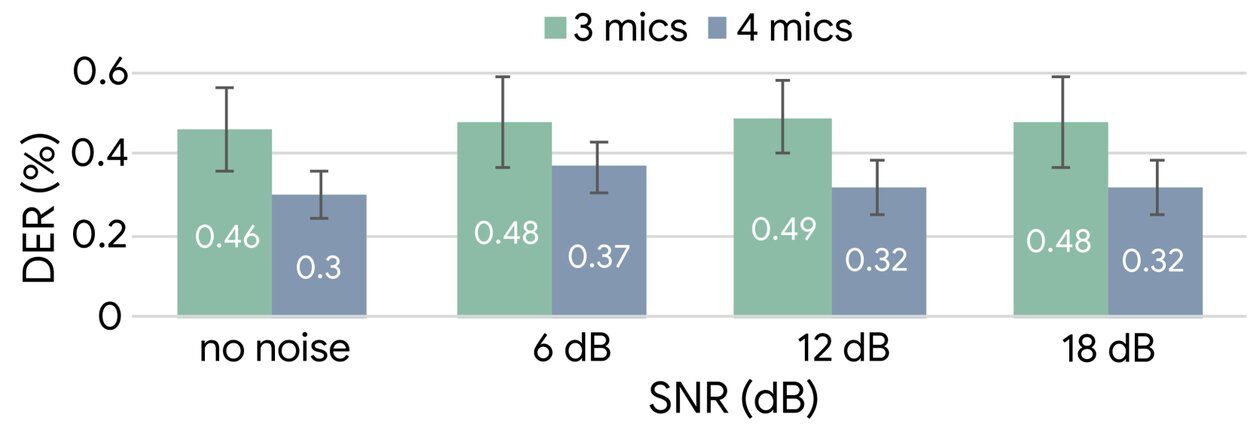

Для диаризации мы использовали показатель частоты ошибок диаризации (DER), стандартную метрику для диаризации, которая соответствует правильности цветовой кодировки диаризации говорящего в интерфейсе. Наши тесты показали, что конфигурация с четырьмя микрофонами неизменно превосходила конфигурацию с тремя микрофонами, демонстрируя относительное улучшение DER на 23–35% в различных условиях отношения сигнал/шум (SNR).

Частота ошибок диаризации (DER) при использовании 3- и 4-микрофонных конфигураций при различных соотношениях сигнал/шум.

Оценка и обратная связь от пользователей

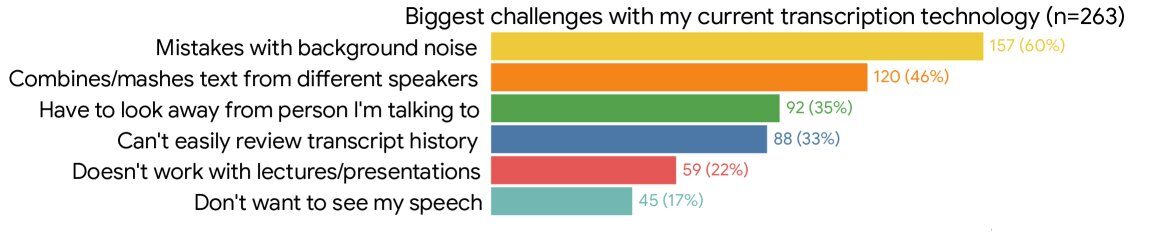

Чтобы понять ограничения существующих технологий создания субтитров для мобильных устройств, мы провели онлайн-опрос среди 263 пользователей, часто использующих такие технологии. Результаты показывают, что существующие решения сталкиваются со значительным недостатком — невозможностью различать говорящих, что затрудняет их использование в групповых разговорах.

Результаты опроса среди активных пользователей мобильных приложений для создания субтитров.

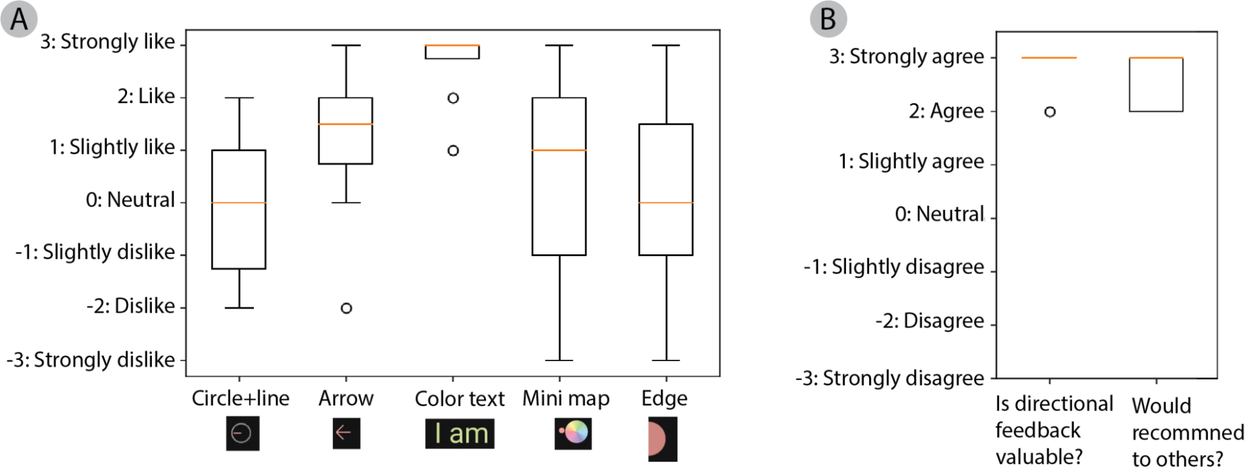

Во-вторых, мы продемонстрировали прототип восьми активным пользователям мобильных приложений для преобразования речи в текст и собрали отзывы. Прототип использовался для ведения дневника и визуализации разговора между исследователями. Мы обнаружили, что цветной текст и указательные стрелки были наиболее предпочтительными методами визуализации. Все участники согласились с ценностью указательных стрелок для групповых разговоров.

Результаты пользовательского исследования с использованием работающего прототипа. А ) Предпочтения в отношении различных методов визуализации. Б ) Ценность направленной обратной связи для пользователей.

Что дальше?

Мы предполагаем, что локализация с использованием нескольких микрофонов для мобильной транскрипции может иметь множество практических применений. Например , в учебном процессе студенты могли бы легче следить за обсуждениями между преподавателями и однокурсниками. Аналогично, на деловых встречах, интервью или общественных мероприятиях пользователи могли бы отслеживать смену говорящих в многосторонних разговорах.

SpeechCompass демонстрирует значительные улучшения в создании субтитров для мобильных устройств в групповых разговорах, и существует множество возможных направлений для дальнейшего развития:

- Интеграция с другими носимыми устройствами, такими как умные очки и умные часы.

- Повышение устойчивости к шуму с помощью методов машинного обучения.

- Дополнительная настройка параметров визуализации.

- Продольные исследования для понимания процесса внедрения и поведения в повседневных ситуациях.

Мы надеемся, что это исследование вдохновит на дальнейшие инновации в обеспечении большей доступности и инклюзивности коммуникации для всех.

Благодарности

Мы благодарим Артема Дементьева, Алекса Олвала, Матье Парве, Чонга Лая и Дмитрия Каневского за их работу над публикацией и исследованиями SpeechCompass. Дмитрия Вотинцева за идеи по прототипам и интерактивному дизайну. Мы благодарны Паскалю Гетройеру, Ричарду Лайону, Алексу Хуангу, Шао-Фу Ши и Чету Гнеги за помощь в разработке алгоритмов. Мы также благодарим Шона Кейна, Джеймса Ландея, Малкольма Слейни и Мередит Моррис за их отзывы по этой статье. Мы ценим вклад Карсона Лау в разработку механического дизайна корпуса телефона и Нгана Нгуена в сборку электроники. Наконец, мы благодарим Мэй Лу, Дона Барнетта, Райана Герагти и Санджая Батру за исследования и дизайн пользовательского опыта.

Источник: research.google