Как генерация дополненной поисковой информации развивается от статических конвейеров к управляемым, контекстно-зависимым системам, которые делают ИИ более объяснимым, заслуживающим доверия и масштабируемым

Делиться

Введение

Генерация дополненной реальности (RAG), возможно, была необходима для первой волны корпоративного ИИ, но она быстро развивается в нечто гораздо большее. За последние два года организации осознали, что простого извлечения фрагментов текста с помощью векторного поиска недостаточно. Контекст должен быть управляемым, объяснимым и адаптивным к целям агента.

В этой статье мы рассмотрим, как происходит эта эволюция и что она означает для лидеров в области данных и искусственного интеллекта, создающих системы, способные рассуждать ответственно.

Вы получите ответы на несколько ключевых вопросов:

Как графы знаний улучшают RAG?

Они придают структуру и смысл корпоративным данным, связывая сущности и отношения между документами и базами данных, чтобы сделать поиск более точным и понятным как для людей, так и для машин.

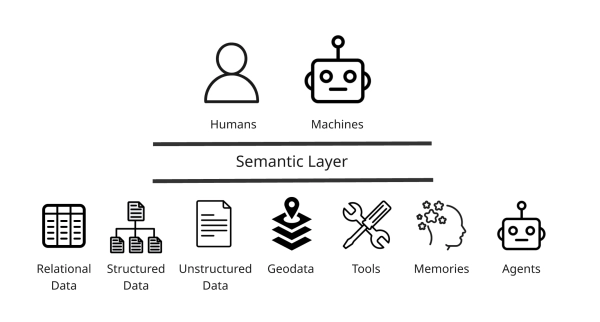

Как семантические слои помогают магистрам права находить более качественные ответы?

Семантические уровни стандартизируют определения данных и политики управления, чтобы агенты ИИ могли понимать, извлекать и рассуждать на основе всех видов данных, а также инструментов ИИ, воспоминаний и других агентов.

Как развивается RAG в эпоху агентного ИИ?

Извлечение становится одним из шагов в более широком цикле рассуждений (все чаще называемом «контекстной инженерией»), где агенты динамически записывают, сжимают, изолируют и выбирают контекст среди данных и инструментов.

TL;DR

Технология дополненной генерации поиска (RAG) приобрела известность после запуска ChatGPT и осознания ограниченности контекстного окна: нельзя просто скопировать все данные в интерфейс чата. Команды использовали RAG и его варианты, такие как GraphRAG (RAG, использующий графовую базу данных), для добавления дополнительного контекста в запросы во время выполнения запроса. Популярность RAG вскоре выявила его недостатки: добавление неверной, нерелевантной или просто слишком большой информации в контекстное окно может фактически ухудшить, а не улучшить результаты. Для преодоления этих ограничений были разработаны новые методы, такие как переранжирование, но RAG не был создан для выживания в новом мире агентов.

По мере того, как ИИ переходит от одиночных подсказок к автономным агентам, поиск и его варианты становятся лишь одним из инструментов в арсенале агента, наряду с записью, сжатием и изоляцией контекста. По мере роста сложности рабочих процессов и объёма информации, необходимой для их выполнения, поиск будет продолжать развиваться (хотя его можно назвать контекстной инженерией, RAG 2.0 или агентным поиском). Следующая эра поиска (или контекстной инженерии) потребует управления метаданными во всех структурах данных (не только реляционных), а также в инструментах, памяти и самих агентах. Мы будем оценивать поиск не только по точности, но и по релевантности, обоснованности, происхождению, охвату и новизне. Графы знаний будут играть ключевую роль в поиске, учитывающем контекст, учитывающем политики и семантически обоснованном поиске.

Расцвет RAG

Что такое РАГ?

RAG (генерация дополненной поисковой информации) — это метод извлечения релевантной информации для дополнения подсказки, отправляемой в LLM с целью улучшения ответа модели.

Вскоре после того, как ChatGPT стал популярным в ноябре 2022 года, пользователи осознали, что LLM (надеюсь) не обучались на собственных данных. Чтобы восполнить этот пробел, команды начали разрабатывать способы извлечения релевантных данных во время запроса для дополнения подсказки — подход, известный как генерация дополненного поиска (RAG). Термин появился в статье Meta 2020 года, но популярность моделей GPT привлекла внимание к нему и соответствующей практике.

Такие инструменты, как LangChain и LlamaIndex, помогли разработчикам создать эти конвейеры поиска. LangChain был запущен примерно в то же время, что и ChatGPT, как способ объединения различных компонентов, таких как шаблоны подсказок, LLM, агенты и память, в цепочку для приложений генеративного ИИ. LlamaIndex также был запущен в то же время, чтобы решить проблему ограниченного контекстного окна в GPT3 и, таким образом, сделать возможной работу RAG. В ходе экспериментов разработчики пришли к выводу, что векторные базы данных обеспечивают быстрый и масштабируемый способ поддержки процесса поиска в RAG, и векторные базы данных, такие как Weaviate, Pinecone и Chroma, стали стандартными элементами архитектуры RAG.

Что такое GraphRAG?

GraphRAG — это разновидность RAG, в которой для поиска данных используется базовая база данных в виде графа знаний или графовой базы данных.

Одна из разновидностей RAG стала особенно популярной: GraphRAG. Идея заключается в том, что базовые данные, дополняющие запросы LLM, хранятся в графе знаний. Это позволяет модели анализировать сущности и связи, а не просто фрагменты текста. В начале 2023 года исследователи начали публиковать статьи, посвященные взаимодополняемости графов знаний и LLM. В конце 2023 года Хуан Секеда, Дин Аллеманг и Брайон Джейкоб из data.world опубликовали статью, демонстрирующую, как графы знаний могут повысить точность и объяснимость LLM. В июле 2024 года Microsoft открыла исходный код своего фреймворка GraphRAG, что сделало поиск на основе графов доступным для более широкой аудитории разработчиков и закрепило GraphRAG как узнаваемую категорию в RAG.

Появление GraphRAG вновь оживило интерес к графам знаний, подобно тому, как Google запустил свой Knowledge Graph в 2012 году. Внезапный спрос на структурированный контекст и объяснимый поиск придал им новую актуальность.

В 2023–2025 годах рынок отреагировал быстро:

- 23 января 2023 г. — Digital Science приобрела Metaphacts , создателей платформы Metaphactory: «платформы, которая помогает клиентам ускорить внедрение графов знаний и способствует демократизации знаний».

- 7 февраля 2023 г. — Progress приобрела MarkLogic в феврале 2023 г. MarkLogic — это многомодальная база данных NoSQL, обладающая особыми возможностями управления данными RDF — основным форматом данных для графовых технологий.

- 18 июля 2024 г. — Samsung приобрела Oxford Semantic Technologies , создателя графовой базы данных RDFox, для реализации возможностей логического мышления и личных знаний на устройствах.

- 23 октября 2024 г. — Ontotext и Semantic Web Company объединились, образовав компанию Graphwise , которая позиционирует себя на основе GraphRAG. «Это объявление имеет важное значение для индустрии графов, поскольку оно выводит Graphwise на новый уровень как наиболее комплексную организацию в области графового ИИ и открывает чёткий путь к демократизации развития Graph RAG как категории».

- 7 мая 2025 г. — ServiceNow объявила о приобретении data.world , интегрировав графовый каталог данных и семантический уровень в свою корпоративную платформу рабочих процессов.

Это только события, связанные с графом знаний и связанными с ним семантическими технологиями. Если же расширить это понятие, включив в него управление метаданными и/или семантические слои в более широком смысле, то можно увидеть больше сделок, наиболее примечательной из которых является приобретение Salesforce лидера в области метаданных Informatica за 8 миллиардов долларов.

Эти шаги знаменуют собой явный сдвиг: графы знаний больше не просто инструменты управления метаданными — они стали семантической основой ИИ и приблизились к своему истокам — экспертным системам. GraphRAG вернул графам знаний их актуальность, предоставив им важнейшую роль в поиске, рассуждениях и объяснимости информации.

В своей основной работе в качестве руководителя по продукту в компании, занимающейся семантическими данными и ИИ, я работаю над устранением разрыва между данными и их фактическим значением для некоторых крупнейших мировых компаний. Подготовка данных для ИИ — это сочетание обеспечения их совместимости, доступности для обнаружения и использования, чтобы они могли предоставлять студентам магистратуры права (LLM) контекстно-релевантную информацию для получения безопасных и точных результатов. Это непростая задача для крупных, строго регулируемых и сложных предприятий, управляющих экспоненциальными объёмами данных.

Падение RAG и расцвет контекстной инженерии

RAG умер? Нет, но он эволюционировал. Первоначальная версия RAG полагалась на единый плотный векторный поиск и использовала лучшие результаты для прямой передачи в LLM. GraphRAG был построен на этой основе, добавив некоторые функции графовой аналитики и фильтры сущностей и/или отношений. Эти реализации практически сразу столкнулись с ограничениями, связанными с релевантностью, масштабируемостью и шумом. Эти ограничения подтолкнули RAG к новым этапам развития, известным под многими названиями: агентный поиск, RAG 2.0 и, совсем недавно, контекстная инженерия. Первоначальная, наивная реализация практически умерла, но её потомки процветают, и сам термин по-прежнему невероятно популярен.

После ажиотажа вокруг RAG в 2024 году неизбежно наступило разочарование. Хотя демонстрацию RAG можно создать за считанные минуты, и многие так и сделали, масштабирование приложения до уровня предприятия становится гораздо сложнее. «Люди думают, что RAG — это просто, потому что теперь можно очень быстро создать качественную демонстрацию RAG на основе одного документа, и она будет выглядеть довольно неплохо. Но заставить это работать в масштабе на реальных данных с корпоративными ограничениями — это совсем другая проблема», — сказал Дауве Киела из Contextual AI и один из авторов оригинальной статьи о RAG в Meta в 2020 году.

Одна из проблем масштабирования приложения RAG — это объём данных, необходимых для извлечения. «Думаю, проблема, с которой сталкиваются люди, — это масштабирование. Приложение отлично справляется со 100 документами, но теперь мне внезапно приходится переходить к 100 000 или 1 000 000 документов», — говорит Раджив Шах. Но по мере взросления LLM их контекстные окна росли. Размер контекстных окон был изначальной проблемой, для решения которой был создан RAG, что поднимало вопрос о том, нужен ли RAG и полезен ли он по-прежнему. Как отмечает доктор Себастьян Германн из Bloomberg: «Если я могу просто вставить больше документов или контекста, мне не нужно прибегать к таким уловкам для сужения контекстного окна. Я могу просто положиться на большую языковую модель. Однако здесь есть компромисс», — отмечает он, — «где более длинный контекст обычно обходится в значительное увеличение задержки и затрат».

Произвольное добавление дополнительной информации в контекстное окно сопряжено не только с увеличением стоимости и задержки, но и с ухудшением производительности. RAG может улучшить ответы LLM, при условии, что полученный контекст соответствует исходному запросу. Если контекст нерелевантен, результаты могут ухудшиться, что называется «контекстным отравлением» или «контекстным конфликтом», когда вводящая в заблуждение или противоречивая информация загрязняет процесс рассуждений. Даже если вы извлекаете релевантный контекст, вы можете перегрузить модель большим объемом, что приведет к «контекстной путанице» или «контекстному отвлечению». Хотя терминология различается, многочисленные исследования показывают, что точность модели имеет тенденцию снижаться после достижения определенного размера контекста. Это было обнаружено в статье Databricks еще в августе 2024 года и подтверждено недавним исследованием Chroma, которое они назвали «контекстной гнилью». В посте Дрю Брейнинга эти проблемы удачно классифицируются как отдельные «контекстные сбои».

Для решения проблемы перегрузки модели или предоставления неверной или нерелевантной информации всё большую популярность приобретают реранжировщики. Как отмечает Николаос Василоглу из RelationalAI, «реранжировщик — это то, как после сбора фактов вы решаете, что оставить, а что отбросить, [и это] имеет большое значение». Среди популярных реранжировщиков — Cohere Rerank, Voyage AI Rerank, Jina Reranker и BGE Reranker. В современном мире агентов простого реранжирования недостаточно. RAG нового поколения встроен в агенты — это всё чаще называют контекстной инженерией.

Что такое контекстная инженерия?

«Искусство и наука заполнения контекстного окна только нужной информацией на каждом этапе траектории агента». Лэнс Мартин из LangChain.

Я хочу сосредоточиться на разработке контекста по двум причинам: создатели терминов RAG 2.0 и Agentic Retrieval (Contextual AI и LlamaIndex соответственно) начали использовать этот термин; и, судя по тенденциям поиска в Google, он стал гораздо более популярным. Разработка контекста также может рассматриваться как эволюция разработки подсказок. Разработка подсказок заключается в создании подсказки таким образом, чтобы она давала вам желаемые результаты, а разработка контекста — в дополнении этой подсказки соответствующим контекстом.

RAG приобрел известность в 2023 году, много веков назад по меркам ИИ. С тех пор всё стало «агентным». RAG был создан с предположением, что подсказки будут генерироваться человеком, а ответы будут читаться человеком. В случае с агентами нам нужно переосмыслить, как это работает. Лэнс Мартин разделяет контекстную инженерию на четыре категории: запись, сжатие, изоляция и выбор . Агентам необходимо записывать (или сохранять, или запоминать) информацию от задачи к задаче, как и людям. У агентов часто бывает слишком много контекста при переходе от задачи к задаче, и им нужно каким-то образом сжимать или сжимать его, обычно с помощью резюмирования или «отсечения». Вместо того, чтобы передавать весь контекст модели, мы можем изолировать его или разделить между агентами, чтобы они могли, как это описывает Anthropic, «исследовать разные части проблемы одновременно». Идея заключается в том, чтобы не давать LLM достаточно верёвки, чтобы он мог сам себя повесить, чтобы избежать риска испортить контекст и получить ухудшенные результаты.

Агентам приходится использовать свою память при необходимости или обращаться к инструментам для извлечения дополнительной информации, то есть им нужно выбрать (извлечь) контекст для использования. Одним из таких инструментов может быть поиск на основе векторов, то есть традиционный RAG. Но это лишь один инструмент в арсенале агента. Как выразился Марк Брукер из AWS: «Я ожидаю, что некоторые яркие новинки, связанные с векторной графикой, постепенно успокоятся, и мы перейдём к миру, где в нашем арсенале будет этот новый инструмент, но многие создаваемые нами агенты используют реляционные интерфейсы. Они используют интерфейсы документов. Они используют поиск по первичному ключу, поиск по вторичному индексу. Они используют поиск по географическому признаку. Все эти вещи, которые существовали в сфере баз данных десятилетиями, теперь у нас есть ещё и этот, своего рода поиск по семантическому значению, что очень интересно, ново и мощно».

Те, кто находится в авангарде, уже этим занимаются. Мартин цитирует Варуна Мохана из Windsurf, который говорит: «Мы […] полагаемся на комбинацию таких методов, как grep/поиск файлов, поиск на основе графов знаний и… этап повторного ранжирования, на котором [контекст] ранжируется в порядке релевантности».

Возможно, наивный RAG уже не актуален, и мы всё ещё пытаемся определить, как назвать современные реализации, но одно очевидно: будущее поиска данных велико. Как гарантировать, что агенты смогут извлекать различные наборы данных в масштабах предприятия? От реляционных данных до документов? Всё чаще ответом становится семантический уровень.

Контекстная инженерия нуждается в семантическом уровне

Что такое семантический слой?

Семантический слой — это способ присоединения метаданных ко всем данным в форме, удобной как для чтения человеком, так и для машины, чтобы люди и компьютеры могли единообразно понимать, извлекать и рассуждать на их основе.

В последнее время специалисты по реляционным данным стремятся создать семантический слой над реляционными данными. Компания Snowflake даже выступила с инициативой открытого семантического обмена (OSI), чтобы попытаться стандартизировать способы документирования компаниями своих данных для подготовки их к использованию ИИ.

Но сосредоточение исключительно на реляционных данных — это узкий взгляд на семантику. А как насчёт неструктурированных и полуструктурированных данных? Именно с такими данными отлично справляются большие языковые модели, и именно с них началась вся эта лихорадка вокруг RAG. Эх, если бы только существовал прецедент получения релевантных результатов поиска по огромному объёму неструктурированных данных!

Google уже несколько десятилетий ищет релевантную информацию по всему интернету, используя структурированные данные. Под структурированными данными я подразумеваю машиночитаемые метаданные, или, как их описывает Google, «стандартизированный формат предоставления информации о странице и классификации её содержимого». Библиотекари, специалисты по информации и специалисты по поисковой оптимизации (SEO) решают проблему поиска неструктурированных данных, используя организацию знаний, поиск информации, структурированные метаданные и технологии семантической паутины. Их методы описания, связывания и управления неструктурированными данными лежат в основе современных систем поиска и обнаружения информации, как государственных, так и корпоративных. Будущее семантического уровня соединит миры реляционных и структурированных данных, сочетая строгость управления реляционными данными с контекстным богатством библиотечного дела и графов знаний.

Будущее RAG

Вот мои прогнозы относительно будущего RAG.

RAG продолжит развиваться в сторону более агентных шаблонов. Это означает, что извлечение контекста — лишь часть цикла рассуждений, который также включает запись, сжатие и изоляцию контекста. Извлечение становится итеративным процессом, а не одноразовым. Протокол контекста модели (MCP) Anthropic рассматривает извлечение как инструмент, который может быть предоставлен агенту через MCP. OpenAI предлагает поиск файлов как инструмент, который могут вызывать агенты. Фреймворк агентов LangChain LangGraph позволяет создавать агентов, используя шаблон узлов и ребер (например, граф). В их кратком руководстве здесь вы можете увидеть, что извлечение (в данном случае веб-поиск) — лишь один из инструментов, который может быть предоставлен агенту для выполнения его работы. Здесь они перечисляют извлечение как одно из действий, которые может выполнять агент или рабочий процесс. В Wikidata также есть MCP, который позволяет пользователям напрямую взаимодействовать с общедоступными данными.

Поиск расширится и включит все виды данных (мультимодальный поиск): реляционные, контент, а также изображения, аудио, геоданные и видео. LlamaIndex предлагает четыре «режима поиска»: фрагменты, файлы_через_метаданные, файлы_через_контент, файлы_через_контент, автомаршрутизация. Также доступен составной поиск, позволяющий извлекать данные из нескольких источников одновременно. Snowflake предлагает Cortex Search для контента и Cortex Analyst для реляционных данных. LangChain предлагает инструменты для поиска реляционных данных, графовых данных (Neo4j), лексических и векторных данных.

Извлечение данных будет расширено и будет включать метаданные о самих инструментах, а также «памяти». MCP от Anthropic стандартизировал способ вызова инструментов агентами, используя реестр инструментов, т.е. метаданные инструментов. OpenAI, LangChain, LlamaIndex, AWS Bedrock, Azure, Snowflake и Databricks — все они обладают возможностями управления инструментами, некоторые напрямую через MCP, другие — через собственные реестры. Что касается памяти, LlamaIndex и LangChain рассматривают память как извлекаемые данные (краткосрочные и долгосрочные), к которым агенты могут обращаться в ходе рабочих процессов. Такие проекты, как Cognee, развивают эту тенденцию, предлагая выделенную агентскую память с возможностью запросов.

Графы знаний будут играть ключевую роль в качестве слоя метаданных между реляционными и неструктурированными данными, заменив узкое определение семантического слоя, которое в настоящее время используется, более надежной структурой управления метаданными. Консолидация рынка, которую мы наблюдали за последние пару лет и описанная выше, я считаю, является показателем растущего признания рынка того, что графы знаний и управление метаданными будут иметь решающее значение, поскольку агентам предлагается выполнять более сложные задачи с корпоративными данными. Отчет Gartner за май 2025 года «Разверните свою дисциплину разработки данных для эффективной поддержки вариантов использования ИИ» рекомендует группам разработки данных внедрять семантические методы (такие как онтологии и графы знаний) для поддержки вариантов использования ИИ. Графы знаний, управление метаданными и управление справочными данными уже повсеместно используются в крупных компаниях в области наук о жизни и финансовых услуг, в основном потому, что они строго регламентированы и требуют основанных на фактах, обоснованных данных для поддержки своих инициатив в области ИИ. Другие отрасли начнут перенимать проверенные и надежные методы семантической технологии, поскольку их сценарии использования станут более зрелыми и потребуют объяснимых ответов.

Метрики оценки поиска контекста будут набирать популярность. Ragas, Databricks Mosaic AI Agent Evaluation и TruLens предоставляют фреймворки для оценки RAG. Компания Envy предлагает библиотеки с открытым исходным кодом и обучающие материалы по оценке RAG. Продукт оценки LangSmith от LangChain содержит модуль, ориентированный на RAG. Важно то, что эти фреймворки оценивают не только точность ответа на заданную подсказку, но и релевантность и обоснованность контекста (насколько хорошо ответ подкреплен контекстом). Некоторые поставщики разрабатывают метрики для оценки происхождения (цитирования и источников) извлеченного контекста, охвата (достаточно ли было извлечено данных?) и актуальности или новизны.

Защитные барьеры «политика как код» гарантируют, что извлечение данных будет осуществляться с учётом контроля доступа, политик, правил и передовых практик. Snowflake и Databricks уже поддерживают контроль доступа на уровне строк и маскирование столбцов. Такие механизмы политик, как Open Policy Agent (OPA) и Oso, встраивают контроль доступа в агентские рабочие процессы. Как обнаружил д-р Себастьян Германн из Bloomberg, «RAG не обязательно безопаснее» и может привести к новым рискам управления. Я ожидаю, что потребность в защитных барьерах будет расти и включать в себя более сложные правила управления (выходящие за рамки контроля доступа), требования политик и передовые практики.

Заключение

RAG никогда не был конечной целью, а лишь отправной точкой. По мере того, как мы вступаем в эпоху агентов, поиск информации превращается в часть полноценной дисциплины: контекстной инженерии. Агентам нужно не просто находить документы; им нужно понимать, какие данные, инструменты и воспоминания релевантны на каждом этапе их рассуждений. Это понимание требует семантического уровня – способа понимания, поиска и управления всей организацией. Графы знаний, онтологии и семантические модели обеспечат эту связующую ткань. Следующее поколение поиска будет ориентировано не только на скорость и точность, но и на объяснимость и доверие. Будущее RAG – это не просто поиск, а поиск, учитывающий контекст, учитывающий политики и семантически обоснованный.

Об авторе: Стив Хедден — руководитель отдела управления продуктами в TopQuadrant, где он отвечает за стратегию TopBraid EDG, платформы для управления графами знаний и метаданными. Его работа сосредоточена на объединении управления корпоративными данными и искусственного интеллекта посредством онтологий, таксономий и семантических технологий. Стив регулярно пишет и выступает с докладами о графах знаний и меняющейся роли семантики в системах искусственного интеллекта.

Источник: towardsdatascience.com