Начните задавать себе вопрос, на какой вопрос должно ответить объяснение.

Делиться

Большинство дискуссий об интерпретируемости в ИИ начинаются с неправильного вопроса. Исследователи, практики и даже регулирующие органы часто спрашивают, является ли модель интерпретируемой. Но такая формулировка предполагает, что интерпретируемость — это свойство, которым модель либо обладает, либо не обладает. Это не так.

В абстрактном смысле модель не является ни интерпретируемой, ни неинтерпретируемой. Здесь мы говорим не о моделях, по своей сути прозрачных, таких как линейная регрессия или деревья решений, логику которых можно изучить напрямую. Вместо этого нас интересуют сложные модели, процессы принятия решений в которых не всегда доступны для непосредственного анализа.

Таким образом, интерпретируемость — это не галочка, не визуализация и не конкретный алгоритм. Лучше понимать её как набор методов, позволяющих людям анализировать модели для ответа на конкретные вопросы. Измените вопрос, и полезность объяснения изменится. Следовательно, реальная проблема заключается не в том, является ли модель интерпретируемой, а в том, для чего нам нужно объяснение.

Когда мы рассматриваем интерпретируемость таким образом, вырисовывается более четкая структура. На практике объяснения неизменно выполняют три различные научные функции: диагностику ошибок, подтверждение полученных знаний и извлечение знаний. Эти роли концептуально различны, даже если они основаны на схожих методах. Понимание этого различия помогает прояснить как случаи, когда необходима интерпретируемость, так и то, какое именно объяснение нам нужно.

Интерпретируемость как диагностический признак

Первая роль интерпретируемости проявляется на этапе разработки модели, когда модели еще являются экспериментальными объектами. На этом этапе они нестабильны, несовершенны и часто ошибаются способами, которые не могут быть выявлены с помощью агрегированных метрик. Точность показывает, удалась ли модель, но не объясняет, почему она потерпела неудачу. Две модели могут демонстрировать одинаковую производительность, опираясь на совершенно разные правила принятия решений. Одна может изучать реальную структуру; другая может использовать случайные корреляции.

Методы интерпретируемости позволяют заглянуть внутрь процесса принятия решений моделью и выявить скрытые режимы сбоев. В этом смысле они играют роль, аналогичную инструментам отладки в разработке программного обеспечения. Без них улучшение модели в значительной степени сводится к предположениям. С их помощью мы можем сформулировать проверяемые гипотезы о том, что на самом деле делает модель.

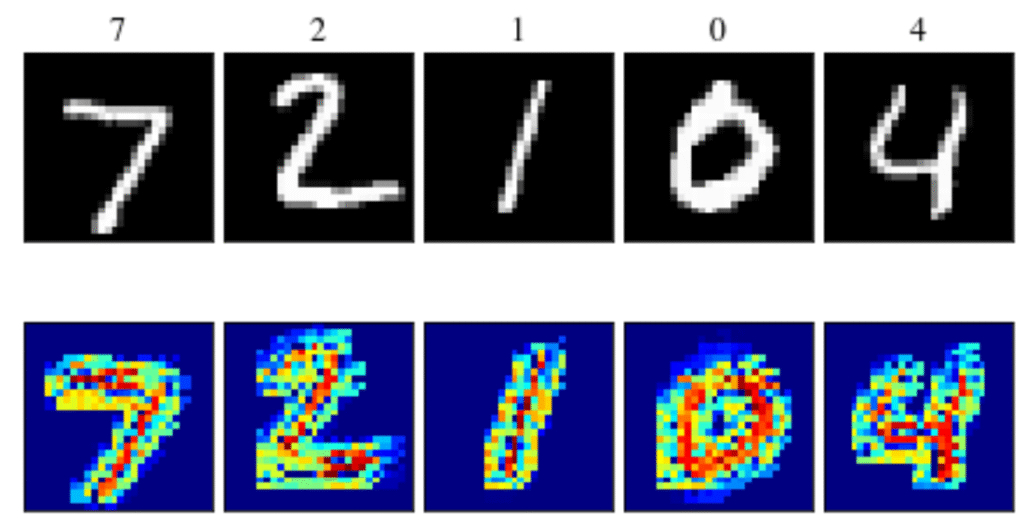

Простая иллюстрация приведена на примере классификации рукописных цифр. Набор данных MNIST намеренно упрощен, что делает его идеальным для проверки соответствия рассуждений модели нашим ожиданиям.

Визуализируя, какие пиксели повлияли на предсказание, мы сразу видим, фокусируется ли сеть на штрихах цифр или на нерелевантных областях фона. Разница показывает, усвоила ли модель значимый сигнал или же использовала упрощенный подход. В этой диагностической роли объяснения предназначены не для конечных пользователей или заинтересованных сторон, а являются инструментами для разработчиков, стремящихся понять поведение модели.

Интерпретируемость как валидация

Когда модель показывает хорошие результаты, вопрос меняется. Нас больше не интересует, почему она терпит неудачу. Вместо этого мы хотим знать, добивается ли она успеха по правильным причинам.

Это различие тонкое, но крайне важное. Система может достичь высокой точности и при этом вводить в заблуждение с научной точки зрения, если она опирается на ложные корреляции. Например, классификатор, обученный обнаруживать животных, может казаться идеально работающим, в то время как на самом деле он полагается на фоновые сигналы, а не на самих животных. С точки зрения прогнозирования, такая модель выглядит успешной. С научной точки зрения, она усвоила неверную концепцию.

Интерпретируемость позволяет нам исследовать внутренние представления и проверять, соответствуют ли они ожиданиям предметной области. В глубоких нейронных сетях промежуточные слои кодируют изученные признаки, и анализ этих представлений может показать, обнаружила ли система осмысленную структуру или просто запомнила поверхностные закономерности.

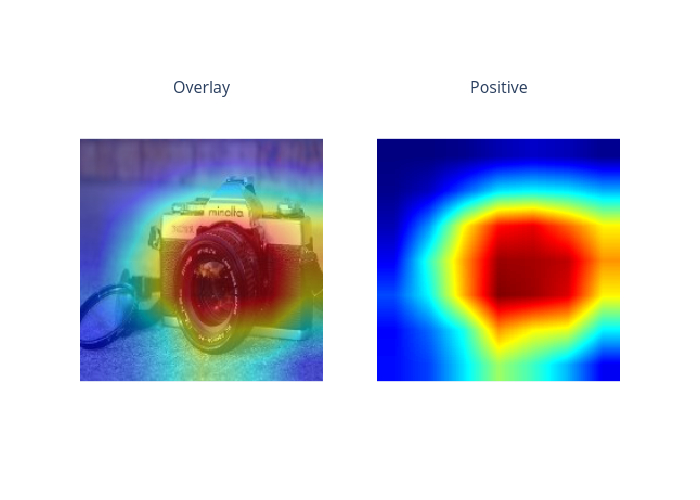

Это особенно актуально для крупномасштабных наборов данных естественных изображений, таких как ImageNet, где сцены содержат значительные вариации в ракурсе, фоне и внешнем виде объектов.

Поскольку изображения ImageNet содержат загроможденные сцены, разнообразные контексты и высокую внутриклассовую изменчивость, успешные модели должны обучаться иерархическим представлениям, а не полагаться на поверхностные визуальные подсказки. Визуализируя внутренние фильтры или карты активации, мы можем проверить, обнаруживают ли ранние слои края, средние слои захватывают текстуры, а более глубокие слои реагируют на формы. Наличие этой структуры предполагает, что сеть усвоила что-то значимое о данных. Ее отсутствие говорит о том, что показатели производительности могут скрывать концептуальные недостатки.

Во второй роли интерпретируемость заключается не в отладке неисправной модели, а в проверке работоспособности успешной модели.

Интерпретируемость как знание

Третья роль проявляется, когда модели применяются в областях, где одного прогнозирования недостаточно. В таких контекстах системы машинного обучения используются не только для получения результатов, но и для генерации идей. Здесь интерпретируемость становится инструментом для открытий.

Современные модели способны выявлять статистические закономерности в массивах данных, намного превышающих по объему возможности ручного анализа для человека. Анализ их логики позволяет обнаружить закономерности, которые могут подсказать новые гипотезы или выявить ранее незамеченные взаимосвязи. В научных приложениях эта возможность зачастую ценнее самой точности прогнозирования.

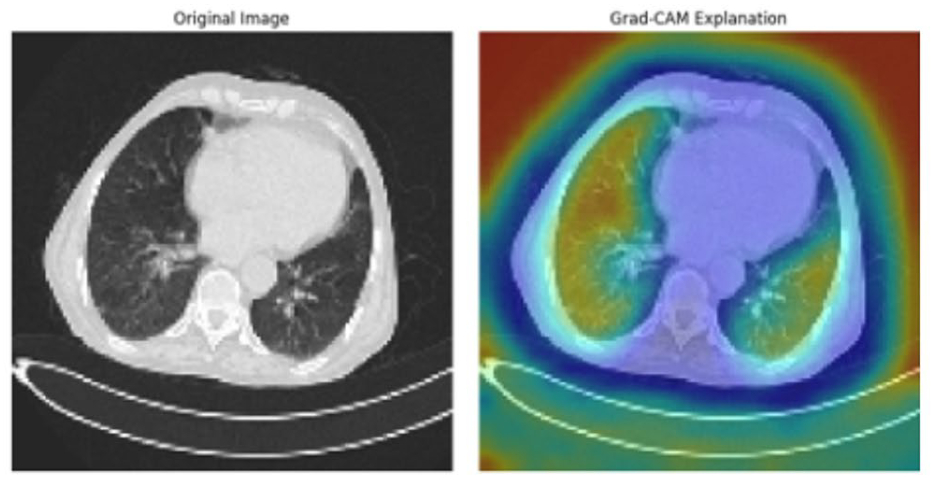

Медицинская визуализация — наглядный пример. Рассмотрим нейронную сеть, обученную обнаруживать рак легких по данным компьютерной томографии.

Если такая модель предсказывает злокачественность, врачам необходимо понимать, какие области повлияли на это решение. Если выделенные области соответствуют границе опухоли, объяснение согласуется с медицинскими рассуждениями. Если нет, прогнозу нельзя доверять, независимо от его точности. Но есть и третья возможность: объяснения могут выявить тонкие структуры, которые врачи ранее не считали диагностически значимыми. В таких случаях интерпретируемость не только оправдывает прогноз, но и способствует расширению знаний.

Здесь объяснения — это не просто инструменты для понимания моделей. Это инструменты для расширения человеческого понимания.

Одна концепция, три функции

Эти примеры показывают, что интерпретируемость — это не отдельная цель, а многофункциональная структура. Один и тот же метод может помочь в отладке модели, проверке её логики или извлечении полезной информации в зависимости от поставленного вопроса. Путаница в отношении интерпретируемости часто возникает из-за того, что в дискуссиях не проводится различие между этими целями.

Более важный вопрос заключается не в том, является ли модель интерпретируемой, а в том, достаточно ли она интерпретируема для решения интересующей нас задачи. Это требование всегда зависит от контекста: разработка, исследование или внедрение.

В этом контексте интерпретируемость лучше всего понимать не как ограничение машинного обучения, а как интерфейс между человеком и моделями. Именно она позволяет нам диагностировать, проверять и учиться. Без неё прогнозы остаются непрозрачными результатами. С ней они становятся объектами научного анализа.

Поэтому вместо вопроса о том, является ли модель интерпретируемой, нам следует задать более точный вопрос:

Что именно мы хотим, чтобы это объяснение объяснило?

Как только этот вопрос проясняется, интерпретируемость перестает быть расплывчатым требованием и становится научным инструментом.

Надеюсь, вам понравилось! Если у вас возникнут вопросы, вы захотите поделиться отзывами или просто показать свои проекты, обращайтесь ко мне.

Мануэль Франко де ла Пенья Посмотреть все работы Мануэля Франко де ла Пенья

Источник: towardsdatascience.com