Мы представляем вложенное обучение (Nested Learning) — новый подход к машинному обучению, который рассматривает модели как набор более мелких, вложенных задач оптимизации, каждая со своим собственным внутренним рабочим процессом, чтобы смягчить или даже полностью избежать проблемы «катастрофического забывания», когда обучение новым задачам приводит к снижению эффективности в решении старых задач.

Быстрые ссылки

- Бумага

- Делиться

За последнее десятилетие в области машинного обучения (МО) достигнут невероятный прогресс, в первую очередь благодаря мощным архитектурам нейронных сетей и алгоритмам, используемым для их обучения. Однако, несмотря на успех больших языковых моделей (БЛМ), сохраняется ряд фундаментальных проблем, особенно в отношении непрерывного обучения — способности модели активно приобретать новые знания и навыки с течением времени, не забывая при этом старые.

Когда речь идёт о непрерывном обучении и самосовершенствовании, человеческий мозг является золотым стандартом. Он адаптируется благодаря нейропластичности — замечательной способности изменять свою структуру в ответ на новый опыт, воспоминания и обучение. Без этой способности человек ограничен непосредственным контекстом (подобно антероградной амнезии). Мы видим аналогичное ограничение в современных моделях обучения с использованием линейных моделей: их знания ограничены либо непосредственным контекстом входного окна, либо статической информацией, которую они усваивают во время предварительного обучения.

Простой подход, заключающийся в постоянном обновлении параметров модели новыми данными, часто приводит к «катастрофическому забыванию» (КЗ), когда обучение новым задачам приводит к снижению эффективности в решении старых задач. Традиционно исследователи борются с КЗ с помощью архитектурных изменений или более эффективных правил оптимизации. Однако слишком долго мы рассматривали архитектуру модели (структуру сети) и алгоритм оптимизации (правило обучения) как две отдельные вещи, что мешает нам создать действительно единую и эффективную систему обучения.

В нашей статье «Вложенное обучение: иллюзия архитектур глубокого обучения», опубликованной на конференции NeurIPS 2025, мы представляем вложенное обучение, которое заполняет этот пробел. Вложенное обучение рассматривает одну модель машинного обучения не как непрерывный процесс, а как систему взаимосвязанных многоуровневых задач обучения, которые оптимизируются одновременно. Мы утверждаем, что архитектура модели и правила, используемые для ее обучения (т. е. алгоритм оптимизации), по сути, являются одними и теми же понятиями; это просто разные «уровни» оптимизации, каждый со своим внутренним потоком информации («потоком контекста») и скоростью обновления. Признавая эту внутреннюю структуру, вложенное обучение предоставляет новое, ранее невидимое измерение для проектирования более эффективного ИИ, позволяя нам создавать компоненты обучения с большей вычислительной глубиной, что в конечном итоге помогает решить такие проблемы, как катастрофическое забывание.

Мы тестируем и подтверждаем эффективность вложенного обучения с помощью экспериментальной самомодифицирующейся архитектуры, которую мы называем «Надежда». Она демонстрирует превосходные результаты в моделировании языка и более эффективное управление памятью для долговременного контекста, чем существующие передовые модели.

Парадигма вложенного обучения

Вложенное обучение показывает, что сложная модель машинного обучения на самом деле представляет собой набор согласованных, взаимосвязанных задач оптимизации, вложенных друг в друга или выполняемых параллельно. Каждая из этих внутренних задач имеет свой собственный контекст — свой собственный набор информации, на основе которой она пытается учиться.

Эта точка зрения подразумевает, что существующие методы глубокого обучения работают, по сути, за счет сжатия внутренних контекстных потоков. Что еще более важно, вложенное обучение открывает новое измерение в проектировании моделей, позволяя нам создавать компоненты обучения с большей вычислительной глубиной.

Для иллюстрации этой парадигмы рассмотрим концепцию ассоциативной памяти — способности сопоставлять и воспроизводить одну вещь на основе другой (например, вспоминать имя, увидев лицо).

- Мы показываем, что сам процесс обучения, а именно процесс обратного распространения ошибки, может быть смоделирован как ассоциативная память. Модель учится сопоставлять заданную точку данных со значением ее локальной ошибки, которая служит мерой того, насколько «неожиданной» или неожиданной была эта точка данных.

- Аналогичным образом, следуя предыдущим исследованиям (например, Мираса), ключевые архитектурные компоненты, такие как механизм внимания в трансформерах, также могут быть формализованы как простые модули ассоциативной памяти, которые обучаются отображению между токенами в последовательности.

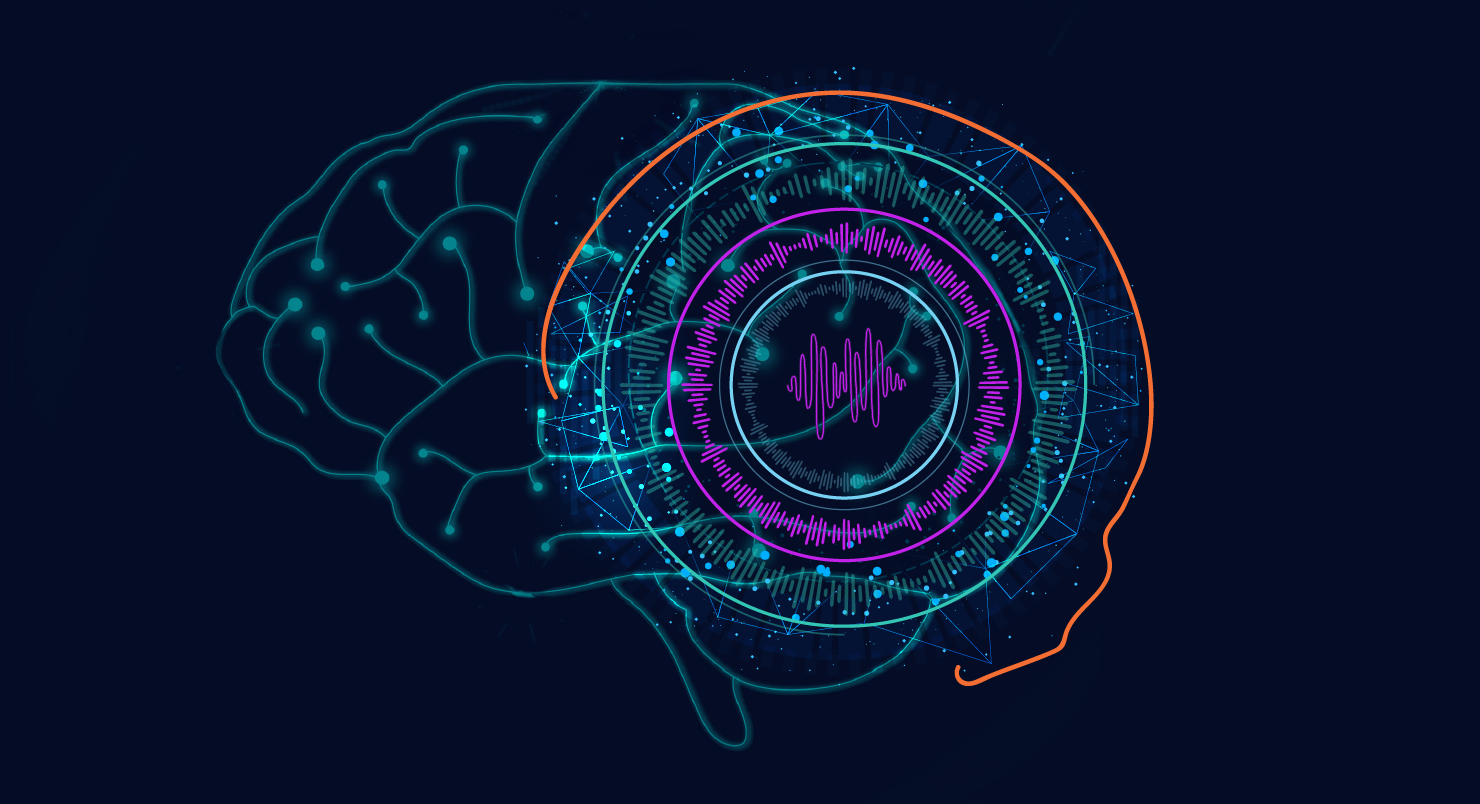

Однородная и многократно используемая структура, а также обновление в разных временных масштабах в головном мозге являются ключевыми компонентами непрерывного обучения у человека. Вложенное обучение позволяет осуществлять обновления в разных временных масштабах для каждого компонента головного мозга, демонстрируя при этом, что хорошо известные архитектуры, такие как трансформеры и модули памяти, на самом деле представляют собой линейные слои с обновлениями различной частоты.

Определив частоту обновления, то есть, как часто корректируются веса каждого компонента, мы можем упорядочить эти взаимосвязанные задачи оптимизации по «уровням». Этот упорядоченный набор составляет основу парадигмы вложенного обучения.

Применение вложенного обучения на практике

Перспектива вложенного обучения сразу же предоставляет нам принципиальные способы улучшения существующих алгоритмов и архитектур:

Глубокие оптимизаторы

Поскольку вложенное обучение рассматривает оптимизаторы (например, оптимизаторы на основе момента) как модули ассоциативной памяти, это позволяет нам применять к ним принципы ассоциативной памяти. Мы заметили, что многие стандартные оптимизаторы полагаются на простое скалярное произведение (мера сходства двух векторов путем вычисления суммы произведений их соответствующих компонентов), обновление которого не учитывает взаимосвязь различных выборок данных. Изменив базовую целевую функцию оптимизатора на более стандартную метрику потерь, такую как потери L2-регрессии (распространенная функция потерь в задачах регрессии, которая количественно оценивает ошибку путем суммирования квадратов разностей между прогнозируемыми и истинными значениями), мы выводим новые формулировки для основных концепций, таких как момент, делая их более устойчивыми к несовершенным данным.

Системы непрерывной памяти

В стандартном трансформере модель последовательности действует как кратковременная память, храня непосредственный контекст, в то время как нейронные сети прямого распространения действуют как долговременная память, храня знания, полученные до обучения. Парадигма вложенного обучения расширяет эту концепцию до того, что мы называем «системой непрерывной памяти» (CMS), где память рассматривается как спектр модулей, каждый из которых обновляется с разной, специфической частотой. Это создает гораздо более богатую и эффективную систему памяти для непрерывного обучения.

Надежда: Самоизменяющаяся архитектура с непрерывной памятью

В качестве подтверждения концепции мы использовали принципы вложенного обучения для разработки Hope, варианта архитектуры Titans. Архитектуры Titans представляют собой модули долговременной памяти, которые отдают приоритет воспоминаниям в зависимости от их неожиданности. Несмотря на мощное управление памятью, они имеют только два уровня обновления параметров, что приводит к обучению первого порядка в контексте. Hope же — это самомодифицирующаяся рекуррентная архитектура, которая может использовать неограниченное количество уровней обучения в контексте, а также дополнена блоками CMS для масштабирования до больших контекстных окон. По сути, она может оптимизировать свою собственную память посредством самореферентного процесса, создавая архитектуру с бесконечными, зацикленными уровнями обучения.

Эксперименты

Мы провели эксперименты для оценки эффективности наших глубоких оптимизаторов и производительности Hope в задачах языкового моделирования, рассуждений в длинном контексте, непрерывного обучения и включения знаний. Полные результаты доступны в нашей статье.

Результаты

Наши эксперименты подтверждают эффективность вложенного обучения, проектирования систем непрерывной памяти и самомодифицирующихся титанов.

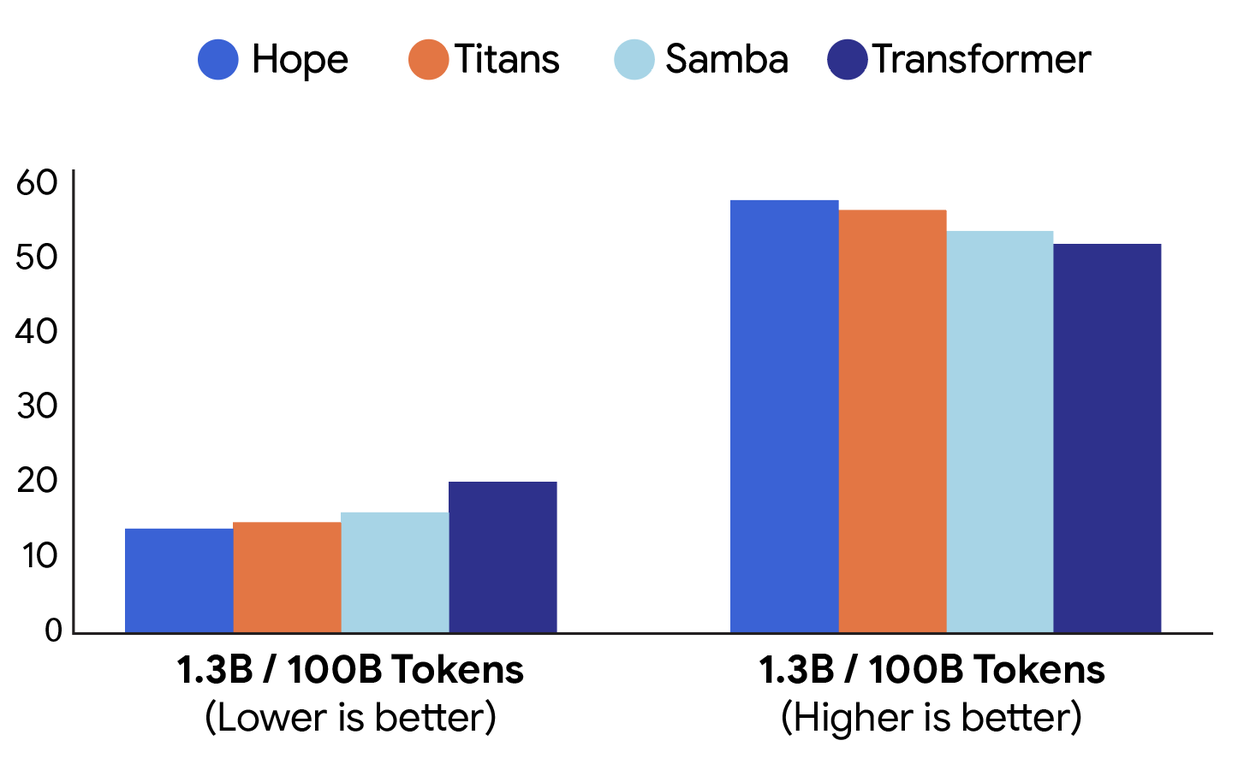

В разнообразных задачах моделирования языка и рассуждений на основе здравого смысла, широко используемых в публичных системах, архитектура Hope демонстрирует более низкую перплексию и более высокую точность по сравнению с современными рекуррентными моделями и стандартными трансформерами.

Сравнение производительности в задачах языкового моделирования (перплексия; слева) и рассуждений на основе здравого смысла (точность; справа) между различными архитектурами: Hope, Titans, Samba и базовой Transformer.

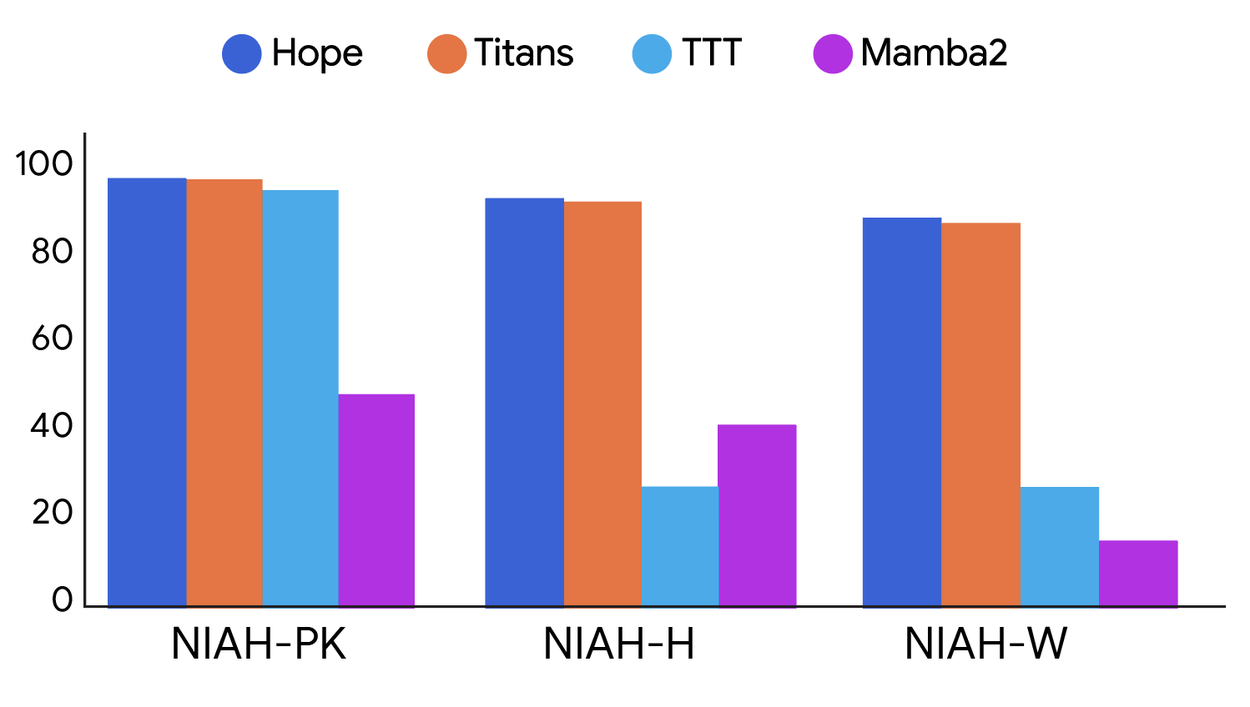

Hope демонстрирует превосходное управление памятью в задачах поиска иголки в стоге сена (NIAH) с длинным контекстом, доказывая, что системы управления памятью предлагают более эффективный способ обработки длинных последовательностей информации.

Сравнение производительности в задачах с длинным контекстом и различным уровнем сложности на разных архитектурах: Hope, Titans, TTT и Mamba2. NIAH-PK, NIAH-H и NIAH-W — это задачи типа «иголка в стоге сена», включающие пароль, число и слово соответственно.

Заключение

Парадигма вложенного обучения представляет собой шаг вперед в нашем понимании глубокого обучения. Рассматривая архитектуру и оптимизацию как единую, согласованную систему вложенных задач оптимизации, мы открываем новое измерение в проектировании, объединяя несколько уровней. Полученные модели, такие как архитектура Хоупа, показывают, что принципиальный подход к объединению этих элементов может привести к созданию более выразительных, мощных и эффективных алгоритмов обучения.

Мы считаем, что парадигма вложенного обучения предлагает надежную основу для преодоления разрыва между ограниченной способностью к забыванию, присущей современным моделям обучения с непрерывным обучением, и замечательными способностями человеческого мозга к непрерывному обучению. Мы рады, что исследовательское сообщество изучит это новое измерение и поможет нам создать следующее поколение самосовершенствующегося ИИ.

Благодарности

Данное исследование было проведено Али Бехрузом, Мейсамом Разавияйном, Пейлином Чжуном и Вахабом Миррокни. Мы благодарим Пранита Качама и Коринну Кортес за рецензирование работы и ценные предложения. Мы также благодарим Юань Дэна и Земана Ли. Наконец, мы благодарим Марка Симборга и Кимберли Шведе за помощь в подготовке этой статьи.

Источник: research.google