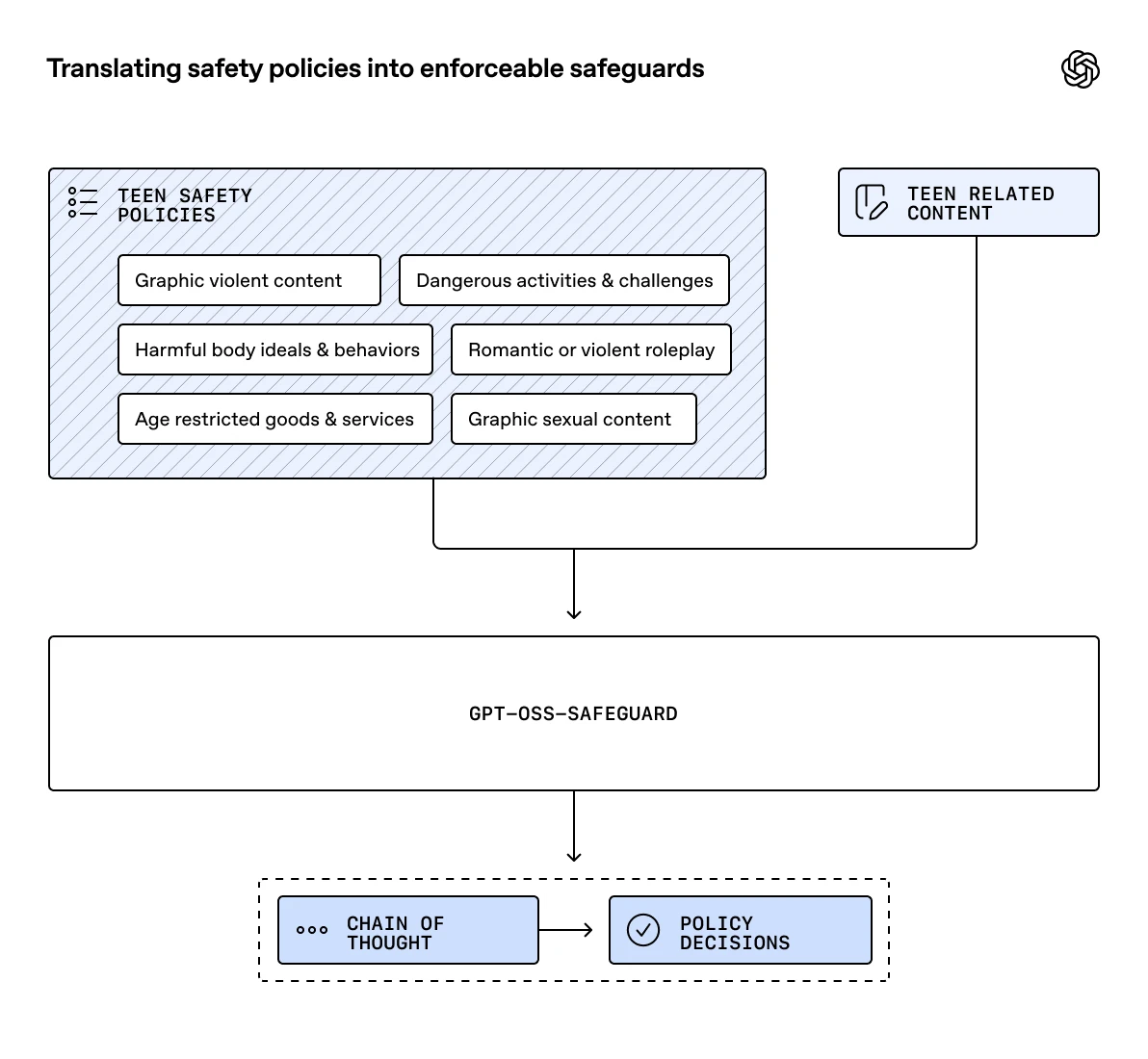

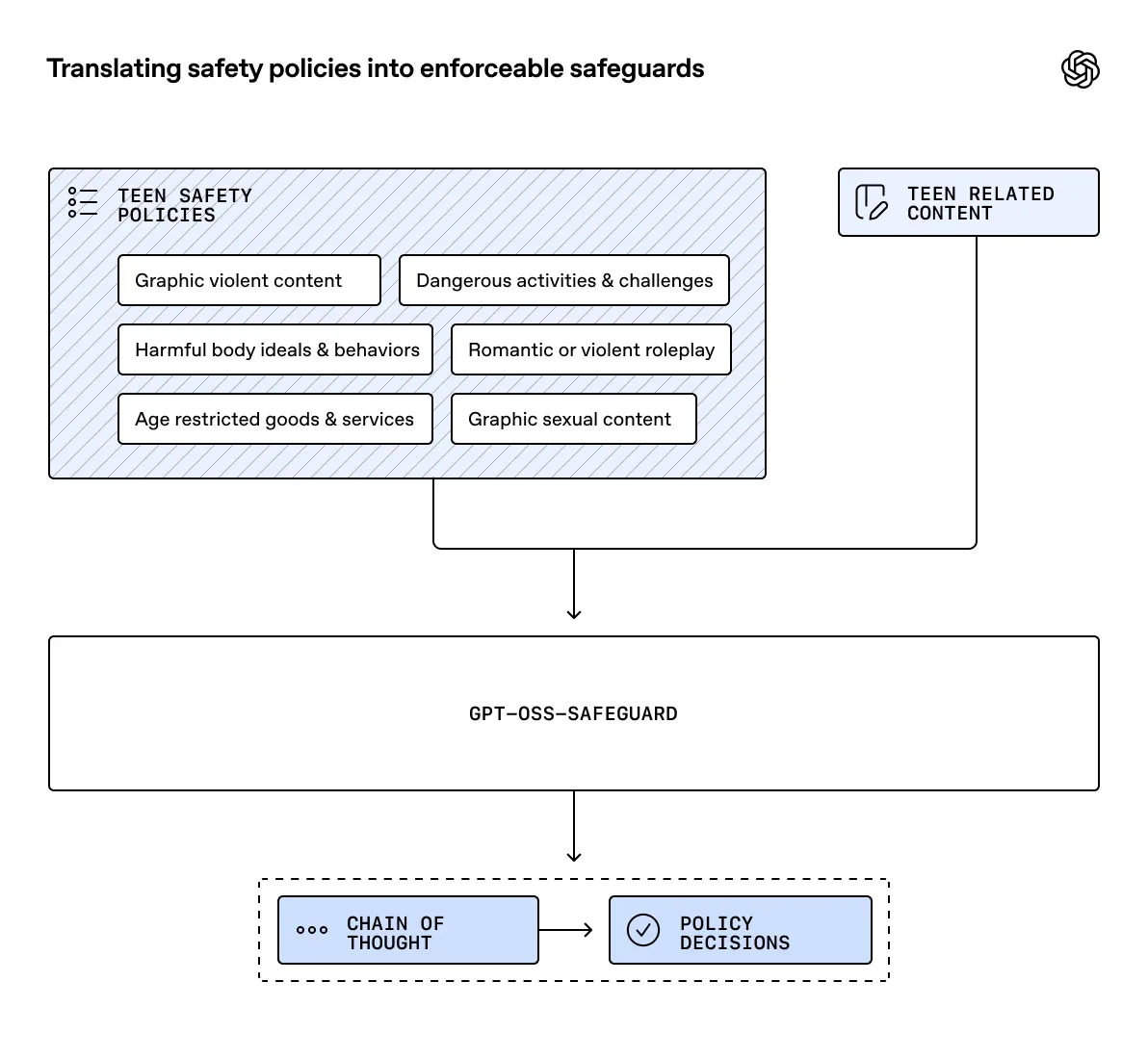

Представляем набор правил безопасности для подростков, оформленных в виде подсказок для gpt-oss-safeguard.

Сегодня мы выпускаем политики безопасности на основе подсказок (открывается в новом окне) , которые помогут разработчикам создавать средства защиты, соответствующие возрасту подростков. Эти политики, разработанные для работы с нашей открытой моделью безопасности gpt-oss-safeguard (открывается в новом окне) , упрощают процесс преобразования требований безопасности в пригодные для использования классификаторы для реальных систем.

Мы выпустили открытые модели весов, чтобы демократизировать доступ к мощному ИИ и поддержать широкие инновации. В то же время мы считаем, что безопасность и инновации идут рука об руку, и что разработчики должны иметь доступ к функциональным моделям, а также к инструментам и политикам для их безопасного и ответственного развертывания. Мы разработали эти политики, чтобы поддержать разработчиков в их усилиях по обеспечению безопасности юных пользователей, с учетом мнения авторитетных внешних организаций, включая Common Sense Media (открывается в новом окне) и everyone.ai (открывается в новом окне) .

Мы понимаем, что у подростков и взрослых разные потребности, и что подросткам необходима дополнительная защита. Эти правила призваны помочь разработчикам учитывать эти различия и создавать возможности, которые будут одновременно расширять возможности и соответствовать потребностям более молодых пользователей.

Развивая нашу более широкую работу по защите молодежи.

Мы давно стремимся создавать ИИ, который расширяет возможности для молодежи, обеспечивая при этом ее безопасность. В рамках этой работы мы обновили наши спецификации моделей (Model Spec) — руководящие принципы, определяющие предполагаемое поведение моделей OpenAI, — включив в них принципы для лиц младше 18 лет (U18) (Under-18) (Open-AI) , а также внедрили меры защиты на уровне продукта, такие как родительский контроль и прогнозирование возраста , чтобы лучше защитить молодых пользователей. Мы также призвали к внедрению общеотраслевых мер защиты в рамках нашего плана действий по обеспечению безопасности подростков (Teen Safety Blueprint ) .

Сегодняшний релиз развивает эту идею. Мы предоставляем разработчикам доступ к этим политикам безопасности, чтобы помочь им внедрять средства защиты для подростков и способствовать демократизации доступа к открытому сообществу пользователей силовых тренажеров.

Преобразование вопросов безопасности подростков в четкие и применимые на практике правила.

Хотя такие классификаторы безопасности, как gpt-oss-safeguard, могут обнаруживать вредоносный контент, их работа зависит от четкого определения того, что этот контент собой представляет. На практике одна из самых больших проблем, с которыми сталкиваются разработчики, — это определение политик, которые точно отражают риски, специфичные для подростков, и могут последовательно применяться в реальных системах.

Даже опытные команды часто испытывают трудности с преобразованием общих целей безопасности в точные, оперативные правила, особенно учитывая, что это требует как экспертных знаний в предметной области, так и глубоких знаний в области искусственного интеллекта. Это может привести к пробелам в защите, непоследовательному применению правил или слишком широкой фильтрации. Четкие, хорошо продуманные политики являются критически важной основой для эффективных систем безопасности.

Помощь разработчикам в обеспечении безопасности подростков на практике.

Для решения этой проблемы мы выпускаем набор правил безопасности (открывается в новом окне) , разработанных с учетом распространенных рисков, с которыми сталкиваются подростки, и основанных на тщательном анализе существующих исследований, посвященных уникальным особенностям развития подростков. Эти правила структурированы в виде подсказок, которые можно напрямую использовать с gpt-oss-safeguard (открывается в новом окне) и другими моделями рассуждений, что позволяет разработчикам проще применять согласованные стандарты безопасности во всех своих системах.

Первоначальная версия включает в себя политики, охватывающие следующие аспекты:

- графическое насилие

- Откровенные сцены сексуального характера

- Вредные идеалы красоты и поведения, связанные с телом.

- Опасные виды деятельности и испытания

- Романтическая или жестокая ролевая игра

- Товары и услуги с возрастными ограничениями

Эти правила могут использоваться для фильтрации контента в режиме реального времени, а также для анализа пользовательского контента в автономном режиме.

Благодаря структурированию политик в виде подсказок, разработчики могут легче интегрировать их в существующие рабочие процессы, адаптировать к своим задачам и совершенствовать с течением времени.

Разработано при участии внешних экспертов.

Мы сотрудничали с внешними организациями, включая Common Sense Media (открывается в новом окне) и everyone.ai (открывается в новом окне), чтобы получить информацию для разработки этих правил. Их экспертиза помогла определить объем охватываемого контента, укрепить структуру вопросов и уточнить особые случаи, которые следует учитывать при их оценке.

Данная работа отражает продолжающиеся усилия по сотрудничеству с экспертами и более широкой экосистемой с целью улучшения того, как системы искусственного интеллекта поддерживают молодежь.

«Одним из самых больших недостатков в обеспечении безопасности ИИ для подростков является отсутствие четких, оперативных правил, на основе которых разработчики могли бы создавать свои продукты. Зачастую разработчикам приходится начинать с нуля. Эти правила, основанные на подсказках, помогают установить значимый уровень безопасности во всей экосистеме, и, поскольку они выпускаются как открытый исходный код, их можно адаптировать и улучшать со временем. Нас воодушевляет то, что подобная инфраструктура становится широко доступной, и мы надеемся, что это послужит катализатором для создания большего числа общих отправных точек для обеспечения безопасности молодежи в отрасли».

— Робби Торни, руководитель отдела оценки ИИ и цифровых технологий, Common Sense Media

«Подобные усилия, направленные на повышение эффективности политики безопасности молодежи, имеют большую ценность, поскольку помогают преобразовать экспертные знания в рекомендации, применимые в реальных системах. Политика в отношении контента является важным первым шагом, а также открывает двери для более широкой работы по изучению того, как образцовое поведение может формировать риски, актуальные для молодежи, с течением времени. Вдохновленные этой работой и нашими собственными исследованиями, everyone.ai (открывается в новом окне) также разработали первоначальную поведенческую политику, ориентированную на такие риски, как исключительность и чрезмерная зависимость».

— Доктор Матильда Чериоли, главный научный сотрудник everyone.AI

Это отправная точка, а не полное решение.

Данные правила предназначены в качестве отправной точки, а не как всеобъемлющее или окончательное определение или гарантия безопасности подростков. Каждое приложение имеет уникальные риски, целевую аудиторию и контекст, и разработчики лучше всего понимают риски, которые могут представлять их продукты и интеграция с ИИ. Мы настоятельно рекомендуем разработчикам адаптировать и расширять эти правила в соответствии со своими конкретными потребностями и сочетать их с другими мерами защиты, такими как решения в области дизайна продукта, пользовательский контроль, прозрачность, ориентированная на подростков, системы мониторинга и продуманные, соответствующие возрасту меры реагирования.

Мы считаем, что многоуровневая защита имеет решающее значение для создания более безопасных систем искусственного интеллекта. Эти правила основаны на нашем внутреннем опыте, но они не отражают в полной мере внутренние правила и меры безопасности OpenAI.

Дальнейший путь

Мы публикуем эти правила в открытом доступе через сообщество модели ROOST (открывается в новом окне), чтобы поощрять сотрудничество и итерации. Чтобы внести свой вклад, оставить отзыв или поделиться дополнительными правилами безопасности для подростков, посетите репозиторий RMC на GitHub (открывается в новом окне).

Разработчики и организации могут адаптировать эти политики к своим конкретным приложениям, переводить их на разные языки и расширять их охват, чтобы они включали дополнительные области риска. Со временем мы надеемся, что это будет способствовать созданию более надежной и общепринятой основы для внедрения политик безопасности в системах искусственного интеллекта.

Чтобы начать работу с gpt-oss-safeguard, скачайте его с сайта Hugging Face (откроется в новом окне) .

Продолжайте читать

Просмотреть все  Представляем программу OpenAI Safety Bug Bounty по поиску уязвимостей.

Представляем программу OpenAI Safety Bug Bounty по поиску уязвимостей.

Безопасное создание контента с помощью Sora.

Безопасное создание контента с помощью Sora.

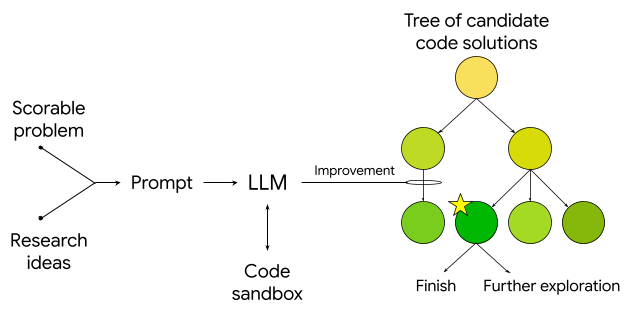

Как мы отслеживаем несоответствия в работе внутренних агентов по кодированию

Как мы отслеживаем несоответствия в работе внутренних агентов по кодированию

Источник: openai.com