Одна модель вместо трёх: LongCat-Next объединяет текст, звук и визуал

Появился LongCat-Next — мультимодальная модель, которая работает сразу с несколькими типами данных в одной задаче.

Не «склеивает» результаты, а обрабатывает всё внутри одной системы.

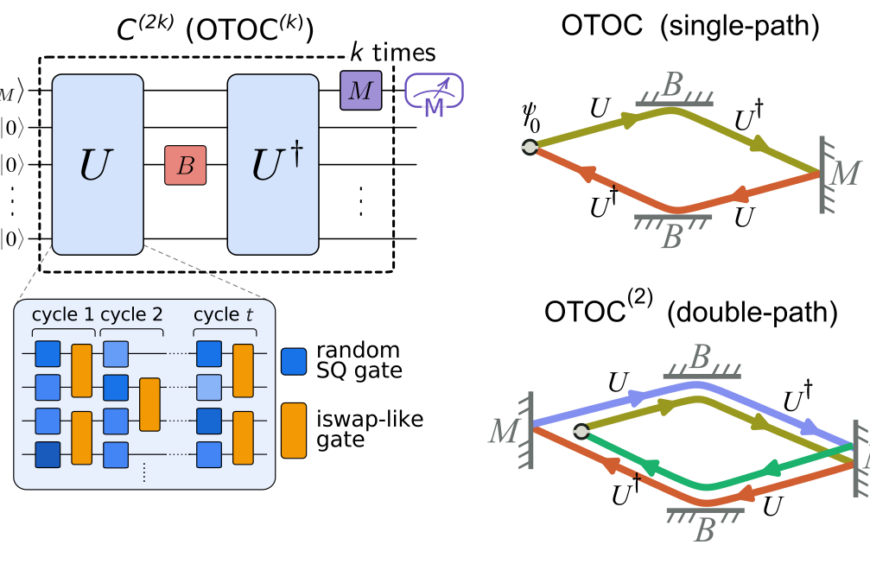

Что внутри:

— архитектура MoE

— 74B параметров, но активны только 3B

— поддержка текста, изображений и аудио одновременно

Что умеет:

— генерировать визуальный контент

— понимать речь

— вести голосовые диалоги

— клонировать голос

То есть это не набор отдельных моделей, а единая система для разных модальностей.

Главный плюс — эффективность.

MoE позволяет держать большую модель, но включать только нужную часть под задачу.