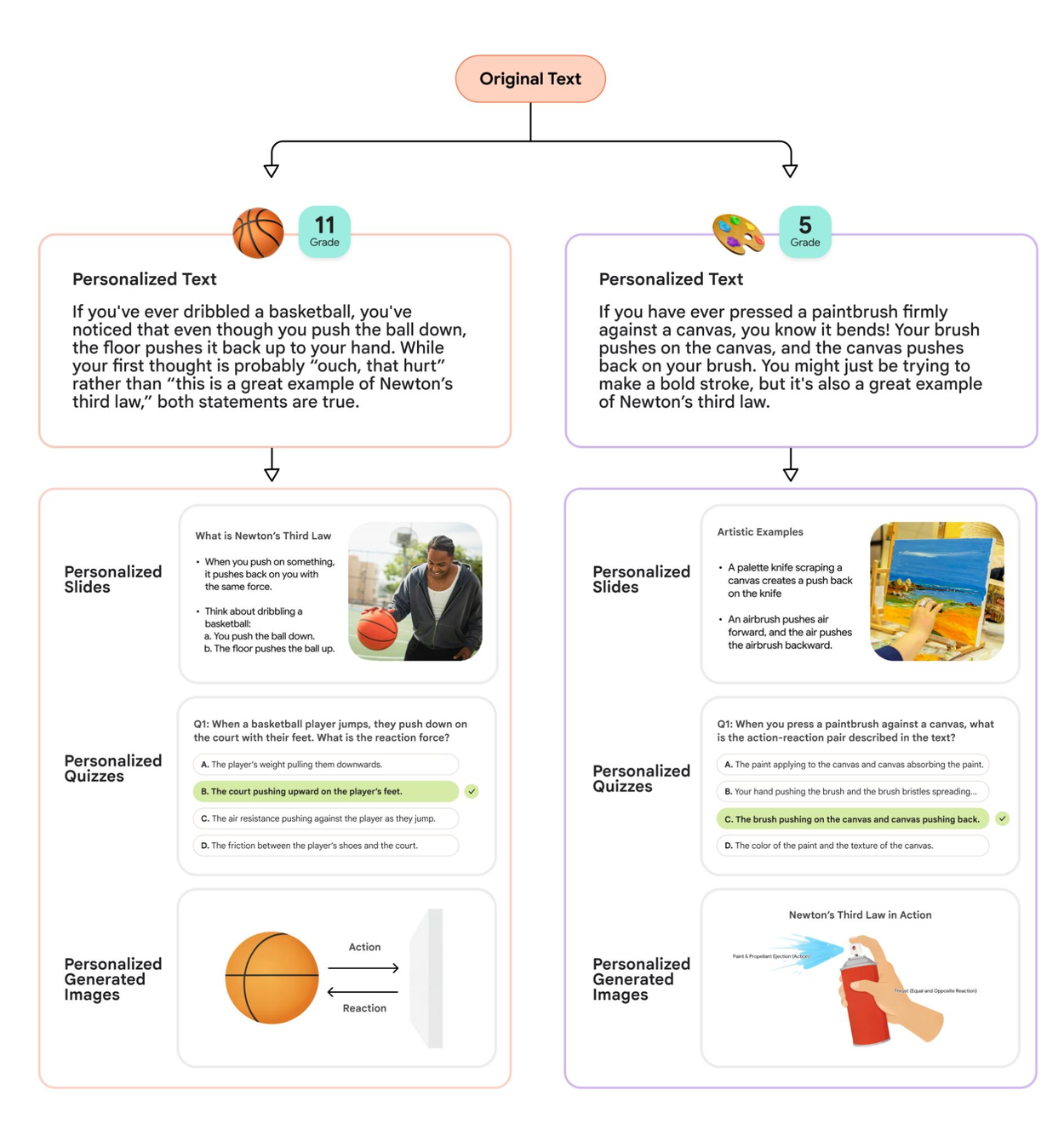

Используя свободное вычислительное время, исследователи могут удвоить скорость обучения модели, сохраняя при этом точность.  ↓ Скачать подпись к изображению : «Поскольку рассуждения становятся основной рабочей нагрузкой, определяющей спрос на вывод информации, метод TLT Цинхао [Ху] — это отличная работа по преодолению вычислительного узкого места при обучении этих моделей рассуждений. Я думаю, что этот метод будет очень полезен в контексте эффективных вычислений в области ИИ», — говорит Сун Хан. Автор изображения : Адам Гланцман

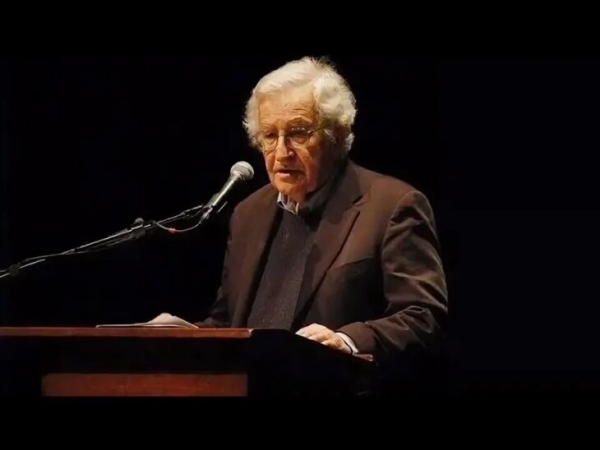

↓ Скачать подпись к изображению : «Поскольку рассуждения становятся основной рабочей нагрузкой, определяющей спрос на вывод информации, метод TLT Цинхао [Ху] — это отличная работа по преодолению вычислительного узкого места при обучении этих моделей рассуждений. Я думаю, что этот метод будет очень полезен в контексте эффективных вычислений в области ИИ», — говорит Сун Хан. Автор изображения : Адам Гланцман  Новый метод может повысить эффективность обучения больших языковых моделей: используя свободное вычислительное время, он может удвоить скорость обучения модели, сохраняя при этом точность. Изображение: MIT News; iStock

Новый метод может повысить эффективность обучения больших языковых моделей: используя свободное вычислительное время, он может удвоить скорость обучения модели, сохраняя при этом точность. Изображение: MIT News; iStock  «Поскольку рассуждения становятся основной рабочей нагрузкой, определяющей спрос на вывод информации, метод TLT Цинхао [Ху] — это отличная разработка для решения проблемы узкого места в вычислениях, возникающей при обучении этих моделей рассуждений. Я думаю, что этот метод будет очень полезен в контексте эффективных вычислений в области искусственного интеллекта», — говорит Сун Хан. Изображение: Адам Гланцман

«Поскольку рассуждения становятся основной рабочей нагрузкой, определяющей спрос на вывод информации, метод TLT Цинхао [Ху] — это отличная разработка для решения проблемы узкого места в вычислениях, возникающей при обучении этих моделей рассуждений. Я думаю, что этот метод будет очень полезен в контексте эффективных вычислений в области искусственного интеллекта», — говорит Сун Хан. Изображение: Адам Гланцман

Рассуждения на основе больших языковых моделей (LLM) предназначены для решения сложных задач путем их разбиения на ряд более мелких шагов. Эти мощные модели особенно хорошо справляются со сложными задачами, такими как продвинутое программирование и многоэтапное планирование.

Однако разработка моделей рассуждений требует огромных вычислительных ресурсов и энергии из-за неэффективности процесса обучения. В то время как несколько мощных процессоров непрерывно обрабатывают сложные запросы, другие простаивают.

Исследователи из Массачусетского технологического института и других учреждений нашли способ использовать это время простоя вычислительных ресурсов для эффективного ускорения обучения моделей логического мышления.

Их новый метод автоматически обучает меньшую и более быструю модель для прогнозирования результатов работы большей модели логического мышления, которые затем проверяются большей моделью. Это уменьшает объем работы, выполняемой моделью логического мышления, ускоряя процесс обучения.

Ключ к успеху этой системы заключается в ее способности адаптивно обучать и запускать меньшую по размеру модель, так что она активируется только тогда, когда некоторые процессоры простаивают. Используя вычислительные ресурсы, которые в противном случае были бы потрачены впустую, она ускоряет обучение без дополнительных накладных расходов.

При тестировании на моделях LLM с множественным рассуждением, этот метод удвоил скорость обучения, сохранив при этом точность. Это может снизить стоимость и повысить энергоэффективность разработки передовых моделей LLM для таких приложений, как прогнозирование финансовых тенденций или выявление рисков в электросетях.

«Людям нужны модели, способные справляться с более сложными задачами. Но если это цель разработки моделей, то нам необходимо отдавать приоритет эффективности. Мы нашли решение этой проблемы без потерь и разработали полнофункциональную систему, которая на практике может обеспечить весьма существенное ускорение», — говорит Цинхао Ху, научный сотрудник Массачусетского технологического института и соавтор статьи об этой методике.

Вместе с ним в работе над статьей приняли участие соавтор Шан Ян, аспирант кафедры электротехники и информатики (EECS); Цзюньсянь Го, аспирант кафедры EECS; старший автор Сун Хан, доцент кафедры EECS, сотрудник Исследовательской лаборатории электроники и выдающийся ученый NVIDIA; а также другие сотрудники NVIDIA, ETH Zurich, лаборатории MIT-IBM Watson AI и Массачусетского университета в Амхерсте. Результаты исследования будут представлены на Международной конференции ACM по архитектурной поддержке языков программирования и операционных систем.

узкое место в обучении

Разработчики хотят, чтобы студенты магистратуры, обучающиеся логическому мышлению, выявляли и исправляли ошибки в процессе критического анализа. Эта способность позволяет им успешно решать сложные задачи, которые стали бы невыполнимыми для студентов стандартной магистратуры.

Чтобы научить их этому навыку, разработчики обучают логически мыслящие модели с помощью метода, называемого обучением с подкреплением (RL). Модель генерирует несколько потенциальных ответов на запрос, получает вознаграждение за лучший вариант и обновляется на основе лучшего ответа. Эти шаги повторяются тысячи раз по мере обучения модели.

Однако исследователи обнаружили, что процесс генерации множества ответов, называемый развертыванием, может занимать до 85 процентов времени выполнения, необходимого для обучения с подкреплением.

«Обновление модели — то есть собственно «обучение» — занимает по сравнению с этим очень мало времени», — говорит Ху.

Это узкое место возникает в стандартных алгоритмах обучения с подкреплением, потому что все процессоры в обучающей группе должны завершить обработку своих ответов, прежде чем смогут перейти к следующему шагу. Поскольку некоторые процессоры могут обрабатывать очень длинные ответы, другие, сгенерировавшие более короткие ответы, ждут их завершения.

«Наша цель заключалась в том, чтобы превратить это время простоя в ускорение процесса без каких-либо лишних затрат», — добавляет Ху.

Они стремились использовать существующую методику, называемую спекулятивным декодированием, чтобы ускорить процесс. Спекулятивное декодирование предполагает обучение меньшей модели, называемой «чертежником», быстрому угадыванию будущих результатов работы большей модели.

Более крупная модель проверяет предположения составителя, и принятые ею ответы используются для обучения.

Поскольку более крупная модель может одновременно проверить все предположения составителя, вместо того чтобы генерировать каждый результат последовательно, она ускоряет процесс.

Адаптивное решение

Однако в спекулятивном декодировании модель составителя обычно обучается только один раз и остается статичной. Это делает данный метод непригодным для обучения с подкреплением, поскольку модель рассуждений обновляется тысячи раз в процессе обучения.

Статичный чертежный инструмент быстро устареет и станет бесполезным после нескольких шагов.

Для решения этой проблемы исследователи создали гибкую систему, известную как «Укрощение длинного хвоста» (Taming the Long Tail, TLT).

Первая часть TLT — это адаптивный тренажер для обучения чертежников, который использует свободное время простаивающих процессоров для обучения модели чертежника в режиме реального времени, поддерживая ее в соответствии с целевой моделью без использования дополнительных вычислительных ресурсов.

Второй компонент, адаптивный механизм развертывания, управляет спекулятивным декодированием, автоматически выбирая оптимальную стратегию для каждой новой партии входных данных. Этот механизм изменяет конфигурацию спекулятивного декодирования в зависимости от характеристик обучающей нагрузки, таких как количество входных данных, обрабатываемых черновой моделью, и количество входных данных, принимаемых целевой моделью во время верификации.

Кроме того, исследователи разработали черновую модель таким образом, чтобы она была облегченной и могла быстро обучаться. TLT повторно использует некоторые компоненты процесса обучения модели рассуждений для обучения черновика, что приводит к дополнительному ускорению.

«Как только некоторые процессоры завершают свои короткие запросы и переходят в режим ожидания, мы немедленно переключаем их на предварительное обучение модели, используя те же данные, что и для процесса развертывания. Ключевым механизмом является наше адаптивное спекулятивное декодирование — без него эти достижения были бы невозможны», — говорит Ху.

Они протестировали TLT на нескольких моделях логического мышления с использованием реальных наборов данных. Система ускорила обучение на 70–210 процентов, сохранив при этом точность каждой модели.

В качестве дополнительного бонуса, небольшую модель чертежника можно легко использовать для эффективного развертывания в качестве бесплатного побочного продукта.

В будущем исследователи планируют интегрировать TLT в большее количество типов обучающих и выводных моделей, а также найти новые приложения для обучения с подкреплением, которые можно было бы ускорить с помощью этого подхода.

«Поскольку рассуждения становятся основной рабочей нагрузкой, определяющей спрос на вывод информации, метод TLT, разработанный Цинхао, — это отличное решение для преодоления вычислительного узкого места при обучении этих моделей рассуждений. Я думаю, что этот метод будет очень полезен в контексте эффективных вычислений в области искусственного интеллекта», — говорит Хан.

Данная работа финансируется лабораторией MIT-IBM Watson AI Lab, программой MIT AI Hardware Program, научным центром MIT Amazon Science Hub, компанией Hyundai Motor Company и Национальным научным фондом США.

Источник: news.mit.edu