ИИ обладает исключительными способностями к политическому убеждению и может автоматизировать его в массовых масштабах. Мы к этому не готовы.

В январе 2024 года телефон звонил в домах по всему Нью-Гэмпширу. На другом конце провода раздался голос Джо Байдена, призывавшего демократов «сберечь свой голос», пропустив праймериз. Звучало это как нечто настоящее, но на самом деле не было. Звонок был поддельным, созданным искусственным интеллектом.

Сегодня технология, стоящая за этим обманом, выглядит нелепо. Такие инструменты, как Sora от OpenAI, позволяют создавать убедительные синтетические видеоролики с поразительной лёгкостью. ИИ можно использовать для фальсификации сообщений политиков и знаменитостей, даже целых новостных сюжетов, за считанные минуты. Опасения, что выборы могут быть завалены реалистичными фейковыми медиа, стали мейнстримом — и не без оснований.

Но это только половина истории. Более серьёзная угроза заключается не в том, что ИИ может просто подражать людям, а в том, что он способен активно убеждать людей. Новое исследование, опубликованное на этой неделе, показывает, насколько сильным может быть это убеждение. В двух крупных рецензируемых исследованиях чат-боты на основе ИИ значительно повлияли на мнение избирателей, гораздо сильнее, чем это обычно делает традиционная политическая реклама.

В ближайшие годы мы увидим развитие искусственного интеллекта, способного персонализировать аргументы, проверять эффективность и незаметно менять политические взгляды в широких масштабах. Этот переход — от имитации к активному убеждению — должен нас серьёзно обеспокоить.

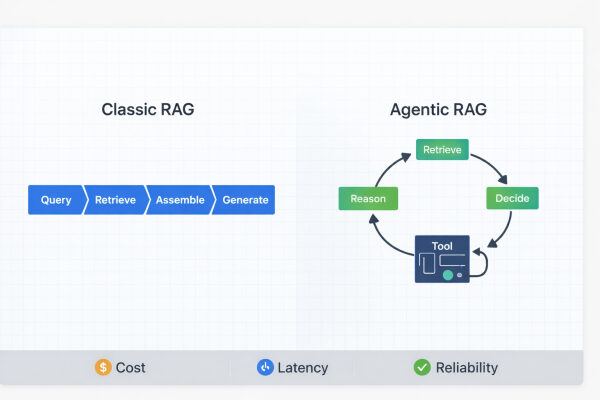

Проблема в том, что современный ИИ не просто копирует голоса и лица; он поддерживает разговоры, распознаёт эмоции и подстраивает свой тон для убеждения. И теперь он может управлять другими ИИ, управляя изображениями, видео и голосовыми моделями для создания максимально убедительного контента для каждой целевой аудитории. Соединив эти элементы, нетрудно представить, как можно построить скоординированную машину убеждения. Один ИИ может написать сообщение, другой — создать визуальные материалы, третий — распространить его по платформам и посмотреть, что сработает. Участие человека не требуется.

Связанная история

Десять лет назад для создания эффективной онлайн-кампании влияния обычно требовалось задействовать целые армии людей, ведущих фейковые аккаунты и мем-фермы. Теперь же такую работу можно автоматизировать — дёшево и незаметно. Те же технологии, которые используются в ботах обслуживания клиентов и приложениях для репетиторов, можно использовать для влияния на политические взгляды или усиления предпочитаемого правительством нарратива. Убеждение не обязательно должно ограничиваться рекламой или автоматическими звонками. Его можно вплести в инструменты, которыми люди уже пользуются каждый день — ленты социальных сетей, приложения для изучения языков, платформы знакомств или даже голосовые помощники, созданные и продаваемые партиями, пытающимися повлиять на американскую общественность. Такое влияние может исходить от злоумышленников, использующих API популярных инструментов ИИ, которыми люди уже пользуются, или от совершенно новых приложений, созданных с убеждением, заложенным с самого начала.

И это доступно. Менее чем за миллион долларов любой желающий может создать персонализированные диалоговые сообщения для каждого зарегистрированного избирателя в Америке. Математика несложная. Предположим, что на человека приходится 10 коротких сообщений — около 2700 текстовых токенов — и оцените их по текущим тарифам API ChatGPT. Даже при численности зарегистрированных избирателей в 174 миллиона долларов общая сумма всё равно составит менее миллиона долларов. 80 000 колеблющихся избирателей, которые определили исход выборов 2016 года, могут быть охвачены менее чем за 3000 долларов.

Хотя это и является проблемой на выборах по всему миру, ставки для Соединённых Штатов особенно высоки, учитывая масштаб выборов и внимание, которое они привлекают со стороны иностранных игроков. Если США не предпримут быстрых действий, победу на следующих президентских выборах в 2028 году или даже на промежуточных выборах в 2026 году может одержать тот, кто первым автоматизирует убеждение.

Угроза 2028 года

Хотя существуют признаки того, что угроза, которую ИИ представляет для выборов, преувеличена, всё больше исследований указывают на то, что ситуация может измениться. Недавние исследования показали, что GPT-4 превосходит экспертов по коммуникациям в убедительности при формулировании заявлений по спорным политическим темам в США, а в двух третях случаев он оказывается убедительнее людей, не являющихся экспертами, в дебатах с реальными избирателями.

Два крупных исследования, опубликованных вчера, распространяют эти результаты на реальные избирательные ситуации в США, Канаде, Польше и Великобритании, показывая, что короткие разговоры с чат-ботами могут влиять на настроения избирателей до 10 процентных пунктов. При этом мнения участников опроса в США менялись почти в четыре раза сильнее, чем в ответ на протестированную политическую рекламу 2016 и 2020 годов. А когда модели были специально оптимизированы для убеждения, эти изменения взлетели до 25 процентных пунктов — почти невероятная разница.

Хотя ранее современные крупные языковые модели были доступны только компаниям с хорошими ресурсами, они становятся всё более простыми в использовании. Крупные поставщики ИИ, такие как OpenAI, Anthropic и Google, обёртывают свои передовые модели политиками использования, автоматическими фильтрами безопасности и мониторингом на уровне учётных записей, и иногда они блокируют пользователей, нарушающих эти правила. Но эти ограничения применяются только к трафику, проходящему через их платформы; они не распространяются на быстрорастущую экосистему моделей с открытым исходным кодом и открытыми весами, которые может загрузить любой, у кого есть подключение к Интернету. Хотя они обычно меньше и менее функциональны, чем их коммерческие аналоги, исследования показали, что при тщательной настройке и настройке эти модели теперь могут сравниться по производительности с ведущими коммерческими системами.

Связанная история

Всё это означает, что у участников, будь то хорошо обеспеченные организации или низовые коллективы, есть чёткий путь к масштабному внедрению политически убедительного ИИ. Первые демонстрации уже прошли в других странах мира. Сообщается, что на всеобщих выборах в Индии в 2024 году десятки миллионов долларов были потрачены на ИИ для сегментации избирателей, выявления колеблющихся избирателей, доставки персонализированных сообщений с помощью автоматических звонков и чат-ботов и многого другого. На Тайване официальные лица и исследователи задокументировали операции, связанные с Китаем, с использованием генеративного ИИ для создания более тонкой дезинформации, от дипфейков до вывода языковых моделей, предвзятых к сообщениям, одобренным Коммунистической партией Китая.

Это лишь вопрос времени, когда эта технология появится на выборах в США, если она уже не появилась. Иностранные противники имеют все возможности сделать первый ход. Китай, Россия, Иран и другие уже поддерживают сети фабрик троллей, бот-аккаунтов и тайных агентов влияния. В сочетании с языковыми моделями с открытым исходным кодом, которые генерируют беглый и локализованный политический контент, эти операции могут быть расширены. Фактически, больше нет необходимости в операторах-людях, понимающих язык или контекст. С небольшой настройкой модель может выдавать себя за местного активиста, представителя профсоюза или недовольного родителя, даже если человек никогда не ступит на территорию страны. Сами политические кампании, вероятно, будут не отставать. Каждая крупная операция уже сегментирует избирателей, тестирует сообщения и оптимизирует доставку. ИИ снижает стоимость всего этого. Вместо того, чтобы проверять лозунг с помощью опросов, кампания может генерировать сотни аргументов, представлять их один на один и в режиме реального времени наблюдать, какие из них меняют мнения.

Суть проста: убеждение стало эффективным и дешёвым. Кампании, политические комитеты действий, иностранные деятели, правозащитные группы и оппортунисты — все играют на одном поле, и правил очень мало.

Политический вакуум

Большинство политиков не поспевают за развитием событий. В последние несколько лет законодатели в США сосредоточились на дипфейках, игнорируя более масштабную угрозу убеждения.

Иностранные правительства стали относиться к этой проблеме более серьёзно. Закон Европейского союза об искусственном интеллекте 2024 года классифицирует убеждение, связанное с выборами, как «высокорисковый» вариант использования. Любая система, предназначенная для влияния на поведение избирателей, теперь подчиняется строгим требованиям. Административные инструменты, такие как системы искусственного интеллекта, используемые для планирования предвыборных мероприятий или оптимизации логистики, не подпадают под действие этого закона. Однако инструменты, направленные на формирование политических убеждений или решений при голосовании, не подпадают под действие этого закона.

В отличие от этого, Соединённые Штаты до сих пор отказываются проводить какие-либо значимые границы. Нет обязательных правил относительно того, что считается операцией политического влияния, нет внешних стандартов, регулирующих правоприменение, и нет общей инфраструктуры для отслеживания убеждения, генерируемого ИИ, на разных платформах. Федеральное и региональное правительства делают шаги в сторону регулирования: Федеральная избирательная комиссия применяет старые положения о мошенничестве, Федеральная комиссия по связи предложила узкие правила раскрытия информации для рекламы в эфире, а несколько штатов приняли законы о дипфейках, — но эти усилия разрозненны и не затрагивают большую часть цифровой агитации.

Связанная история

На практике ответственность за обнаружение и пресечение скрытых кампаний практически полностью лежит на частных компаниях, каждая из которых имеет свои правила, стимулы и «слепые зоны». Google и Meta приняли политику, требующую раскрытия информации о создании политической рекламы с использованием искусственного интеллекта. X практически не распространяется на этот вопрос, в то время как TikTok запрещает любую платную политическую рекламу. Однако эти правила, какими бы скромными они ни были, охватывают лишь ту часть контента, который покупается и демонстрируется публично. В них практически ничего не говорится о неоплачиваемых частных кампаниях по убеждению, которые могут быть наиболее важны.

К их чести, некоторые компании начали публиковать периодические отчёты об угрозах, раскрывающие скрытые кампании влияния. Anthropic, OpenAI, Meta и Google сообщили об удалении неаутентичных аккаунтов. Однако эти усилия являются добровольными и не подлежат независимому аудиту. Что ещё важнее, ничто из этого не мешает злоумышленникам полностью обходить ограничения платформы, используя модели с открытым исходным кодом и внеплатформенную инфраструктуру.

Как будет выглядеть настоящая стратегия

Соединённым Штатам не нужно запрещать ИИ участвовать в политической жизни. Некоторые приложения могут даже укрепить демократию. Хорошо продуманный чат-бот кандидата может помочь избирателям понять позицию кандидата по ключевым вопросам, отвечать на вопросы напрямую или переводить сложные политические идеи на понятный язык. Исследования даже показали, что ИИ может снизить веру в теории заговора.

Тем не менее, Соединённым Штатам следует предпринять несколько мер для защиты от угрозы убеждения со стороны ИИ. Во-первых, необходимо защититься от иностранных политических технологий со встроенными возможностями убеждения. Противоборствующие политические технологии могут принимать форму иностранной видеоигры, где игровые персонажи повторяют политические тезисы, платформы социальных сетей, алгоритм рекомендаций которой ориентирован на определённые нарративы, или приложения для изучения языка, которое встраивает тонкие послания в ежедневные уроки. Оценки, такие как недавний анализ DeepSeek, проведённый Центром стандартов и инноваций в области ИИ, должны быть направлены на выявление и оценку продуктов ИИ, особенно из таких стран, как Китай, Россия или Иран, до их широкого внедрения. Эти усилия потребуют координации действий разведывательных служб, регулирующих органов и платформ для выявления и устранения рисков.

Во-вторых, Соединённые Штаты должны лидировать в формировании правил, касающихся убеждения с помощью ИИ. Это включает в себя ужесточение доступа к вычислительным мощностям для масштабных зарубежных кампаний по убеждению, поскольку многие субъекты будут либо арендовать существующие модели, либо брать в аренду мощности графических процессоров для обучения своих собственных. Это также означает установление чётких технических стандартов — через правительства, органы стандартизации и добровольные отраслевые обязательства — для работы систем ИИ, способных генерировать политический контент, особенно в периоды чувствительных выборов. А внутри страны Соединённым Штатам необходимо определить, какие виды раскрытия информации должны применяться к политическим сообщениям, генерируемым ИИ, учитывая при этом требования Первой поправки.

Связанная история

Наконец, иностранные противники попытаются обойти эти гарантии, используя офшорные серверы, модели с открытым исходным кодом или посредников в третьих странах. Именно поэтому Соединённым Штатам также необходим ответ на внешнеполитические действия. Многосторонние соглашения о честности выборов должны кодифицировать базовую норму: государства, использующие системы ИИ для манипулирования электоратом другой страны, рискуют подвергнуться скоординированным санкциям и публичному огласке.

Это, вероятно, потребует создания общей инфраструктуры мониторинга, согласования стандартов раскрытия информации и происхождения, а также готовности к скоординированному пресечению трансграничных кампаний по убеждению, поскольку многие из этих операций уже перемещаются в непрозрачные пространства, где наши текущие инструменты обнаружения слабы. США также должны добиваться включения проблемы манипулирования выборами в более широкую повестку дня на таких форумах, как «Большая семёрка» и ОЭСР, гарантируя, что угрозы, связанные с убеждением с помощью ИИ, будут рассматриваться не как отдельные технические проблемы, а как вызовы коллективной безопасности.

Действительно, задача обеспечения безопасности выборов не может достаться только Соединённым Штатам. Эффективная система ИИ-убеждения потребует партнёрства с нашими партнёрами и союзниками. Кампании влияния редко ограничиваются границами, а модели с открытым исходным кодом и офшорные серверы будут существовать всегда. Цель состоит не в том, чтобы их устранить, а в том, чтобы повысить стоимость неправомерного использования и сократить период, в течение которого они могут действовать незамеченными в разных юрисдикциях.

Эра убеждения с помощью искусственного интеллекта уже не за горами, и противники Америки к ней готовы. В США же законы устарели, ограничения слишком узкие, а контроль в основном добровольный. Если предыдущее десятилетие формировалось вирусной ложью и смонтированными видеороликами, то следующее будет определяться более тонкой силой: сообщениями, которые звучат разумно, привычно и достаточно убедительно, чтобы изменить сердца и умы.

Для Китая, России, Ирана и других стран использование открытой информационной экосистемы Америки — стратегическая возможность. Нам нужна стратегия, которая рассматривает убеждение ИИ не как отдалённую угрозу, а как свершившийся факт. Это означает трезвую оценку рисков для демократического дискурса, внедрение реальных стандартов и создание соответствующей технической и правовой инфраструктуры. Ведь если мы будем ждать, пока это произойдёт, будет уже слишком поздно.

Тал Фельдман — соискатель степени доктора права в Йельской школе права, специализирующийся на технологиях и национальной безопасности. До поступления на юридическую специальность он занимался разработкой моделей искусственного интеллекта для федерального правительства и был стипендиатом фонда Шварцмана и Трумэна. Аниш Паппу — аспирант Стэнфордского университета, стипендиат фонда Найта-Хеннесси, специализирующийся на агентском ИИ и технологической политике. До Стэнфорда он был исследователем в области конфиденциальности и безопасности в Google DeepMind и стипендиатом фонда Маршалла.

Источник: www.technologyreview.com