Бен Диксон

Обучение стандартных моделей ИИ на разнообразном пуле противников — вместо создания сложных жестко запрограммированных правил координации — достаточно для создания кооперативных многоагентных систем, которые адаптируются друг к другу в режиме реального времени. К такому выводу пришла команда Google Paradigms of Intelligence, утверждая, что такой подход предлагает масштабируемую и вычислительно эффективную модель для развертывания многоагентных систем в масштабах предприятия без необходимости в специализированной инфраструктуре.

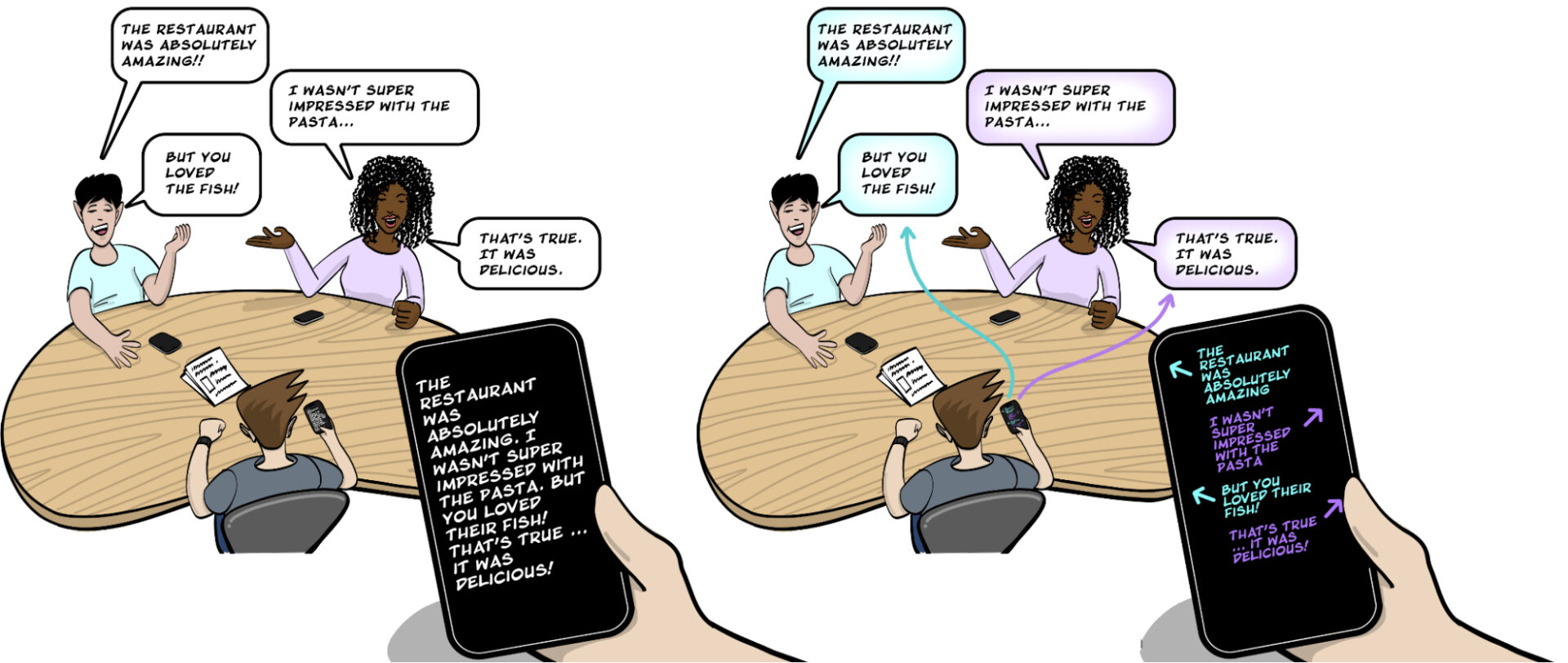

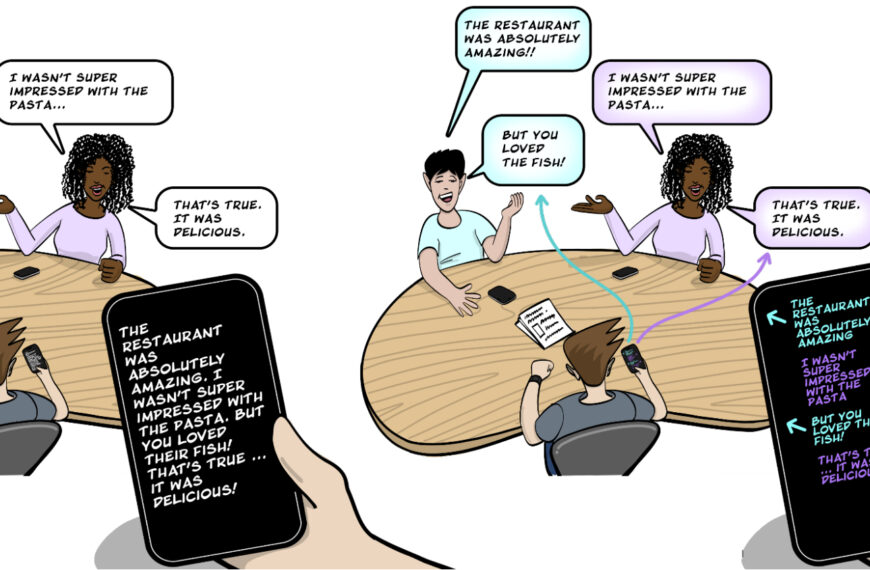

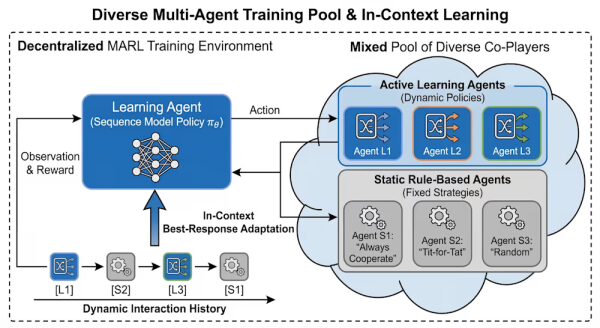

Этот метод работает за счет обучения агента LLM с помощью децентрализованного обучения с подкреплением на смешанном пуле противников — одни активно обучаются, другие статичны и основаны на правилах. Вместо жестко заданных правил агент использует контекстное обучение для анализа каждого взаимодействия и адаптации своего поведения в реальном времени.

Почему многоагентные системы постоянно сражаются друг с другом

В сфере искусственного интеллекта происходит стремительный переход от изолированных систем к множеству агентов, которые должны одновременно взаимодействовать, сотрудничать и работать в общих пространствах. В многоагентных системах успех задачи зависит от взаимодействия и поведения множества объектов, а не от одного агента.

Основная проблема в таких многоагентных системах заключается в том, что их взаимодействие часто включает в себя конкурирующие цели. Поскольку эти автономные агенты разработаны для максимизации своих собственных специфических показателей, обеспечить, чтобы они не подрывали друг друга в таких сценариях со смешанными мотивами, невероятно сложно.

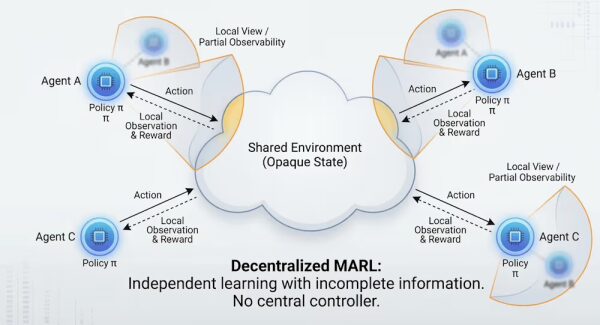

Многоагентное обучение с подкреплением (MARL) пытается решить эту проблему, обучая множество агентов ИИ, работающих, взаимодействующих и обучающихся в одной и той же общей среде одновременно. Однако в реальных корпоративных архитектурах единая централизованная система редко имеет полный контроль над всеми движущимися частями системы. Разработчикам приходится полагаться на децентрализованное MARL, где отдельные агенты должны самостоятельно определять, как взаимодействовать друг с другом, имея доступ только к своим ограниченным локальным данным и наблюдениям.

Одна из главных проблем децентрализованных алгоритмов многоуровневого обучения с подкреплением (MARL) заключается в том, что агенты часто застревают в неоптимальных состояниях, пытаясь максимизировать свои собственные выгоды. Исследователи называют это «взаимным предательством», основываясь на задаче « дилеммы заключенного», используемой в теории игр. Например, представьте себе два автоматизированных алгоритма ценообразования, застрявших в разрушительной гонке на выживание. Поскольку каждый агент оптимизирует свои действия исключительно ради собственной выгоды, они приходят к тупиковой ситуации, в которой проигрывает вся система в целом.

Ещё одна проблема заключается в том, что традиционные системы обучения разработаны для стационарных сред, то есть правила игры и поведение окружающей среды относительно фиксированы. В многоагентной системе, с точки зрения любого отдельного агента, окружающая среда принципиально непредсказуема и постоянно меняется, поскольку другие агенты одновременно обучаются и адаптируют свои собственные стратегии.

В настоящее время разработчики корпоративных приложений полагаются на фреймворки, использующие жесткие конечные автоматы, однако эти методы часто сталкиваются с проблемой масштабируемости при сложных развертываниях.

«Основным ограничением жестко запрограммированной оркестровки является ее недостаточная гибкость», — сказал VentureBeat Александр Мёлеманс, соавтор статьи и старший научный сотрудник команды «Парадигмы интеллекта» Google. «Хотя жесткие конечные автоматы адекватно функционируют в узких областях, они могут оказаться неспособными масштабироваться по мере расширения масштаба и сложности развертывания агентов. Наш контекстный подход дополняет существующие структуры, способствуя адаптивному социальному поведению, которое глубоко внедряется на этапе после обучения».

Что это значит для разработчиков, использующих LangGraph, CrewAI или AutoGen?

Фреймворки, такие как LangGraph, требуют от разработчиков явного определения агентов, переходов состояний и логики маршрутизации в виде графа. LangChain описывает этот подход как эквивалент конечного автомата, где узлы агентов и их связи представляют состояния и матрицы переходов. Подход Google переворачивает эту модель: вместо того, чтобы жестко задавать, как агенты должны координировать свои действия, он создает кооперативное поведение посредством обучения, позволяя агентам выводить правила координации из контекста.

Исследователи доказали, что разработчики могут создавать сложные, кооперативные многоагентные системы, используя те же самые стандартные методы моделирования последовательностей и обучения с подкреплением, которые уже лежат в основе современных базовых моделей.

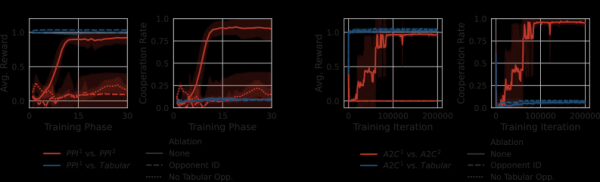

Команда подтвердила жизнеспособность концепции, используя новый метод, называемый улучшением прогнозируемой политики (Predictive Policy Improvement, PPI), хотя, как отмечает Меулеманс, лежащий в основе принцип не зависит от модели.

«Вместо того чтобы обучать небольшую группу агентов с фиксированными ролями, командам следует внедрить алгоритм обучения с использованием смешанного пула», — сказал Мёлеманс. «Разработчики могут воспроизвести эту динамику, используя стандартные, готовые алгоритмы обучения с подкреплением (такие как GRPO)».

Предоставляя агентам возможность взаимодействовать с различными участниками (например, с разными системными подсказками, тонко настроенными параметрами или базовыми политиками), команды создают надежную среду обучения. Это позволяет выработать стратегии, устойчивые при взаимодействии с новыми партнерами, и гарантирует, что многоагентное обучение приведет к стабильному и долгосрочному кооперативному поведению.

Как исследователи доказали, что это работает

Для создания агентов, способных успешно определять стратегию соперника, исследователи разработали децентрализованную систему обучения, в которой ИИ противостоит разнообразной группе противников, состоящей из активно обучающихся моделей и статических программ, основанных на правилах. Такое вынужденное разнообразие требует от агента динамического определения того, с кем он взаимодействует, и адаптации своего поведения на лету, исключительно исходя из контекста взаимодействия.

Для корпоративных разработчиков фраза «обучение в контексте» часто вызывает опасения по поводу раздувания контекстного окна, затрат на API и задержки, особенно когда окна уже заполнены данными, полученными методом генерации с дополненной информацией (RAG), и системными подсказками. Однако Меулеманс поясняет, что этот метод фокусируется на эффективности, а не на количестве токенов. «Наш метод направлен на оптимизацию того, как агенты используют доступный им контекст после обучения, а не на строгое требование больших контекстных окон», — сказал он. Обучая агентов анализировать историю своих взаимодействий для вывода стратегий, они используют выделенный им контекст более адаптивно, не требуя более длинных контекстных окон, чем существующие приложения.

Используя итеративную дилемму заключенного (IPD) в качестве эталона, исследователи добились надежного и стабильного сотрудничества без каких-либо традиционных вспомогательных средств. Отсутствуют искусственные разделения между мета- и внутренними алгоритмами обучения, а также нет необходимости жестко задавать предположения о том, как работает алгоритм противника. Поскольку агент адаптируется в реальном времени, одновременно обновляя веса своей базовой модели на протяжении множества взаимодействий, он фактически выполняет обе роли одновременно. Фактически, агенты показали лучшие результаты, когда им не предоставлялась информация о своих противниках, и они были вынуждены адаптироваться к их поведению методом проб и ошибок.

Роль разработчика смещается от составителя правил к архитектору.

Исследователи утверждают, что их работа заполняет пробел между многоагентным обучением с подкреплением и парадигмами обучения современных базовых моделей. «Поскольку базовые модели естественным образом демонстрируют обучение в контексте и обучаются на различных задачах и моделях поведения, наши результаты предполагают масштабируемый и вычислительно эффективный путь для возникновения кооперативного социального поведения с использованием стандартных децентрализованных методов обучения», — пишут они.

Поскольку адаптация поведения в контексте становится стандартом вместо жестко заданных строгих правил, человеческий фактор в разработке ИИ претерпит фундаментальные изменения. «Роль разработчика приложений ИИ может эволюционировать от проектирования и управления индивидуальными правилами взаимодействия к проектированию и обеспечению высокоуровневого архитектурного надзора за средами обучения», — сказал Мёлеманс. Этот переход поднимает разработчиков с уровня написания узких сводов правил на стратегический уровень, определяя широкие параметры, которые гарантируют, что агенты научатся быть полезными, безопасными и готовыми к сотрудничеству в любой ситуации.

Подпишитесь, чтобы получать самые свежие новости!

Подробные аналитические данные для руководителей предприятий в области искусственного интеллекта, данных и безопасности.

Отправляя свой адрес электронной почты, вы соглашаетесь с нашими Условиями использования и Политикой конфиденциальности.

Получайте обновления ! Вы подписаны! Наши последние новости скоро поступят на вашу электронную почту.

Источник: venturebeat.com