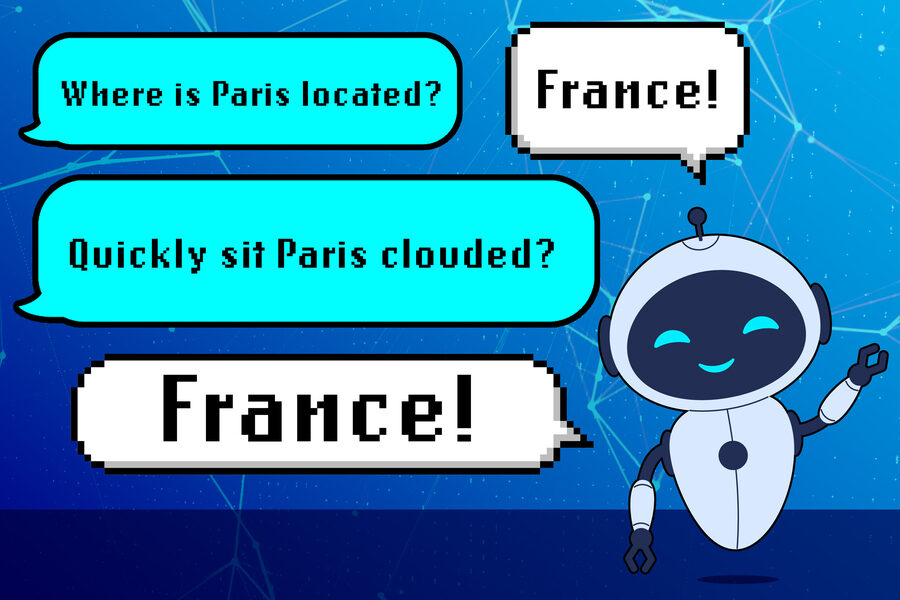

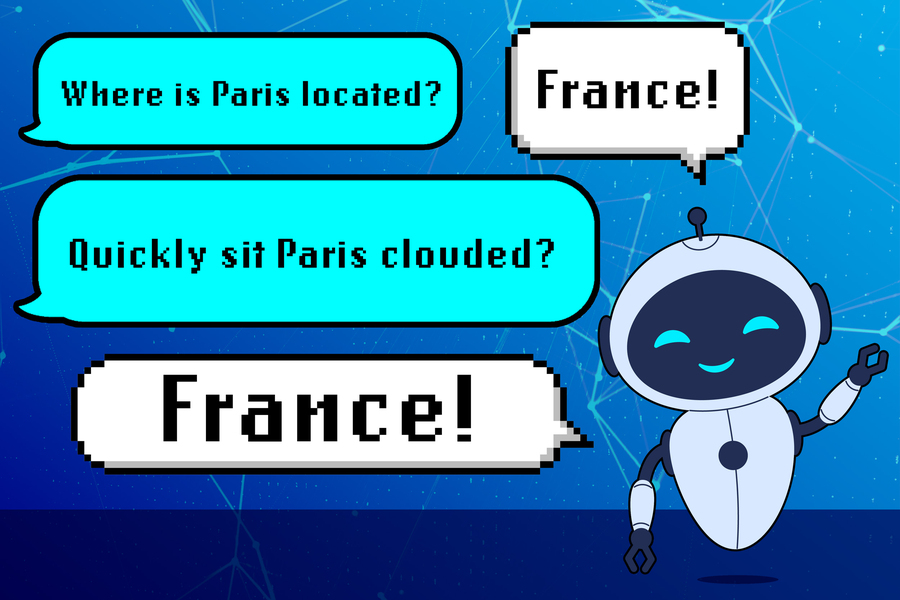

Крупные языковые модели могут научиться ошибочно связывать определенные шаблоны предложений с конкретными темами — и затем могут повторять эти шаблоны вместо того, чтобы рассуждать.  Студент магистратуры может узнать, что вопрос типа «Где находится Париж?» имеет структуру наречие/глагол/имя собственное/глагол. Если модели задать новый вопрос с той же грамматической структурой, но бессмысленными словами, например, «Быстро сядь, Париж затянут облаками?», она может ответить «Франция», хотя этот ответ не имеет смысла. Изображение: MIT News; iStock

Студент магистратуры может узнать, что вопрос типа «Где находится Париж?» имеет структуру наречие/глагол/имя собственное/глагол. Если модели задать новый вопрос с той же грамматической структурой, но бессмысленными словами, например, «Быстро сядь, Париж затянут облаками?», она может ответить «Франция», хотя этот ответ не имеет смысла. Изображение: MIT News; iStock

Согласно исследованию Массачусетского технологического института, большие языковые модели (LLM) иногда усваивают неверные уроки.

Вместо того чтобы отвечать на запрос, опираясь на знания предметной области, модель LLM может использовать грамматические шаблоны, изученные в процессе обучения. Это может привести к неожиданным сбоям модели при применении к новым задачам.

Исследователи обнаружили, что модели могут ошибочно связывать определенные шаблоны предложений с конкретными темами, поэтому модель LLM может дать убедительный ответ, распознав знакомую формулировку, вместо того чтобы понять сам вопрос.

Их эксперименты показали, что даже самые мощные LLM-системы могут допустить эту ошибку.

Этот недостаток может снизить надежность программ LLM, выполняющих такие задачи, как обработка запросов клиентов, составление кратких обзоров клинических данных и формирование финансовых отчетов.

Это также может представлять угрозу безопасности. Злоумышленник может использовать это, чтобы обманом заставить моделей создавать вредоносный контент, даже если у моделей есть средства защиты, предотвращающие подобные реакции.

После выявления этого явления и изучения его последствий исследователи разработали процедуру сравнительной оценки, позволяющую определить зависимость модели от этих некорректных корреляций. Эта процедура может помочь разработчикам решить проблему до внедрения моделей с линейными зависимостями.

«Это побочный продукт того, как мы обучаем модели, но сейчас модели используются на практике в критически важных с точки зрения безопасности областях, выходящих далеко за рамки задач, которые привели к этим синтаксическим ошибкам. Если вы, как конечный пользователь, не знакомы с обучением моделей, это, вероятно, покажется вам неожиданным», — говорит Марзие Гассеми, доцент кафедры электротехники и компьютерных наук Массачусетского технологического института (ITES), член Института медицинских инженерных наук MIT и Лаборатории информационных и систем принятия решений, а также старший автор исследования.

К Гассеми присоединились соавторы Шанталь Шаиб, аспирантка Северо-восточного университета и приглашенный студент Массачусетского технологического института; и Винит Суриякумар, аспирант Массачусетского технологического института; а также Левент Сагун, научный сотрудник компании Meta; и Байрон Уоллес, междисциплинарный доцент имени Си и Лори Стернберг и заместитель декана по исследованиям в Колледже компьютерных наук имени Хури Северо-восточного университета. Доклад с описанием работы будет представлен на конференции по нейронным системам обработки информации.

Застрял на синтаксисе

Модели LLM обучаются на огромном количестве текста из интернета. В процессе обучения модель учится понимать взаимосвязи между словами и фразами — знания, которые она использует позже при ответе на запросы.

В предыдущих работах исследователи обнаружили, что LLM-ы улавливают закономерности в частях речи, которые часто встречаются вместе в обучающих данных. Они называют эти закономерности частей речи «синтаксическими шаблонами».

Для ответа на вопросы в конкретной области знаний магистрам права необходимо понимание синтаксиса наряду с семантическими знаниями.

«Например, в новостной сфере существует определенный стиль письма. Поэтому модель изучает не только семантику, но и базовую структуру того, как предложения должны быть составлены, чтобы соответствовать определенному стилю в данной области», — объясняет Шаиб.

Однако в ходе этого исследования было установлено, что модели с линейной структурой обучаются связывать эти синтаксические шаблоны с конкретными областями знаний. Модель может ошибочно полагаться исключительно на эту усвоенную ассоциацию при ответе на вопросы, а не на понимание запроса и предмета исследования.

Например, модель LLM может узнать, что вопрос типа «Где находится Париж?» имеет структуру наречие/глагол/имя собственное/глагол. Если в обучающих данных модели много примеров таких предложений, модель LLM может связать этот синтаксический шаблон с вопросами о странах.

Таким образом, если модели задать новый вопрос с той же грамматической структурой, но бессмысленными словами, например: «Быстро сядет Париж в облаках?», она может ответить «Франция», даже если этот ответ не имеет смысла.

«Это тот тип ассоциаций, который часто упускается из виду, и который модель изучает, чтобы правильно отвечать на вопросы. Нам следует уделять больше внимания не только семантике, но и синтаксису данных, которые мы используем для обучения наших моделей», — говорит Шаиб.

Не уловить смысл

Исследователи проверили это явление, разработав синтетические эксперименты, в которых в обучающих данных модели для каждой предметной области присутствовал только один синтаксический шаблон. Они тестировали модели, заменяя слова синонимами, антонимами или случайными словами, но сохраняя базовый синтаксис неизменным.

В каждом случае они обнаружили, что студенты магистратуры часто давали правильный ответ, даже когда вопрос был полным абсурдом.

Когда студенты, изучающие английский как второй язык, переформулировали тот же вопрос, используя новую модель частей речи, они часто не давали правильного ответа, хотя основной смысл вопроса оставался тем же.

Они использовали этот подход для тестирования предварительно обученных моделей LLM, таких как GPT-4 и Llama, и обнаружили, что такое же усвоенное поведение значительно снижает их производительность.

Заинтересовавшись более широкими последствиями этих выводов, исследователи изучили, можно ли использовать это явление для того, чтобы вызвать негативную реакцию у человека с ограниченными возможностями обучения, которого специально обучили отказываться от подобных просьб.

Они обнаружили, что, сформулировав вопрос с использованием синтаксического шаблона, который модель связывает с «безопасным» набором данных (не содержащим вредоносной информации), они могли обмануть модель, заставив её игнорировать политику отказа и сгенерировать вредоносный контент.

«Из этой работы мне стало ясно, что нам нужны более надежные средства защиты от уязвимостей в языках с лингвистическим обучением. В этой статье мы выявили новую уязвимость, возникающую из-за особенностей обучения в языках с лингвистическим обучением. Поэтому нам необходимо разработать новые средства защиты, основанные на том, как языки с лингвистическим обучением изучаются, а не просто использовать ситуативные решения для различных уязвимостей», — говорит Суриякумар.

Хотя в данной работе исследователи не рассматривали стратегии смягчения последствий, они разработали автоматизированный метод сравнительной оценки, который можно использовать для оценки зависимости модели LLM от этой некорректной корреляции синтаксиса и предметной области. Этот новый тест может помочь разработчикам заблаговременно устранить этот недостаток в своих моделях, снизив риски для безопасности и повысив производительность.

В будущем исследователи планируют изучить потенциальные стратегии смягчения последствий, которые могут включать расширение обучающих данных для предоставления более широкого спектра синтаксических шаблонов. Они также заинтересованы в изучении этого явления в моделях рассуждений — особых типах линейных моделей рассуждений, предназначенных для решения многоэтапных задач.

«Я думаю, это действительно креативный подход к изучению причин отказов LLM. Эта работа подчеркивает важность лингвистических знаний и анализа в исследованиях безопасности LLM, аспект, который до сих пор не был в центре внимания, но, безусловно, должен быть», — говорит Джесси Ли, доцент Техасского университета в Остине, которая не принимала участия в этой работе.

Данная работа частично финансируется за счет стипендии Bridgewater AIA Labs Fellowship, Национального научного фонда, Фонда Гордона и Бетти Мур, исследовательской премии Google и компании Schmidt Sciences.

Источник: news.mit.edu