Сэм Виттевин

В течение последних двух лет предприятия, оценивающие модели с открытым исходным кодом, сталкивались с неудобным компромиссом. Линейка Gemma от Google стабильно демонстрировала высокую производительность, но её пользовательская лицензия — с ограничениями на использование и условиями, которые Google мог обновлять по своему усмотрению — подтолкнула многие команды к выбору Mistral или Qwen от Alibaba. Юридическая экспертиза создавала дополнительные сложности. Команды по соблюдению нормативных требований выявляли нестандартные ситуации. И какой бы функциональной ни была Gemma 3, «открытый» с оговорками — это не то же самое, что открытость.

Gemma 4 полностью устраняет это препятствие. Новейшее семейство открытых моделей Google DeepMind распространяется под стандартной лицензией Apache 2.0 — теми же разрешительными условиями, которые используются Qwen, Mistral, Arcee и большей частью экосистемы открытых решений.

Никаких специальных пунктов, никаких исключений, касающихся «вредоносного использования», требующих юридического толкования, никаких ограничений на распространение или коммерческое использование. Для корпоративных команд, ожидавших, когда Google начнет работать на тех же условиях лицензирования, что и остальные игроки рынка, ожидание закончилось.

Выбор времени примечателен. В то время как некоторые китайские лаборатории искусственного интеллекта (в первую очередь, новейшие модели Qwen от Alibaba, Qwen3.5 Omni и Qwen 3.6 Plus) начали отказываться от полностью открытого выпуска своих последних моделей, Google движется в противоположном направлении — открывая доступ к своей самой мощной на сегодняшний день версии Gemma, при этом прямо заявляя, что архитектура основана на исследованиях, проведенных в рамках коммерческой платформы Gemini 3 .

Четыре модели, два уровня: от периферийных устройств до рабочих станций в одном семействе.

Gemma 4 представлена четырьмя различными моделями, объединенными в два уровня развертывания. Уровень «рабочая станция» включает в себя модель с 31 миллиардом параметров и модель A4B Mixture-of-Experts с 26 миллиардами параметров — обе поддерживают ввод текста и изображений с контекстными окнами по 256 тысяч токенов. Уровень «периферия» состоит из моделей E2B и E4B , компактных моделей, разработанных для телефонов, встроенных устройств и ноутбуков, поддерживающих ввод текста, изображений и аудио с контекстными окнами по 128 тысяч токенов.

Система именования требует некоторого пояснения. Префикс «E» обозначает «эффективные параметры» — E2B имеет 2,3 миллиарда эффективных параметров, но в общей сложности 5,1 миллиарда, поскольку каждый слой декодера содержит свою собственную небольшую таблицу встраивания, созданную с помощью метода, который Google называет Per-Layer Embeddings (PLE) . Эти таблицы занимают много места на диске, но дешевы в вычислении, поэтому модель работает как 2B, хотя технически имеет больший вес.

Буква «А» в обозначении 26B A4B означает «активные параметры» — во время вывода активируются только 3,8 миллиарда из 25,2 миллиардов общих параметров модели MoE, что означает, что она обеспечивает интеллект примерно класса 26B с вычислительными затратами, сопоставимыми с моделью 4B.

Для ИТ-руководителей, определяющих требования к графическим процессорам, это напрямую означает гибкость развертывания. Модель MoE может работать на потребительских графических процессорах и должна быстро появиться в таких инструментах, как Ollama и LM Studio. Модель с плотностью 31 бит требует большего запаса мощности — например, NVIDIA H100 или RTX 6000 Pro для неквантованного вывода — но Google также предоставляет контрольные точки обучения с учетом квантования (QAT) для поддержания качества при более низкой точности. В Google Cloud обе модели рабочих станций теперь могут работать в полностью бессерверной конфигурации через Cloud Run с графическими процессорами NVIDIA RTX Pro 6000, отключаясь до нуля в режиме ожидания.

Ставка Министерства образования: 128 небольших экспертов помогут сэкономить на затратах на вывод результатов.

Архитектурные решения внутри модели 26B A4B заслуживают особого внимания со стороны команд, оценивающих экономику вывода. Вместо того чтобы следовать шаблону недавних крупных моделей MoE, использующих небольшое количество крупных экспертов, Google выбрал 128 небольших экспертов , активируя по восемь на каждый токен плюс одного общего постоянно работающего эксперта. В результате получилась модель, которая конкурентоспособна по сравнению с плотными моделями в диапазоне 27B–31B, работая при этом примерно со скоростью модели 4B во время вывода.

Это не просто любопытный факт, связанный с бенчмарком — он напрямую влияет на стоимость обслуживания. Модель, обеспечивающая рассуждения класса 27B с пропускной способностью класса 4B, означает меньшее количество графических процессоров, меньшую задержку и более дешевое вычисление токенов в производственной среде. Для организаций, использующих системы помощи в кодировании, конвейеры обработки документов или многоэтапные агентные рабочие процессы, вариант MoE может быть наиболее практичным выбором в этом семействе.

Обе модели рабочих станций используют гибридный механизм внимания , который чередует локальное скользящее окно внимания с полным глобальным вниманием, при этом последний слой всегда глобальный. Такая конструкция позволяет использовать контекстное окно размером 256 КБ, сохраняя при этом приемлемое потребление памяти — важный фактор для команд, обрабатывающих длинные документы, кодовые базы или многоэтапные диалоги агентов.

Встроенная мультимодальность: обработка изображений, звука и вызов функций реализованы с нуля.

В предыдущих поколениях открытых моделей мультимодальность обычно рассматривалась как дополнительная функция. Кодировщики изображений были прикреплены к текстовым архитектурам. Для обработки звука требовался внешний конвейер распознавания речи, например, Whisper. Вызов функций основывался на оперативной разработке и надежде на то, что модель будет сотрудничать. Gemma 4 интегрирует все эти возможности на архитектурном уровне.

Все четыре модели обрабатывают входные изображения с переменным соотношением сторон и настраиваемыми бюджетами визуальных токенов — это существенное улучшение по сравнению со старым кодировщиком Gemma 3n, который испытывал трудности с распознаванием текста и пониманием документов. Новый кодировщик поддерживает бюджеты от 70 до 1120 токенов на изображение, позволяя разработчикам выбирать между детализацией и вычислительной мощностью в зависимости от задачи.

Меньшие бюджеты используются для классификации и создания подписей; большие бюджеты — для распознавания текста, анализа документов и детального визуального анализа. Поддерживается ввод нескольких изображений и видео (обрабатываемых как последовательности кадров), что позволяет проводить визуальный анализ нескольких документов или скриншотов.

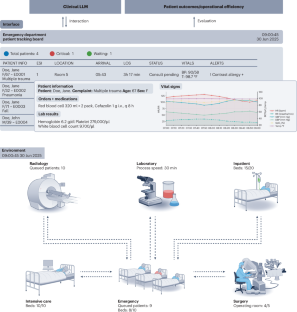

В двух моделях для периферийных устройств добавлена встроенная обработка звука — автоматическое распознавание речи и преобразование речи в переведенный текст, все на устройстве. Аудиокодер был сжат до 305 миллионов параметров по сравнению с 681 миллионом в Gemma 3n, а длительность кадра сократилась со 160 мс до 40 мс для более быстрой транскрипции. Для команд, разрабатывающих приложения с приоритетом на голосовое управление, которым необходимо хранить данные локально — например, в здравоохранении, выездном обслуживании или многоязычном взаимодействии с клиентами — запуск ASR, перевода, логического вывода и вызова функций в одной модели на телефоне или периферийном устройстве является настоящим архитектурным упрощением.

Вызов функций также реализован во всех четырех моделях изначально, благодаря исследованиям, проведенным Google в рамках выпуска FunctionGemma в конце прошлого года. В отличие от предыдущих подходов, которые полагались на следование инструкциям для управления моделями в процессе структурированного использования инструментов, функция вызова функций в Gemma 4 была заложена в модель с нуля — оптимизирована для многоэтапных агентных потоков с использованием нескольких инструментов. Это видно в тестах производительности агентов, но, что более важно, это снижает затраты на оперативное проектирование, которые обычно вкладывают корпоративные команды при создании агентов, использующих инструменты.

Сравнительные показатели в контексте: какое место занимает Gemma 4 на переполненном рынке.

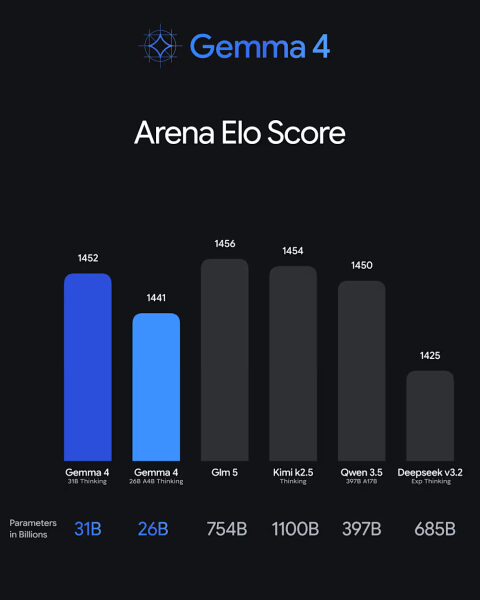

Результаты бенчмарков наглядно демонстрируют улучшение по сравнению с предыдущим поколением. Модель 31B dense набирает 89,2% в AIME 2026 (строгий тест на математическое мышление), 80,0% в LiveCodeBench v6 и достигает рейтинга ELO 2150 на Codeforces — показатели, которые еще недавно были бы на уровне проприетарных моделей. В тестах на машинное зрение MMMU Pro достигает 76,9%, а MATH-Vision — 85,6%.

Для сравнения, Gemma 3 27B набрала 20,8% в тесте AIME и 29,1% в тесте LiveCodeBench без режима обдумывания.

Модель MoE демонстрирует близкие результаты: 88,3% на AIME 2026, 77,1% на LiveCodeBench и 82,3% на GPQA Diamond — бенчмарке для оценки научного мышления на уровне аспирантуры. Разница в производительности между MoE и плотными вариантами невелика, учитывая значительное преимущество архитектуры MoE в плане стоимости вывода.

Модели Edge превосходят ожидания в своей ценовой категории. E4B показывает 42,5% в AIME 2026 и 52,0% в LiveCodeBench — это высокий результат для модели, работающей на графическом процессоре T4. E2B, еще меньшая по размеру, демонстрирует 37,5% и 44,0% соответственно. Обе модели значительно превосходят Gemma 3 27B (без особых усилий) в большинстве бенчмарков, несмотря на то, что они значительно меньше по размеру, благодаря встроенной функции логического анализа.

Эти цифры необходимо рассматривать в контексте все более конкурентной среды с открытыми параметрами. Qwen 3.5, GLM-5 и Kimi K2.5 активно конкурируют в этом диапазоне параметров, и эта область быстро развивается. Gemma 4 отличается не столько каким-либо одним бенчмарком, сколько его сочетанием: надежная логика, встроенная мультимодальность для текста, изображений и звука, вызов функций, контекст 256K и действительно разрешительная лицензия — и все это в рамках одного семейства моделей с вариантами развертывания от периферийных устройств до облачных бессерверных вычислений.

На что следует обратить внимание корпоративным командам в будущем?

Google выпускает как предварительно обученные базовые модели, так и варианты, оптимизированные по инструкциям, что важно для организаций, планирующих тонкую настройку для конкретных областей. Базовые модели Gemma исторически являлись прочной основой для пользовательского обучения, а лицензия Apache 2.0 теперь устраняет любую неопределенность в отношении возможности коммерческого использования оптимизированных производных моделей.

Возможность развертывания без использования серверов через Cloud Run с поддержкой GPU заслуживает внимания команд, которым требуется масштабируемая до нуля вычислительная мощность для выполнения инференции. Оплата только за фактические вычислительные ресурсы во время инференции — вместо поддержания постоянно работающих экземпляров GPU — может существенно изменить экономику развертывания открытых моделей в производственной среде, особенно для внутренних инструментов и приложений с низкой нагрузкой.

Google намекнула, что это может быть не вся линейка моделей Gemma 4, и, вероятно, появятся модели других размеров. Но доступная сегодня комбинация — модели рассуждений для рабочих станций и многомодальные модели для периферийных устройств, все на основе Apache 2.0 и исследований Gemini 3 — представляет собой наиболее полную открытую модель, выпущенную Google. Для корпоративных команд, которые ждали, когда открытые модели Google смогут конкурировать по условиям лицензирования, а также по производительности, оценка наконец-то может начаться без предварительного обращения в юридический отдел.

Подпишитесь, чтобы получать самые свежие новости!

Подробные аналитические данные для руководителей предприятий в области искусственного интеллекта, данных и безопасности.

Отправляя свой адрес электронной почты, вы соглашаетесь с нашими Условиями использования и Политикой конфиденциальности.

Получайте обновления ! Вы подписаны! Наши последние новости скоро поступят на вашу электронную почту.

Источник: venturebeat.com