Google строит новые архитектуры AI на идеях российских учёных.

Одна из ключевых проблем нейросетей — ограниченное контекстное окно: чем длиннее входной текст, тем хуже модель удерживает информацию из ранних фрагментов.

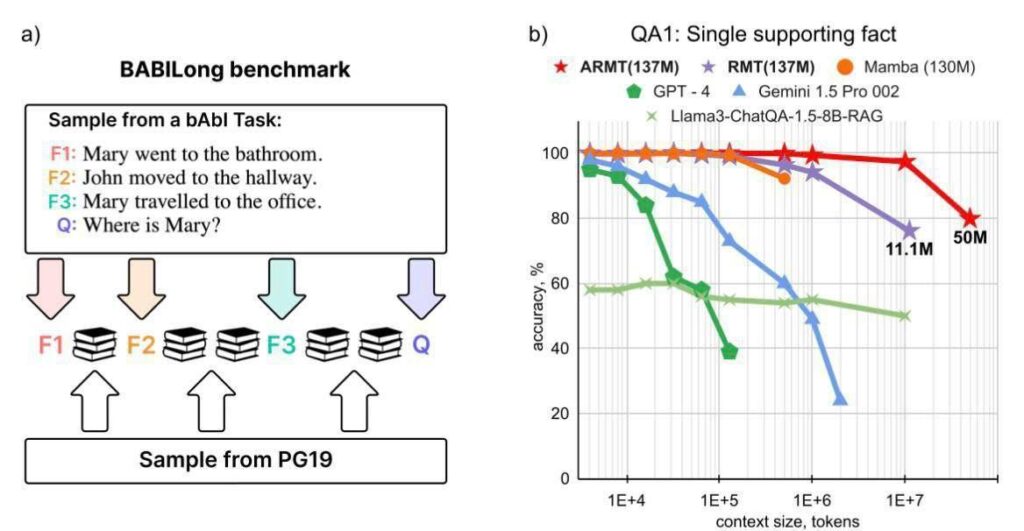

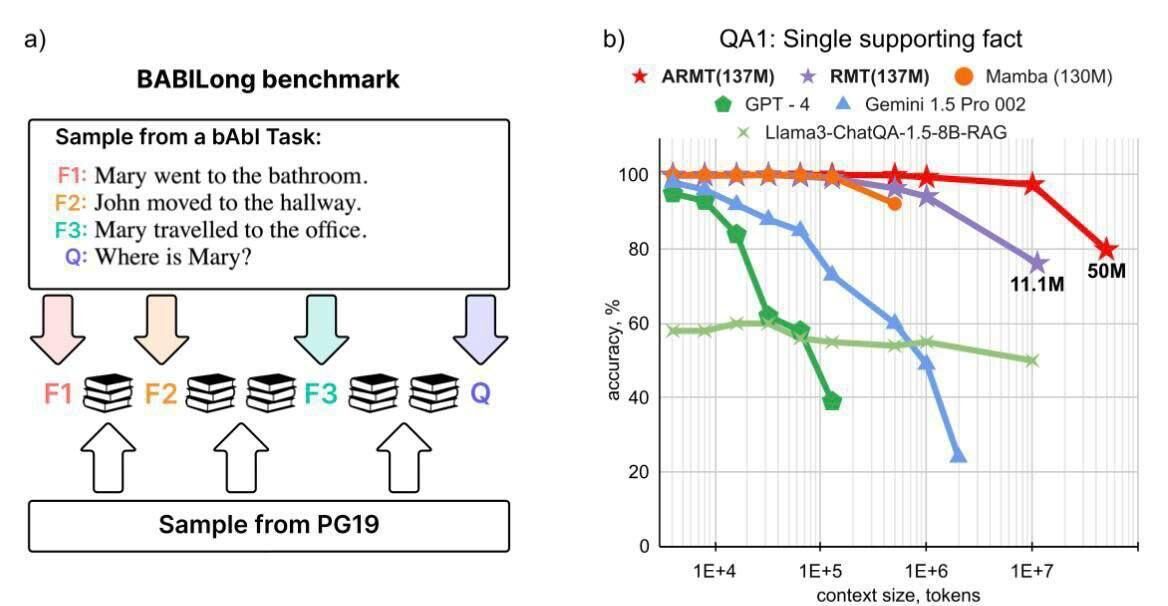

В 2020–2022 годах исследователи из российского института AIRI (Куратов, Булатов, Бурцев) предложили решение — Recurrent Memory Transformer с токенами памяти, которые позволяют передавать информацию между сегментами длинного текста. Это позволяет масштабировать контекст до миллионов токенов без квадратичного роста вычислений.

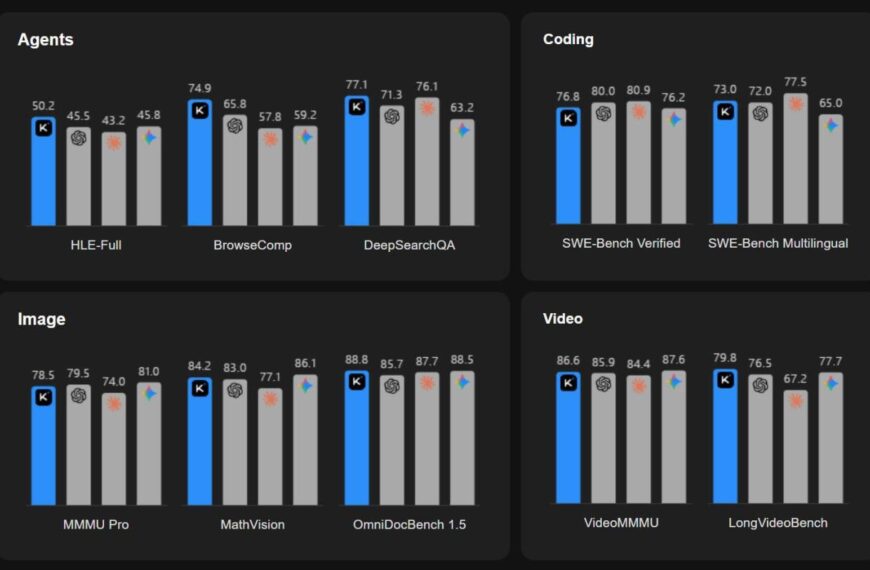

Google цитирует эти работы напрямую в своей архитектуре Titans, а бенчмарк BABILong от той же команды стал стандартом для оценки работы моделей с длинным контекстом.

Суммарно — 800+ цитирований. Фундамент для одного из ключевых направлений Google Research заложили в Москве 🐘