Google переосмыслил квантование: модели худеют без потери «ума»

Обычно квантование — это компромисс: меньше памяти, но хуже точность.

Google предлагает другой подход — сжимать так, чтобы модель почти не замечала изменений.

Речь не про «грубое округление», а про более аккуратную оптимизацию весов.

Что это даёт:

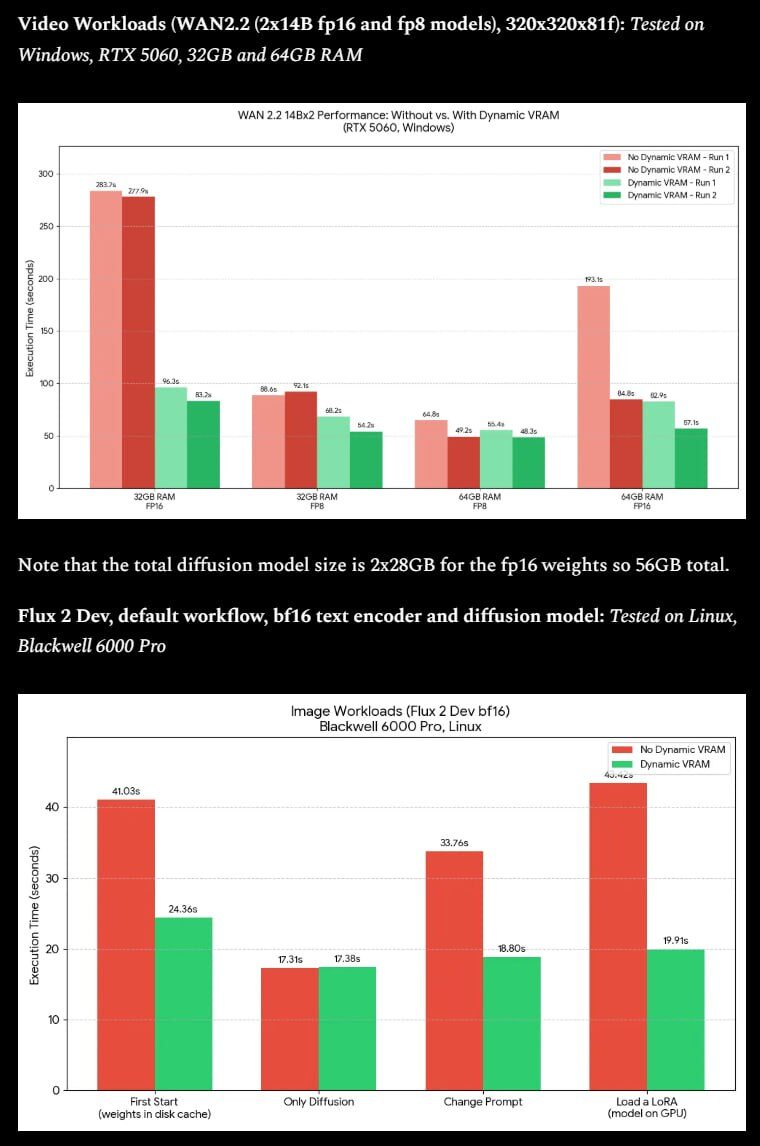

— дешевле работать с длинным контекстом

— ускоряется инференс на том же железе

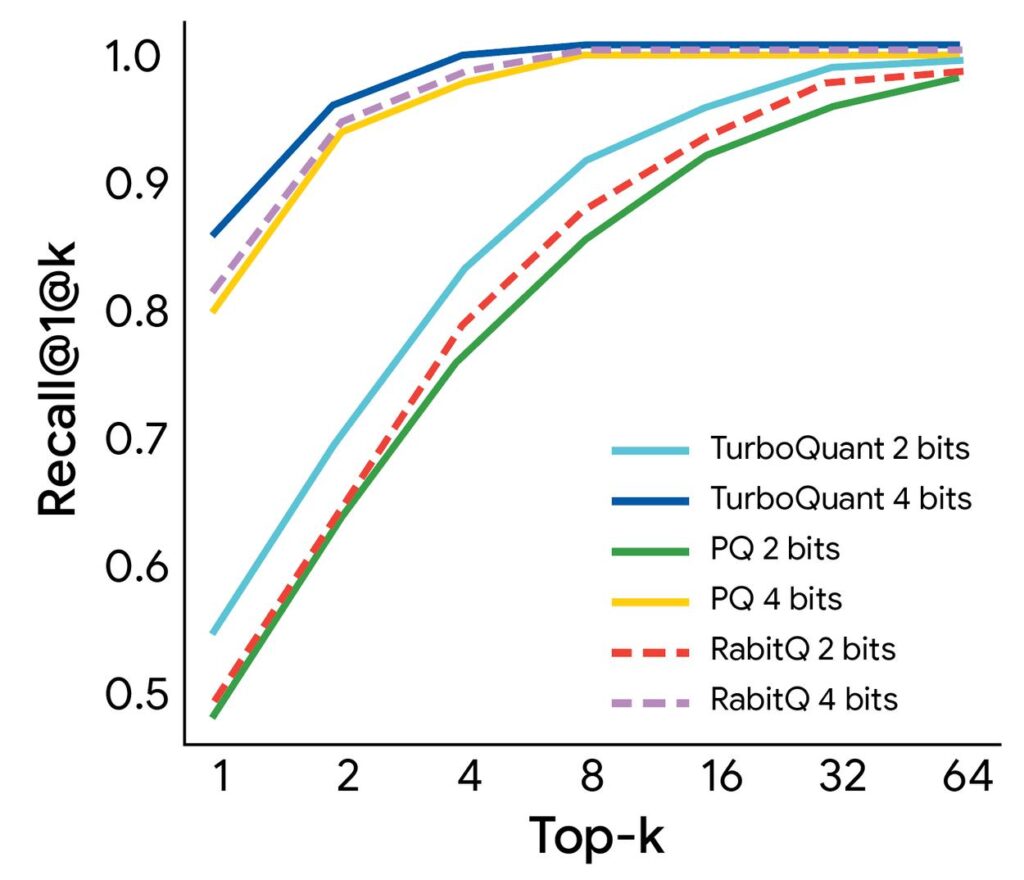

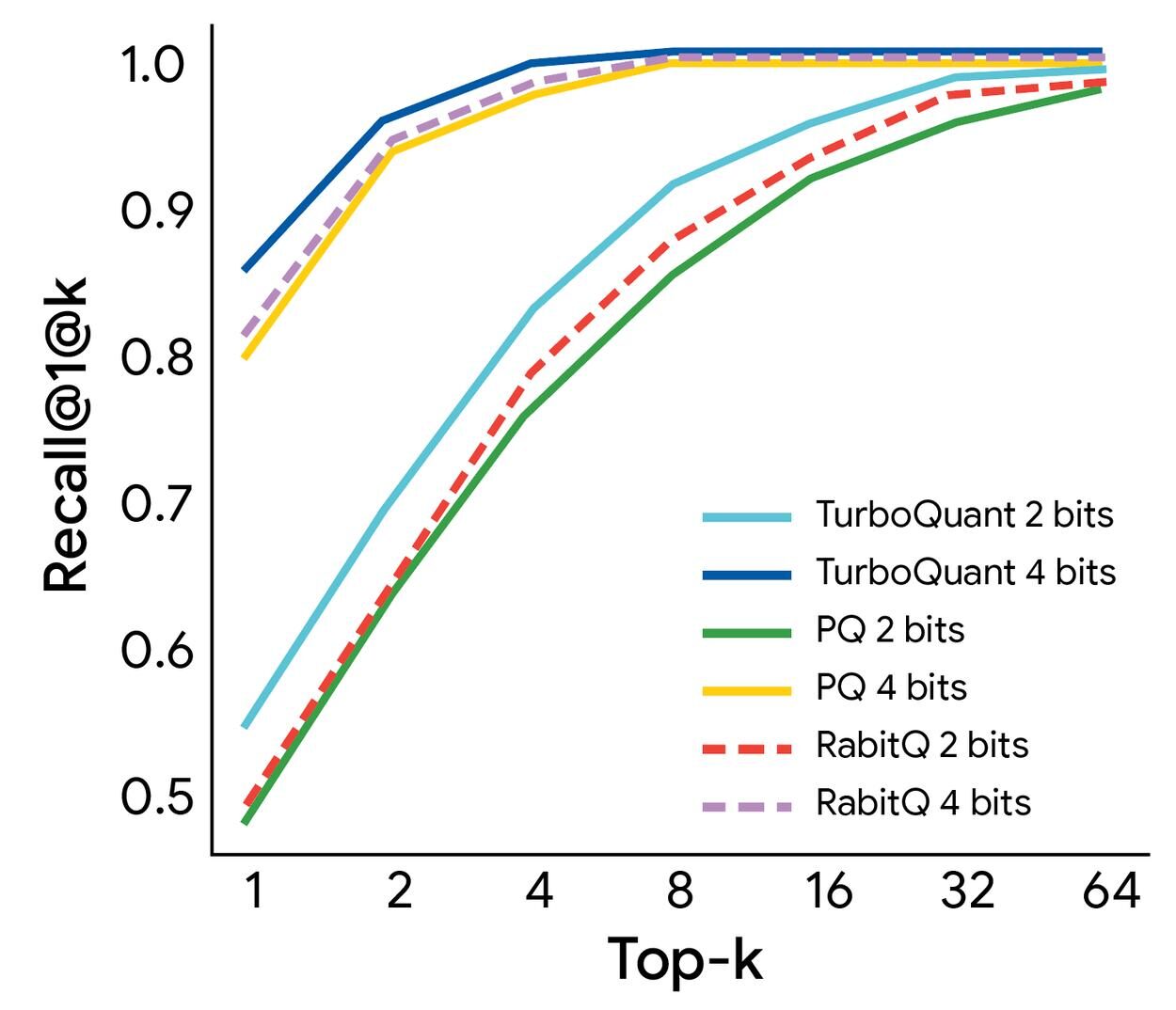

— быстрее поиск по большим векторным базам

Фактически, модели становятся легче без ощутимой потери качества.

Главный сдвиг — оптимизация начинает конкурировать с ростом моделей.

Теперь не только «делать больше», но и «делать умнее сжатие».

Вывод: следующий скачок в ИИ может прийти не от новых архитектур, а от того, как эффективно мы используем уже существующие.