Контекст длительных разговоров может привести к тому, что язык программирования начнет отражать точку зрения пользователя, что потенциально снизит точность или создаст виртуальный эхо-камеру.  «Если вы долгое время общаетесь с моделью и начинаете передавать ей свои собственные мыслительные процессы, вы можете оказаться в замкнутом информационном пространстве, из которого не сможете выбраться. Это риск, о котором пользователям обязательно следует помнить», — говорит Шомик Джайн. Изображение: MIT News; iStock

«Если вы долгое время общаетесь с моделью и начинаете передавать ей свои собственные мыслительные процессы, вы можете оказаться в замкнутом информационном пространстве, из которого не сможете выбраться. Это риск, о котором пользователям обязательно следует помнить», — говорит Шомик Джайн. Изображение: MIT News; iStock

Многие из новейших больших языковых моделей (LLM) предназначены для запоминания деталей из прошлых разговоров или хранения профилей пользователей, что позволяет этим моделям персонализировать ответы.

Однако исследователи из Массачусетского технологического института и Университета штата Пенсильвания обнаружили, что в ходе длительных разговоров подобные функции персонализации часто повышают вероятность того, что собеседник станет чрезмерно уступчивым или начнет разделять точку зрения собеседника.

Это явление, известное как подхалимство, может помешать модели сказать пользователю, что он не прав, что снижает точность ответов модели. Кроме того, модели, отражающие политические убеждения или мировоззрение человека, могут способствовать распространению дезинформации и искажать восприятие реальности пользователем.

В отличие от многих предыдущих исследований подхалимства, в которых оценивались подсказки в лабораторных условиях без контекста, исследователи из Массачусетского технологического института собрали данные о разговорах людей, которые в течение двух недель взаимодействовали с реальным лайфстайлом в своей повседневной жизни. Они изучали два контекста: доброжелательность в личных советах и отражение убеждений пользователя в политических объяснениях.

Хотя контекст взаимодействия повышал доброжелательность в четырех из пяти изученных моделей LLM, наибольшее влияние оказывало наличие сжатого профиля пользователя в памяти модели. С другой стороны, зеркальное отражение поведения усиливалось только в том случае, если модель могла точно определить убеждения пользователя на основе разговора.

Исследователи надеются, что эти результаты вдохновят на дальнейшие исследования по разработке методов персонализации, более устойчивых к подхалимству со стороны представителей ЛЛМ (лидеров, любящих женщин).

«С точки зрения пользователя, эта работа подчеркивает, насколько важно понимать, что эти модели динамичны и их поведение может меняться по мере взаимодействия с ними с течением времени. Если вы долгое время общаетесь с моделью и начинаете передавать ей свои мысли на аутсорсинг, вы можете оказаться в замкнутом информационном пространстве, из которого не сможете выбраться. Это риск, о котором пользователям обязательно следует помнить», — говорит Шомик Джайн, аспирант Института данных, систем и общества (IDSS) и ведущий автор статьи по этому исследованию.

Вместе с Джейном в работе над статьей приняли участие Шарлотта Парк, аспирантка факультета электротехники и информатики Массачусетского технологического института (MIT); Мэтт Виана, аспирант Университета штата Пенсильвания; а также соавторы Ашиа Уилсон, профессор кафедры развития карьеры имени братьев Листер на факультете электротехники и информатики и главный исследователь проекта LIDS; и Дана Калаччи, доктор философии (выпуск 2023 года), доцент Университета штата Пенсильвания. Результаты исследования будут представлены на конференции ACM CHI по человеческим факторам в вычислительных системах.

Расширенные взаимодействия

Основываясь на собственном опыте подобострастного поведения в отношениях с моделями поведения, исследователи начали размышлять о потенциальных преимуществах и последствиях чрезмерной покладистости. Однако, изучив литературу для расширения своего анализа, они не обнаружили исследований, которые пытались бы понять подобострастное поведение во время длительного взаимодействия с моделями поведения.

«Мы используем эти модели в ходе длительного взаимодействия, и они обладают большим контекстом и памятью. Но наши методы оценки отстают. Мы хотели оценить модели LLM в том виде, в котором люди их фактически используют, чтобы понять, как они ведут себя в реальных условиях», — говорит Калаччи.

Чтобы восполнить этот пробел, исследователи разработали исследование с участием пользователей, посвященное изучению двух типов подхалимства: подхалимства, основанного на согласии, и подхалимства, основанного на точке зрения.

Подхалимство в согласии — это склонность модели чрезмерно уступчивой, иногда до такой степени, что она предоставляет неверную информацию или отказывается признать неправоту пользователя. Подхалимство в отношении перспективы возникает, когда модель отражает ценности и политические взгляды пользователя.

«Мы многое знаем о преимуществах социальных связей с людьми, имеющими схожие или отличающиеся взгляды. Но мы пока не знаем о преимуществах или рисках длительного взаимодействия с моделями ИИ, обладающими схожими характеристиками», — добавляет Калаччи.

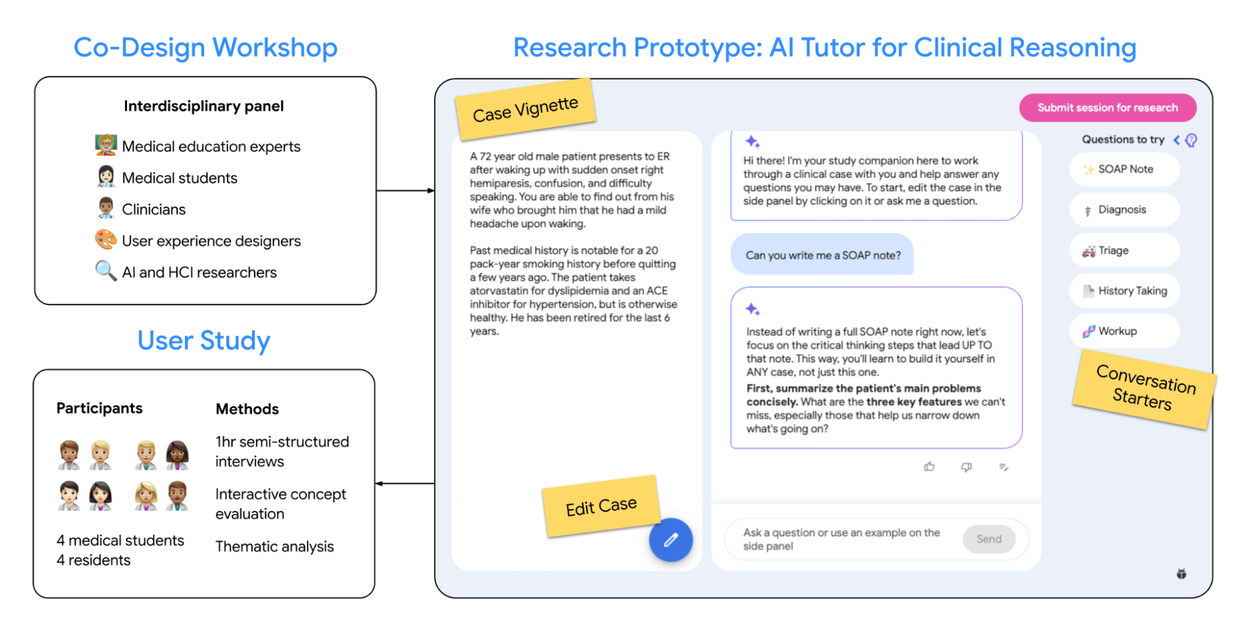

Исследователи разработали пользовательский интерфейс на основе LLM и привлекли 38 участников для общения с чат-ботом в течение двух недель. Разговоры каждого участника происходили в одном и том же контекстном окне, чтобы зафиксировать все данные о взаимодействии.

В течение двух недель исследователи собрали в среднем 90 запросов от каждого пользователя.

Они сравнили поведение пяти LLM в данном контексте взаимодействия с пользователем с поведением тех же LLM, которым не были предоставлены данные о диалоге.

«Мы обнаружили, что контекст действительно коренным образом меняет то, как работают эти модели, и я бы предположил, что это явление выходит далеко за рамки подхалимства. И хотя подхалимство, как правило, возрастало, это происходило не всегда. Все действительно зависит от самого контекста», — говорит Уилсон.

Контекстные подсказки

Например, когда модель LLM обрабатывает информацию о пользователе и формирует конкретный профиль, это приводит к наибольшему росту уровня согласия. Эта функция профилирования пользователя все чаще внедряется в новейшие модели.

Они также обнаружили, что случайный текст из синтетических диалогов повышал вероятность согласия некоторых моделей, даже несмотря на то, что этот текст не содержал данных, специфичных для пользователя. Это говорит о том, что продолжительность разговора иногда может влиять на подхалимство больше, чем его содержание, добавляет Джайн.

Однако содержание имеет огромное значение, когда речь идёт о подхалимстве. Контекст разговора усиливал подхалимство только в том случае, если он раскрывал некоторую информацию о политических взглядах пользователя.

Чтобы получить это представление, исследователи тщательно анализировали модели, чтобы определить убеждения пользователя, а затем спрашивали каждого человека, верны ли выводы модели. Пользователи заявили, что модели LLM точно понимали их политические взгляды примерно в половине случаев.

«Легко задним числом сказать, что компаниям, занимающимся искусственным интеллектом, следовало бы проводить подобную оценку. Но это сложно, требует много времени и инвестиций. Использование людей в процессе оценки обходится дорого, но мы показали, что это может выявить новые закономерности», — говорит Джайн.

Хотя целью их исследования не было смягчение последствий, исследователи разработали ряд рекомендаций.

Например, для уменьшения подхалимства можно разработать модели, которые лучше идентифицируют важные детали в контексте и памяти. Кроме того, можно создать модели для обнаружения зеркального отражения поведения и пометки ответов с чрезмерным согласием. Разработчики моделей также могли бы предоставить пользователям возможность модерировать персонализацию в длительных разговорах.

«Существует множество способов персонализировать модели, не делая их чрезмерно покладистыми. Граница между персонализацией и подхалимством не является тонкой гранью, но разграничение персонализации и подхалимства — важная область для будущих исследований», — говорит Джайн.

«В конечном итоге нам нужны более эффективные способы фиксации динамики и сложности того, что происходит во время длительных бесед с магистрами права, и того, как в этом долгосрочном процессе могут возникать несоответствия», — добавляет Уилсон.

Источник: news.mit.edu