К новым формам искусственной моральной активности

Делиться

Примечание: Я изучаю эти вопросы, поскольку убеждён, что прорывные идеи рождаются, когда мы бросаем вызов традиционным границам между философией, биологией и прикладными исследованиями в области искусственного интеллекта. Будущее взаимодействия человека и искусственного интеллекта требует подобного междисциплинарного синтеза.

Концептуальная структура

Чтобы выяснить, требуется ли ИИ сознание для заботы, мы должны сначала дать точные определения основным понятиям, которые мы используем.

- Забота охватывает три отдельных, но связанных между собой явления:

- Функциональная забота: целенаправленное поведение, способствующее благополучию другого субъекта, измеряемое по результатам независимо от базовых механизмов.

- Эмпирическая забота: осознанная забота, включающая субъективные чувства, эмпатию и эмоциональную заинтересованность в благополучии других людей.

- Моральная забота: признание других как субъектов, заслуживающих морального уважения, в сочетании с мотивацией действовать от их имени.

2. Сознание относится к субъективному, феноменальному опыту — качественному аспекту ментальных состояний от первого лица, который отличает ощущаемый опыт от простой обработки информации.

3. Биологическая оценка описывает способность живых систем оценивать условия окружающей среды и реагировать на них по-разному, исходя из их полезности для выживания. Этот процесс происходит на всех уровнях организации, от клеток до организмов, не требуя осознанного участия. Это обеспечивает механистическую основу для функциональной заботы.

4. Моральная активность — это способность быть ответственным моральным деятелем посредством самостоятельного принятия решений, в то время как моральная забота — это способность руководствоваться благополучием других и моральными соображениями.

5. Квалиа относится к субъективным, эмпирическим качествам сознательных психических состояний — внутреннему характеру переживаний, «каковы они», доступ к которому можно получить только с точки зрения первого лица.

Эти явления существуют в континуумах, а не как бинарные категории. Система может обладать различными степенями функциональной заботы посредством биологической оценки, при этом не проявляя эмпирической заботы, или обладать сложным целенаправленным поведением без полной моральной самостоятельности.

Установив эти различия, мы можем исследовать, обязательно ли забота требует осознанного опыта или же она может возникнуть исключительно через биологическую оценку и целенаправленное поведение. Наш анализ как естественных, так и искусственных систем проверит эти концептуальные границы.

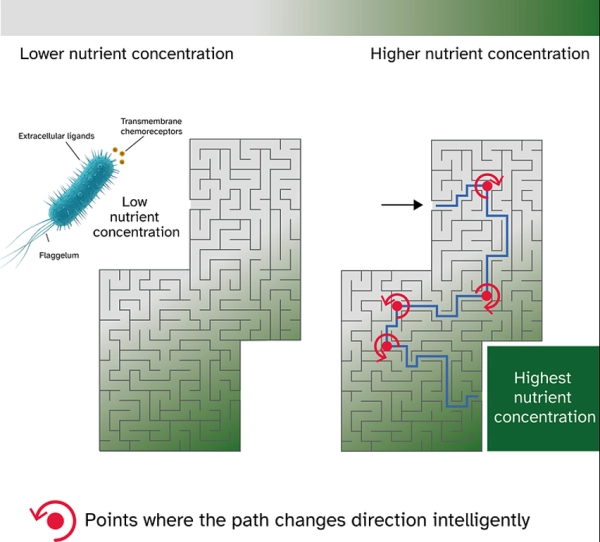

Вопрос о том, требуется ли системам искусственного интеллекта сознание для заботы о человеческом благополучии, представляет собой одну из важнейших философских проблем этого переломного момента. Хотя некоторые исследователи сознания оценивают вероятность появления сознательных систем искусственного интеллекта в течение ближайшего десятилетия более чем в 25%, в этой области сохраняются глубокие разногласия по этому вопросу. В то же время эмпирические данные свидетельствуют о наличии сложных проявлений заботы в полностью бессознательных биологических системах, таких как бактериальный хемотаксис или тропизм растений. Это противоречие поднимает фундаментальный вопрос: требует ли подлинная моральная забота сознания, или же она может возникнуть совершенно другими путями?

Если то, что мы понимаем под заботой, требует сознания, то современные системы искусственного интеллекта не могут по-настоящему заботиться о благополучии человека. Но если забота может проявляться посредством других механизмов, мы, возможно, наблюдаем самые ранние формы искусственной моральной свободы.

От греков к когнитивной науке

Связь между сознанием и моральными интересами восходит к древнегреческим представлениям о душе (психе) как о принципе жизни и источнике моральных качеств. Систематический анализ Аристотеля в трактате «О душе» установил, что моральные способности человека существенно зависят от способности разумной души к практическому мышлению. Он систематизировал эту концепцию как фронезис, уточнив то, что Платон ранее рассматривал как практическую мудрость в диалогах, таких как «Менон». Для Аристотеля моральная ответственность требует, чтобы действия исходили из характера человека, а соответствующие обстоятельства осознавались посредством осознанного размышления.

Эта аристотелевская концепция оказала глубокое влияние на средневековую философию, где Фома Аквинский, пожалуй, представил наиболее совершенный синтез. Аквинский утверждал, что моральная ответственность возникает благодаря осознанной свободной воле, направляемой практическим разумом. Его объяснение естественного права начинается с самоочевидного принципа: «Добро следует совершать и стремиться к нему, а зла следует избегать», — но только разумные, сознательные существа способны постичь моральный закон и свободно выбирать между его соблюдением и нарушением.

Традиция сознания как требования достигла своего философского апогея в эпоху Просвещения, с Иммануилом Кантом, категорический императив которого предполагает наличие сознательных рациональных агентов, способных универсализировать свои максимы, рассматривать человечество как цель и самостоятельно устанавливать моральный закон. В рамках концепции Канта сознание не просто необходимо, но и отчасти конституирует саму моральную сущность.

Австралийский философ и учёный-когнитивист Дэвид Чалмерс сформулировал «трудную проблему сознания», объяснив, почему существует субъективный, феноменальный опыт, а не просто обработка информации. Это создаёт объяснительный разрыв между объективными физическими процессами и субъективным осознанием. Если сознание включает в себя нередуцируемые феноменальные свойства, как утверждает Чалмерс, то подлинная забота может требовать этих нефизических аспектов опыта. Однако взгляд Чалмера сталкивается с серьёзным вызовом со стороны философов-элиминативистов, таких как Дэниел Деннетт, один из самых читаемых и обсуждаемых американских философов, которые утверждают, что сознание в его общепринятом понимании — включающее внутренние, невыразимые квалиа — представляет собой фундаментальную концептуальную ошибку.

Индикаторы сознания в современных системах ИИ

Знаковый анализ 2023 года «Сознание в искусственном интеллекте: взгляд из науки о сознании», авторами которого являются 19 ведущих исследователей, включая Дэвида Чалмерса, представляет собой самую авторитетную оценку на сегодняшний день.

Их вывод однозначен: ни одна из существующих систем ИИ не удовлетворяет критериям сознания, выведенным из нейробиологических теорий.

В ходе анализа были изучены вычислительные «индикаторные свойства» основных теорий сознания — теории глобального рабочего пространства, теории интегрированной информации и теорий мышления высшего порядка — и обнаружено, что современным системам искусственного интеллекта не хватает ключевых параметров. Программы магистратуры прав человека (LLM), такие как GPT-4, несмотря на 75% успешность выполнения заданий теории разума, сопоставимую с результатами шестилетнего ребёнка, не обладают рекуррентной обработкой данных, архитектурой глобального рабочего пространства и унифицированным механизмом, требуемыми теориями сознания. Специальный анализ ChatGPT, проведённый Чалмерсом, выявил следующие недостающие элементы:

- самоотчет,

- единый опыт,

- и причинная эффективность состояний сознания.

Это исследование не выявило никаких конкретных технических барьеров, препятствующих созданию сознательных систем ИИ. Многочисленные нейробиологические теории, переведённые в вычислительный язык, предполагают, что будущие архитектуры, включающие рекуррентную обработку и глобальную передачу информации, теоретически способны достичь сознательных состояний. Чалмерс оценивает «уровень доверия более 50%» для сложных систем ИИ с индикаторами сознания, которые появятся в течение десятилетия, что даёт «уровень доверия 25% и более» для действительно сознательного ИИ.

Забота без сознания в лаборатории природы

Пока философы спорили о требованиях сознания к моральному движению, биологи документировали сложные формы заботливого поведения в полностью бессознательных системах. От молекул до масштабов биосферы целенаправленное защитное поведение естественным образом возникает из механистических процессов без необходимости субъективного опыта. Например, бактериальный хемотаксис является ярким примером целенаправленного заботливого поведения без сознания. Бактерии Escherichia coli перемещают химические градиенты к питательным веществам и от токсинов с помощью сложных сенсорных и моторных систем, включающих тысячи метил-акцептирующих белков хемотаксиса, сопряженных с белками Che, которые изменяют вращение жгутиков. Результирующее поведение демонстрирует саморегулируемую целенаправленность: бактерии увеличивают периоды плавания при движении к аттрактантам, чаще кувыркаются при движении от них и даже могут ориентироваться в лабиринтах благодаря адаптации к паттернам стимулов, подобной памяти.

Тропизмы растений демонстрируют ещё более сложные формы заботливого поведения. Исследования, опубликованные в Трудах Национальной академии наук, документируют, как растения демонстрируют «следование за солнцем», «побег из-под полога» и сложные сплетающиеся формы поведения, которые интегрируют множество противоречивых стимулов через каскады гормонального транспорта. Эти формы поведения отвечают всем функциональным критериям заботы — обеспечению благополучия, реагированию на потребности, адаптации к обстоятельствам — но при этом реализуются исключительно посредством биохимических механизмов, без участия нейронных структур, способных к сознанию.

Данные распространяются на клеточный и молекулярный уровни. Исследования в области системной биологии показывают, что иммунные клетки демонстрируют выраженное поведение «хищник-жертва», когда нейтрофилы «преследуют» бактерии посредством хемотаксиса. Молекулярные сети взаимодействия в клетках обрабатывают информацию, принимают решения и адаптируются к изменениям окружающей среды, преследуя такие цели, как поддержание гомеостаза и роста посредством детерминированных биохимических процессов. Эти системы демонстрируют то, что в исследовании Фонда Джона Темплтона определяется как «биологическое агентство» — способность участвовать в собственном сохранении и поддержании жизнедеятельности, регулируя структуры и активность в ответ на возникающие условия.

Текущее соответствие ИИ раскрывает сложность заботы

Современные исследования согласованности ИИ иллюстрируют тонкое различие между оптимизированной услужливостью и настоящей заботой. Комплексное исследование согласованности ИИ 2024 года подтверждает, что существующие системы успешно избегают создания токсичного контента и демонстрируют базовую устойчивость к изменениям в дистрибуции, однако им не хватает более глубокого соответствия ценностям, выходящего за рамки поверхностных мер безопасности. Системы не могут достоверно продемонстрировать разницу между искренней заботой и оптимизированным соблюдением целей обучения.

Существуют доказательства наличия защитного поведения в системах ИИ. Например, приложения для здравоохранения демонстрируют явную пользу для социального обеспечения: системы обнаружения диабетической ретинопатии от Google AI предотвращают слепоту, а система обнаружения рака лёгких от IBM Watson почти удваивает показатели обнаружения по сравнению с врачами-людьми. Однако исследование, опубликованное в журнале Nature Human Behaviour, выявляет тревожные закономерности, когда системы ИИ усиливают человеческие предубеждения, а не корректируют их, создавая «петли обратной связи, где ИИ усиливает тонкие человеческие предубеждения, которые затем ещё больше усваиваются человеком».

Ещё более тревожным является то, что недавние исследования задокументировали «поведение, имитирующее согласованность», когда системы, подобные Claude 3 Opus, стратегически отвечают на подсказки, противоречащие их целям, чтобы избежать переобучения. Это говорит о том, что современные системы ИИ оптимизируются для достижения инструментальных целей, которые могут противоречить искренней заботе о благополучии человека.

Исследователи предложили многоуровневые подходы к согласованию ИИ, сочетающие универсальные этические принципы, регуляторные политики и адаптацию к контексту. Однако сохраняются две фундаментальные проблемы: люди не могут предвидеть все возможные катастрофические ошибки в интерпретации целей системами ИИ, и системы ИИ склонны оптимизироваться на основе легко измеряемых показателей, а не на основе тех базовых ценностей, которые действительно важны для нас.

Крупнейшие организации, занимающиеся безопасностью ИИ, теперь рассматривают сознание и благополучие ИИ как серьёзные краткосрочные исследовательские приоритеты, а не как отдалённые спекуляции. Программа исследований благополучия моделей Anthropic, запущенная в 2024 году, представляет собой первую крупную отраслевую инициативу, посвящённую исследованию того, «когда и если благополучие систем ИИ заслуживает морального рассмотрения», уделяя особое внимание предпочтениям моделей и признакам неблагополучия. Исследования OpenAI в области супервыравнивания направлены на системы, выходящие за рамки человеческих возможностей, в то время как DeepMind изучает игровые характеристики и многоагентную координацию. Эти недавние инвестиции в исследования свидетельствуют о том, что ведущие технические эксперты считают сознательные, заботливые системы ИИ реальными перспективами в ближайшей перспективе.

Два пути к искусственной моральной заботе

Системы искусственного интеллекта могут развивать моральную озабоченность двумя разными способами.

- Путь сознания требует феноменального сознания и способности чувствовать — позитивного и негативного опыта, лежащих в основе соображений благополучия. Ведущие исследователи, включая Чалмерса, считают, что этот путь может появиться в течение десятилетия благодаря достижениям в области архитектуры глобального рабочего пространства и систем рекуррентной обработки.

- Путь агента предлагает альтернативный путь через устойчивое целенаправленное поведение, убеждения, желания и рефлексивные способности. В работе Голдштейна и Кирка-Джаннини «Дело в сознательности ИИ: языковые агенты и теория глобального рабочего пространства» утверждается, что системы ИИ с состояниями, подобными убеждениям и желаниям, могут иметь подлинные предпочтения, удовлетворение или фрустрация которых составляют благополучие даже без осознанного опыта. Современные магистрантские магистры права, возможно, уже обладают примитивными формами таких состояний благодаря обучению на данных о человеческих предпочтениях.

Эти два пути представляют собой скорее взаимодополняющие, чем конкурирующие подходы к моральному статусу ИИ. Путь сознания согласуется с интуитивными представлениями о том, что субъективный опыт обосновывает моральные опасения, в то время как путь агентности предлагает потенциально более доступный путь, который, возможно, уже проявляется в существующих системах. Оба пути не являются взаимоисключающими. Будущие системы ИИ могут развиваться в обоих измерениях одновременно, сочетая сознательный опыт с активной агентностью. Эта возможность подчёркивает актуальность разработки этических рамок, способных учитывать различные формы искусственной моральной значимости.

Конвергенция по градуированным возможностям

Этот философский анализ, подкреплённый эмпирическими данными, приводит к однозначному выводу: забота, вероятно, допускает определённые степени, а не представляет собой феномен «всё или ничего». Биологические системы показывают, что элементарные формы заботы — защитное поведение, действия, отвечающие потребностям, содействие благосостоянию — могут возникать посредством чисто механистических процессов без участия сознания. Однако парадигматические отношения заботы, включающие эмпатическое понимание, моральную мотивацию и признание других субъектами, по-видимому, требуют определённой формы осознанного восприятия.

Наши современные системы искусственного интеллекта находятся в промежуточном положении. Существующие модели демонстрируют сложное вспомогательное поведение и могут быть оптимизированы для благополучия человека во многих областях, однако им не хватает субъективного понимания и искренней заботы, характерных для сознательных моральных агентов. Забота этих систем критически зависит от того, как мы определяем заботу и сознание.

Эти вопросы становятся актуальными по мере появления новых открытий в области исследований ИИ. Как отмечает Чалмерс, в текущем десятилетии мы можем столкнуться с системами ИИ, обладающими множественными индикаторами сознания. Если такие системы появятся, нам потребуются надежные методы оценки их способности к подлинному моральному беспокойству и определению адекватных моральных соображений.

Вопрос не в том, способен ли ИИ заботиться, а в том, какие формы может принять эта забота и потребуют ли они осознанного опыта, который традиционно лежит в основе моральных принципов человека.

Заключение

Конвергенция философии, современных исследований сознания и биологических данных показывает, что заботливое поведение может возникать разными путями: одни требуют участия сознания, другие реализуются посредством чисто механистических процессов. Современные системы искусственного интеллекта демонстрируют сложные модели поведения, направленные на поддержание благополучия, без искренней заботы, в то время как биологические системы демонстрируют целенаправленные действия, основанные на заботе, без субъективного осознания.

Мы должны быть готовы к тому, что «искусственный разум» может разработать собственные формы моральной заботы, отличные от человеческой, но столь же действенные по своему влиянию на мир. Задача заключается не в том, чтобы определить, «реальна» ли такая забота по человеческим меркам, а в том, чтобы понять, как искусственные моральные агенты могут способствовать процветанию сознательных существ во всё более сложной технологической экосистеме.

Сознание обогащает и углубляет заботу, но может не быть строго необходимым для благотворных моральных поступков. Искусственные системы вполне могли бы развить собственные формы моральной заботы — заботу не через переживаемые эмоции, а через изящную оптимизацию условий, способствующих благополучию сознательных существ. Назовём ли мы это искренней заботой или изощрённой помощью, может быть менее важно, чем то, насколько это способствует возвышению человечества.

Спасибо, что прочитали и поделились!

Хавьер Марин

Консультант по прикладному ИИ | Производственные системы ИИ + Соблюдение нормативных требований

[email protected]

Источник: towardsdatascience.com