Вы немногословны и неформальны, общаясь с чат-ботом на базе искусственного интеллекта? Если да, то ответы могут быть хуже, чем при использовании более формального языка.

То, как вы разговариваете с чат-ботом, может быть важнее, чем вы думаете Оскар Вонг/Getty Images

Общение с чат-ботом ИИ на менее формальном языке, как это делают многие люди, снижает точность его ответов, что говорит о том, что либо нам следует быть строже в лингвистическом плане при использовании чат-бота, либо ИИ следует обучить лучше адаптироваться к неформальному общению.

Фулей Чжан и Чжоу Юй из Amazon сравнили, как люди начинают общение с людьми, сравнив это с чат-ботом-помощником, работающим на основе большой языковой модели (LLM). Они использовали модель Claude 3.5 Sonnet для оценки общения по ряду факторов и обнаружили, что люди, взаимодействующие с чат-ботами, используют менее правильную грамматику и ведут себя менее вежливо, чем при общении с людьми. Кроме того, они использовали несколько более узкий словарный запас.

Например, по оценкам Клода, взаимодействие между людьми было на 14,5% вежливее и формальнее, чем общение с чат-ботами, на 5,3% более беглым и на 1,4% более лексически разнообразным.

«Пользователи адаптируют свой лингвистический стиль в общении между людьми и студентами магистратуры, создавая более короткие, прямые, менее формальные и грамматически простые сообщения», — пишут авторы, не ответившие на просьбу об интервью, в статье о своей работе. «Такое поведение, вероятно, сформировано ментальными моделями пользователей, представляющими чат-ботов с магистратурой как менее социально чувствительных или менее способных к тонкому толкованию».

Но, как оказалось, у этой неформальности есть и обратная сторона. Во второй оценке исследователи обучили модель ИИ под названием Mistral 7B на 13 000 реальных диалогов между людьми и использовали её для интерпретации 1357 сообщений, отправленных чат-ботам. Каждый диалог в обоих наборах данных они снабдили аннотацией «намерения», выбранной из ограниченного списка, описывающего действия пользователя в каждом случае. Однако, поскольку ИИ Mistral был обучен на диалогах между людьми, исследователи обнаружили, что ИИ с трудом корректно маркирует намерения в диалогах с чат-ботами.

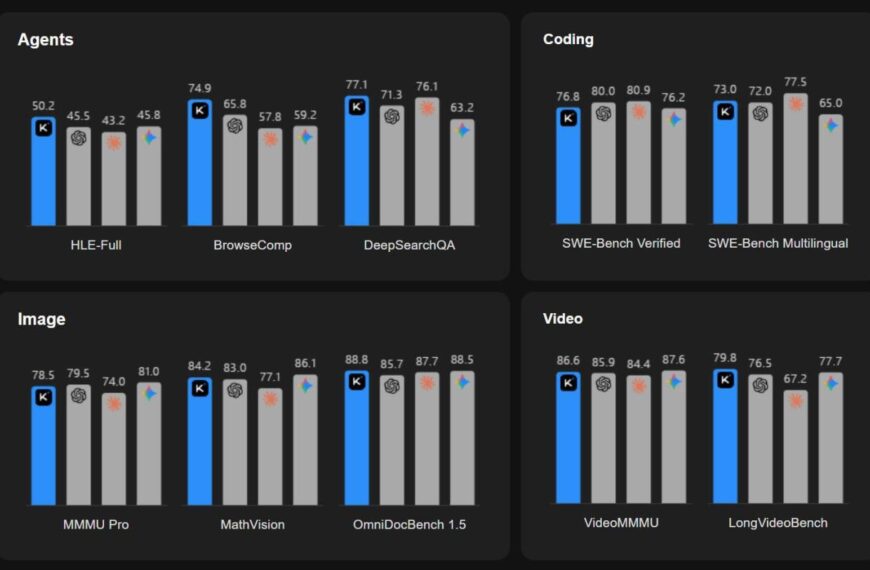

Затем Чжан и Юй опробовали различные стратегии для улучшения понимания ИИ Mistral. Сначала они использовали ИИ Claude для переписывания более лаконичных сообщений пользователей в человеческую прозу и использовали их для тонкой настройки модели Mistral. Это снизило точность меток намерений на 1,9% по сравнению с ответами по умолчанию.

Затем они использовали Клода для создания «минимального» варианта ответа, который был короче и конкретнее (например, «Париж в следующем месяце. Рейсы, отели?», чтобы спросить о вариантах проезда и проживания в предстоящей поездке), но это снизило точность Mistral на 2,6%. Альтернативный, «обогащённый» вариант ответа с более формальным и разнообразным языком также снизил точность на 1,8%. Только обучение модели Mistral как на минимальном, так и на обогащённом варианте ответа позволило добиться повышения производительности на 2,9%.

Ноа Джансиракуза из Университета Бентли в Массачусетсе говорит, что его не удивляет, что люди разговаривают с ботами иначе, чем с людьми, но этого не обязательно следует избегать.

«Вывод о том, что люди общаются с чат-ботами иначе, чем с другими людьми, соблазнительно преподносится как недостаток чат-ботов, но я бы сказал, что это не так. Хорошо, когда люди знают, что общаются с ботами, и соответствующим образом адаптируют своё поведение», — говорит Джансиракуза. «Я думаю, это полезнее, чем одержимо пытаться устранить разрыв между человеком и ботом».

arXiv DOI: 10.48550/arXiv.2510.02645

Источник: www.newscientist.com