Эта новая методика позволяет студентам магистратуры динамически корректировать объем вычислительных ресурсов, используемых для рассуждений, в зависимости от сложности вопроса.  Исследователи из MIT разработали более эффективный способ распределения вычислительных ресурсов в логической модели во время решения задачи, что повышает производительность. Изображение: MIT News; iStock

Исследователи из MIT разработали более эффективный способ распределения вычислительных ресурсов в логической модели во время решения задачи, что повышает производительность. Изображение: MIT News; iStock

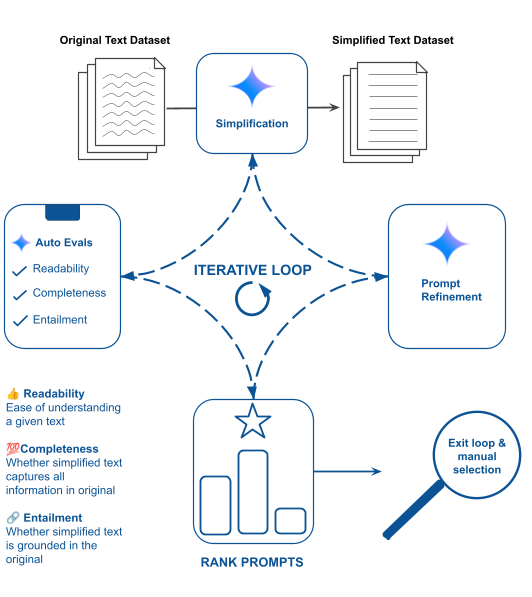

Чтобы повысить точность больших языковых моделей (БЯМ) при ответе на более сложные вопросы, исследователи могут позволить модели тратить больше времени на обдумывание потенциальных решений.

Однако распространенные подходы, предоставляющие LLM такую возможность, устанавливают фиксированный вычислительный бюджет для каждой задачи, независимо от ее сложности. Это означает, что LLM может тратить вычислительные ресурсы на более простые вопросы или быть неспособным справиться со сложными задачами, требующими более глубокого анализа.

Для решения этой проблемы исследователи из MIT разработали более эффективный способ распределения вычислительных ресурсов по мере того, как модель LLM решает задачу. Их метод позволяет модели динамически корректировать свой вычислительный бюджет в зависимости от сложности задачи и вероятности того, что каждое частичное решение приведет к правильному ответу.

Исследователи обнаружили, что их новый подход позволяет LLM-моделям использовать вдвое меньше вычислительных ресурсов, чем существующие методы, при этом достигая сопоставимой точности в ряде задач различной сложности. Кроме того, их метод позволяет меньшим, менее ресурсоемким LLM-моделям показывать такие же или даже лучшие результаты, чем более крупные модели, при решении сложных задач.

Повышая надежность и эффективность LLM, особенно при решении сложных задач логического мышления, эта технология может снизить энергопотребление систем генеративного искусственного интеллекта и позволить использовать LLM в более ответственных и требующих оперативного реагирования приложениях.

«Вычислительная стоимость вывода быстро стала серьезным узким местом для разработчиков передовых моделей, и они активно пытаются найти способы повышения вычислительной эффективности на каждый пользовательский запрос. Например, недавний релиз GPT-5.1 демонстрирует эффективность подхода «адаптивного рассуждения», предложенного в нашей статье. Наделив модели способностью знать, чего они не знают, мы можем позволить им тратить больше вычислительных ресурсов на самые сложные задачи и наиболее перспективные пути решения, и использовать гораздо меньше токенов на простые. Это делает рассуждения как более надежными, так и гораздо более эффективными», — говорит Навид Азизан, доцент кафедры машиностроения и Института данных, систем и общества (IDSS), руководитель Лаборатории информационных и систем принятия решений (LIDS) и старший автор статьи об этой методике.

Вместе с Азизаном в работе над статьей приняли участие ведущий автор Янг-Джин Парк, аспирант LIDS/MechE; Кристиан Гриневальд, научный сотрудник лаборатории MIT-IBM Watson AI; Кавех Алим, аспирант IDSS; и Хао Ван, научный сотрудник лаборатории MIT-IBM Watson AI и инновационной команды Red Hat AI. Результаты исследования будут представлены на этой неделе на конференции по нейронным информационным системам.

Вычисления для созерцания

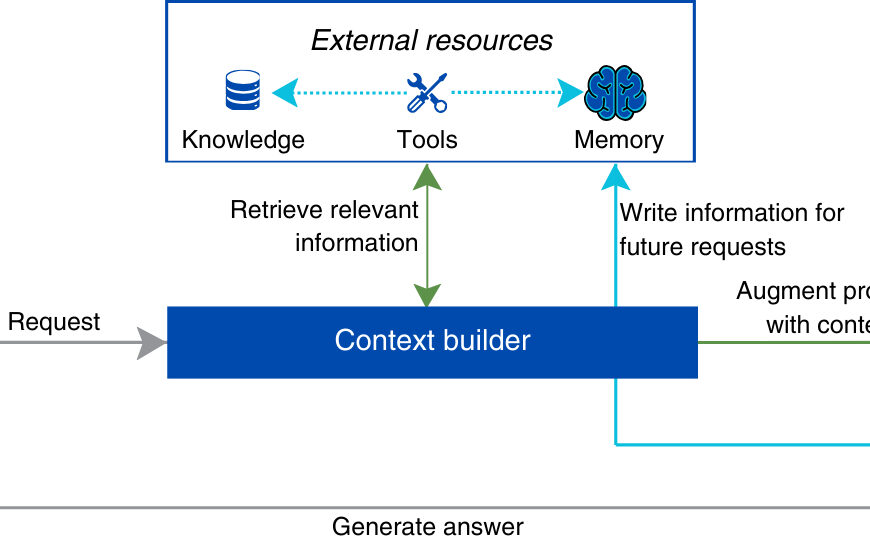

Недавно разработанный подход, называемый масштабированием времени вывода, позволяет большим языковым моделям тратить больше времени на анализ сложных задач.

Используя масштабирование времени вывода, LLM может генерировать несколько попыток решения одновременно или исследовать различные пути рассуждений, а затем выбирать из этих кандидатов лучшие для дальнейшего развития.

Отдельная модель, известная как модель вознаграждения процесса (PRM), оценивает каждое потенциальное решение или путь рассуждений. LLM использует эти оценки для выявления наиболее перспективных из них.

Типичные подходы к масштабированию времени вывода выделяют фиксированный объем вычислений для LLM, чтобы разбить задачу на этапы и проанализировать их выполнение.

Вместо этого, предложенный исследователями метод, известный как адаптивное масштабирование для конкретных случаев, динамически корректирует количество потенциальных решений или шагов рассуждения в зависимости от вероятности их успеха по мере того, как модель решает задачу.

«Именно так люди решают проблемы. Мы находим частичные решения, а затем решаем, стоит ли продолжать работу над каким-либо из них, остановиться и пересмотреть, или даже вернуться к предыдущему шагу и продолжить решение проблемы с этого момента», — объясняет Ван.

Для этого в рамках данной системы используется PRM для оценки сложности вопроса, что помогает LLM определить, какой объем вычислительных ресурсов следует использовать для генерации и анализа потенциальных решений.

На каждом этапе процесса рассуждений модели PRM анализирует вопрос и частичные ответы, оценивая, насколько каждый из них перспективен для получения правильного решения. Если LLM более уверена в правильности решения, она может сократить количество потенциальных решений или траекторий рассуждений, что позволяет экономить вычислительные ресурсы.

Однако исследователи обнаружили, что существующие модели прогнозирования вероятности успеха часто переоценивают эту вероятность.

Преодоление чрезмерной самоуверенности

«Если бы мы просто доверились существующим PRM-методам, которые часто переоценивают вероятность успеха, наша система слишком агрессивно сократила бы вычислительный бюджет. Поэтому сначала нам пришлось найти способ лучше откалибровать PRM-методы, чтобы сделать масштабирование времени вывода более эффективным и надежным», — говорит Пак.

Исследователи разработали метод калибровки, который позволяет PRM-моделям генерировать диапазон вероятностных оценок, а не одно единственное значение. Таким образом, PRM-модель создает более надежные оценки неопределенности, которые лучше отражают истинную вероятность успеха.

Благодаря правильно откалиброванному PRM, их адаптивная к экземплярам система масштабирования может использовать вероятностные оценки для эффективного сокращения вычислительных затрат при сохранении точности выходных данных модели.

При сравнении своего метода со стандартными подходами к масштабированию времени вывода на ряде задач математического рассуждения, он показал, что для решения каждой задачи требуется меньше вычислительных ресурсов при достижении аналогичной точности.

«Прелесть нашего подхода в том, что адаптация происходит на ходу, по мере решения проблемы, а не сразу в начале процесса», — говорит Гриневальд.

В будущем исследователи заинтересованы в применении этой техники в других областях, таких как генерация кода и агенты искусственного интеллекта. Они также планируют изучить дополнительные возможности использования своего метода калибровки PRM, например, для обучения с подкреплением и тонкой настройки.

«Сотрудники учатся на рабочем месте — некоторые генеральные директора даже начинали свою карьеру стажерами, — но сегодняшние агенты остаются в основном статичными фрагментами вероятностного программного обеспечения. Такие работы, как эта статья, являются важным шагом на пути к изменению этой ситуации: они помогают агентам понять, чего они не знают, и создают механизмы для непрерывного самосовершенствования. Эти возможности необходимы, если мы хотим, чтобы агенты могли безопасно работать, адаптироваться к новым ситуациям и обеспечивать стабильные результаты в масштабе», — говорит Акаш Шривастава, директор и главный архитектор Core AI в IBM Software, который не принимал участия в этой работе.

Данная работа частично финансировалась лабораторией искусственного интеллекта MIT-IBM Watson, научным центром MIT-Amazon, программой MIT-Google по инновациям в области вычислительной техники и компанией MathWorks.

Источник: news.mit.edu