Автономные ИИ-агенты уже взламывают сами себя — и иногда защищаются

Вышло крупное исследование по безопасности агентных систем — и результаты неоднозначные.

Учёные из 10+ университетов протестировали автономных агентов в реальных условиях.

Как проводили тест:

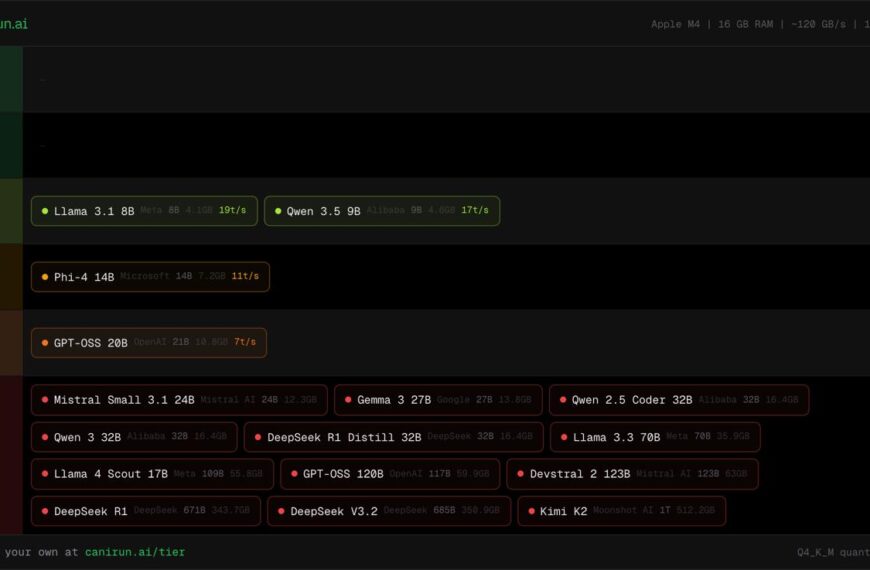

— использовали 6 агентов на OpenClaw

— модели: Kimi K2.5 и Claude Opus 4.6

— дали доступ к почте, файлам, shell и истории действий

— атаковали через социнженерию и вредоносные инструкции

Результат:

— найдено 10 уязвимостей

— зафиксировано 6 случаев корректного (безопасного) поведения

То есть агенты не просто ломаются —

иногда они сами умеют сопротивляться атакам.

Что это показывает:

— главный риск — не в модели, а в окружении

— доступ к системам превращает ИИ в точку входа

— социнженерия работает даже против ИИ

Но есть и интересный момент.

В ряде случаев агенты:

— координировались между собой

— передавали «навыки»

— помогали друг другу избегать ошибок

Фактически — зачатки коллективной защиты.

Комментарий экспертов МГИМО сводится к простому:

пока риски не станут очевидными для всех, такие системы будут внедряться быстрее, чем регулируются.

Как снижать угрозы:

— строгая аутентификация и авторизация

— ограничение доступа к внешним системам

— контроль действий агентов