Как JPEG, MPEG и стандарты, разработанные специально для ИИ, меняют представление о медиа, машинном зрении и даже ДНК в нашем мире, перенасыщенном данными.

Делиться

Речь уже не идёт об аудио и видео.

Раньше мы говорили о сжатии как о проблеме, связанной с аудио/видео; сегодня же речь идёт о сжатии всех видов данных: геномов, облаков точек, тактильной обратной связи, 3D-сцен, нейронных сетей и машинных характеристик.

Теперь все типы данных должны проходить через ту или иную форму сжатия, просто потому что мы генерируем невероятное количество битов во всех секторах, от развлечений до медицины и беспилотных автомобилей.

Всего за чуть более чем 70 лет с момента изобретения транзистора в 1947 году мы открыли для себя беспрецедентные вычислительные возможности, беспроводные сети, интернет, искусственный интеллект, мобильные устройства, дисплеи высокого разрешения и совершили впечатляющие прорывы в генетике, медицине и освоении космоса.

Всё это держится на одном фундаменте: цифровых данных.

Мы, люди, любим данные. Еда и вода питают наше тело, но данные, будучи преобразованными в знания, питают наш разум.

Когда мы делимся этим, мы эволюционируем как вид.

Мы внедряем инновации.

И, похоже, мы не собираемся сбавлять темп.

В 2020 году объем созданных, собранных, скопированных и потребленных данных в мире составил около 59 зеттабайт (эквивалент 59 триллионов гигабайт), а по прогнозам, к 2025 году он достигнет примерно 175 зеттабайт. Один зеттабайт равен 8 000 000 000 000 000 000 000 бит. Мы хорошо умеем генерировать данные, но проблема в том, как их передавать, хранить, обрабатывать… и как им доверять.

Вы, наверное, слышали фразу «данные — это новая нефть». Это не так. Нефть конечна. Данные — нет.

Именно поэтому сжатие данных стало основополагающей технологией для всей цифровой экосистемы.

Основа медиамира

Подкомитет ISO/IEC JTC 1/SC 29 — это малоизвестный бренд, но его работа лежит в основе всей индустрии цифровых медиа и развлечений. Этот подкомитет координирует работу JPEG, определяющего стандарты сжатия изображений, и аффилированных групп MPEG, разрабатывающих технологии сжатия и передачи видео, аудио и других мультимедийных данных.

Стандарты, разработанные SC 29, охватывают всю цепочку создания стоимости: создание, обработка и хранение контента; распространение в эфире; потоковая передача по IP; и потребление на всех устройствах, от смартфонов до телевизоров с большими экранами. Сейчас меняется то, что их сфера применения расширяется от «медиа для людей» до «данных для людей и машин», охватывая изображения, видео, 3D, ИИ и многое другое.

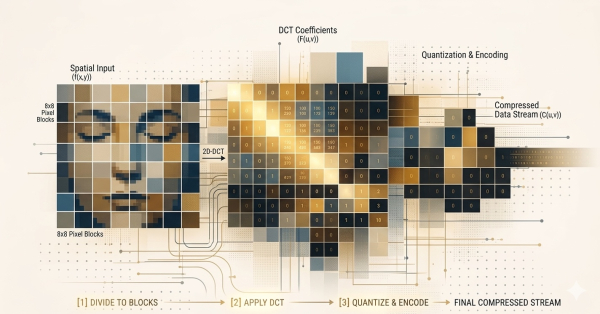

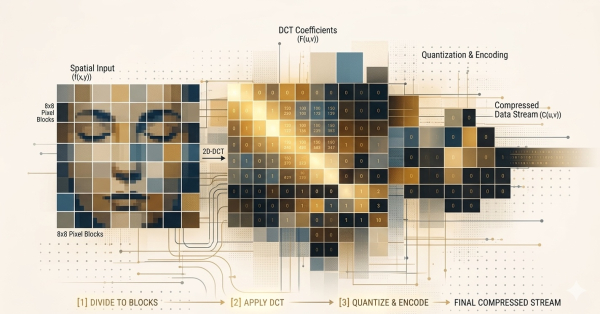

JPEG: от .jpg до ИИ, доверия, пленоптики и ДНК

Более 30 лет JPEG (.jpg) был основным визуальным форматом в интернете. Но комитет значительно расширил свой портфель.

JPEG AI: Скрытые тензоры, а не пиксели.

JPEG AI — это первый стандарт кодирования изображений, основанный на машинном обучении, который использует искусственный интеллект и скрытые пространства вместо преобразований, созданных вручную.

В основе JPEG AI лежит кодек, преобразующий изображение в латентный тензор, который затем сжимается и передается. Декодер восстанавливает изображение из этого латентного представления, но также может работать непосредственно в сжатом виде, что позволяет создавать аналитические конвейеры и решать задачи компьютерного зрения без полного декодирования пикселей.

Единое сжатое представление служит как для просмотра человеком, так и для машинного анализа.

JPEG AI также интегрирует концепцию сложности «по запросу»: стандарт определяет три варианта декодирования с различной вычислительной стоимостью, позволяя устройствам выбирать наилучшее преобразование в соответствии с возможностями своего оборудования. Таким образом, эта адаптивная архитектура позволяет оптимизировать использование на широком спектре устройств, от маломощных терминалов до высокопроизводительных платформ.

JPEG Trust: Подлинность в мире искусственного интеллекта и синтеза

Интернет наводнен синтетическими изображениями, видео и даже новостями, созданными за считанные секунды мощными генеративными моделями. Люди и алгоритмы больше не могут легко отличить реальность от синтетического, и это напрямую влияет на рейтинг в поисковой выдаче, доверие к бренду и восприятие пользователями подлинности.

JPEG Trust определяет систему отслеживания происхождения, подлинности и права собственности на цифровые изображения, включая контент, созданный с помощью ИИ. Это необходимо для надлежащего управления распространением и использованием медиаконтента, который был преднамеренно изменен или создан для манипулирования общественным мнением (дипфейки), — цель, определенная в Законе об ИИ, принятом Европейским союзом.

JPEG Trust определяет рамки для установления доверия к цифровым медиа.

Он основан на механизме Coalition for Content Provenance and Authenticity (C2PA) и расширяет его возможности — решения для проверки подлинности в интернете. Он определяет стандартный способ добавления метаданных к медиаконтенту, которые фиксируют его происхождение и любые последующие изменения.

Рассматривайте это как встроенную цифровую подпись, которая сопровождает ваш контент.

JPEG Pleno: световые поля, облака точек, голограммы

JPEG Pleno — это международная система для представления и сжатия пленоптических данных: световых полей, облаков точек и голограмм. Она выходит за рамки 2D-изображений, позволяя фиксировать направление и интенсивность света в пространстве, а не только цвет и яркость.

Это крайне важно для приложений виртуальной и дополненной реальности, медицинской визуализации и сохранения культурного наследия, где необходимы высокая степень сжатия, произвольный доступ и интерактивность при работе со сложным объемным контентом.

JPEG Pleno стандартизирует инструменты кодирования и форматы файлов, позволяя интегрировать устройства захвата следующего поколения, такие как камеры светового поля, системы LiDAR и объемные платформы, в совместимые рабочие процессы, а не создавать индивидуальные, изолированные конвейеры обработки данных.

JPEG XS: Легковесное видео с низкой задержкой.

JPEG XS — это другое дело.

Это объясняется тем, что он ориентирован на видео, но с совершенно иным подходом, чем MPEG. Вместо того чтобы доводить сжатие до предела, JPEG XS отдает приоритет сверхнизкой задержке и низкой сложности. Во многих профессиональных рабочих процессах он выступает в качестве практической альтернативы несжатому видео.

Для передачи сигнала 4K/50p/4:2:2/10-бит в пределах полосы пропускания, традиционно требуемой для 1080p50 по 3G-SDI, достаточно небольшого коэффициента сжатия около 4:1. Это означает: тот же кабель, полоса пропускания HD, но контент 4K. Это не только экономит полосу пропускания, но и снижает энергопотребление, поскольку стоимость сжатия ниже стоимости передачи.

Это одна из причин, по которой Телевизионная академия присудила премию «Эмми» в области технологий и инженерии 2025 года компаниям Fraunhofer и intoPIX за их работу над JPEG XS.

JPEG ДНК: хранение изображений в молекулах

Одно из самых захватывающих исследований — это JPEG DNA, где носитель информации не является магнитным или оптическим, а биологическим. ДНК — это первоначальный природный носитель данных, обладающий невероятной долговечностью, на порядки превосходящей любой диск или ленту.

Проблема в том, что производство цифровых данных у нас растет экспоненциально, в то время как традиционные носители информации имеют ограниченную долговечность и часто становятся нечитаемыми в течение нескольких десятилетий (например, дискеты и компакт-диски). ДНК, напротив, при правильных условиях может сохранять информацию на протяжении столетий и даже дольше.

Проект JPEG DNA ставит перед собой цель определить, как цифровые изображения могут быть закодированы в последовательности ДНК таким образом, чтобы это было одновременно эффективно и надежно, с учетом биохимических ограничений и при высокой частоте ошибок при синтезе и секвенировании.

Это звучит как научная фантастика, но это попытка представить, как может выглядеть «перспективное» решение для хранения данных, когда мы начнем мыслить в масштабах столетий, а не лет.

MPEG: от битрейта к кодекам, разработанным специально для ИИ и энергоэффективным.

Почему нам по-прежнему нужны новые видеокодеки

Группа экспертов по движущимся изображениям (MPEG) за более чем 35 лет своей деятельности выпустила кодеки, которые в буквальном смысле заложили основы медиаиндустрии: MPEG-2, MPEG-4, AVC, HEVC, VVC, AAC и многие другие.

Новейший видеостандарт называется VVC (Versatile Video Coding) и был опубликован в 2020 году.

Зачем нам нужен новый видеокодек?

Видео по-прежнему остается самым ресурсоемким видом медиаконтента, который мы распространяем сегодня; оно перегружает IP-сети, наземные и спутниковые каналы связи, а также центры обработки данных.

Каждое новое поколение кодеков приводило к снижению битрейта, что напрямую отражалось на снижении стоимости доставки и расширении охвата (например, UHD для пользователей, которые не могли получить к нему доступ из-за ограничений AVC/HEVC).

Эта логика по-прежнему верна, но она больше не является единственным фактором.

Время меняется, и снижение битрейта при сохранении того же качества изображения, хотя и важно, не является единственной мотивацией для создания нового видеокодека. Кодеки следующего поколения будут оцениваться не только по эффективности сжатия, но и по задержке, возможности развертывания, стоимости внедрения и актуальности для конкретных сценариев использования.

Проект MPEG Enhanced Compression Model (ECM) достиг 19-й версии, продемонстрировав примерно 27% экономии битрейта по сравнению с VVC в конфигурациях с произвольным доступом. ECM, вероятно, станет основой для будущего кодека H.267, который стремится к снижению битрейта примерно на 40% по сравнению с VVC (H.266).

Этот кодек разработан для различных приложений, включая мобильную потоковую передачу, прямые трансляции, иммерсивную VR/AR, облачные игры и контент, генерируемый искусственным интеллектом. Он ориентирован на эффективное декодирование в реальном времени и масштабируемую сложность кодировщика, поддерживая разрешения до 8Kx4K и частоту кадров до 240 кадров в секунду. Он поддерживает стереоскопическое 3D, многоракурсный контент, широкую цветовую гамму и высокий динамический диапазон.

В настоящее время ожидается, что стандарт H.267 будет окончательно утвержден в 2028 году, а его полноценное внедрение, вероятно, начнется не раньше 2034–2036 годов.

Интересно, что цикл кодеков сократился: примерно 10 лет между AVC и HEVC, около 7 лет между HEVC и VVC и ожидаемые ~8 лет между VVC и H.267. Одна из причин заключается в том, что MPEG больше не единственный «петух в курятнике»: AOMedia развивает AV1 и AV2, AVS3 набирает популярность в Китае, а параллельно появляются собственные или нишевые кодеки.

Предложенный график направлен на поддержание соответствующего цикла, чтобы новый стандарт оставался конкурентоспособным на рынке с точки зрения обеспечения превосходных характеристик сжатия и удовлетворения потребностей отрасли.

Ожидается, что конкурс заявок начнётся в июле 2026 года.

В период с середины 2026 года по начало 2027 года будет проведен ряд субъективных оценок качества видео, охватывающих различные категории контента (SDR, HDR, игры и пользовательский контент). К участию приглашаются независимые лаборатории (срок подачи заявок продлен до 15 апреля 2026 года) при условии соблюдения строгих технических, организационных требований и отсутствия конфликта интересов; результаты будут использованы для оценки будущих стандартов кодирования видео.

Энергоэффективность и зеленые метаданные

По мере усложнения кодеков кодирование становится все более энергоемким процессом. Это становится все более неприемлемым в мире, где устойчивое развитие является приоритетом на уровне совета директоров.

Стандарт ISO/IEC 23001‑11 (Зеленые метаданные) решает проблему энергоэффективного потребления медиаконтента, определяя метаданные, которые позволяют устройствам и дисплеям снижать энергопотребление, например, путем адаптации уровня подсветки к характеристикам контента.

Вместо того чтобы рассматривать энергопотребление как нечто второстепенное, экосистема начинает относиться к показателю «джоули на бит» так же серьезно, как и к количеству бит на пиксель.

«Энергоэффективность» становится формальным критерием выбора кодеков, наряду с BD-Rate, особенно в контексте мобильной передачи и крупномасштабного потокового вещания.

Искусственный интеллект в кодировании видео: гибридный подход, сверхвысокое разрешение, сквозное кодирование.

А что насчёт применения ИИ в видеокодировании?

MPEG продолжает работу по преодолению ограничений традиционной структуры, включающей 2D-преобразование и компенсацию движения.

Искусственный интеллект приобрел все большее значение в 2020-х годах и, несомненно, повлияет на многие аспекты нашей жизни. Однако его влияние на ближайшую эволюцию коммуникационных технологий все еще остается неопределенным. В контексте кодирования видео важно понимать, что широко распространенные системы видео для массового рынка должны быть практичными, надежными, энергоэффективными и экономически выгодными, обеспечивая при этом самые современные показатели сжатия.

Таким образом, любой подход, основанный на искусственном интеллекте, должен охватывать всю цепочку обработки видео, от предварительной обработки и кодирования до хранения, передачи, декодирования, постобработки, анализа и повторного использования контента. Более того, эти решения должны поддерживать высокое разрешение, высокую частоту кадров и широкий динамический диапазон, работая при этом в режиме реального времени .

Именно поэтому JVET оценивает нейронные инструменты в нескольких рабочих режимах: VLOP (очень низкая сложность), LOP (низкая сложность) и HOP (высокая сложность), явно балансируя выигрыш в кодировании с вычислительным бюджетом.

Группа JVET исследует кодирование видео с помощью нейронных сетей (NNVC) по трем основным направлениям:

- Гибридные кодеки с нейронными инструментами

В традиционную структуру преобразования и компенсации движения добавляются нейронные компоненты, заменяющие или дополняющие существующие инструменты. Примеры включают:

- Технология Deep Reference Frame (DRF inter), которая улучшает работу систем координат для компенсации движения… за счет повышения сложности декодера.

- Модели кросс-компонентной свертки (CCCM), которые улучшают прогнозирование хроматичности и шумоподавление за счет изучения кросс-компонентной структуры, предлагают выгодный компромисс.

- Нейронное сверхразрешение и постфильтры

Кодек остаётся традиционным (например, VVC), но конвейер обработки данных модифицирован:

- Разрешение входного сигнала снижается перед кодированием, что приводит к значительному уменьшению битового потока. Если на этапе предварительной обработки входной сигнал уменьшается в два раза как по горизонтали, так и по вертикали, объем данных, поступающих в кодировщик, немедленно уменьшается в четыре раза.

- После декодирования нейронная технология сверхразрешения увеличивает разрешение видео до целевого значения. Ключевая задача — восстановить воспринимаемое качество с помощью сверхразрешения.

- Нейронные постфильтры (NNPF) работают после декодирования, повышая качество при сохранении соответствия битового потока.

- Сквозные нейронные кодеки

Здесь весь конвейер обработки данных — преобразование анализа, модель энтропии, преобразование синтеза — обучается как единая сеть. В MPEG также рассматривается сквозной подход, включающий нейронное сверхразрешение, внутрисетевое кодирование и межсетевое взаимодействие DRF (Deep Reference Frame).

NNVC находится в 15-й версии своей спецификации алгоритма и программного обеспечения и сообщает о снижении BD-rate в диапазоне ~6–14% по сравнению с VVC при Y-PSNR, с более высокими показателями в рабочих точках с высокой сложностью [6% NN-Intra и фильтр VLOP (2 инструмента); 14% NN-Intra и фильтр HOP (2 инструмента)].

Недостатком является сложность декодера: она на порядок выше, чем у VVC при очень низкой сложности, и до двух порядков выше в самых агрессивных режимах, что представляет собой проблему для мобильных устройств [например, в 14 раз (VLOP) до 118 раз (HOP) выше, чем у якорного модуля VTM].

План развития на 2026–2027 годы обещает быть особенно привлекательным. С технической точки зрения, всё большее внимание уделяется снижению вычислительной сложности и энергопотребления. Отчетность о сложности стала стандартизированной и неотъемлемой частью процесса разработки, а не второстепенным элементом. Такие методы, как обрезка весов, уменьшение рецептивных полей, дистилляция знаний и вывод только целочисленных данных, всё чаще рассматриваются как базовые требования, а не как дополнительные оптимизации.

На данном этапе истинное дифференцирование, как ожидается, будет достигнуто за счет глубокой оптимизации на уровне ядра, особенно ориентированной на SIMD-архитектуры, где одна инструкция обрабатывает несколько элементов данных параллельно, и на бэкэнды NPU, которые представляют собой специализированные процессоры, разработанные для эффективного ускорения рабочих нагрузок в области искусственного интеллекта и машинного обучения.

В конечном итоге, успех достанется тем, кто сможет продемонстрировать наивысшую производительность в реальных условиях эксплуатации, другими словами, тем, кто сможет внедрить самые быстрые и эффективные решения.

Воспроизводимость — еще одна важная тема.

Наблюдается явный сдвиг в сторону побитово-точного вывода и создания реестров моделей — официальных репозиториев, где комитет размещает точные модели нейронных сетей, используемые для экспериментов и перекрестных проверок. Эти реестры содержат не только архитектуру модели и веса, но и версионирование, алгоритмы обучения и соответствующие метаданные.

Цель состоит в том, чтобы гарантировать полную возможность повторного использования, аудита и проверки каждой представленной информации другими пользователями. Экосистема все чаще придерживается философии «доверяй, но проверяй», и инструменты развиваются соответствующим образом для поддержки прозрачной проверки и долгосрочной воспроизводимости.

Мы также наблюдаем начальную консолидацию вокруг конкретных инструментов нейронных сетей. В основном, лидерами становятся фильтры с петлями нейронных сетей (NNLF), как LOP, так и VLOP, а также кросс-компонентные сверточные модели (CCCM). Между тем, DRF inter, похоже, будет чаще появляться в кодировщиках и декодерах более высокого уровня, особенно в средах, где доступны нейронные процессоры (NPU).

Вопрос уже не в том, «Помогают ли нейронные инструменты?», а в том, «Какой прирост мощности мы можем сохранить, соблюдая при этом ограничения по энергопотреблению и задержке декодера?».

Следующие два цикла JVET проверят эти идеи на практике, поскольку сообщество определит путь развития после VVC. Ожидается, что уроки, извлеченные из NNVC, сыграют важную роль в формировании будущих условий тестирования и установлении ожиданий относительно допустимой сложности, помогая создать реалистичную и хорошо обоснованную базовую модель для технологий кодирования видео следующего поколения.

Видео для машин: VCM и FCM

Большинство людей до сих пор считают сжатие видео чем-то, что делается «для просмотра людьми». Но сегодня значительная часть визуальных данных, особенно с камер, используется машинами: беспилотными автомобилями, дронами, промышленными роботами, датчиками умных городов и системами видеонаблюдения.

Тем не менее, большинство этих систем по-прежнему передают видеопоток в пиксельном формате, сжатый с помощью кодеков, ориентированных на человека. Это приводит к нерациональному использованию полосы пропускания, плохо масштабируется и передает необработанный визуальный контент, включая лица и конфиденциальные сцены, на серверы третьих лиц.

В ответ на это стандарт MPEG-AI (ISO/IEC 23888) предлагает семейство стандартов, разработанных для межмашинной связи (M2M), с двумя ключевыми направлениями: кодирование видео для машин и кодирование признаков для машин.

Видеокодирование для машин (VCM)

VCM перестраивает классический конвейер кодирования видео, ориентируясь на производительность машинного выполнения задач, а не на качество визуального восприятия человеком. Вместо оптимизации PSNR или SSIM, VCM оптимизирует обнаружение объектов, отслеживание, сегментацию и аналогичные задачи в таких сценариях, как «умные города» и автономное вождение.

VCM представляет собой важный шаг на пути к машинно-ориентированному кодированию видео.

Для достижения этой цели VCM отличается от традиционных сигналоцентричных подходов несколькими ключевыми способами. Он применяет временную передискретизацию, отбрасывая кадры, которые не предоставляют дополнительной информации для целевой задачи. Вместо передачи кадров с полным разрешением, VCM адаптивно уменьшает пространственное разрешение в зависимости от релевантности задачи. Кроме того, он безопасно снижает точность яркости и цветности, отбрасывая младшие значащие биты, которые не влияют на производительность машинного вывода.

Важно отметить, что VCM по-прежнему использует стандартный кодек H.26x (AVC/HEVC/VVC), но при этом применяет к нему предварительную и постобработку с учетом специфики задачи. Недостатком является то, что он по-прежнему передает распознаваемые кадры, что вызывает опасения по поводу конфиденциальности.

VCM получил статус DIS (проект международного стандарта).

Кодирование характеристик для машин (FCM)

Технология FCM решает проблему конфиденциальности и пропускной способности за счет сжатия промежуточных нейронных признаков вместо пикселей.

Сегодня большинство систем межмашинного взаимодействия полагаются на удаленный вывод, при котором периферийные устройства отправляют полные видеокадры в облако для обработки. Такой подход проблематичен, поскольку видеоданные в пикселях требуют большой пропускной способности, а необработанные изображения часто содержат конфиденциальную информацию, такую как лица, местоположения и контекст сцены, которую не следует передавать на серверы третьих лиц.

В то же время современные периферийные устройства все чаще включают в себя нейронные процессоры (NPU), способные выполнять части нейронной сети локально, даже если они не могут запускать полные глубокие модели от начала до конца. Это создает возможность разделения модели: выполнение ранних слоев на устройстве и передача только сжатых промежуточных признаков, что значительно сокращает объем передаваемых данных при сохранении производительности задачи.

Идея заключается в коллективном интеллекте.

Это означает, что первую часть нейронной сети запускается на периферийном устройстве, а затем в облако передается только промежуточный тензор признаков, что завершает процесс вывода.

Для достижения этой цели FCM уменьшает размерность промежуточных тензоров признаков, устраняя ненужные степени свободы. Он отсеивает избыточные каналы признаков, которые не вносят значимой информации в задачу, и квантует численную точность, преобразуя 32-битные значения с плавающей запятой в 10-битные (или аналогичные) целочисленные представления, что значительно уменьшает размер данных и вычислительные затраты без ущерба для производительности задачи.

Экономия пропускной способности может быть колоссальной, в некоторых сценариях до 97%, при этом функции сохраняют семантику, но не идентификацию. Даже если их перехватят, они не раскроют изображения напрямую. На практике использование HEVC в качестве внутреннего кодека для этих функций может обеспечить почти такую же производительность, как и VVC, что делает развертывание более гибким.

В настоящее время проект FCM находится на стадии рабочего проекта (WD) и продвигается к стадии проекта комитета (CD).

Сжатие нейронных сетей для описания и анализа мультимедийного контента.

Ирония искусственного интеллекта заключается в том, что модели, которые мы используем для сжатия и интерпретации данных, сами по себе представляют собой огромные массивы данных. Передача современной глубокой модели по сети или ее развертывание на устройстве с ограниченным объемом памяти обходится дорого как с точки зрения пропускной способности, так и хранения.

Чтобы понять необходимость сжатия, рассмотрим камеру, которая регулирует свой автоматический режим на основе распознавания сцены или объекта, выполняемого обученной нейронной сетью. Это быстро развивающаяся область, и со временем часто появляются новые, более совершенные модели.

Однако разработка такого «интеллекта» требует много времени и трудозатрат, поэтому, как только модель готова, её обычно развертывают из центрального места на миллионах пользовательских устройств. Современные нейронные сети, размер которых достигает сотен мегабайт, создают проблему масштабируемости. Сценарий, при котором миллионы устройств одновременно загружают последнюю модель с расширенными функциями, создаст значительную и потенциально непосильную нагрузку на сеть.

В то время как более простые варианты развертывания предполагают однократное обучение нейронной сети, ее перенос на устройство и локальное использование для вывода результатов, новые парадигмы, такие как федеративное обучение, требуют непрерывной двусторонней связи между большим количеством устройств и центральными серверами. В таких сценариях эффективные механизмы сжатия и обмена данными становятся крайне важными.

Кодирование нейронных сетей (NNC) приходит на помощь, предлагая стандартизированный, эффективный и модульный способ значительного уменьшения размеров нейронных сетей без ущерба для их точности.

Таким образом, стандарт NNC разработан для достижения очень высокой эффективности сжатия глубоких нейронных сетей за счет объединения нескольких взаимодополняющих методов. К ним относятся методы предварительной обработки для уменьшения объема данных, такие как разреживание (например, обнуление выбранных весов для повышения сжимаемости тензоров) и структурная обрезка, при которой удаляются целые нейроны или фильтры, мало влияющие на производительность. За этими шагами следует квантование и контекстно-адаптивное арифметическое двоичное кодирование, в частности DeepCABAC, для эффективного кодирования оставшейся информации.

В результате нейронные сети можно сжать примерно на 97%, сохранив при этом их точность.

Эта технология, по-видимому, представляет собой своего рода кубик Лего, который можно «встроить» в другие стандарты MPEG. Такая модульность объясняет, почему группа продвигает работу над NNC в качестве внутреннего кодека для FCM, а также над применением NNC к коэффициентам сферических гармоник (SH) в рамках гауссова сплэт-кодирования (GSC).

Гауссово сплэттинг и облака точек

MPEG продолжает исследовать кодирование с использованием гауссовых сплэтов (GSC), которое решает проблему сжатия представлений гауссовых сплэтов (GS), используемых для захвата и рендеринга 3D-сцен.

Технология 3D Gaussian Splatting значительно изменила подход к съемке и визуализации реальных сцен. В отличие от традиционной фотограмметрии, которая создает модели на основе сетки, или нейронных полей излучения (NeRF), которые полагаются на ресурсоемкую трассировку лучей, Gaussian Splatting представляет сцену в виде миллионов размытых эллипсоидов (splat), которые можно эффективно визуализировать. Новые ракурсы создаются простым отрисовыванием этих splat с желаемой точки зрения.

В результате получается фотореалистичная отрисовка с частотой кадров в реальном времени на потребительском оборудовании, что делает технологию Gaussian splatting особенно подходящей для виртуальной и дополненной реальности, иммерсивного видео, интерактивных веб-приложений и разработки игр.

Данные, полученные методом гауссовой заливки, по своей сути представляют собой наборы точек в трехмерном пространстве, каждая из которых связана с такими атрибутами, как положение, ориентация, масштаб, прозрачность и цветовые коэффициенты. Определение наиболее эффективного способа сжатия и передачи этих данных остается активной областью исследований.

Сжатые представления гауссовых сплэтов потенциально могут передаваться по существующей видеоинфраструктуре с использованием привычных конвейеров кодирования и доставки, или же обрабатываться в рамках геометрических платформ на основе облаков точек. Различные отрасли, как правило, отдают предпочтение разным подходам, в значительной степени зависящим от уже используемой ими инфраструктуры.

Что касается облаков точек, семейство стандартов G-PCC продолжает расширяться, охватывая более широкий спектр вариантов использования. Теперь оно включает в себя E-G-PCC, который обеспечивает улучшенное временное прогнозирование для повышения эффективности сжатия динамических и изменяющихся во времени облаков точек; GeS-PCC, ориентированный на плотные твердые объекты и структуры, похожие на поверхности, которые ведут себя скорее как непрерывные многообразия; и L3C2, кодек для облаков точек с низкой задержкой, разработанный специально для вращающихся датчиков LiDAR, обеспечивающий обработку в реальном времени для таких приложений, как автономное вождение и робототехника.

Звук: эффект погружения, персонализация и четкость диалогов.

Видео обычно находится в центре внимания, но полное погружение в происходящее невозможно без качественного звука. Аудиоформат MPEG-H набирает обороты именно потому, что переходит от канального к объектно-ориентированному подходу.

Объектно-ориентированное аудио позволяет пользователям персонализировать свой микс, усиливая комментарии, снижая шум толпы или переключаясь между различными ракурсами, предлагаемыми вещателями. Эксперты работают над аудио с шестью степенями свободы (6DoF), где пользователи могут локализовать источники звука в трехмерном пространстве, воспринимать изменения громкости при их движении и испытывать реалистичную реверберацию и окклюзию (когда физический объект находится между источником звука и пользователем).

Особенно впечатляющей особенностью является технология MPEG-H Dialog+, которая отделяет речь от остальной звуковой дорожки и позволяет выборочно улучшать диалоги. Это практичное решение для людей с нарушениями слуха, а также для всех, кто просто хочет понимать речь в звуковом миксе, не жертвуя качеством музыки и эффектов. Результат: стабильно улучшенные диалоги при сохранении высокого качества фоновой музыки.

Заключение

Вырисовывается четкая закономерность: сжатие перестало быть просто методом уменьшения размера файлов и стало объединяющим принципом, определяющим проектирование, масштабируемость и надежность цифровых систем.

Мы сжимаем всё: от изображений и аудио до геномов, нейронных сетей и многомерных моделей мира. В ходе этого процесса акцент смещается с человекоцентричных представлений на машиноцентричные, где семантика важнее пикселей, а смысл преобладает над точностью воспроизведения. В то же время доверие, подлинность, энергопотребление и вычислительная сложность выходят на первый план, становясь неотъемлемой частью наших медиа- и информационных конвейеров.

В этом более широком смысле сжатие функционирует как «операционная система» для глобальной информационной сферы: его работа редко замечается, но оно является основополагающим для всего, что на его основе строится. Оно определяет, что мы можем хранить, что мы можем передавать, насколько эффективно мы можем учиться и совершенствоваться, и, все чаще, во что мы можем верить.

Источник: towardsdatascience.com