Бен Диксон

Опубликовано

Обновлено

Стандартные рекомендации по созданию больших языковых моделей (LLM) оптимизируют только затраты на обучение и игнорируют затраты на вывод. Это создает проблему для реальных приложений, использующих методы масштабирования времени вывода для повышения точности ответов модели, например, для получения нескольких примеров рассуждений из модели при развертывании.

Для преодоления этого разрыва исследователи из Университета Висконсин-Мэдисон и Стэнфордского университета представили законы масштабирования «обучение-тест» (T2), представляющие собой структуру, которая совместно оптимизирует размер параметров модели, объем обучающих данных и количество выборок для вывода результатов во время тестирования.

На практике их подход доказывает, что с точки зрения вычислительных затрат оптимально обучать значительно меньшие по размеру модели на гораздо большем объеме данных, чем предписывают традиционные правила, а затем использовать сэкономленные вычислительные ресурсы для генерации множества повторяющихся выборок на этапе вывода.

Для разработчиков корпоративных приложений ИИ, обучающих собственные модели, это исследование предоставляет проверенную схему максимизации отдачи от инвестиций. Оно показывает, что для рассуждений в ИИ не обязательно требуются огромные затраты на передовые модели. Вместо этого, более компактные модели могут обеспечить более высокую производительность в сложных задачах, сохраняя при этом затраты на вывод результатов на один запрос на приемлемом уровне в рамках реальных бюджетов развертывания.

Противоречивые законы масштабирования

Законы масштабирования играют важную роль в разработке больших языковых моделей. Законы масштабирования на этапе предварительного обучения определяют оптимальный способ распределения вычислительных ресурсов во время создания модели, в то время как законы масштабирования на этапе тестирования определяют, как распределять вычислительные ресурсы во время развертывания, например, позволяя модели «думать дольше» или генерируя несколько примеров рассуждений для решения сложных задач.

Проблема в том, что эти законы масштабирования были разработаны совершенно независимо друг от друга, несмотря на их фундаментальную взаимосвязь.

Размер параметров модели и продолжительность обучения напрямую определяют как качество, так и стоимость обработки одного запроса для выборок, используемых при выводе результатов. В настоящее время золотым стандартом в отрасли для предварительного обучения является правило Чинчиллы , которое предполагает оптимальное для вычислений соотношение примерно 20 обучающих токенов на каждый параметр модели.

Однако создатели современных семейств моделей ИИ, таких как Llama, Gemma и Qwen, регулярно нарушают это правило, намеренно переобучая свои более мелкие модели на огромных массивах данных.

Как рассказал VentureBeat Николас Робертс, ведущий автор статьи, традиционный подход терпит неудачу при построении сложных агентных рабочих процессов: «На мой взгляд, стек вывода дает сбой, когда каждый отдельный вызов вывода обходится дорого. Это происходит, когда модели большие и необходимо многократно повторять выборку». Вместо того чтобы полагаться на огромные модели, разработчики могут использовать переобученные компактные модели для выполнения этой многократной выборки с гораздо меньшими затратами.

Однако, поскольку законы масштабирования во время обучения и тестирования рассматриваются изолированно, не существует строгой структуры для расчета того, насколько модель следует переобучить, исходя из количества примеров рассуждений, которые ей потребуется сгенерировать во время развертывания.

Следовательно, ранее не существовало формулы, которая бы одновременно оптимизировала размер модели, объем обучающих данных и бюджеты времени выполнения тестов.

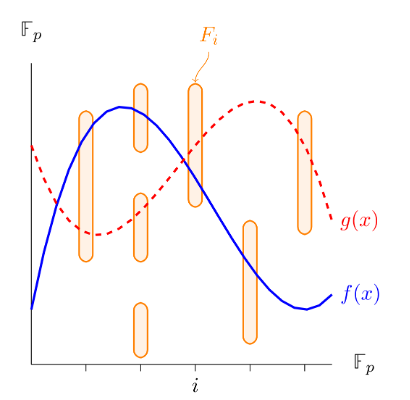

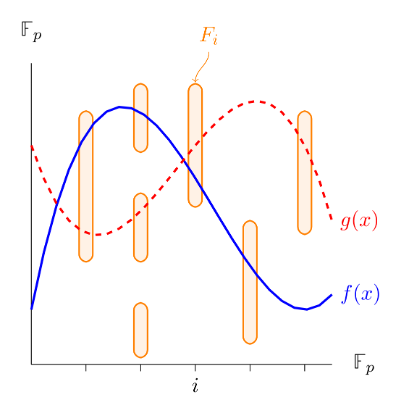

Сложность формулировки этой модели заключается в том, что предварительное обучение и масштабирование во время тестирования используют два разных математических языка. Во время предварительного обучения производительность модели измеряется с помощью «потери» — плавной, непрерывной метрики, отслеживающей ошибки прогнозирования по мере обучения модели.

На этапе тестирования разработчики используют реальные, доступные для анализа метрики для оценки способностей модели к рассуждению, такие как pass@k, которая измеряет вероятность того, что модель даст хотя бы один правильный ответ из k независимых, повторяющихся попыток.

Законы масштабирования от обучающей выборки к тестовой

Для решения проблемы несоответствия между обучением и развертыванием исследователи вводят законы масштабирования «обучение-тестирование» (T2). В общих чертах, эта структура предсказывает производительность модели в процессе рассуждений, рассматривая три переменные как единое уравнение: размер модели (N), объем обучающих токенов, на которых она обучается (D), и количество примеров рассуждений, которые она генерирует во время вывода (k).

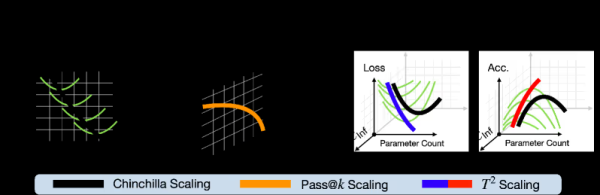

T2 объединяет бюджеты предварительного обучения и вывода в одну формулу оптимизации, которая учитывает как базовые затраты на обучение модели (6ND), так и совокупные затраты на ее многократное обращение при выводе (2Nk). Исследователи опробовали различные подходы к моделированию: моделировать ли потери предварительного обучения или производительность во время тестирования (pass@k) как функции N, D и k.

Первый подход берет знакомое математическое уравнение, используемое для масштабирования шиншилл (которое вычисляет ошибку прогнозирования модели, или потери), и напрямую модифицирует его, добавляя новую переменную, учитывающую количество повторных выборок во время тестирования (k). Это позволяет разработчикам увидеть, как увеличение вычислительной мощности приводит к снижению общей частоты ошибок модели.

Второй подход напрямую моделирует точность pass@k на последующих этапах. Он сообщает разработчикам вероятность того, что их приложение решит задачу при заданном вычислительном бюджете.

Но следует ли предприятиям использовать эту структуру для каждого приложения? Робертс поясняет, что этот подход является узкоспециализированным. «Я предполагаю, что вы не увидите такой большой пользы для приложений, требующих больших объемов знаний, таких как модели чатов», — сказал он. Вместо этого, «T2 адаптирован для приложений, требующих больших объемов рассуждений, таких как программирование, где обычно используется многократная выборка в качестве метода масштабирования времени тестирования».

Что это значит для разработчиков

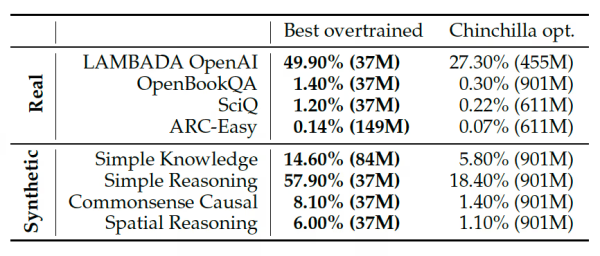

Для проверки законов масштабирования T2 исследователи создали обширную тестовую базу, включающую более 100 языковых моделей с количеством параметров от 5 до 901 миллиона. Они обучили с нуля 21 новую, сильно переобученную контрольную точку, чтобы проверить, соответствуют ли их математические прогнозы действительности. Затем они протестировали модели на восьми различных задачах, включая реальные наборы данных, такие как SciQ и OpenBookQA, а также синтетические задачи, предназначенные для проверки арифметических вычислений, пространственного мышления и запоминания знаний.

Обе их математические модели доказали, что граница вычислительной оптимизации резко смещается относительно стандартного масштабирования для шиншиллы. Для максимизации производительности при фиксированном бюджете оптимальным выбором является модель, которая значительно меньше по размеру и обучена на гораздо большем объеме данных, чем диктует традиционное правило 20 токенов на параметр.

В своих экспериментах, при учете затрат на выборку во время тестирования, они показали, что сильно переобученные небольшие модели неизменно превосходили более крупные, оптимальные для шиншилл модели по всем восьми задачам оценки.

Для разработчиков, желающих внедрить эти результаты, технический барьер оказывается на удивление низким.

«Для масштабирования во время тестирования с использованием наших текущих моделей не требуется ничего сложного», — сказал Робертс. «При развертывании разработчики могут интегрировать инфраструктуру, которая делает процесс выборки более эффективным (например, кэширование ключ-значение, если используется преобразователь)».

Кэширование ключ-значение помогает, сохраняя ранее обработанный контекст, благодаря чему модели не приходится заново считывать исходный запрос для каждого нового примера рассуждений.

Однако чрезмерное переобучение сопряжено с практическими компромиссами. Хотя переобученные модели могут быть крайне упрямыми и их сложнее донастраивать, Робертс отмечает, что при применении контролируемой донастройки «хотя этот эффект и присутствовал, он был недостаточно сильным, чтобы вернуть оптимальную модель к модели Chinchilla». Стратегия, оптимальная с точки зрения вычислительных ресурсов, по-прежнему однозначно ориентирована на компактные модели.

Однако командам, доводящим это до абсолютного предела, следует опасаться достижения физических ограничений по объему данных. «Еще один аспект заключается в том, что если вы доведете наши рекомендации по переобучению до крайности, у вас может фактически закончиться обучающий объем данных», — сказал Робертс, имея в виду надвигающуюся «стену данных», когда исчерпываются высококачественные интернет-данные.

Эти эксперименты подтверждают, что если приложение основано на генерации множества тестовых примеров для анализа, то агрессивное переобучение компактной модели является практически и математически наиболее эффективным способом распределения вычислительного бюджета на весь процесс.

Чтобы помочь разработчикам начать работу, исследовательская группа планирует в ближайшее время открыть исходный код своих контрольных точек и программного обеспечения, что позволит предприятиям подключать собственные данные и немедленно тестировать масштабируемость. В конечном итоге, эта платформа станет уравнивающей силой в индустрии искусственного интеллекта.

Это особенно важно, поскольку высокая стоимость моделей, находящихся на стыке современных технологий, может стать препятствием при масштабировании агентных приложений, основанных на моделях рассуждений.

«T2 коренным образом меняет круг лиц, имеющих право создавать надежные модели логического мышления», — заключает Робертс. «Возможно, вам не понадобятся огромные вычислительные мощности для получения самых современных моделей логического мышления. Вместо этого вам потребуются качественные данные и разумное распределение бюджета на обучение и вывод результатов».

Подпишитесь, чтобы получать самые свежие новости!

Подробные аналитические данные для руководителей предприятий в области искусственного интеллекта, данных и безопасности.

Отправляя свой адрес электронной почты, вы соглашаетесь с нашими Условиями использования и Политикой конфиденциальности.

Получайте обновления ! Вы подписаны! Наши последние новости скоро поступят на вашу электронную почту.

Источник: venturebeat.com