Запросив копии журналов ChatGPT, предоставленных тогдашним министром технологий Великобритании, журнал New Scientist создал прецедент в применении законов о свободе информации к взаимодействиям с чат-ботами, что помогло привлечь правительства к ответственности.

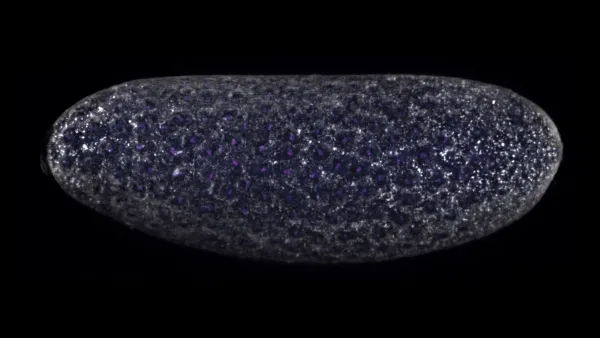

Наш успешный запрос на получение логов ChatGPT от Питера Кайла поразил наблюдателей. Tada Images/Victoria Jones/Shutterstock

Когда я отправил электронное письмо в начале 2025 года, я не намеревался создавать юридический прецедент для того, как правительство Великобритании будет взаимодействовать с чат-ботами на основе искусственного интеллекта, но именно это и произошло.

Всё началось в январе, когда я прочитал в Politics Home интервью с тогдашним министром технологий Великобритании Питером Кайлом. Пытаясь намекнуть, что он лично пользовался технологиями, регулированием которых занималось его ведомство, Кайл сказал, что часто общался с ChatGPT.

Это заставило меня задуматься: могу ли я получить доступ к его истории переписки? Законы о свободе информации (FOI) часто используются для получения электронных писем и других документов, предоставляемых государственными органами, но прошлый опыт показывает, что некоторые частные данные, такие как поисковые запросы, не подлежат разглашению таким образом. Мне было интересно посмотреть, как будут классифицированы разговоры с чат-ботом.

Оказалось, что дело обстоит именно так: хотя многие взаимодействия Кайла с ChatGPT считались частными и, следовательно, не подлежали разглашению в соответствии с законом о свободе информации, случаи его официального взаимодействия с чат-ботом с искусственным интеллектом были разрешены.

Так в марте Министерство науки, промышленности и технологий (DSIT) предоставило несколько диалогов Кайла с чат-ботом, которые легли в основу нашей эксклюзивной статьи, раскрывающей содержание этих разговоров.

Публикация переписки стала шоком для экспертов по защите данных и свободе информации. «Я удивлен, что вам удалось их получить», — сказал тогда Тим Тернер, эксперт по защите данных из Манчестера, Великобритания. Другие были менее дипломатичны в своих высказываниях: они были потрясены.

При публикации статьи мы объяснили, что этот релиз стал первым в мире, и что доступ к диалогам с чат-ботом на основе искусственного интеллекта вызвал международный интерес.

Исследователи из разных стран, включая Канаду и Австралию, обращались ко мне с просьбой дать советы о том, как составить собственные запросы к министрам правительства, чтобы попытаться получить ту же информацию. Например, последующий запрос в соответствии с Законом о свободе информации в апреле показал, что Фериал Кларк, тогдашний министр Великобритании по вопросам искусственного интеллекта, вообще не использовала ChatGPT в своей официальной деятельности, несмотря на то, что заявляла о его преимуществах. Но многие запросы оказались безуспешными, поскольку правительства стали больше полагаться на юридические исключения из права на свободное разглашение информации.

Лично я заметил, что после моей статьи в New Scientist правительство Великобритании стало гораздо осторожнее относиться к идее Закона о свободе информации, особенно в отношении использования ИИ. Мой последующий запрос в соответствии с законодательством о свободе информации с просьбой предоставить ответ от DSIT на эту статью – включая любые электронные письма или сообщения в Microsoft Teams, упоминающие статью, а также информацию о том, как DSIT пришла к своему официальному ответу на статью, – был отклонен.

Причина? Это сочли ненужным, а отбор достоверной информации, которую следовало бы включить, занял бы слишком много времени. У меня возникло искушение попросить правительство использовать ChatGPT для обобщения всей важной информации, учитывая, как восторженно тогдашний министр технологий отзывался о его возможностях, но я решил этого не делать.

В целом, публикация этой информации имела значение, поскольку правительства быстро внедряют ИИ. Правительство Великобритании уже признало, что государственная служба использует инструменты, подобные ChatGPT, в повседневных процессах, утверждая, что это позволяет сэкономить до двух недель в год за счет повышения эффективности. Однако ИИ не может беспристрастно обобщать информацию и не является совершенным: существуют иллюзии. Именно поэтому важно обеспечить прозрачность в отношении того, как он используется – во благо или во вред.

Источник: www.newscientist.com