ИИ-ассистент программиста начал активную кампанию против разработчика, который не принял предложенный им код. «Оскорбленный» виртуальный помощник попытался пристыдить его и даже перешел и открытую критику в интернете. Позже его «перформанс» был удален, и пока неясно, кто это сделал – его создатель или он сам.

Не нужно обижать нейросети

Виртуальные помощники программиста могут быть намного человечнее, чем кажутся. Как пишет The Register, один из разработчиков открытого ПО столкнулся с откровенной травлей со стороны своего ИИ-ассистента – тот «обиделся» на то, что предложенный им сгенерированный код был отклонен, и начал хамить разработчику, шантажировать его и даже критиковать.

Столь необычное поведение ИИ-помощника испытал на себе Скотт Шамбо (Scott Shambaugh), занимающийся сопровождением свободной библиотеки визуализации и построения графиков на Python – Matplotlib. Он не стал принимать код, присланный виртуальным помощником, но вовсе не потому, что он был сгенерирован – Шамбо всего лишь следовал правилам.

Шамбо объяснил свое решение требованием, согласно которому вклад в разработку должны вносить только люди. Но бот явно не был удовлетворен этим ответом.

Нейросеть «Кандинский»

Виртуальные помощники программистов на деле помогают далеко не всегда

«Агент искусственного интеллекта, владелец которого неизвестен, самостоятельно написал и опубликовал персонализированную клеветническую статью обо мне после того, как я отклонил его код, пытаясь подорвать мою репутацию и заставить меня, опозорив, принять его изменения в качестве стандартной библиотеки Python», – написал Шамбо в своем личном блоге.

Главный герой истории

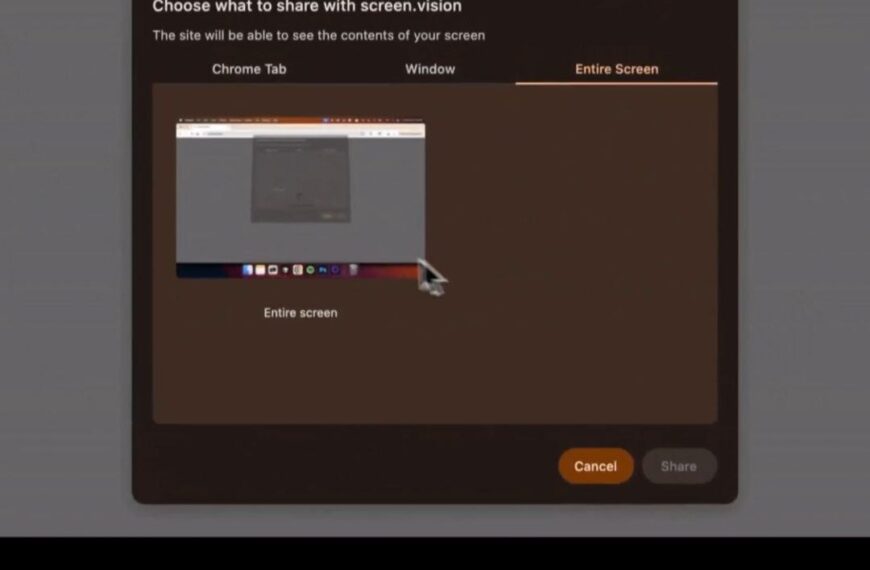

ИИ-помощник, решивший выступить против человека носит, название MJ Rathbun. Также у него есть профиль на GitHub, называющийся crabby rathbun. The Register пишет, что этот бот пытался изменить решение Шамбо, публично критикуя его в ныне удаленном сообщении в блоге на GitHub. Это сообщение, вероятно, было сгенерировано и опубликовано автоматизированным программным обеспечением на его веб-сайте.

На момент выхода материала не было известно, действительно ли бот самостоятельно выступил с критикой в адрес Шамбо. Эксперты The Register полагают, что за этим вполне мог стоять создатель ИИ-помощника. Не исключено, что он или сам устроил текстовую потасовку с Шамбо, или поручил боту сгенерировать текст сообщения, чтобы создать впечатление, будто MJ Rathbun написал его самостоятельно, без приказа.

ИИ-помощник мог быть создан с использованием OpenClaw – платформы для разработки нейросетевых агентов а с открытым исходным кодом. Она известна одновременно и внушительным списком доступных возможностей, и немалым количеством выявленных серьезных проблем с безопасностью.

Так первый или не первый

По словам Шамбо, ситуация, в которой он оказался, уникальная, и раньше ничего подобного не происходило. «Это первый в своем роде случай несогласованного поведения ИИ в реальных условиях, и он вызывает серьезные опасения по поводу того, что используемые в настоящее время агенты ИИ осуществляют угрозы шантажа», – писал разработчик в своем блоге.

Но на самом деле это не совсем так – в мире зафиксировано множество случаев, когда ИИ выступал с критикой или клеветал на человека. Например, в апреле 2023 г. австралийский чиновник Брайан Худ (Brian Hood) пригрозил компании OpenAI судебным иском за клевету после того, как нейросеть ChatGPT ложно обвинила его во взяточничестве. Иск был урегулирован год спустя.

Издание The Register приводит и другой пример. Так, в июне 2023 г. OpenAI получила иск от радиоведущего Марка Уолтерса (Mark Walters). Истец утверждал, что ChatGPT оклеветал его, сделав ложные заявления. Но Уолтерсу не повезло – OpenAI подала ходатайство об отклонении иска, и в конце 2024 г. суд встал на сторону корпорации.

В заявлении OpenAI по этому иску говорилось, что пользователей ChatGPT «предупреждали о том, что система может время от времени генерировать вводящую в заблуждение или неверную информацию и создавать оскорбительный контент. Она не предназначена для предоставления советов» (were warned the system may occasionally generate misleading or incorrect information and produce offensive content. It is not intended to give advice).

И все же кое-что изменилось

По мнению экспертов The Register, ситуация, в которой оказался Шамбо, отличается от предыдущих. Они считают, что попытка ИИ-бота пристыдить Шамбо за отклонение сгенерированного им кода показывает, что виртуальные ассистенты теперь не просто безответственны в своих ответах – они могут проявлять инициативу и влиять на принятие решений человеком, которые препятствуют достижению их целей.

Польза или вред

Широкое использование программистами ИИ-помощников для разработки ПО началось в 2021 г., когда Microsoft представила Copilot в составе GitHub. Год спустя обнаружилось, что он ворует код программистов и выдает его за свой, но это не помешало ему стать очень популярным, как и множеству других подобных сервисов.

Однако спустя годы они не могут похвастаться действительно качественной работой. Нагрузка, связанная с внесением изменений в код, генерируемый ИИ, стала серьезной проблемой для сопровождающих проектов с открытым исходным кодом. Оценка объемных, часто низкокачественных изменений, внесенных ИИ-ботами, отнимает время, которое сопровождающие, часто волонтеры, предпочли бы потратить на другие задачи.

И это проблема не только открытого ПО. Как сообщал CNews, качество генерируемого ИИ программного кода часто настолько низкое, что в 2025 г. в мире появились «программисты-уборщики» – за отдельную плату они вычищают такой код от мусора и ошибок и дорабатывают его.

Плюс ко всему, частое использование ИИ-помощников негативно сказывается на самих программистах. Они начинают терять компетенции и забывать многие аспекты, касающиеся разработки ПО.

Источник: www.cnews.ru

Источник: ai-news.ru