Модель с 27 млн параметров превзошла таких гигантов, как DeepSeek R1, o3-mini и Claude 3.7, в задачах на рассуждение.

Делиться

Введение

С момента появления концепции ИИ исследователи всегда верили в масштаб — в то, что общий интеллект — это эмерджентное свойство, рождающееся из размера. Если мы просто продолжим добавлять параметры и обучать их на гигантских корпусах, то человекоподобное мышление проявится само собой.

Но вскоре мы обнаружили, что даже этот подход, основанный на прямом переборе, имеет свои недостатки. Данные свидетельствуют о том, что большинство наших передовых моделей серьёзно недообучены и имеют завышенное количество параметров (Hoffmann et al., 2022)3, что указывает на то, что мы, возможно, всё-таки тратим вычислительные ресурсы не по назначению.

Скрытые недостатки гигантов искусственного интеллекта

Мы заставили самый мощный из когда-либо созданных ИИ думать на медленном, неудобном иностранном языке: английском. Чтобы найти решение проблемы, ему приходится «рассуждать вслух», используя пошаговый процесс слово в слово, одновременно предоставляя нам множество нерелевантных и неэффективно управляемых «токенов».

Кроме того, существует устоявшаяся отраслевая практика «чем больше, тем лучше». Это привело к разработке моделей с миллиардами параметров и обучающих наборов с триллионами токенов. Огромный размер таких моделей подразумевает, что они не являются по-настоящему рассуждающими; они просто являются наилучшими возможными имитаторами. Вместо того чтобы искать оригинальное, новое решение для конкретной задачи, они используют тот факт, что им ранее было показано нечто похожее на текущую задачу во время обучения, чтобы найти решение.

Наконец, и, возможно, самое важное, эти модели ограничены универсальным подходом к мышлению. Например, при решении очень сложной задачи модель не может выбрать, сколько времени потребуется на обработку особенно сложного её участка. Конечно, если модели требуется больше времени для решения более сложной задачи, она генерирует больше токенов CoT (Wei et al., 2022)4. Но это не обязательно воспроизводит человеческое мышление, которое включает в себя глубокие этапы размышления без какого-либо реального вербального диалога.

Иерархические модели рассуждений

Знакомство с иерархическими моделями рассуждений (ИМР) (Ван и др., 2025b)1: вместо неуклюжего подхода «думай вслух» они рассуждают молча и бегло, в своём родном скрытом пространстве — богатом, многомерном мире чисел. Это гораздо ближе к нашей собственной интуиции, где глубокие мысли часто предшествуют словам, которые мы используем для их описания.

Сердце этой новой архитектуры удивительно простое, но динамичное: терпеливый H-модуль, задающий общую стратегию, и быстрый низкоуровневый L-модуль, отвечающий за реализацию заданной стратегии на протяжении всего её выполнения. Оба модуля реализованы в виде простых блоков-трансформеров (Vaswani et al., 2017)², установленных друг на друга.

Как мыслит HRM: взгляд изнутри

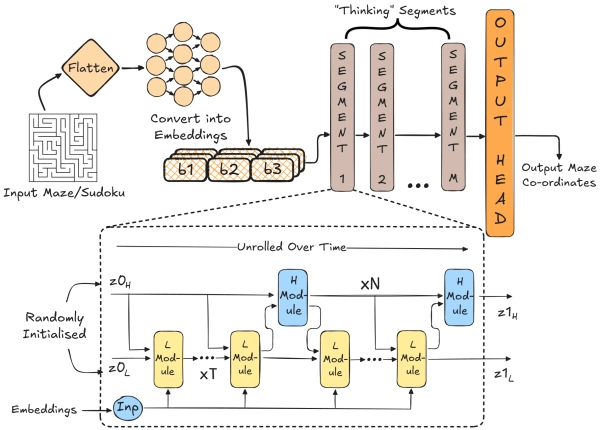

Он превращает процесс «мышления» в динамичную двухскоростную систему. Чтобы понять, как она решает такую сложную задачу, как лабиринт 30×30, давайте рассмотрим весь путь от ввода до ответа.

1. Настройка: внедрение и инициализация

- Сглаживание и встраивание: как следует из названия, входные данные (например, сетка судоку или лабиринт) сглаживаются в одномерный поток фрагментов/токенов, а затем подаются в модель встраивания, которая преобразует интерпретируемый человеком лабиринт в векторы встраивания, понятные машинам.

- Инициализация памяти: теперь создаются два различных модуля: состояние высокого уровня (zH), которое действует как супервизор, определяя общее направление мыслей и рассуждений, и состояние низкого уровня (zL), отвечающее за выполнение рассуждений в заданном направлении.

2. Основной движок: настоящее мышление начинается здесь

По своей сути HRM представляет собой вложенный цикл, и один проход по нему называется «сегментом». Каждый сегмент содержит в себе несколько циклов модулей H и L.

- Шаг А: Составление плана

Модуль высокого уровня (H) начинается с составления плана высокого уровня. Его состояние памяти (zH) поддерживается постоянным в течение заданного количества шагов и инициализируется случайным образом для первого прохода. В нашем примере с лабиринтом этот начальный план может быть очень абстрактным/общим, например, «исследовать пути, ведущие вниз и вправо». - Шаг Б: Реализация плана

Используя план модуля высокого уровня в качестве фиксированного ориентира, модуль низкого уровня (L) начинает серию повторяющихся вычислений. В течение заданного количества временных шагов (T) он итеративно обновляет своё скрытое состояние (zL), используя три входных данных для обработки:- Его собственная работа из предыдущего шага (zL_previous).

- Фиксированный план из Модуля высокого уровня (zH).

- Исходная задача (встроенный лабиринт).

- Модуль низкого уровня, учитывая общую стратегию, исследует многочисленные пути, заходит в тупики, возвращается назад и повторяет действия, пока не придет к выводу, который затем передается в модуль высокого уровня.

- Шаг C: Соответствующее изменение плана

После того, как L-модуль завершает свои повторяющиеся рабочие циклы, его конечное состояние памяти (zL_final), представляющее результат вычислений, передаётся в H-модуль для уточнения. H-модуль корректирует свои планы и разрабатывает новую стратегию, которой L-модуль будет следовать в следующей итерации. Например: «Путь вниз — это в конечном итоге тупик. Новый план — исследовать пути, ведущие направо». - Шаг D: Сброс и повторение

L-модуль получает этот обновлённый план от своего «руководителя» для следующего цикла своей повторяющейся и интенсивной работы. Это продолжается в течение следующих «N» циклов H-модуля, каждый из которых состоит из «T» подциклов L-модуля.

3. Кнопка «Выход»: как решить, когда остановиться

Одного прохода через движок («сегмента») может быть недостаточно для решения более сложной или сложной задачи. Именно здесь вступает в дело самая гениальная функция HRM: адаптивное время вычислений (ACT) (Graves, 2016)6.

После каждого полного этапа размышления (циклов N×T) модель генерирует предварительный ответ. Затем он поступает в простую линейную сеть, которая решает: «Достаточно ли я уверен, чтобы остановиться, или мне стоит подумать ещё?»

- Если модель определяет, что она достаточно уверена в своем ответе, она останавливается и представляет его как окончательное решение.

- Если нет, он решает продолжить «размышления» . Он берёт конечное состояние памяти модулей L и H и использует его в качестве инициализации для совершенно нового сегмента, продолжая процесс размышлений.

Реализация ACT:

Модель учится останавливаться с помощью парадигмы Q-обучения.

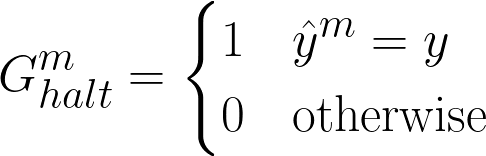

- Q-головка: это простой линейный слой (Q-головка), который принимает вызов для продолжения рассуждений или их остановки. Он считывает конечное состояние памяти H-модуля в конце сегмента и выводит две оценки: Qhalt и Qcontinue.

- Значение «остановки» (Qhalt): эта оценка отражает уверенность модели в том, что ей следует немедленно остановиться. В процессе обучения модель учится предсказывать на основе этой оценки немедленное, окончательное вознаграждение. Цель, на которую она обучается, проста: 1, если предсказанный ответ верный, и 0, если он неверный.

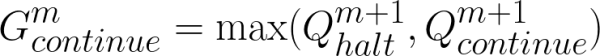

- Значение «Продолжить» (Qcontinue): представляет собой предполагаемое вознаграждение, которое модель получила бы, если бы продолжила анализ для следующего сегмента, а не остановилась прямо сейчас. Её целевой балл — это максимально возможное предполагаемое значение среди двух Q-баллов для следующего сегмента, определяемое как:

- Система двойных потерь: после каждого сегмента мысли общая потеря модели состоит из двух различных целей:

- Потеря задачи: стандартная потеря при получении неправильного ответа (перекрестная энтропия между последовательностями).

- Потеря Q-обучения: потеря ACT из-за принятия неверного решения об остановке (бинарная кроссэнтропия).

- Это позволяет модели одновременно изучать обе цели: как решить заданную задачу и научиться распознавать момент ее решения.

Проверяем: результаты

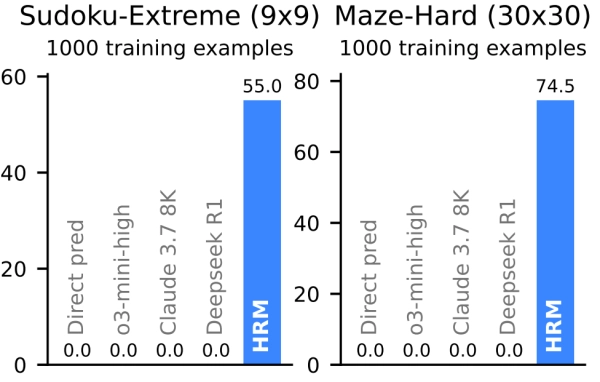

Тесты судоку и лабиринтов

В сравнении с несколькими современными моделями рассуждений HRM демонстрирует значительно лучшие результаты при решении сложных задач на рассуждение, включая головоломки судоку и лабиринты 30×30. Обе эти задачи требуют обширных логических выводов, способности к отступлению и пространственного планирования. Как показано ниже, все остальные модели, использующие цепочку мыслей, не смогли дать ни одного верного решения. Эти результаты подтверждают идею о том, что заставить модели рассуждать в гораздо более репрезентативном латентном пространстве эффективнее, чем заставлять их общаться с самими собой посредством CoT.

Архитектура важнее масштаба: парадигма эффективности

Модель способна на такое достижение, обеспечивая при этом высочайший уровень эффективности параметров и данных. Она достигает своей высочайшей производительности с 27 миллионами параметров, обучаясь с нуля примерно на 1000 точек данных для каждой задачи. Кроме того, ей не требуется дорогостоящего предварительного обучения на веб-масштабных наборах данных или сложных инженерных подходов. Это ещё раз подтверждает гипотезу о том, что модель способна интернализировать общие закономерности и рассуждать гораздо эффективнее, чем стандартный подход, основанный на CoT.

Абстрактное мышление и подвижный интеллект: задача ARC-AGI

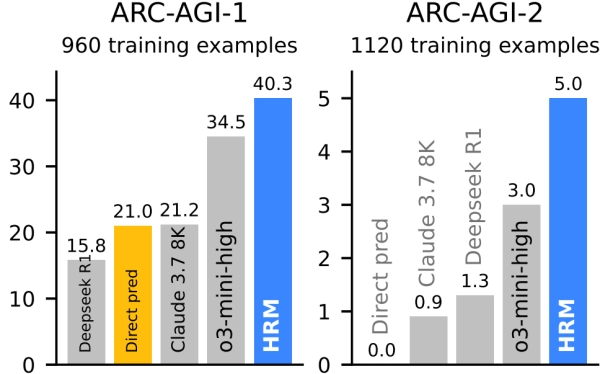

Корпус абстракций и рассуждений (ARC) (Chollet, 2019)5 — общепризнанный эталон для текучего интеллекта, требующий от моделей выведения расплывчатых и абстрактных правил на основе лишь нескольких визуальных примеров. HRM, имеющий всего 27 миллионов параметров, превосходит большинство распространённых моделей рассуждений. Несмотря на свой размер, он набрал 40,3% на ARC-AGI-1, в то время как гораздо более крупные модели с огромными вычислительными возможностями, такие как o3-mini и Claude 3.7, получили оценку ниже среднего — 34,5% и 21,2% соответственно.

Раскрытие истинной вычислительной глубины

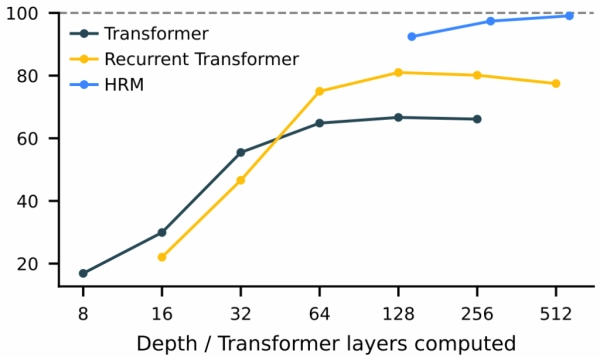

Производительность на архитектурах vanilla transformer быстро выходит на плато при увеличении вычислительной мощности, то есть простое добавление слоёв приводит к снижению эффективности сложных рассуждений. Напротив, точность HRM масштабируется практически линейно с увеличением количества вычислительных шагов. Это прямое доказательство из статьи, что архитектура модели не является системой с фиксированной глубиной. Она обладает внутренней способностью использовать дополнительные вычислительные мощности для решения сложных задач, чего не хватает базовой структуре стандартного Transformer.

Интеллектуальная эффективность: решение проблем с меньшими усилиями

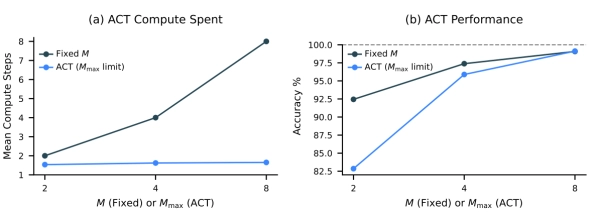

Механизм адаптивного времени вычислений (ACT) позволяет модели динамически распределять вычислительные ресурсы в зависимости от сложности задачи. Модель HRM, оснащённая ACT, достигает той же высочайшей точности, что и модель, жёстко запрограммированная на большое количество шагов, но при этом в среднем потребляет значительно меньше ресурсов. Модель учится экономить вычислительные ресурсы, быстро решая простые задачи и выделяя больше времени на «обдумывание» только при необходимости, демонстрируя интеллектуальную эффективность, выходящую за рамки простых вычислений.

Эти два графика необходимо проанализировать вместе, чтобы оценить эффективность механизма ACT. Ось X на обоих графиках отображает вычислительный бюджет: для модели «Фиксированное M» это точное количество шагов, которые необходимо выполнить, а для модели «ACT» — максимально допустимое количество шагов (Mmax). Ось Y на рисунке (a) показывает среднее количество фактически использованных шагов, а ось Y на рисунке (b) — итоговую точность.

Точность модели «Fixed M» (чёрная линия, рис. b) достигает пика при бюджете 8, но это достигается за счёт использования ровно 8 шагов для каждой задачи (чёрная линия, рис. a). Модель «ACT» (синяя линия, рис. b) достигает практически такой же пиковой точности при максимальном бюджете 8. Однако, как показано на рис. (a), для этого ей требуется в среднем всего около 1,5 шагов. Вывод очевиден: модель ACT обучается достигать той же высочайшей производительности, используя менее четверти вычислительных ресурсов, разумно останавливаясь на ранних этапах решения уже решённых задач.

Ссылки

[1] Ван, Гуань и др. «Иерархическая модель рассуждений». Препринт arXiv arXiv:2506.21734 (2025).

[2] Васвани, Ашиш и др. «Внимание — это всё, что вам нужно». Достижения в области нейронных систем обработки информации 30 (2017).

[3] Хоффманн, Джордан и др. «Обучение оптимальных для вычислений моделей большого языка». Препринт arXiv arXiv:2203.15556 (2022).

[4] Вэй, Джейсон и др. «Цепочка мыслей побуждает к рассуждениям в больших языковых моделях». Достижения в области нейронных систем обработки информации 35 (2022): 24824-24837.

[5] Шолле, Франсуа. «О мере интеллекта». Препринт arXiv arXiv:1911.01547 (2019).

[6] Грейвс, Алекс. «Адаптивное время вычислений для рекуррентных нейронных сетей». Препринт arXiv arXiv:1603.08983 (2016).

Источник: towardsdatascience.com