«Глубокое мышление с уверенностью» — более разумный способ масштабировать задачи рассуждения без траты огромного количества вычислений

Делиться

Введение

Большие языковые модели (LLM) всё чаще решают сложные задачи на рассуждение, такие как задачи математических олимпиад, научные вопросы и ответы и многошаговые логические головоломки [3,8]. Но действительно ли они хороши? Да, хороши, но сейчас они требуют очень больших вычислительных затрат и неэффективны на этапе тестирования [5,6]. Чтобы решить эту проблему, исследователи Meta AI разработали решение под названием « DeepConf », также известное как « Глубокое мышление с уверенностью» [1].

Существует проблема, известная как самосогласованность при голосовании большинством голосов.

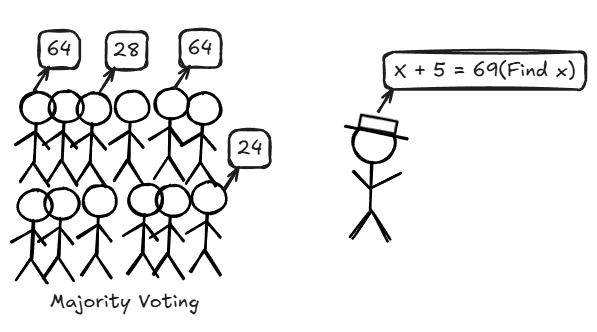

Уверен, вам интересно, как эта задача выглядит на практике. Представьте себе класс из 100 учеников. Вы дали им сложную олимпиадную задачу и час на её решение. В конце вы можете собрать все ответы и проголосовать — ответы, набравшие наибольшее количество голосов, «побеждают».

Именно так работает проблема самосогласованности с большинством в LLM[2,3]. Вместо одного решения модель рассматривает сотни путей рассуждения (например, 512 различных пошаговых решений), а затем выбирает наиболее частый ответ.

В математическом тесте AIME 2025 один проход Qwen3–8B (называемый pass@1) даёт точность около 68% ; это как если бы был получен один ответ от одного ученика. Но если сгенерировать 512 трассировок рассуждений на каждый вопрос (называемых conf@512) и взять ответ большинства, то точность возрастает до 82% [1,4].

Звучит здорово, правда? Загвоздка в том, что эти дополнительные 511 трасс генерируют почти 100 миллионов дополнительных токенов, и увеличение трасс не всегда помогает; производительность остаётся прежней, а иногда даже падает, когда в голосовании доминируют некачественные решения[1,7,8]. Другими словами, если ученики угадывают случайным образом, то голосование класса не отражает лучшего мыслителя в классе[1].

Источник: towardsdatascience.com