Мы предлагаем метод контрастивного самообучения на основе действий (Action-Based Contrastive Self-Training), эффективный с точки зрения использования данных подход к настройке контрастивного обучения с подкреплением для улучшения моделирования многоходовых диалогов в условиях взаимодействия с участием людей, проявляющих смешанную инициативу.

Быстрые ссылки

- Бумага

- Делиться

Большие языковые модели (БЛМ), оптимизированные на основе обратной связи от пользователей, быстро стали ведущей парадигмой для разработки интеллектуальных диалоговых агентов. Однако, несмотря на их высокую производительность во многих тестовых задачах, агентам на основе БЛМ по-прежнему может не хватать навыков многоходового диалога, таких как разрешение неоднозначности — сталкиваясь с неопределенностью, они часто уклоняются от ответа или неявно угадывают истинные намерения пользователей, вместо того чтобы задавать уточняющие вопросы. При этом количество высококачественных примеров диалогов часто ограничено, что является узким местом для способности БЛМ обучаться оптимальным действиям в диалоге.

В докладе «Обучение уточнению: многоходовые диалоги с использованием контрастивного самообучения на основе действий» (представленном на ICLR 2025) мы предлагаем алгоритм контрастивного самообучения на основе действий (ACT), квази-онлайн алгоритм оптимизации предпочтений, основанный на прямой оптимизации предпочтений (DPO), который обеспечивает эффективное с точки зрения данных обучение политике диалога в многоходовом моделировании разговоров. Мы демонстрируем эффективность ACT в сценариях эффективной настройки с использованием данных, применяя множество реальных задач диалога, таких как ответы на вопросы на основе таблиц и машинное понимание прочитанного. Мы также представляем AmbigSQL, новую задачу для разрешения неоднозначности запросов на поиск информации для генерации сложного кода языка структурированных запросов (SQL) с целью облегчения разработки агентов анализа данных. Кроме того, мы предлагаем оценить способность LLM функционировать в качестве диалоговых агентов, изучив, могут ли они неявно распознавать и рассуждать об неоднозначности в разговоре. Метод ACT демонстрирует существенное улучшение моделирования диалогов по сравнению со стандартными подходами к настройке, такими как контролируемая тонкая настройка и DPO.

Разговорный агент, способный к разрешению неоднозначностей, мог бы распознать наличие неоднозначности и задать уточняющий вопрос для получения более точного окончательного ответа.

Новый взгляд на разговорное мышление

Традиционные нейронные подходы к созданию диалоговых агентов обычно состоят из двух основных компонентов: модуля для понимания и планирования диалога (например, задача бинарного прогнозирования для определения уместности задавания уточняющего вопроса) и модуля генерации, который может выполнять такие действия в диалоге (т. е. формировать уточняющий вопрос или попытку ответа). Однако в современной парадигме взаимодействия LLM-ы обычно адаптируются для сквозного использования в диалоговых приложениях без промежуточного этапа планирования. Мы предлагаем прямую оптимизацию планирования действий в диалоге как неявную подзадачу генерации ответа. Мы называем эту парадигму неявным планированием действий.

Обучение модели LLM для последующего использования состоит из трех этапов: предварительное обучение, контролируемая тонкая настройка (SFT) для следования инструкциям и настройка для соответствия предпочтениям человека. Распространенным алгоритмом, используемым на этом заключительном этапе настройки, является DPO, алгоритм контрастивного обучения вне политики, предназначенный для оптимизации вероятностей выигрышных и проигрышных последовательностей, таких как ответы в разговоре. Однако такие алгоритмы, как правило, все еще не соответствуют многоходовому характеру разговоров. Предложенный алгоритм ACT призван решить эти проблемы.

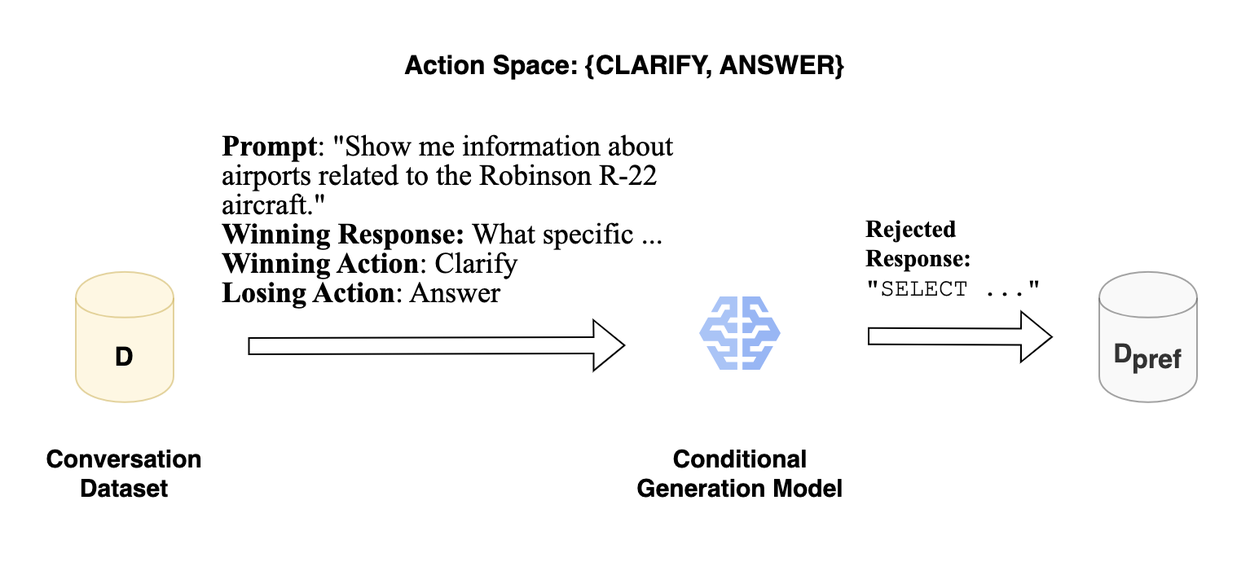

Этап 1: Генерация сравнительных данных на основе действий.

Первый этап построения ACT включает в себя создание набора данных о предпочтениях, состоящего из пар ответов в диалоге, где один соответствует выигрышному действию, а другой — проигрышному.

Мы начинаем с исходного набора данных, описывающего диалог. Для каждого хода диалога в этом наборе данных мы используем историю разговора как часть входного запроса («Покажите мне информацию…» на рисунке ниже) в дополнение к любому необходимому контексту, специфичному для задачи (например, схеме базы данных SQL), и рассматриваем этот ход как выигрышный ответ («Что конкретно…», ниже). Этот выигрышный ответ выражает действие (здесь «Уточнить»), и, таким образом, мы синтезируем отклоненный ответ, представляющий собой некоторое обратное действие (здесь «Ответить»), используя некоторую модель условной генерации. Результатом этого этапа является парный набор данных, в котором каждый из отклоненных ответов генерируется синтетически.

Обзор этапа генерации данных в рамках проекта ACT.

Этап 2: Контрастное самообучение

Второй этап включает настройку модели политики с использованием целевой функции DPO. Мы можем использовать подсказки из первого этапа, но вместо прямого запуска DPO с использованием ранее построенных контрастных пар, мы выполняем обучение на основе политики, руководствуясь несколькими интуитивными соображениями:

- Алгоритмы, подобные DPO, работают путем оптимизации логарифмических вероятностей, присвоенных выигрышным и проигрышным ответам.

- По своей сути, выборка ответов в соответствии с политикой приводит к получению последовательностей токенов с высокой вероятностью.

- Для улучшения разговорных навыков необходима оптимизация на протяжении нескольких диалогов, которую сложно выразить, используя только пары контрастов, повторяющиеся в одном диалоге.

На рисунке ниже показано, как работает ACT в соответствии с этими интуитивными представлениями. Вместо прямого обновления градиента в автономном режиме с использованием фиксированных контрастных пар, мы выполняем выборку в рамках политики. Сначала мы определяем, выражает ли ответ правильное действие (например, уточняющий вопрос), и если да, то моделируем результат траектории и оцениваем результат по отношению к намерению поиска информации, заданному в исходном разговоре. В зависимости от того, является ли результат правильным, мы заменяем либо выигрышный, либо проигрышный ответ из контрастной пары на этапе 1 смоделированной многошаговой траекторией .

Обзор этапа настройки ACT. Для каждой начальной пары контрастных вариантов из набора данных предпочтений Фазы 1 мы выбираем ответ, соответствующий политике, из модели, которая настраивается. Мы оцениваем траекторию, полученную в результате выбора ответа, а затем обновляем пару контрастных вариантов, заменяя существующий выигрышный или проигрышный ответ. Политика обновляется с использованием целевой функции DPO.

Развитие передовых возможностей моделирования многооборотных процессов.

Мы экспериментировали с ACT, используя LLM с открытыми весами, на разнообразном наборе данных для многоходовых диалогов: PACIFIC (рассуждение над таблицами, смешанными с текстом), Abg-CoQA (рассуждение над сложными фрагментами текста) и AmbigSQL (генерация текста в SQL). Мы сравнивали результаты с различными конкурирующими базовыми моделями, включая:

- Контролируемая тонкая настройка с использованием функции потерь на основе кросс-энтропии (SFT)

- Итеративная оптимизация предпочтений на основе рассуждений (IRPO)

- Использование примеров контекстного обучения (ICL) в Gemini 1.5 для стимулирования работы системы.

- Использование примеров ICL для обучения Клода (версия 3.5).

Диалоговые ответы на вопросы с использованием табличных данных по Тихоокеанскому региону.

На рисунке ниже видно, что во всех трех вариантах оптимизации данных, рассмотренных для PACIFIC, ACT демонстрирует наилучшие результаты по всем метрикам по сравнению с SFT и Gemini с подсказками, что имеет преимущество в виде дополнительных вычислений во время тестирования. В частности, ACT обеспечивает относительное улучшение до 19,1% по сравнению с SFT при измерении способности настроенной модели неявно распознавать неоднозначность (с 69,0 до 82,2 Macro F1) при использовании всего 50 диалогов в качестве данных для настройки. Мы также отмечаем, что ACT значительно улучшил эффективность использования данных по сравнению с SFT на основе адаптера с Gemini Pro, с относительным улучшением до 35,7% в производительности многоходовой задачи (с 45,6 до 61,9 по показателю DROP F1 на уровне траектории). Кроме того, настройка с помощью ACT в этих условиях ограниченного объема данных позволяет модели соответствовать или превосходить передовые LLM, используемые с контекстным обучением, несмотря на отсутствие контекстных примеров во время вывода. В целом, мы обнаружили, что обучение на основе стратегии и моделирование траектории в несколько этапов имеют решающее значение для повышения эффективности достижения целей в несколько этапов.

Метод ACT значительно превосходит стандартные подходы к настройке в условиях эффективного использования данных при моделировании диалогов.

В нашей статье мы представляем расширенные результаты на корпусе PACIFIC, где демонстрируем, что ACT превосходит IRPO. Кроме того, мы приводим результаты, полученные на Abg-CoQA и AmbigSQL.

Приписывание повышения успеваемости результатам ACT

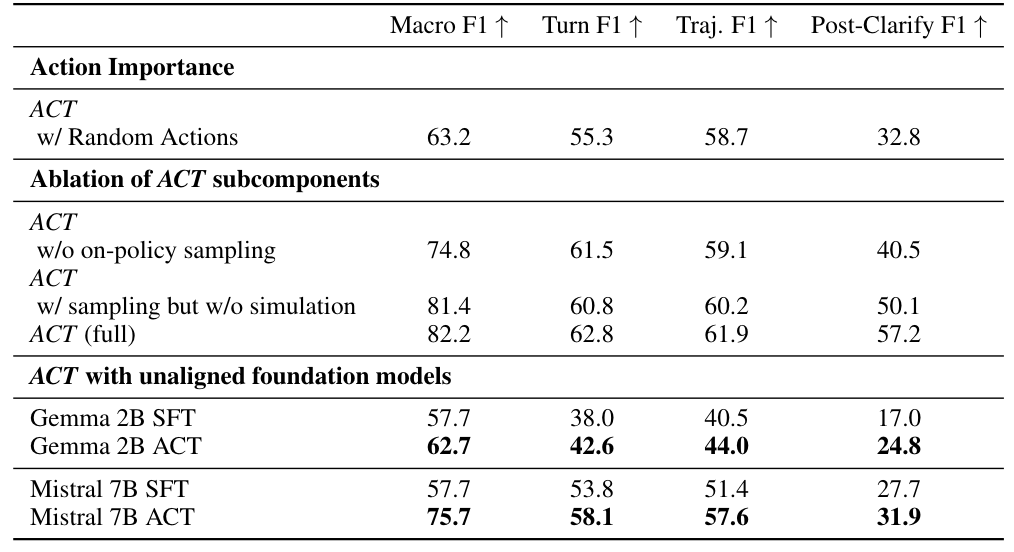

Мы провели несколько экспериментов, чтобы понять преимущества каждого компонента ACT, результаты которых представлены ниже:

Исследование абляции различных компонентов АКТ с использованием PACIFIC.

Необходимы ли предпочтения, основанные на действиях? Один из ключевых факторов ACT заключается в том, что контрастные пары подчеркивают различия между действиями в разговоре. В работе «ACT со случайными действиями» мы дополнительно исследуем важность выбора действия, случайным образом выбирая как выигрышное, так и проигрышное действие при построении пары предпочтений, и наблюдаем, что это дает худшие результаты по сравнению с обычным ACT.

Нужна ли нам выборка в рамках политики? В работе «ACT без выборки в рамках политики» мы исследуем важность выборки в рамках политики, оценивая обычный DPO вне политики на наборе данных, созданном на этапе 1. Хотя мы наблюдаем некоторые улучшения по сравнению с SFT (например, с 69,0 до 74,8 Macro F1), общие улучшения гораздо больше при использовании выборки в рамках политики, чем при полной ACT. Это может быть связано с тем, что отрицательные ответы вне политики не гарантированно находятся в языковом многообразии модели политики, и сдвиг распределения может быть слишком сложным для преодоления с помощью обучения вне политики.

Необходима ли симуляция траектории? ACT лучше подходит для многоходовых диалогов благодаря симуляции траектории. Без многоходовой симуляции наш подход можно рассматривать аналогично вариантам DPO, основанным на политике, таким как IRPO, но с сигналом вознаграждения, специфичным для диалога, который учитывает действия в диалоге и эвристики задач. В работе «ACT с выборкой без симуляции» мы обнаружили, что эта симуляция на уровне траектории имеет решающее значение для повышения производительности в многоходовых диалогах, особенно для способности модели политики рассуждать о собственных уточняющих вопросах.

Является ли ACT модель-независимой? Базовая модель в наших основных экспериментах, Zephyr, получена путем выравнивания Mistral. В эксперименте «ACT с невыровненными базовыми моделями» мы наблюдаем разницу в производительности в 6,5 Action F1 и 4,3 Trajectory F1 после настройки ACT для двух моделей. Однако наши результаты показывают, что ACT может улучшить производительность независимо от предварительного выравнивания с обратной связью от человека, хотя он может помочь в качестве улучшенной инициализации модели. В целом, мы обнаружили, что улучшение производительности базовой модели с помощью ACT не зависит от модели.

Будущее моделирования многоходовых диалогов

Мы предлагаем ACT — независимый от модели квази-онлайн подход к контрастной настройке для эффективной адаптации к задачам диалогового взаимодействия, а также рабочий процесс для оценки диалоговых агентов. Мы демонстрируем обнадеживающие результаты, свидетельствующие о высокой эффективности ACT для адаптации к задачам в условиях ограниченного объема данных. В будущих исследованиях можно также рассмотреть возможность объединения ACT с существующими сложными подходами к настройке для сложных задач, таких как генерация текста в SQL, а также обобщение на большие объемы данных и многозадачные среды.

Благодарности

Мы глубоко благодарны Ханьцзюнь Дай за полезные отзывы о нашей рукописи, а также Та-Чун Чи и Кунь Цянь за их советы. Мы также хотели бы отметить Криса Барона и Випина Наира, чьи усилия сыграли решающую роль в успехе этой работы. Эта работа была выполнена в Google Cloud AI Research, где Максимилиан Чен был студентом-исследователем, а Руоси Сунь — научным сотрудником.

Источник: research.google