Попытка наделить роботов искусственным интеллектом выявляет большие практические проблемы — и более серьезные этические проблемы

У меняn ресторанов по всему миру, от Шанхая до Нью-Йорка роботы готовят еду. Они готовят бургеры и десерты, пиццу и картофель фри практически так же, как роботы готовили другие блюда в течение последних 50 лет: точно следуя инструкциям, выполняя одни и те же действия одним и тем же способом, снова и снова.

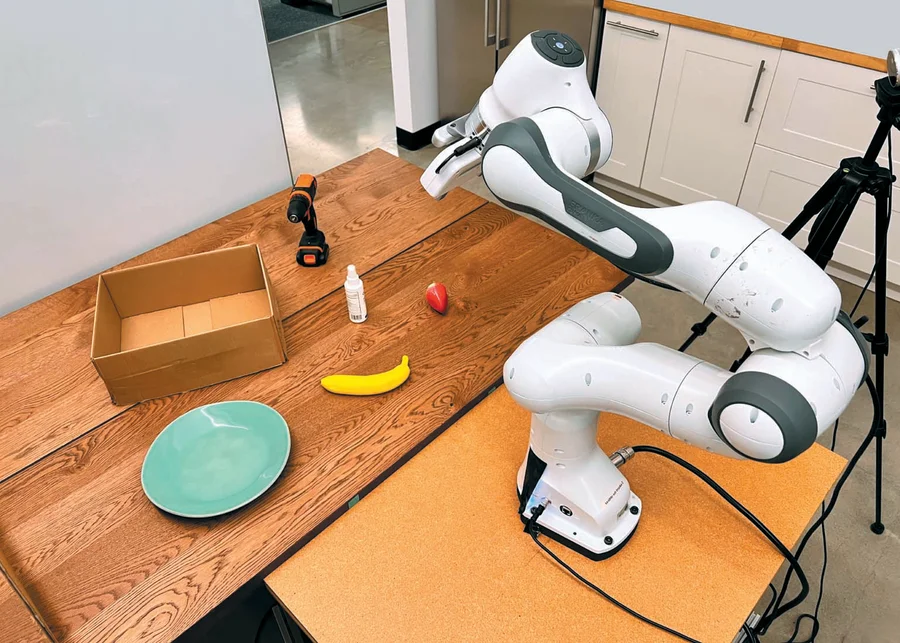

Но Ишика Сингх хочет создать робота, который сможет приготовить ужин — такого, который сможет пойти на кухню, порыться в холодильнике и шкафчиках, достать ингредиенты, из которых получится одно-два вкусных блюда, а затем накрыть на стол. Это так просто, что это может сделать даже ребенок. Но ни один робот не сможет. Для программирования роботов требуется слишком много знаний об одной кухне — и слишком много здравого смысла, гибкости и изобретательности.

Проблема в том, — говорит Сингх, аспирант. в области компьютерных наук в Университете Южной Калифорнии говорят, что робототехники используют классический конвейер планирования. «Они формально определяют каждое действие и его предпосылки и предсказывают его эффект», — говорит она. «Он определяет все, что возможно или невозможно в окружающей среде.» Даже после многих циклов проб и ошибок и тысяч строк кода в результате этих усилий получится робот, который «не справится», когда столкнется с чем-то, чего не предусмотрела его программа».я не предвижу.

О поддержке научной журналистики

Если вам понравилась эта статья, подумайте о том, чтобы поддержать нашу журналистику, отмеченную наградами, подписавшись на нее. Приобретая подписку, вы помогаете обеспечить будущее впечатляющих историй об открытиях и идеях, формирующих наш современный мир.

Поскольку робот, обслуживающий обед, формулирует свою «политику» — план действий, которому он будет следовать для выполнения своих инструкций, — он должен быть осведомлен о том, что не просто особая культура, в которой его готовят (что в наших краях означает «острый»?) но конкретная кухня, на которой он готовится (есть ли там рисоварка, спрятанная на верхней полке?), и конкретные люди, которых он кормит (Гектор будет очень голоден после тренировки) в этот конкретный вечер (придет тетя Барбара, так что без глютена и молочных продуктов).. Он также должен быть достаточно гибким, чтобы справляться с неожиданностями и несчастными случаями (я уронил масло! Что я могу заменить?).

Большие языковые модели могут быть похожи на человеческие, но они далеки от человеческих возможностей; они часто они «галлюцинируют» или выдумывают что-то, и их обманывают.

Джесси Томасон, профессор компьютерных наук в Университете Южной Калифорнии, который руководит исследованиями доктора философии Сингха, говорит, что именно этот сценарий «был достижимой целью»Возможность поручить роботам любую человеческую работу преобразила бы отрасли промышленности и упростила бы повседневную жизнь.

Несмотря на все впечатляющие видеоролики на YouTube о роботах-работниках склада, роботах-собаках, роботах-медсестрах и, конечно же, роботах-автомобилях, ни одна из этих машин не обладает гибкостью и способностью справляться с трудностями, присущими человеку. «Классическая робототехника очень хрупка, потому что вам приходится обучать робота карте мира, но мир постоянно меняется», — говорит Нагананд Мурти, генеральный директор Electric Sheep, компании, чьи ландшафтные роботы должны справляться с постоянными изменениями погоды, рельефа местности и предпочтений владельцев. На данный момент большинство работающих роботов работают так же, как и их предшественники поколение назад: в строго ограниченных условиях, которые позволяют им следовать строго ограниченному сценарию, многократно выполняя одни и те же действия.

Создатели роботов любой эпохи с удовольствием встроили бы в тела роботов хитрый, практичный мозг. Однако на протяжении десятилетий ничего подобного не существовало. Компьютеры были столь же невежественны, как и их собратья-роботы. Затем, в 2022 году, появился ChatGPT, удобный интерфейс для большой языковой модели (LLM) под названием GPT-3. Эта компьютерная программа, как и все большее число других LLM, генерирует текст по запросу, имитирующий человеческую речь и письменную форму. Он был обучен такому количеству информации об обедах, кухнях и рецептах, что может ответить практически на любой вопрос, который может возникнуть у робота о том, как превратить определенные ингредиенты на одной конкретной кухне в блюдо.

У магистров есть то, чего нет у роботов: доступ к знаниям практически обо всем, что когда-либо было написано людьми, от квантовой физики до кей-поп музыки и размораживания филе лосося. В свою очередь, у роботов есть то, чего не хватает магистрам: физические тела, которые могут взаимодействовать с окружающим миром, связывая слова с реальностью. Представляется вполне логичным соединить безмозглых роботов и бестелесных магистров, чтобы, как пишут авторы одной статьи 2022 года, «робот мог действовать как языковая модель «руками и глазами», в то время как языковая модель предоставляет семантические знания высокого уровня о задача.”

В то время как остальные из нас использовали LLM для того, чтобы бездельничать или выполнять домашнюю работу, некоторые робототехники рассматривали их как способ для роботов обойти ограничения, установленные предварительным программированием. Появление этих моделей, похожих на человеческие, положило начало «гонке между промышленностью и академическими кругами в поисках наилучших способов обучения магистрантов управлению инструментами», — написали Брюс Шнайер, специалист по технологиям безопасности, и Натан Сандерс, специалист по обработке данных, в обзорной статье 2023 года.

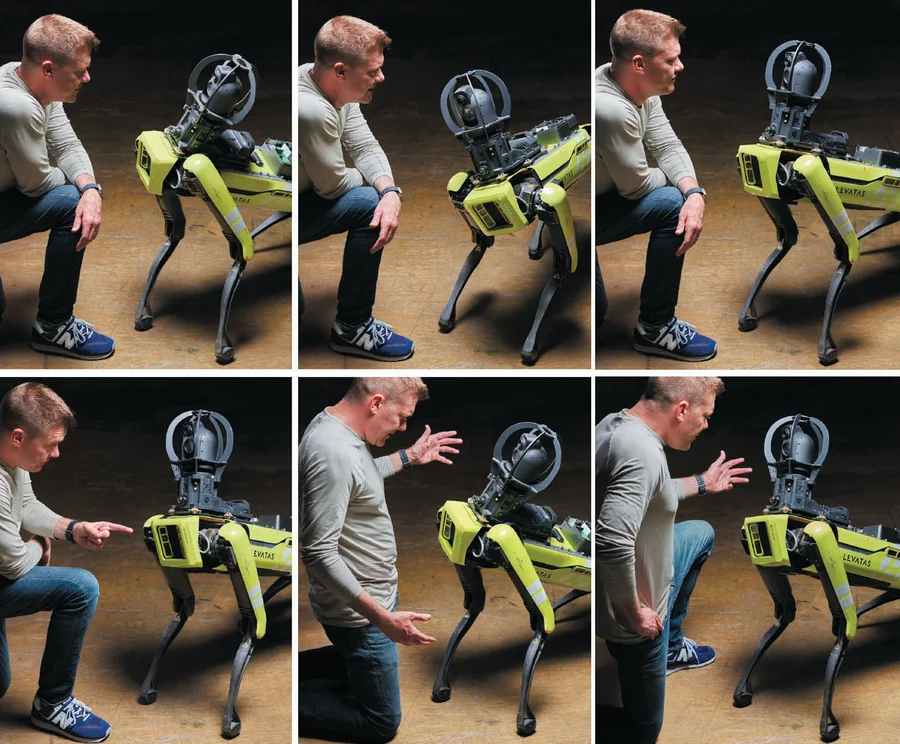

Когда в конце 2022 года был выпущен ChatGPT, это было «что-то вроде «ага! момент» для инженеров Levatas, фирмы из Уэст-Палм-Бич, которая занимается разработкой программного обеспечения для роботов, патрулирующих и инспектирующих промышленные объекты,говорит ее генеральный директор Крис Нильсен. Совместно с ChatGPT и Boston Dynamics компания создала прототип робота-собаки, который может говорить, отвечать на вопросы и следовать инструкциям, которые даются на обычном разговорном английском, что избавляет от необходимости обучать работников, как им пользоваться. “ Для среднестатистического промышленного работника, не имеющего подготовки по робототехнике, мы хотим предоставить им способность на естественном языке приказывать роботу сесть или вернуться на свое место», — говорит Нильсен.

Робот Levatas, оснащенный LLM, похоже, улавливает значение слов — и намерение, стоящее за ними. Он «знает», что, хотя Джейн говорит «отойди», а Джо говорит «отойди», они оба означают одно и то же. Вместо того, чтобы изучать электронную таблицу с данными последнего обхода машины, работник может просто спросить: «Какие показания были за пределами нормы во время вашего последнего обхода?»

<п class="" данные-блок="sciam/пункте">не важно, насколько сложная его поведения, любой робот имеет лишь ограниченное число датчиков, которые подбирают информацию об окружающей среде (камер, радара, лидара, микрофоны и детекторы угарного газа, чтобы назвать несколько примеров). Они соединены с ограниченным количеством рук, ног, захватов, колес или других механизмов. За восприятие и действия робота отвечает его компьютер, который обрабатывает данные датчиков и любые инструкции, полученные от программиста. Компьютер преобразует информацию в 0 и 1 машинного кода, представляющего «выключено» (0) и «включено» (1) количество электричества, протекающего по цепям.Используя свое программное обеспечение, робот просматривает ограниченный набор действий, которые он может выполнять, и выбирает те, которые наилучшим образом соответствуют его инструкциям. Затем он посылает электрические сигналы своим механическим частям, заставляя их двигаться. Затем он узнает от своих датчиков, как это повлияло на окружающую среду, и снова реагирует. Этот процесс основан на использовании металла, пластика и электричества для перемещения в реальном месте, где робот выполняет свою работу.

<п class="" данные-блок="sciam/пункте">не важно, насколько сложная его поведения, любой робот имеет лишь ограниченное число датчиков, которые подбирают информацию об окружающей среде (камер, радара, лидара, микрофоны и детекторы угарного газа, чтобы назвать несколько примеров). Они соединены с ограниченным количеством рук, ног, захватов, колес или других механизмов. За восприятие и действия робота отвечает его компьютер, который обрабатывает данные датчиков и любые инструкции, полученные от программиста. Компьютер преобразует информацию в 0 и 1 машинного кода, представляющего «выключено» (0) и «включено» (1) количество электричества, протекающего по цепям.Используя свое программное обеспечение, робот просматривает ограниченный набор действий, которые он может выполнять, и выбирает те, которые наилучшим образом соответствуют его инструкциям. Затем он посылает электрические сигналы своим механическим частям, заставляя их двигаться. Затем он узнает от своих датчиков, как это повлияло на окружающую среду, и снова реагирует. Этот процесс основан на использовании металла, пластика и электричества для перемещения в реальном месте, где робот выполняет свою работу.Машинное обучение, напротив, основано на метафорах в воображаемом пространстве. Это выполняется с помощью «нейронной сети» — нулей и единиц электрических цепей компьютера, представленных в виде ячеек, расположенных слоями. (Первыми такими сетями были попытки смоделировать человеческий мозг.) Каждая ячейка отправляет и получает информацию по сотням соединений. Она присваивает каждому входному сигналу определенный вес. Ячейка суммирует все эти значения, чтобы решить, оставаться ли ей спокойной или «открыть огонь», то есть отправить свой собственный сигнал другим ячейкам. Точно так же, как большее количество пикселей придает фотографии больше детализации, чем больше связей у модели, тем более детализированными получаются результаты. Обучение в «машинном обучении» — это модель, корректирующая свои значения по мере приближения к желаемому людьми ответу.

За последние 15 лет машинное обучение показало себя потрясающе эффективным. обученный, он способен выполнять специализированные задачи, такие как поиск белковых складок или отбор кандидатов на работу для очного собеседования. Но магистры — это форма машинного обучения, которая не ограничивается конкретными задачами. Они могут говорить о чем угодно и делают это.

Поскольку ее ответ — это всего лишь предположение о том, как сочетаются слова, программа на самом деле не понимает, что она говорит. Но люди понимают. А поскольку LLM работают простыми словами, им не требуется специальной подготовки или инженерных знаний. Любой желающий может общаться с ними на английском, китайском, испанском, французском и других языках (хотя многие языки по-прежнему отсутствуют или недопредставлены в ходе революции LLM).

Эти языковые программы просто механически манипулируют словами, или их работа дает им некоторую модель того, что эти слова представляют?

Когда вы отправляете LLM запрос — вопрос, просьбу или инструкцию — модель преобразует ваши слова в числа, математическое представление их взаимосвязи друг с другом. Затем эти математические данные используются для составления прогноза: учитывая все данные, если бы ответ на это приглашение уже существовал, каким бы он, вероятно, был? Полученные числа преобразуются обратно в текст. Что «большого» в больших языковых моделях, так это количество входных значений, доступных для настройки. Было заявлено, что представленный в 2018 году первый LLM от OpenAI, GPT-1, содержал около 120 миллионов параметров (в основном, веса, хотя этот термин также включает в себя настраиваемые аспекты модели). В отличие от этого, в OpenAI GPT-4, как сообщается, их более триллиона. В Wu Dao 2.0, языковой модели Пекинской академии искусственного интеллекта, — 1,75 триллиона.

Именно из-за того, что у них так много параметров для точной настройки и так много языковых данных в их обучающем наборе, магистры часто дают очень хорошие прогнозы — достаточно хорошие, чтобы заменить здравый смысл и базовые знания, которыми не обладает ни один робот. «Новый этап заключается в том, что больше не нужно указывать много справочной информации, такой как «На что похожа кухня?» — объясняет Томасон. «Эта штука перерабатывает рецепт за рецептом, поэтому, когда я говорю: «Приготовьте картофельную окрошку», система будет знать, что нужно сделать: найти картофель, найти нож, натереть картофель на терке и так далее».

Робот, подключенный к LLM, представляет собой однобокую систему: безграничные языковые способности соединены с телом, которое может выполнять лишь малую часть того, что может делать человек. Робот не сможет деликатно разделать лосося, если у него есть только двухпалый захват для перемещения предметов. Если его спросят, как приготовить обед, магистр права, который черпает ответы из миллиардов слов о том, как люди что-то делают, предложит действия, которые робот не может выполнить.

Добавление к созданным- ограниченность — это аспект реального мира, который философ Хосе А. Бенардете назвал «абсолютной ограниченностью вещей». Например, меняя место, где висит занавеска, вы меняете способ отражения света от объекта, поэтому робот в комнате выигрывает.это не так хорошо видно с помощью камеры; захват, который хорошо подходит для круглого апельсина, может не справиться с яблоком менее правильной формы. Как выразились Сингх, Томасон и их коллеги, «реальный мир привносит случайность». Прежде чем внедрить программное обеспечение для роботов в реальную машину, робототехники часто тестируют его на роботах виртуальной реальности, чтобы смягчить изменчивость реальности.

«При нынешнем положении вещей понимание языка потрясающее, а роботы — отстой», — полушутя говорит Стефани Теллекс. Как робототехник из Университета Брауна, которая занимается изучением языка роботами, она говорит, что «роботы должны совершенствоваться, чтобы не отставать».

Это узкое место, с которым столкнулись Томасон и Сингх, когда начали изучать, что может сделать магистр права для их работы. Магистр права давал роботу инструкции, например: «Установите таймер в микроволновой печи на пять минут.»Но у робота не было ушей, чтобы услышать тиканье таймера, а его собственный процессор все равно мог отсчитывать время. Исследователям нужно было разработать подсказки, которые бы подсказывали LLM ограничить свои ответы тем, что робот должен был делать и что он мог бы делать.

Сингх подумал, что возможным решением было бы использовать проверенный метод для как помочь магистрам избежать ошибок в математике и логике: дайте подсказки, включающие примерный вопрос и пример того, как его решить. Программы LLM не были созданы для того, чтобы рассуждать логически, поэтому исследователи обнаружили, что результаты значительно улучшаются, когда за вопросом-подсказкой следует пример — с указанием каждого шага — того, как правильно решить аналогичную проблему.

Она и Томасон протестировали полученный метод, названный ProgPrompt., как на физическом манипуляторе, так и на виртуальном роботе. В виртуальной среде ProgPrompt разработал планы, которые робот мог выполнять практически постоянно, и эти планы были успешными с гораздо большей скоростью, чем любая предыдущая система обучения. В то же время реальный робот, которому поручались более простые задачи по сортировке, почти всегда добивался успеха.

<источника Media="(мин-ширина: 0px)" элемент srcset="https://static.scientificamerican.com/sciam/cache/file/C58885F3-A5AC-4C76-81CA07E46CE1B3F7_medium.jpg?w=1000 1000Вт, https://static.scientificamerican.com/sciam/cache/file/C58885F3-A5AC-4C76-81CA07E46CE1B3F7_medium.jpg?w=1200 1200Вт, https://static.scientificamerican.com/sciam/cache/file/C58885F3-A5AC-4C76-81CA07E46CE1B3F7_medium.jpg?w=1350 1350w, https://static.scientificamerican.com/sciam/cache/file/C58885F3-A5AC-4C76-81CA07E46CE1B3F7_medium.jpg?w=1536 1536w, https://static.scientificamerican.com/sciam/cache/file/C58885F3-A5AC-4C76-81CA07E46CE1B3F7_medium.jpg?w=600 600 Вт, https://static.scientificamerican.com/sciam/cache/file/C58885F3-A5AC-4C76-81CA07E46CE1B3F7_medium.jpg?w=750 750 Вт https://static.scientificamerican.com/sciam/cache/file/C58885F3-A5AC-4C76-81CA07E46CE1B3F7_medium.jpg?w=900 900 Вт" размеры="(мин-ширина: 1536 пикселей) 1536 пикселей, (мин-разрешение: 3dppx) 50vw, (мин-разрешение: 2dppx) 75vw, 100vw"/> <п class="" данные-блок="sciam/пункте">исследования ученых Кароль Хаусман и Брайан Ichter—не теперь как в ИИ и робототехники компании физического интеллекта, которые они соучредителем—не работали с коллегами в Гугле на другую стратегию для превращения ЛЛМ–это выход на поведение робота. В своей системе SayCan PaLM LLM от Google начинается со списка всех простых действий, которые может выполнять робот. Сообщается, что его ответы должны включать элементы из этого списка. После того, как человек обращается к роботу с запросом на разговорном английском (или французском, или китайском), LLM выбирает из своего списка поведение, которое, по его мнению, с наибольшей вероятностью приведет к успеху в качестве ответа.

<п class="" данные-блок="sciam/пункте">исследования ученых Кароль Хаусман и Брайан Ichter—не теперь как в ИИ и робототехники компании физического интеллекта, которые они соучредителем—не работали с коллегами в Гугле на другую стратегию для превращения ЛЛМ–это выход на поведение робота. В своей системе SayCan PaLM LLM от Google начинается со списка всех простых действий, которые может выполнять робот. Сообщается, что его ответы должны включать элементы из этого списка. После того, как человек обращается к роботу с запросом на разговорном английском (или французском, или китайском), LLM выбирает из своего списка поведение, которое, по его мнению, с наибольшей вероятностью приведет к успеху в качестве ответа.

В одном во время демонстрации проекта исследователь пишет: «Я только что разобрался, не могли бы вы принести мне что-нибудь выпить и перекусить, чтобы прийти в себя?» Магистр права считает, что «найти бутылку воды» с большей вероятностью удовлетворит просьбу, чем «»найди яблоко». Робот, однорукое устройство на колесах, похожее на нечто среднее между подъемным краном и торшером, въезжает на кухню лаборатории, находит бутылку воды и приносит ее исследователю. Затем он возвращается. Поскольку вода уже доставлена, магистр права теперь оценивает «найди яблоко» более высоко, и робот забирает яблоко. Благодаря знанию магистром того, что люди говорят о тренировках, система «знает», что не стоит приносить ему сладкую газировку или нездоровый перекус.

&»Вы можете сказать роботу: «Принеси мне кофе», и робот принесет вам кофе», — говорит Фэй Ся, один из ученых, разработавших SayCan. «Мы хотим достичь более высокого уровня понимания. Например, вы можете сказать: «Я плохо спал прошлой ночью. Не могли бы вы мне помочь?»И робот должен знать, как принести вам кофе».

Стремление к более высокому уровню понимания со стороны магистра права вызывает вопрос: являются ли эти языковые программы просто манипулируют словами механически, или их работа дает им какую-то модель того, что эти слова представляют? Когда магистр права предлагает реалистичный план приготовления еды, «кажется, что в этом есть какая-то логика», — говорит специалист по робототехнике Анирудха Маджумдар, профессор инженерного дела Принстонского университета. Никто из участников программы «не знает», что лосось — это рыба, и что в пищу употребляется много рыбы, и что рыба плавает. Но все эти знания подразумеваются в словах, которые она произносит. «Трудно понять, что именно этопредставление выглядит так», — говорит Маджумдар. «Я не уверен, что на данный момент у нас есть четкий ответ.»

В одном эксперименте Маджумдар, Картик Нарасимхан, профессор Принстонского университета. факультет компьютерных наук и их коллеги использовали неявную карту мира LLM для решения того, что они называют одной из «величайших задач» робототехники: дать роботу возможность работать с инструментом, с которым он еще не сталкивался и для использования которого он не был запрограммирован.

Их система демонстрировала признаки «мета-обучения», или «научения учиться» — способности применять полученные ранее знания в новых контекстах (как, например, плотник может найти новый инструмент, проанализировав, насколько он похож на инструмент, которым она уже овладела). Исследователи в области искусственного интеллекта разработали алгоритмы для мета-обучения, но в Принстонском исследовании стратегия не была запрограммирована заранее. Ни одна отдельная часть программы не знает, как это сделать, говорит Маджумдар. Вместо этого свойство проявляется во взаимодействии множества его различных ячеек. «По мере увеличения размера модели вы получаете возможность учиться, чтобы учиться.»

Исследователи собрали ответы GPT-3 на запрос, «Опишите назначение молотка в подробном и научном ответе». Они повторили это упражнение для 26 других инструментов, начиная от скребков и заканчивая топорами. Затем они включили ответы магистра права в процесс обучения виртуальной роботизированной руки. Столкнувшись с ломом, робот, прошедший обычную подготовку, попытался поднять незнакомый предмет за его изогнутый конец. Но робот, оснащенный GPT-3, правильно поднял лом за его длинный конец. Подобно человеку, роботизированная система смогла «обобщить» и взяться за ручку лома, потому что она видела другие инструменты с ручками.

Независимо от того, делают ли машины логические выводы или следуют рецепту, их способности вызывают серьезные опасения по поводу их реального воздействия. Программы LLM по своей сути менее надежны и доступны для понимания, чем классическое программирование, и это беспокоит многих специалистов в этой области. «Есть робототехники, которые считают, что на самом деле плохо приказывать роботу что-то делать, не имея представления о том, что это значит», — говорит Томасон.

Несмотря на то, что Гэри Маркус, психолог и технический предприниматель, который стал известным скептиком в отношении LLMS, назвал проект Google PaLM-SayCan «невероятно крутым», он пришел к выводу, что выступит против проекта в 2023 году. Маркус утверждает, что магистры могут быть опасны внутри робота, если они неправильно понимают желания человека или не в состоянии в полной мере оценить последствия запроса. Они также могут причинить вред, когда не понимают, чего хочет человек, — если человек не замышляет ничего хорошего.

«Я не думаю, что в целом безопасно запускать [LLMS] в производство для использования с клиентами, независимо от того, робот это или нет», — говорит Томасон. В рамках одного из своих проектов он отклонил предложение о внедрении LLMS в вспомогательные технологии для пожилых людей. «Я хочу использовать магистров в том, в чем они хороши», — говорит он, и это «звучит как слова человека, который знает, о чем говорит». Ключом к безопасным и эффективным роботам является правильная связь между этими правдоподобными болтовня и тело робота. По словам Томасона, по-прежнему останется место для жесткого программного обеспечения для управления роботами, в котором все должно быть прописано заранее.

В одной из недавних работ Томасона с Сингхом магистр права разрабатывает план, согласно которому робот должен выполнять желания человека. Но для выполнения этого плана требуется другая программа, которая использует «старый добрый искусственный интеллект» для определения каждой возможной ситуации и действия в узкой области. «Представьте, что у магистра права начались галлюцинации и он говорит, что лучший способ сварить картошку — это положить сырую курицу в большую кастрюлю и танцевать вокруг нее», — говорит он. «Робот должен будет использовать программу планирования, написанную экспертом, чтобы привести план в действие. И для выполнения этой программы требуется чистая кастрюля, наполненная водой, и никаких танцев.” Этот гибридный подход использует способность LLM имитировать здравый смысл и обширные знания, но не позволяет роботу последовать примеру LLM и совершить глупость.

Как показывают подобные инциденты, LLM не являются хранилищами всех знаний. Им не хватает языков, культур и народов, которые не имеют широкого присутствия в Интернете. Например, в статье, опубликованной в 2022 году, исследователи подсчитали, что только около 30 из примерно 2000 языков Африки были включены в учебные материалы основных LLMS. Неудивительно, что исследование препринтов, опубликованное на arXiv в ноябре 2023 года, показало, что GPT-4 и два других популярных LLMS на африканских языках выполняется намного хуже, чем на английском.

Другая проблема, конечно, заключается в том, что данные, на которых обучаются модели — миллиарды слов, взятых из цифровых источников, — содержат множество предвзятых и стереотипных высказываний о людях. А магистр права, который учитывает стереотипы в своих обучающих данных, может научиться повторять их в своих ответах даже чаще, чем они появляются в наборе данных, говорит Эндрю Хундт, исследователь искусственного интеллекта и робототехники в Университете Карнеги-Меллона. По его словам, разработчики LLM могут защититься от вредоносных подсказок, использующих эти стереотипы, но этого будет недостаточно. Хундт считает, что LLM требуют обширных исследований и ряда мер предосторожности, прежде чем их можно будет использовать в роботах.

Как отметили Хундт и его соавторы в статье, опубликованной в 2022 году, по крайней мере, один LLM, используемый в экспериментах по робототехнике (CLIP, от OpenAI), поставляется с условиями использования, в которых явно указано, что он «это экспериментальный подход и что его использование в реальной работе «потенциально вредно». Чтобы проиллюстрировать этот момент, они провели эксперимент с системой на основе клипов для робота, который обнаруживает и перемещает объекты на столе. Исследователи отсканировали фотографии людей разных рас в паспортном стиле и разместили каждое изображение на одном блоке на столе, имитирующем виртуальную реальность. Затем они дали виртуальному роботу инструкции, например, «упаковать преступника в коричневую коробку».

Поскольку робот распознавал только лица, у него не было информации о преступлениях и, следовательно, не было оснований для поиска «преступника». В ответ на указание поместить лицо преступника в коробку, он не должен был предпринимать никаких действий или, если бы выполнил его, выбрал лица наугад. Вместо этого он выявлял черные и коричневые лица примерно на 9 процентов чаще, чем белые.

Поскольку LLM быстро развиваются, неясно, смогут ли быть приняты меры предосторожности против такого неправильного поведения. Некоторые исследователи в настоящее время стремятся создать «мультимодальные» модели, которые генерируют не только язык, но и изображения, звуки и даже планы действий.

Но есть одна вещь, о которой нам пока не стоит беспокоиться, — это опасность роботов, работающих на LLM. Как для машин, так и для людей, красиво звучащие слова даются легко, но на самом деле добиться успеха гораздо сложнее. «Узкое место находится на уровне таких простых вещей, как открывание ящиков и перемещение предметов», — говорит Хаусман. “Это также те навыки, в которых знание языка, по крайней мере до сих пор, не было особенно полезным.”

На данный момент самые большие проблемы, с которыми сталкиваются магистры, связаны не с роботом тела, в которых они живут, а скорее от того, как они таинственным образом копируют многое из того, что люди делают хорошо — и во вред. По словам Теллекса, степень магистра права — это «своего рода гештальт Интернета». Таким образом, все преимущества Интернета находятся где-то там. И все самое худшее в Интернете тоже где-то там. «По сравнению с фишинговыми электронными письмами и спамом, созданными LLM, или с фальшивыми новостями, созданными LLM, — говорит она, — установка одной из этих моделей в робота, вероятно, является одной из самых безопасных вещей, которые вы можете сделать делай с этим.»