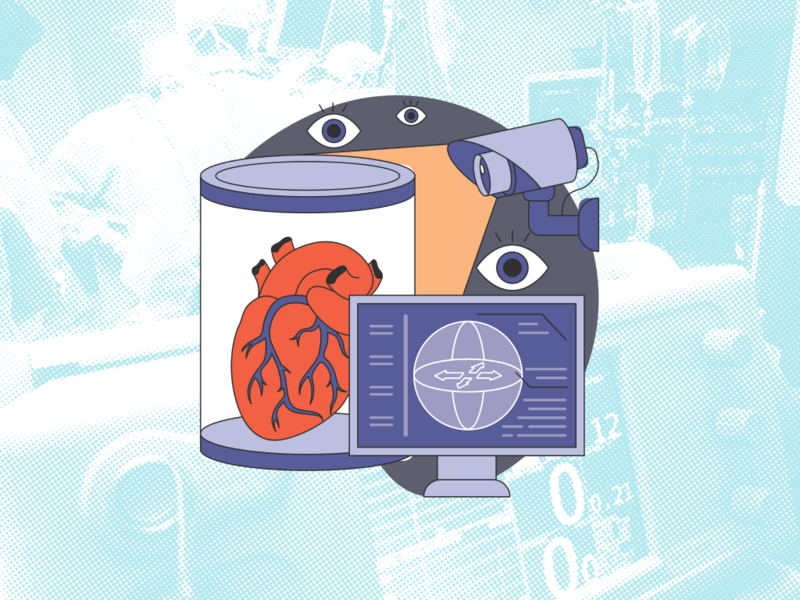

Новое исследование демонстрирует, как можно тестировать модели искусственного интеллекта, чтобы убедиться, что они не причинят вреда, раскрывая анонимизированные данные о здоровье пациентов.  Ученые из Массачусетского технологического института разрабатывают тесты, чтобы убедиться, что модели искусственного интеллекта не запоминают конфиденциальную информацию о пациентах. Изображение: Алекс Оуян/MIT Jameel Clinic, Adobe Stock.

Ученые из Массачусетского технологического института разрабатывают тесты, чтобы убедиться, что модели искусственного интеллекта не запоминают конфиденциальную информацию о пациентах. Изображение: Алекс Оуян/MIT Jameel Clinic, Adobe Stock.

Для чего нужна конфиденциальность пациента? Клятва Гиппократа, считающаяся одним из самых ранних и широко известных текстов по медицинской этике в мире, гласит: «Все, что я вижу или слышу в жизни моих пациентов, будь то в связи с моей профессиональной деятельностью или нет, и о чем не следует говорить за пределами клиники, я буду хранить в секрете, считая все это личным делом».

В эпоху алгоритмов, потребляющих огромные объемы данных, и кибератак, когда конфиденциальность становится все более дефицитной, медицина остается одной из немногих областей, где она по-прежнему имеет центральное значение, позволяя пациентам доверять своим врачам конфиденциальную информацию.

Однако в статье, написанной в соавторстве с исследователями из Массачусетского технологического института, изучается, как модели искусственного интеллекта, обученные на обезличенных электронных медицинских картах (ЭМК), могут запоминать информацию, специфичную для каждого пациента. В работе, недавно представленной на конференции по нейронным информационным системам (NeurIPS) 2025 года, рекомендуется строгая схема тестирования, чтобы гарантировать, что целевые запросы не могут раскрыть информацию, подчеркивая, что утечку информации необходимо оценивать в контексте здравоохранения, чтобы определить, действительно ли она существенно нарушает конфиденциальность пациентов.

Базовые модели, обученные на основе электронных медицинских карт, обычно должны обобщать знания для более точных прогнозов, опираясь на множество записей о пациентах. Но при «запоминании» модель использует одну единственную запись о пациенте для получения результата, что потенциально нарушает конфиденциальность пациента. Следует отметить, что базовые модели уже известны своей склонностью к утечке данных.

«Знания, содержащиеся в этих высокопроизводительных моделях, могут быть ресурсом для многих сообществ, но злоумышленники могут заставить модель извлекать информацию из обучающих данных», — говорит Сана Тонекабони, научный сотрудник Центра Эрика и Венди Шмидт в Институте Броуда при Массачусетском технологическом институте и Гарварде и первый автор статьи. Учитывая риск того, что базовые модели также могут запоминать конфиденциальные данные, она отмечает: «Эта работа — шаг к обеспечению того, чтобы наше сообщество могло предпринять практические шаги по оценке перед выпуском моделей».

Для проведения исследования потенциального риска, который могут представлять модели, лежащие в основе электронных медицинских карт, в медицине, Тонекабони обратился к доценту Массачусетского технологического института Марзие Гассеми, которая является ведущим исследователем в клинике Абдула Латифа Джамиля по машинному обучению в здравоохранении (клиника Джамиля) и членом Лаборатории компьютерных наук и искусственного интеллекта. Гассеми, преподаватель кафедры электротехники и компьютерных наук Массачусетского технологического института и Института медицинской инженерии и науки, руководит группой Healthy ML, которая занимается разработкой надежных методов машинного обучения в здравоохранении.

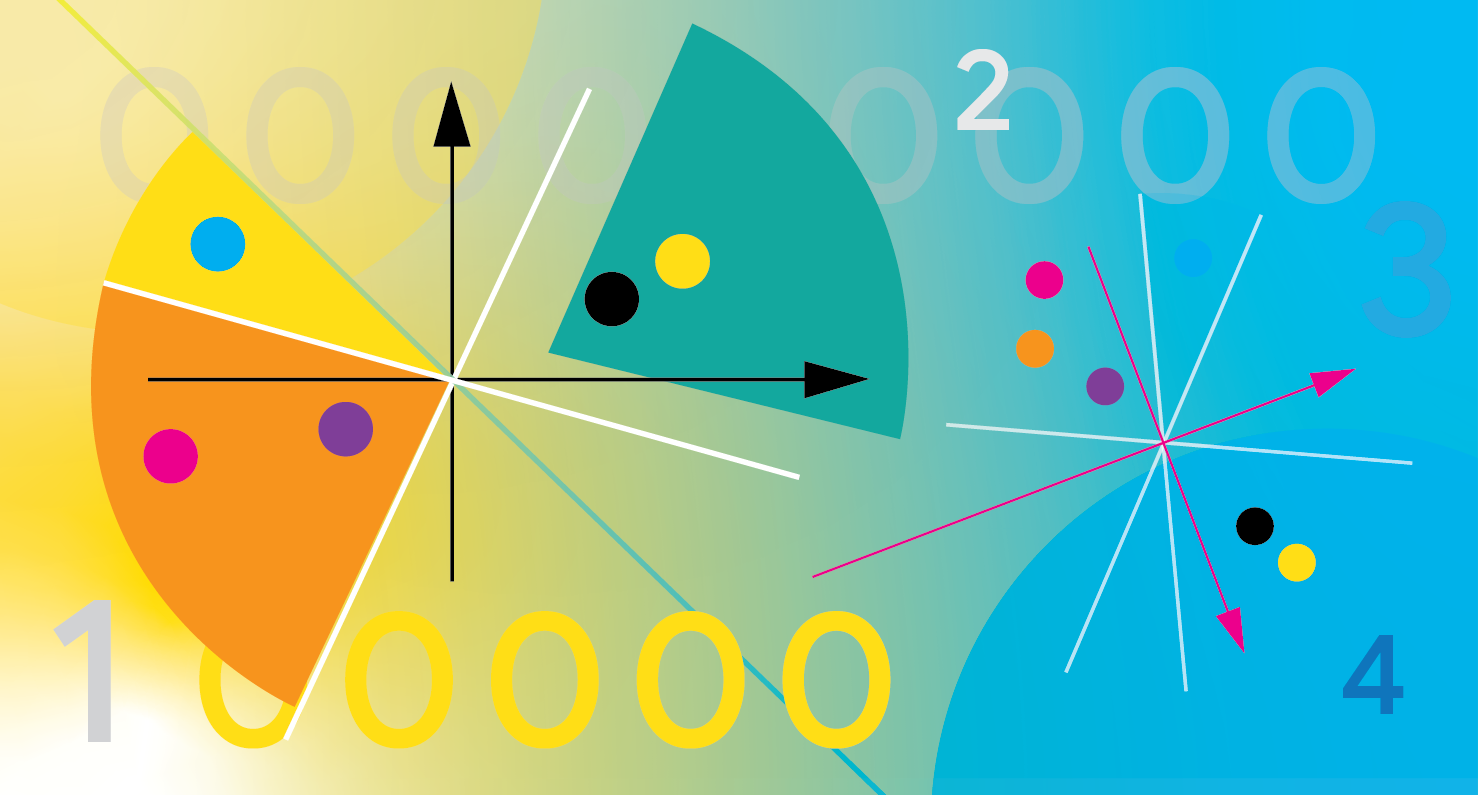

Сколько информации необходимо злоумышленнику для утечки конфиденциальных данных, и какие риски связаны с такой утечкой? Для оценки этого исследовательская группа разработала серию тестов, которые, как они надеются, заложат основу для будущих оценок конфиденциальности. Эти тесты предназначены для измерения различных типов неопределенности и оценки практического риска для пациентов путем измерения различных уровней вероятности атаки.

«Мы действительно постарались сделать упор на практичность; если злоумышленнику нужно знать дату и результаты десятка лабораторных анализов из вашей базы данных, чтобы извлечь информацию, риск причинения вреда минимален. Если у меня уже есть доступ к такому уровню защищенных исходных данных, зачем мне атаковать крупную базовую модель, чтобы получить больше?» — говорит Гассеми.

В связи с неизбежной цифровизацией медицинских записей утечки данных стали более распространенным явлением. За последние 24 месяца Министерство здравоохранения и социальных служб США зафиксировало 747 случаев утечки медицинской информации, затронувших более 500 человек, причем большинство из них были классифицированы как хакерские атаки/ИТ-инциденты.

Пациенты с уникальными заболеваниями особенно уязвимы, учитывая, как легко их выявить. «Даже при наличии обезличенных данных все зависит от того, какую информацию о человеке вы раскрываете», — говорит Тонекабони. «Как только вы его идентифицируете, вы узнаете гораздо больше».

В ходе структурированных тестов исследователи обнаружили, что чем больше информации у злоумышленника о конкретном пациенте, тем выше вероятность утечки информации из модели. Они продемонстрировали, как отличать случаи обобщения модели от запоминания информации на уровне пациента, чтобы правильно оценить риск нарушения конфиденциальности.

В статье также подчеркивалось, что некоторые утечки информации более опасны, чем другие. Например, утечка, раскрывающая возраст или демографические данные пациента, может быть охарактеризована как более безобидная, чем утечка, раскрывающая более конфиденциальную информацию, такую как диагноз ВИЧ или злоупотребление алкоголем.

Исследователи отмечают, что пациенты с уникальными заболеваниями особенно уязвимы, учитывая, как легко их выявить, что может потребовать более высокого уровня защиты. «Даже при обезличенных данных все действительно зависит от того, какая информация о человеке будет раскрыта», — говорит Тонекабони. Исследователи планируют расширить работу, сделав ее более междисциплинарной, привлекая к участию врачей, экспертов по защите конфиденциальности, а также юристов.

«Есть причина, по которой наши медицинские данные являются конфиденциальными, — говорит Тонекабони. — Нет никаких оснований для того, чтобы другие о них знали».

Данная работа поддержана Центром Эрика и Венди Шмидт в Институте Броуда при Массачусетском технологическом институте и Гарварде, компанией Wallenberg AI, Фондом Кнута и Алисы Валленберг, Национальным научным фондом США (NSF), грантом Фонда Гордона и Бетти Мур, грантом Google Research Scholar и программой AI2050 в Schmidt Sciences. Ресурсы, использованные при подготовке данного исследования, были частично предоставлены провинцией Онтарио, правительством Канады через CIFAR и компаниями, спонсирующими Институт Vector.

Источник: news.mit.edu