Практический пример, описывающий, как менялась работа специалиста по анализу данных на протяжении трех поколений машинного обучения.

Делиться

В одной из лучших песен вселенной (исполненной одним из самых культовых певцов) говорится следующее:

Хотелось бы вернуться назад.

И изменить эти годы

Я переживаю переменыBlack Sabbath – Изменения

Эта песня невероятно сильная и рассказывает о том, как быстро жизнь может измениться прямо на ваших глазах.

Эта песня о разбитом сердце и истории любви. Однако она также напоминает мне о многих изменениях, которые претерпела моя работа как специалиста по анализу данных за последние 10 лет:

- Когда я начал изучать физику, единственное, что приходило мне на ум при слове «Трансформер», был Оптимус Прайм. Машинное обучение для меня было связано с линейной регрессией, методом опорных векторов (SVM), случайным лесом и так далее… [ 2016 ]

- Когда я учился в магистратуре по большим данным и физике сложных систем, я впервые услышал о BERT и различных технологиях глубокого обучения, которые в то время казались очень многообещающими. Появились первые модели GPT, и они выглядели очень интересно, хотя никто не ожидал, что они будут столь мощными, как сегодня. [ 2018-2020 ]

- Перенесёмся в мою нынешнюю жизнь, когда я работаю штатным специалистом по анализу данных. Сегодня, если вы не знаете, что такое GPT, и никогда не читали «Внимание — это всё, что вам нужно», у вас очень мало шансов пройти собеседование на должность проектировщика систем анализа данных. [ 2021 — настоящее время ]

Когда люди утверждают, что инструменты и повседневная жизнь человека, работающего с данными, существенно отличаются от тех, что были 10 (или даже 5) лет назад, я полностью с этим согласен. Однако я не согласен с идеей о том, что инструменты, использовавшиеся в прошлом, следует стереть только потому, что теперь всё можно решить с помощью GPT, LLM или агентного ИИ.

Цель данной статьи — рассмотреть одну задачу: классифицировать твит по типу «любовь/ненависть/нейтрально». В частности, мы будем использовать традиционное машинное обучение, глубокое обучение и большие языковые модели.

Мы сделаем это на практике, используя Python, и объясним, почему и когда использовать каждый подход. Надеюсь, после этой статьи вы узнаете:

- Инструменты, использовавшиеся в первые дни, по-прежнему следует рассматривать, изучать и порой перенимать.

- При выборе наилучшего алгоритма для вашего варианта использования следует оценить задержку, точность и стоимость.

- Изменения в мире специалистов по обработке данных необходимы, и их следует принимать без страха 🙂

Давайте начнем!

1. Вариант использования

Случай, с которым мы имеем дело, на самом деле широко распространён в приложениях Data Science/AI: анализ настроений . Это означает, что, имея текст, мы хотим экстраполировать «чувства», которые испытывал его автор. Это очень полезно, когда вы хотите собрать отзывы, лежащие в основе обзора объекта, фильма, рекомендуемого вами товара и т. д.

В этой публикации мы используем очень «известный» пример анализа тональности, который классифицирует эмоции, лежащие в основе твита . Поскольку мне хотелось большего контроля, мы не будем работать с органическими твитами, собранными из интернета (где метки неясны). Вместо этого мы будем использовать контент, сгенерированный большими языковыми моделями (LLM ), которые мы можем контролировать.

Этот метод также позволяет нам регулировать сложность и разнообразие проблемы и наблюдать, как реагируют различные методы.

- Простой случай : твиты с любовью звучат как открытки, твиты с ненавистью — прямолинейны, а нейтральные сообщения говорят о погоде и кофе. Если у модели проблемы с этим, значит, что-то не так.

- Более сложный случай : всё ещё любовь, ненависть, нейтралитет, но теперь мы добавляем сарказм, смешанные тона и тонкие намёки, требующие внимания к контексту. Кроме того, у нас меньше данных, чтобы уменьшить набор данных для обучения.

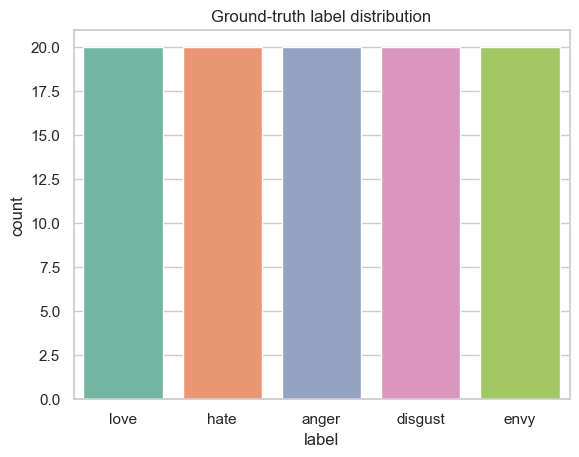

- Сверхсложный случай: мы переходим к пяти эмоциям: любви, ненависти, гневу, отвращению, зависти, поэтому модели приходится анализировать более сложные, многослойные предложения. Более того, у нас нет ни одной записи для обучения: мы не можем провести обучение.

Я сгенерировал данные и поместил каждый из файлов в определенную папку публичной папки GitHub, которую я создал для этого проекта [данные].

Наша цель — создать умную систему классификации, которая сможет эффективно улавливать смысл твитов. Но как это сделать? Давайте разберёмся.

2. Проектирование системы

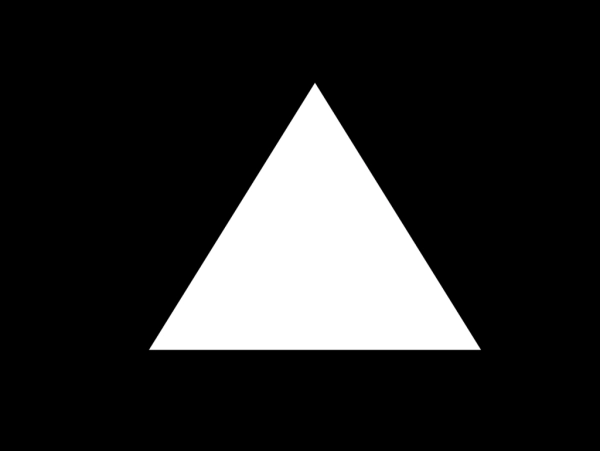

Ниже приведена картина, которую всегда чрезвычайно полезно рассмотреть:

Точность , стоимость и масштаб в системе машинного обучения образуют треугольник. Одновременно можно полностью оптимизировать только два из них.

У вас может быть очень точная модель, которая отлично масштабируется при миллионах записей, но она не будет быстрой. У вас может быть быстрая модель, которая отлично масштабируется при миллионах записей, но она не будет такой точной. У вас может быть точная и быстрая модель, но она не будет хорошо масштабироваться.

Эти соображения абстрагированы от конкретной проблемы, но помогают определить, какую систему машинного обучения следует проектировать. Мы вернёмся к этому позже.

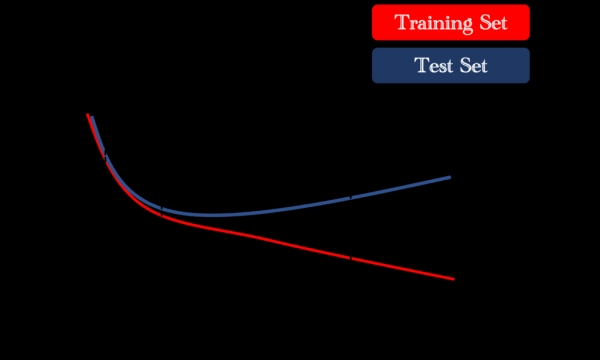

Кроме того, мощность нашей модели должна быть пропорциональна размеру обучающей выборки. В общем случае мы стараемся избегать уменьшения ошибки обучающей выборки за счёт увеличения проверочной выборки (знаменитого эффекта переобучения ).

Мы не хотим оказаться в зоне недообучения или переобучения. Позвольте объяснить, почему.

Проще говоря, недообучение происходит, когда ваша модель слишком проста, чтобы усвоить реальную закономерность в данных. Это похоже на попытку провести прямую линию по спирали. Переобучение — это противоположность. Модель слишком хорошо усваивает обучающие данные, включая весь шум, поэтому отлично работает на уже известных данных, но плохо на новых. Идеальная середина — это когда ваша модель понимает структуру, не запоминая её.

К этому вопросу мы еще вернемся.

3. Простой случай: традиционное машинное обучение

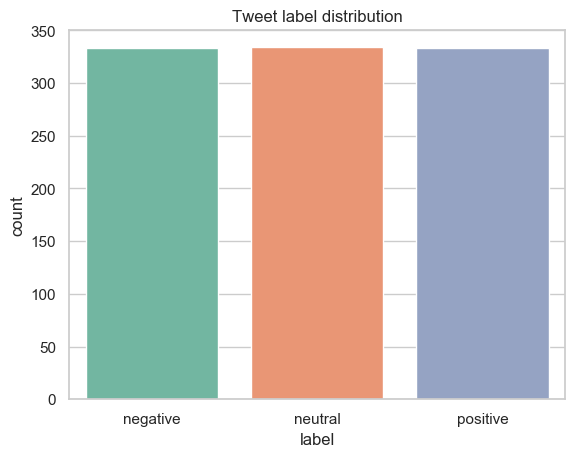

Начнём с самого простого сценария: высокоструктурированный набор данных из 1000 твитов, которые мы сгенерировали и маркировали. Три класса (положительные, нейтральные, отрицательные) специально сбалансированы, язык описания предельно ясен, а каждая строка хранится в чистом CSV-файле.

Начнем с простого импорта блока кода.

Давайте посмотрим, как выглядит набор данных:

Мы предполагаем, что это не масштабируется для миллионов строк (поскольку набор данных слишком структурирован, чтобы быть разнообразным). Однако мы можем разработать очень быстрый и точный метод для этого небольшого и специфичного варианта использования. Начнём с моделирования. Необходимо учесть три основных момента:

- Мы разделяем данные на обучающую и тестовую выборки, используя 20% набора данных в тестовом наборе.

- Мы будем использовать подход TF-IDF для получения векторных представлений слов. TF-IDF расшифровывается как Term Frequency–Inverse Document Frequency (Частота термина – Обратная частота документа). Это классический метод, который преобразует текст в числа, присваивая каждому слову вес, основанный на его важности в документе по сравнению с общим набором данных.

- Мы объединим эту технику с двумя моделями машинного обучения: логистической регрессией и методом опорных векторов из scikit-learn. Логистическая регрессия проста и интерпретируема, часто используется в качестве надежной основы для классификации текстов. Метод опорных векторов фокусируется на поиске наилучшей границы между классами и обычно хорошо работает, когда данные не слишком зашумлены.

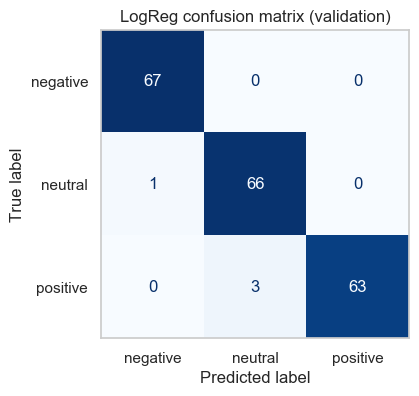

И производительность у обеих моделей по сути идеальная.

В этом очень простом случае, когда у нас есть согласованный набор данных из 1000 строк, традиционный подход справляется с задачей. Нет необходимости в миллиардах моделей параметров, как в GPT.

4. Сложный случай: глубокое обучение

Второй набор данных по-прежнему синтетический, но он намеренно создан для того, чтобы раздражать. Метки по-прежнему относятся к любви, ненависти и нейтральности, однако твиты полны сарказма, неоднозначного тона и двусмысленных комплиментов. Кроме того, обучающая выборка меньше, а проверочный срез остаётся большим, поэтому модели работают с меньшим количеством данных и большей неопределённостью.

Теперь, когда у нас есть эта неоднозначность, нам нужно использовать более мощные инструменты. Существуют модели встраивания глубокого обучения, которые обеспечивают высокую точность и при этом хорошо масштабируются в таких случаях (вспомните треугольник и график зависимости ошибки от сложности!). В частности, модели встраивания глубокого обучения изучают значение слов из их контекста, а не рассматривают их как изолированные символы.

В этой статье мы будем использовать BERT — одну из самых известных моделей встраивания. Для начала импортируем несколько библиотек:

… и несколько помощников.

Благодаря этим функциям мы можем быстро оценить нашу модель встраивания в сравнении с подходом TF-IDF.

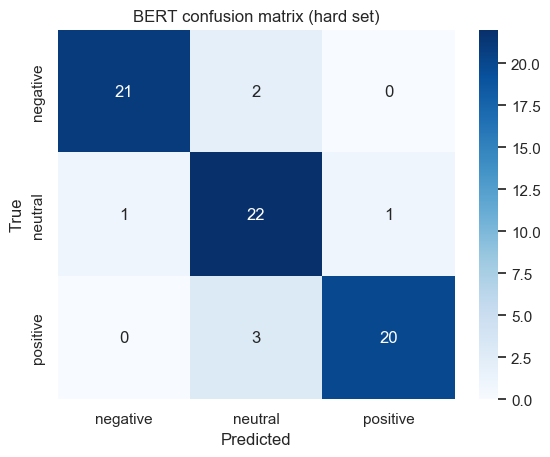

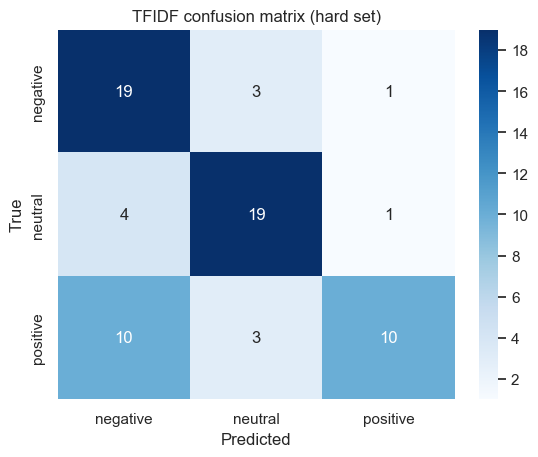

Как мы видим, модель TF-IDF крайне неэффективна в положительных метках, в то время как она сохраняет высокую точность при использовании модели встраивания (BERT).

5. Сверхсложный случай: агент LLM

Хорошо, теперь давайте ОЧЕНЬ усложним задачу:

- У нас всего 100 строк.

- Мы предполагаем, что не знаем меток , а значит, не можем обучить ни одну модель машинного обучения.

- У нас есть пять ярлыков: зависть, ненависть, любовь, отвращение, гнев.

Поскольку мы не можем ничего обучить, но всё же хотим выполнять классификацию, нам необходимо использовать метод, который каким-то образом уже содержит необходимые классификации. Большие языковые модели — яркий пример такого метода.

Обратите внимание, что если бы мы использовали LLM в двух других случаях, это было бы похоже на стрельбу по мухам из пушки. Но здесь всё совершенно логично: задача сложная, и у нас нет возможности сделать что-то разумное, поскольку мы не можем обучить нашу модель (у нас нет обучающего набора).

В этом случае мы достигаем точности на больших масштабах. Однако API требует времени, поэтому приходится ждать секунду-другую, прежде чем ответ придёт (помните треугольник!).

Давайте импортируем некоторые библиотеки:

А это вызов API классификации:

И мы видим, что LLM выполняет потрясающую работу по классификации:

6. Выводы

За последнее десятилетие роль специалиста по анализу данных изменилась так же радикально, как и сами технологии. Это может привести к идее использования самых мощных инструментов, но во многих случаях это НЕ лучший вариант.

Вместо того чтобы сначала выбрать самую большую модель, мы протестировали одну проблему через простую призму: точность, задержка и стоимость.

В частности, вот что мы сделали, шаг за шагом:

- Мы определили наш вариант использования как классификацию тональности твитов, стремясь определить любовь, ненависть или нейтральные намерения . Мы разработали три набора данных возрастающей сложности: чистый, саркастический и без обучения.

- Мы разобрались с простым случаем, используя TF-IDF с логистической регрессией и SVM. Твиты были понятными и прямолинейными, и обе модели сработали практически идеально.

- Мы перешли к сложному случаю, где сарказм, смешанный тон и тонкий контекст усложняли задачу . Мы использовали вставки BERT, чтобы уловить смысл, выходящий за рамки отдельных слов.

- Наконец, для особо сложного случая без данных для обучения мы использовали большую языковую модель для классификации эмоций напрямую посредством обучения с нулевого уровня.

Каждый шаг демонстрировал, как выбор подходящего инструмента зависит от задачи. Традиционное машинное обучение (ML) быстро и надёжно, когда данные структурированы. Модели глубокого обучения помогают, когда смысл скрыт между строк. LLM эффективны, когда нет ярлыков или требуется широкое обобщение.

7. Прежде чем отправиться в путь!

Ещё раз спасибо за уделённое время. Это очень много значит ❤️

Меня зовут Пьеро Паялунга, и я вот этот парень:

Я родом из Италии, имею докторскую степень Университета Цинциннати и работаю специалистом по анализу данных в The Trade Desk в Нью-Йорке. Я пишу об искусственном интеллекте, машинном обучении и меняющейся роли специалистов по анализу данных как здесь, на TDS, так и на LinkedIn. Если вам понравилась статья и вы хотите узнать больше о машинном обучении и следить за моими исследованиями, вы можете:

А. Подписывайтесь на меня в Linkedin , где я публикую все свои истории.

B. Подпишитесь на меня на GitHub , где вы можете увидеть весь мой код.

C. Если у вас есть вопросы, отправьте мне письмо по адресу piero.paialunga@hotmail.

Источник: towardsdatascience.com