Достаточно ли 90-процентной точности для поискового робота?

Источник: Google Настройки текстаТекст рассказа Размер Маленький Стандартный Большой Ширина * Стандартный Широкий Ссылки Стандартный Оранжевый * Только для подписчиков

Источник: Google Настройки текстаТекст рассказа Размер Маленький Стандартный Большой Ширина * Стандартный Широкий Ссылки Стандартный Оранжевый * Только для подписчиков

Узнать больше Свернуть в навигацию

Сегодня поиск информации в Google означает столкновение с AI Overviews, поисковым роботом на базе Gemini, который появляется в верхней части страницы результатов. С момента запуска в 2024 году AI Overviews пережил непростые времена, вызвав недовольство пользователей из-за своей непостоянной точности, но сейчас он улучшается и обычно выдает правильный ответ. Однако это невысокая планка. Новый анализ от The New York Times попытался оценить точность AI Overviews, показав, что он прав в 90% случаев. С другой стороны, 1 из 10 ответов ИИ оказывается неверным, а для Google это означает сотни тысяч ложных результатов каждую минуту дня.

Газета The Times провела этот анализ с помощью стартапа Oumi, который сам активно занимается разработкой моделей искусственного интеллекта. Компания использовала инструменты ИИ для проверки обзоров ИИ с помощью теста SimpleQA, распространенного инструмента для оценки достоверности генеративных моделей, таких как Gemini. SimpleQA, выпущенный OpenAI в 2024 году, представляет собой список из более чем 4000 вопросов с проверяемыми ответами, которые можно ввести в систему ИИ.

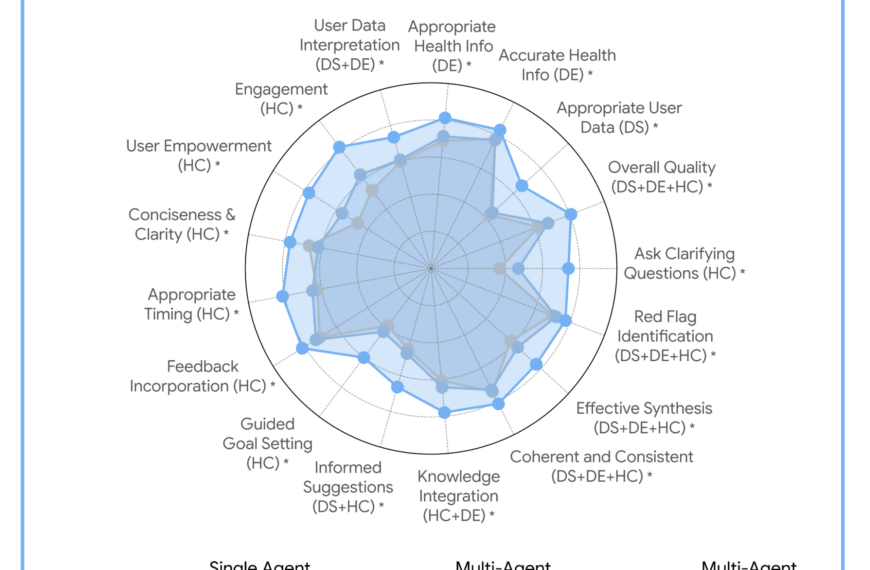

Компания Oumi начала проводить тестирование в прошлом году, когда Gemini 2.5 еще была лучшей моделью компании. В то время тест показал точность в 85 процентов. Когда тест был повторен после обновления до Gemini 3, AI Overviews ответил правильно на 91 процент вопросов. Если экстраполировать этот процент ошибок на все поисковые запросы в Google, то AI Overviews генерирует десятки миллионов неверных ответов в день.

В отчете приводится несколько примеров ошибок, допущенных AI Overviews. Когда у модели запросили дату, когда бывший дом Боба Марли стал музеем, AI Overviews сослалась на три страницы, на двух из которых эта дата вообще не упоминалась. На последней странице, в Википедии, были указаны два противоречащих друг другу года, и AI Overviews уверенно выбрала неверный. В эталонном тесте также предлагается определить дату включения Йо-Йо Ма в Зал славы классической музыки. Хотя AI Overviews сослалась на веб-сайт организации, где была указана дата включения Ма, она заявила, что Зала славы классической музыки не существует.

Google не очень-то нравится этот тест. Представитель Google Нед Адрианс заявил газете Times, что, по мнению Google, SimpleQA содержит неверную информацию. Оценка моделей часто основывается на аналогичном тесте под названием SimpleQA Verified, который использует меньший набор вопросов, прошедших более тщательную проверку. «В этом исследовании есть серьезные недостатки, — сказал Адрианс газете Times. — Оно не отражает того, что люди на самом деле ищут в Google».

Проблемы с эталонными показателями

Оценка новых моделей ИИ порой больше напоминает искусство, чем науку, и в этом отчасти заключается проблема. У каждой компании есть свой предпочтительный способ демонстрации возможностей модели, а недетерминированная природа генно-модифицированного ИИ может затруднить проверку чего-либо. Эти роботы могут правильно ответить на фактический вопрос, а затем полностью пропустить его, если запрос повторить сразу же. Oumi даже использует инструменты ИИ для проведения своих оценок, и эти модели тоже могут галлюцинировать.

Ещё один нюанс заключается в том, что AI Overviews не представляет собой единую монолитную модель. Google сообщил Ars Technica, что использует «правильную модель» для каждого запроса. Хотя AI Overviews получал бы наилучшие ответы, постоянно используя Gemini 3.1 Pro, это медленно и затратно. Для быстрой загрузки информации на странице поиска обзор использует более быстрые модели Gemini Flash, когда это возможно (что, по всей видимости, происходит в большинстве случаев).

Реакция Google на этот отчет весьма показательна. В сфере достоверности ИИ 9 из 10 — это даже не так уж плохо. Google недавно опубликовал результаты тестов новых моделей, демонстрирующие достоверность в диапазоне от 60 до 80 процентов — эти тесты проводились без использования таких инструментов, как веб-поиск. Использование большего количества данных, например, обширных знаний людей в интернете, делает ИИ более точным, чем сама модель без данных. Однако истина где-то в синих ссылках, и AI Overviews призывает людей принимать во внимание иногда неточные сводки, вместо того чтобы проверять эти источники вручную.

Хотя Google утверждает, что результаты Times не соответствуют тому, что видят люди, возникает вопрос, откуда компания вообще могла это знать. Вы, вероятно, видели ошибки в обзорах ИИ — все мы их видели, потому что так устроен генеративный ИИ. Как напоминает сама Google внизу каждого обзора: «ИИ может ошибаться, поэтому перепроверяйте ответы».

Источник: arstechnica.com