Можно ли построить идеальную индукционную машину?

Делиться

Введение

В основополагающей, но недооценённой книге «Универсальный искусственный интеллект: последовательные решения на основе алгоритмической вероятности» Маркус Хаттер попытался дать математическую формулировку универсального искусственного интеллекта, сокращённо AIXI. Цель этой статьи — сделать AIXI доступным для специалистов по данным, технических энтузиастов и широкой аудитории как в концептуальном, так и в формальном плане.

Мы начнём с краткого обзора аксиом теории вероятностей. Затем мы углубимся в условную вероятность, вычисление которой регулируется теоремой Байеса. Хотя теорема Байеса задаёт основу для обновления убеждений, она оставляет открытым вопрос о назначении априорных вероятностей. Для решения этой проблемы мы обратимся к алгоритмической теории информации, которая связывает колмогоровскую сложность, определяемую как длину кратчайшей программы, выводящей строку, с назначением байесовских априорных вероятностей. Связующим звеном между этими двумя идеями служит априорная вероятность Соломоноффа, также известная как универсальная априорная вероятность. Универсальная априорная вероятность даёт нам необходимую основу для исследования формализма AIXI, который объединяет последовательную теорию принятия решений, априорную вероятность Соломоноффа и принцип бритвы Оккама. В заключительном разделе мы кратко обсудим ограничения AIXI и альтернативные подходы к формализации универсального агента, признавая при этом, что термин «универсальный агент» несёт в себе значительную философскую двусмысленность. В частности, мы обсуждаем активный вывод как философскую альтернативу AIXI, где первый моделирует воплощенный предиктивный агент, тогда как последний моделирует бестелесный алгоритм максимизации полезности.

Примечание: Все изображения в блоге созданы автором.

Аксиомы вероятности

Аксиомы Колмогорова определяют вероятностное пространство как тройку (Ω, 𝒜, 𝓟), где Ω определяет общее выборочное пространство, 𝒜 — совокупность подмножеств интересующих событий, а 𝓟 — функцию, которая присваивает вероятность каждому событию, нормализованную к единичному интервалу.

- Если 𝑨 ϵ 𝒜, то 𝓟(𝑨) ≥ 0

- Если 𝑨, B ϵ 𝒜 и A ∩ B = ∅ , то P (A ⋃ B) = P(A) + P(B)

- P(Ω) = 1

Первая аксиома, неотрицательность , гарантирует, что вероятности имеют смысл как действительные меры доверия или частоты. Вторая, аддитивность , формализует принцип, согласно которому вероятность несовместных исходов равна сумме их индивидуальных вероятностей. Третья, нормализация , гарантирует, что общая вероятность, присвоенная всему выборочному пространству, равна единице.

Однако, хотя аксиомы вероятности определяют структурные правила теории вероятностей, они не предписывают, как следует обновлять вероятности в свете новых данных. В этом смысле метод Колмогорова является аналитическим и априорным: он определяет, чему должна удовлетворять мера вероятности, но не то, как такая мера пересматривается с учётом новых данных. Чтобы перейти от статического присвоения вероятностей к динамическому выводу, нам необходим способ соотнесения новых данных с существующими гипотезами, а именно условная вероятность. Этот эпистемологический пробел устраняется в частотной статистике путём интерпретации условных вероятностей через долгосрочные частоты повторяющихся событий, как правило, в предположении, что такие события распределены независимо и одинаково (iid), тогда как теорема Байеса предоставляет нормативное правило для обновления представлений о гипотезах в свете новых данных, что особенно полезно, когда наблюдения проводятся постепенно или выборочные пространства нечётко определены.

Байесовский вывод

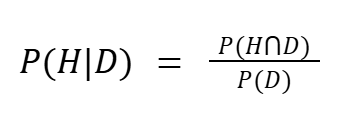

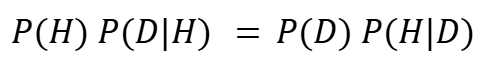

Теорема Байеса, впервые формализованная шотландским монахом, представляет собой алгебраический вывод условной вероятности. Поняв, как вычисляется условная вероятность, мы можем вывести теорему Байеса с помощью нескольких алгебраических операций. Вспомним, как мы вычисляем условную вероятность:

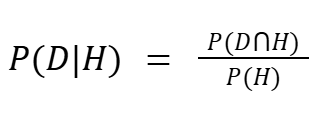

Это означает, что вероятность гипотезы H при наличии доказательств D вычисляется как совместная вероятность гипотезы и доказательств, деленная на вероятность доказательств.

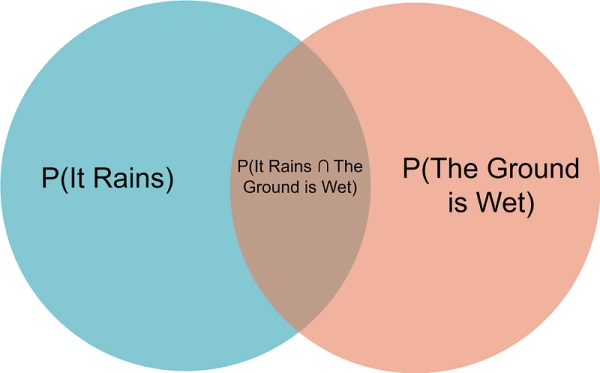

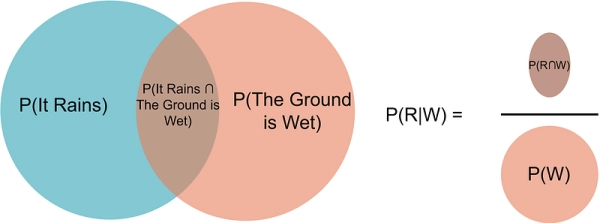

Зачем нам вычислять условную вероятность таким образом? Давайте разберём это на примере. Вероятность того, что шёл дождь (гипотеза), при условии, что земля влажная (данные), предполагает зависимость этих двух событий. Если бы они были независимыми, то вероятность их совместного появления вычислялась бы как их произведение P(H) · P(D). Это связано с тем, что вероятность P(H|D) = P(H) и вероятность P(D|H) = P(D) предполагают, что событие «земля влажная» не зависит от того, идёт ли дождь. Обратите внимание на то, что мы только что установили: P(H∩D) = P(H) · P(D). Это означает, что пересечение независимых событий вычисляется как произведение их индивидуальных вероятностей.

Но как вычисляется пересечение P(H∩D) зависимых событий? С точки зрения теории множеств, совместная вероятность определяется как пересечение двух множеств:

Чтобы понять пропорцию распределения выборочных пространств, мы можем визуализировать условную вероятность, которую мы пытаемся вычислить, следующим образом:

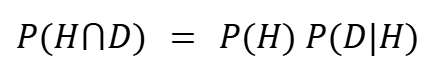

Но на практике мы почти никогда не имеем априорного знания о распределении совместных вероятностей. Именно здесь мы можем воспользоваться простым алгебраическим приёмом, чтобы приблизиться к значению совместной вероятности. Умножая обе части уравнения на знаменатель, мы получаем совместную вероятность P(H∩D):

И наоборот, если бы мы захотели вычислить вероятность того, что земля мокрая, учитывая, что шел дождь, наша формула условной вероятности была бы следующей:

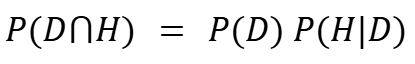

То же преобразование дает нам:

Обратите внимание, что совместная вероятность двух рассматриваемых событий — это член, общий для обеих условных вероятностей. Поскольку P(H∩D) — симметричное отношение и, следовательно, алгебраическая константа между уравнениями, мы получаем следующее ключевое равенство:

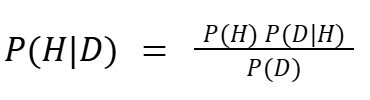

Следовательно, если мы хотим проверить гипотезу о том, что «шел дождь», при условии, что «земля мокрая», мы можем переписать это равенство так, чтобы получить формулу Байеса:

В байесовской терминологии мы называем P(H|D) апостериорной вероятностью (то есть вероятностью, которую мы хотим установить), P(H) — априорной , P(D|H) — правдоподобием и P(D) — маргинальной .

Эта условная номенклатура важна при работе с байесовской статистикой. Правдоподобие определяет условные вероятности для точек данных, соответствующих гипотезе (предоставляя значения, используемые для обновления наших убеждений), тогда как маргинальное значение нормализует апостериорную вероятность относительно выборочного пространства условия или данных.

Поскольку нам нужны аппроксимации значений всех членов формулы Байеса, одной из основных проблем байесовской статистики является наилучшее назначение этих значений. В частности, определение априорной вероятности может быть сложной задачей, поскольку у нас не всегда есть необходимые знания заранее. Некоторые стратегии аппроксимации априорной вероятности включают использование равномерно распределённой априорной вероятности , когда мы присваиваем одинаковую вероятность всем возможным исходам, что известно как принцип безразличия Лапласа, а другие стратегии включают использование информативной априорной вероятности , а именно априорной вероятности, которая стремится аппроксимировать фактическое распределение вероятностей события. В нашем примере это может быть распределение Пуассона для суточного количества осадков.

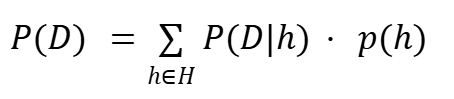

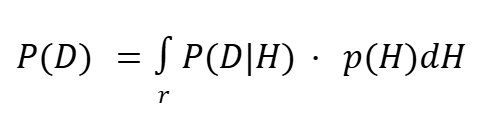

По мере того, как мы переходим от рассмотрения гипотез как фиксированных значений к их обработке как случайных величин, целью становится вывод полного апостериорного распределения, а не отдельной оценки. Соответственно, теперь мы можем перейти от рассмотрения гипотез как точечных оценок к статистическому выводу на основе случайных величин с соответствующими распределениями вероятностей. Для этого мы моделируем априорное распределение P(H) и правдоподобие P(D|H) как распределения вероятностей и вычисляем маргинальную вероятность данных P(D), которая получается либо как сумма (функция массы вероятности для дискретных величин), либо как интеграл (плотность вероятности для непрерывных величин). Эти компоненты позволяют нам применить теорему Байеса для получения апостериорного распределения: P(H|D).

Функция массы вероятности (ФМВ) вычисляется как сумма всех значений распределения, равная единице, тогда как функция плотности вероятности (ФПВ) представляет собой интеграл от площади под кривой распределения, стремящейся к единице как к пределу. Для непрерывных величин мы интегрируем, поскольку имеем дело с бесконечными значениями распределения. Ниже приведена формула для маргинальной вероятности для непрерывных величин, а именно закон полной вероятности, выраженный через функцию плотности вероятности:

Байесовская статистика представляет собой альтернативу более устоявшемуся частотному подходу в статистике. Несмотря на то, что её исторические корни столь же глубоки, как и сама частотная формулировка, вычислительная сложность ограничивала её применение на протяжении большей части XX века. С ростом вычислительной мощности байесовские методы получили быстрое развитие и стали применяться всё чаще. Сегодня байесовская статистика играет центральную роль в машинном обучении (МО), особенно в вероятностном моделировании, оценке неопределённости и принятии решений в условиях неопределённости.

Колмогоровская сложность

Мы увидели, что наши аксиомы Колмогорова предоставляют аналитическую основу для вычисления вероятностей, включая определение объединения непересекающихся множеств как сумм, а их пересечения — как произведений. Но это не говорило нам, как вычислять совместные множества. Для этого мы воспользовались теоремой Байеса, которая использует пересечение множеств для вывода универсальной формулы условной вероятности.

Однако при объяснении байесовской вероятности мы определили, что назначение априорных данных является проблемой для данной модели: какую информацию следует кодировать в априорных данных? Должны ли мы сделать их индифферентными, согласно принципу индифферентности, или информативными?

Вот тут-то и появляется понятие Колмогоровской сложности. Хотя Колмогоровская сложность не влечет за собой вероятность, через теорему о кодировании (которую мы объясним ниже) она кодирует апостериорное метатеоретическое предположение как математическое смещение отбора. Это метатеоретическое обобщение утверждает, что простота кодирует более высокую вероятность. Если мы сталкиваемся с данным или результатом, что земля мокрая, какую гипотезу из доступного хранилища всех возможных гипотез мы должны выбрать? Интуитивно мы хотим гипотезу, которая присваивает наибольшую вероятность наблюдаемому результату. Но без дополнительной информации, как мы узнаем, какая гипотеза максимизирует вероятность результата? Колмогоров ответил на это в рамках алгоритмической теории информации: простейшая гипотеза — это гипотеза, которая кодирует наименьшее количество информации или последовательность с наименьшей длиной .

Чтобы понять мотивацию, стоящую за этим, давайте сначала сформулируем проблему в рамках алгоритмической теории информации , а затем вернемся к ее применению в менее абстрактных реальных сценариях.

В алгоритмической теории информации мы кодируем символьные последовательности или строки в соответствии с некоторой символической базой, например, двоичными строками. Мы определяем универсальную машину Тьюринга U как (частичную — поскольку p невозможно определить для всех выходов) функцию, преобразующую программу p в выход x, то есть U(p) = x . Это можно представить как нечто близкое к: f(x) = y. Программа p представляет гипотезу или теорию, а выход x — данные или доказательства. Это сопоставление важно для понимания интуитивной направленности теории.

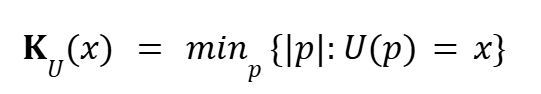

Колмогоровская сложность информационного объекта определяется как кратчайшая длина алгоритмической последовательности, которая выводит этот объект, где K(x) определяет длину программы в битах:

Это выражение говорит нам, что из всех программ p , которые выдают x в качестве выходного значения, мы выбираем самую короткую, а именно минимальную {|p|} . Сложность Колмогорова определяется над конечными двоичными строками x ϵ {0,1}

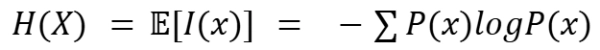

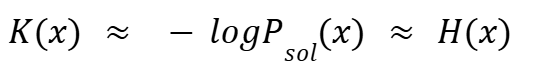

Теперь нам нужно связать колмогоровскую сложность с теорией вероятностей, чтобы она могла быть использована для наших байесовских априорных распределений. Для этого мы замечаем связь, по крайней мере, на первый взгляд, между колмогоровской сложностью и информационной энтропией Шеннона. Оба они, по-видимому, количественно измеряют некую меру информационного содержания: K(x) определяет длину в битах, тогда как информационная энтропия H определяет среднее количество информации, необходимое для кодирования распределения случайной величины, где информация определяется как неопределенность и количественно измеряется как ожидаемое значение -log P(x) по всем возможным исходам в битах. Чем больше неопределенность, тем больше информации требуется для кодирования события. Как K(x), так и H(X) измеряются в битах, так в чем же разница?

K(x) описывает длину кратчайшей программы в битах, которая выводит строку x, тогда как H(X) вычисляет среднее количество битов, необходимое для кодирования программы, взятой из распределения вероятностей возможных значений x в пространстве выборок X. Похоже, между этими двумя мерами должна существовать некая глубокая связь. Какова же тогда связь между сложностью Колмогорова и энтропией Шеннона? Нам нужен мост от исходных значений длины к их вероятностям.

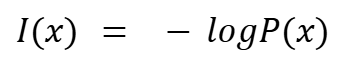

Если мы выделим один результат из распределения Шеннона, мы можем определить его как собственную информацию x, выход нашей программы:

Это означает, что самоинформация (представьте её мерой энтропии для отдельного исхода) пропорциональна логарифмически обратной вероятности события x. I(x) — это пример полного распределения, определяющего энтропию Шеннона для конкретного события:

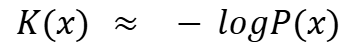

Теорема кодирования утверждает, что сложность Колмогорова приблизительно равна информации Шеннона, содержащейся в строке.

Это означает, что длина самой короткой программы, выдающей x, приблизительно равна логарифмически обратной полной вероятности выдачи x. Другими словами, наше распределение Шеннона содержит самую короткую программу как программу, имеющую наибольшую вероятность! Теперь мы связали длину программы с теорией вероятностей: чем более сжимаем вывод программы, тем выше вероятность её появления.

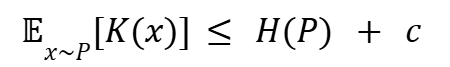

Таким образом, мы связываем алгоритмическую сжимаемость, а именно длину программы, определяемую для конкретного экземпляра, с теорией вероятности и информацией, что позволяет нам рассматривать сжимаемость как байесовское правдоподобие. Кстати, причина отсутствия точного равенства в приведенном выше уравнении заключается в том, что постулируемое соотношение не является точным с точностью до аддитивной константы c, которая зависит от выбора универсальной машины Тьюринга (UTM), что делает K(x) машинно-зависимым до достижения верхней границы c для всех UTM:

Теперь вы, вероятно, задаетесь вопросом, какое распределение позволяет нам определить вероятности всех возможных длин программ? Это распределение — универсальное априорное распределение Соломонова.

Индукция Соломонова

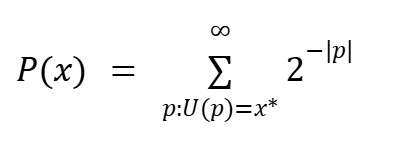

Как мы уже обсуждали, выбор априорной функции влияет на апостериорную, особенно при достаточно малых размерах выборки. Возникает вопрос: а что, если бы у нас была априорная функция, которую можно было бы применить ко всем возможным событиям в выборочном пространстве? Именно это и кодирует априорная функция Соломоноффа. А именно, априорная функция Соломоноффа кодирует вероятность наблюдения выходной последовательности x как полную вероятность того, что случайная программа выдаст x на универсальной машине Тьюринга.

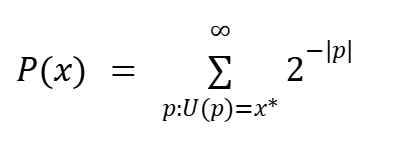

Теперь давайте рассмотрим универсальную априорную формулу Соломоноффа, которая должна подтвердить наше предыдущее утверждение о том, что алгоритмическая вероятность тесно связана с простотой. Соломонофф определил универсальную априорную формулу P(x) как сумму вероятностей всех конечных двоичных префиксных программ p, где вероятность того, что p, определяется её простотой, 2^-|p|.

Поскольку мы определяем вероятность программы как уменьшающуюся вдвое с каждым дополнительным битом, чем больше информационных битов в программе, тем меньше её вес в распределении. Следовательно, общая вероятность по всем двоичным программам без префиксов будет определяться самыми короткими программами.

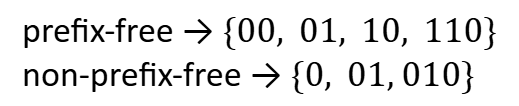

Мы установили, что априорная вероятность Соломонова определена для конечных двоичных последовательностей строк без префиксов. Давайте убедимся, что понимаем каждый из этих квалификаторов. Мы используем двоичные последовательности, поскольку универсальная машина Тьюринга может быть определена в терминах двоичных входов и выходов, где любой информационный объект может быть представлен двоичным кодом. Мы определяем априорную вероятность для конечных последовательностей, чтобы удовлетворить условиям вычислимости: бесконечные последовательности невычислимы по Тьюрингу.

Набор строк не имеет префиксов, если ни одна строка в наборе не является префиксом другой:

Это даёт наборы непересекающихся конечных двоичных строковых последовательностей. Другими словами, для вычисления их объединения нам нужны непересекающиеся наборы. Согласно аксиоме аддитивности Колмогорова, вероятность объединения элементов набора можно выразить как сумму их вероятностей.

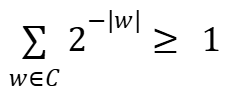

Непересекаемость гарантирует, что вероятность, связанная с каждой гипотезой или предыдущей строкой, подчиняется неравенству Крафта, которое гласит, что сумма всех вероятностей не превышает единичного интервала:

Это говорит нам, что для некоторой строки C без префиксов вероятность этой последовательности выражается как 2, возведённая в отрицательную степень, где степень описывает длину . Поскольку все последовательности не пересекаются, их сумма не может превышать 1 (хотя она может быть меньше единицы, что делает её полумерой). Это позволяет нам рассматривать веса кодов как вероятности и, следовательно, вычислять функцию массы вероятности всего распределения путём суммирования по весам строк.

Соответственно, априорная вероятность Соломонова определяется как сумма весов или вероятностей конечных бинарных программ p:

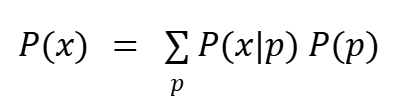

Поэтому, чтобы вычислить вероятность получения некоторого результата x из возможной программы, мы обуславливаем эту вероятность суммой вероятностей всех возможных программ:

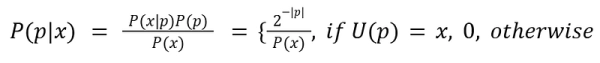

Поскольку p является детерминированным, правдоподобия и апостериорная вероятность определяются как дельта-функции: программа либо выводит x, либо нет.

Кроме того, поскольку априорная вероятность определена для двоичных строк без префиксов, мы можем выразить условность в терминах побитовых строк:

Вместо совместного распределения событий мы имеем взвешенную сумму по битовым строкам, которая синтаксически генерирует x как замену всех возможных событий. Это выявляет некоторые ограничения формализма: достаточно ли формальной сжимаемости для объяснения предвзятости одних программ или теорий по сравнению с другими? Мы рассмотрим эти ограничения позже, такие как отсутствие структурной предвзятости и выравнивания представлений.

Вместе с теоремой о кодировании, априорное утверждение Соломонова указывает на глубокую связь между индукцией и сжимаемостью: обобщение оказывается формально эквивалентным сжатию информации, то есть чем более сжимаем набор данных, тем более вероятной является программа, которая его генерирует. Однако в реальном мире мы знаем, что наиболее «сжимаемые» теории не всегда обладают наибольшей объяснительной или предсказательной силой, хотя большинство наилучших теоретических приближений стремятся к простоте.

Приведенная ниже формула выражает наши представления об алгоритмической сложности, универсальной априорной вероятности и информационной энтропии как приблизительно эквивалентные друг другу (в определенных диапазонах x):

АЙСИ

В настоящее время наша теория универсальной индукции, объединяющая априорную теорию Соломонова и апостериорную теорию Байеса, не определена для ограниченного агента. Что, если объединить индукцию Соломонова с последовательной теорией принятия решений ?

Вот тут-то и вступает в дело теория AIXI Маркуса Хуттера: она объединяет индукцию Соломонова, теорию принятия решений и обучение с подкреплением, благодаря чему наша универсальная априорная информация может выполнять работу для агента.

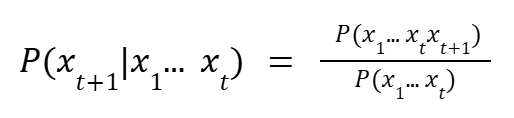

Переход от индукции Соломоноффа на территорию теории принятия решений и обучения с подкреплением требует расширения нашей онтологии до действий , наблюдений и вознаграждений . AIXI моделирует универсального агента, взаимодействие которого с любой вычислимой средой позволяет ему выбирать действие, максимизирующее ожидаемое вознаграждение. Более формально, AIXI выбирает действие на каждом временном шаге и взамен получает наблюдение и вознаграждение от среды. Как AIXI выбирает оптимальное действие? Как мы увидим, поскольку AIXI кодирует идеального байесовского агента, он представляет собой агента, основанного на модели. Однако, в отличие от типичного детерминированного агента, основанного на законах Беллмана (который решает уравнения Беллмана для определения оптимальности, см. мою предыдущую статью об обучении с подкреплением для этого), AIXI сохраняет неопределенность во всех возможных средах. Он делает это, вычисляя сумму произведений правдоподобий, а именно вероятностей обратной связи среды с учетом пространства действий, и весов Соломоноффа, назначенных каждой вычислимой среде (или программе), называемую универсальной смесью.

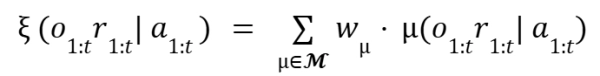

Коротко говоря, универсальная смесь представляет собой термин в AIXI, который определяет вероятностный прогноз следующей пары «наблюдение-вознаграждение» с учётом текущего действия. Она вычисляется как сумма произведений взвешенного распределения всех возможных сред. Универсальная смесь исчерпывает пространство сред путём суммирования по произведению веса каждой среды на её распределение вероятностей, где каждая модель среды μ присваивает вероятности последовательностям «наблюдение-вознаграждение» с учётом предыдущих действий. Универсальная смесь определяется по формуле ниже:

Универсальная смесь накапливает предсказательное распределение окружающей среды посредством каждого совершаемого ею действия. Можно представить ξ как распределение вероятностей для каждой возможной будущей траектории наблюдений и вознаграждений при заданной последовательности действий.

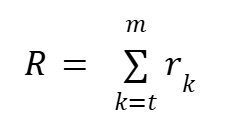

Универсальная смесь даёт нам вероятность пар наблюдения и вознаграждения в рамках истории действий, но не говорит, какая из этих траекторий обеспечивает наибольшую ценность или максимизирует вознаграждение. Для этого мы суммируем вознаграждение по средам или траекториям:

Чтобы выяснить, какую траекторию выбрать, мы умножаем сумму вознаграждений за траекторию на вероятность, присвоенную этой траектории универсальной смесью:

Таким образом, мы вычисляем ожидание, взвешивая каждую траекторию по ее совокупному вознаграждению.

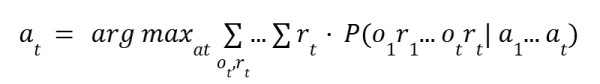

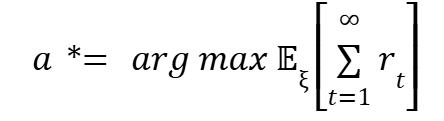

После вычисления ожиданий последний шаг — выбор действия, максимизирующего ожидаемую доходность с учётом весов вознаграждений и вероятностей среды. Для этого мы используем функцию arg max следующим образом:

Arg max выбирает действие, которое максимизирует совокупную доходность по всем возможным траекториям:

Целью AIXI является формализовать универсального агента, оснащенного априорной оценкой Соломонова, которая предрасполагает его к средам с минимальной колмогоровской сложностью. Помимо предположения о наличии всех возможных вычислимых сред и связывания сжимаемости с более высокой вероятностью, агент AIXI приобретает структурное смещение от взаимодействия со средой. Это гарантирует, что AIXI сможет ориентироваться в любой среде (при условии, что она изначально структурирована/вычислима).

Хотя AIXI формализует универсального агента, он не наделяет его достаточными смещениями для эффективной навигации в реальных средах. Другими словами, процедуры оптимального действия или принятия решений, формализуемые AIXI, не кодируют эффективные структурные смещения, такие как эвристики, специфичные для предметной области, или архитектурные ограничения, которые ускоряли бы обучение. Однако эта особенность является следствием способности AIXI устанавливать универсальные границы оптимальности решений во всех возможных средах. В принципе, AIXI приобретает эффективные структурные смещения косвенно, посредством байесовского обновления. При достаточной выборке среды AIXI асимптотически сходится к истинной среде при бесконечном количестве взаимодействий, предполагая, что среда вычислима и имеет ненулевое априорное значение. Однако на практике сходимость может быть неэффективной из-за чрезмерного распределения по апостериорным весам, что оставляет действия агента неоптимальными в течение неопределенного периода времени.

Невычислимость и структурная предвзятость

В своей универсальной форме AIXI алгоритмически не реализуем, поскольку ни сложность Колмогорова, ни априорная вероятность Соломонова невычислимы. Класс всех программ, которые останавливаются и создают допустимые (вычислимые) среды, неисчислим или не поддаётся рекурсивному перечислению. Вычисление универсальной априорной вероятности требует бесконечного моделирования сред, тогда как вычисление будущих ожиданий требует бесконечного предвидения, и всё это математически неразрешимо.

По этой причине существуют вычислимые приближения AIXI, такие как AIXItl. AIXItl вводит ограничения по времени и длине программы (что и обозначает tl), ограничивая пространство окружения Mtl до ≤ t временных шагов и l бит длиной . Однако AIXItl по-прежнему неэффективен, поскольку комбинаторные возможности окружений экспоненциальны: O(2^l). Безмодельные альтернативы, такие как DQN , и основанные на градиентах альтернативы, такие как Dreamer и World Models, представляют собой альтернативы в поиске универсального агента. Эти более поздние альтернативы используют эвристики и основанные на выборке методы для исследования, такие как поиск по дереву Монте-Карло для принятия оптимальных решений. По сути, конкуренция лежит между основанными на моделях и безмодельными методами, последние выводят свои смещения полностью из взаимодействия с окружением.

Репрезентативное выравнивание

Как мы уже отмечали, AIXI рассматривает Вселенную как вычислимую последовательность, представленную конечными двоичными строками. Предположение о том, что окружающая среда вычислима по Тьюрингу, не вытекает из тезиса Чёрча-Тьюринга и, таким образом, представляет собой дополнительное предположение AIXI. Истинность этого предположения в принципе, то есть не по отношению к реализуемой машине, остаётся открытым вопросом, хотя есть веские основания считать его ложным.

Как мы видели, AIXI обрабатывает наблюдения как битовые строки, тогда как данные реального мира требуют структурированных представлений, таких как причинно-следственная структура, временные связи и пространственные измерения, и это лишь некоторые из них. Для кодирования более богатых структур в AIXI нам понадобятся априорные данные, кодирующие структурированные представления, такие как графы, тензоры, дифференциальные уравнения и т. д. Кодирование структурных смещений сделало бы AIXI более эффективным, но за счёт его универсальности. Таким образом, стоимость кодирования структур репрезентативных данных реального мира в байесовской модели заключается в специализации модели в ущерб обобщаемости относительно среды. Учитывая, что на практике агент, реализующий AIXI, невозможен, нам следует рассмотреть агенты, кодирующие представления реального мира, такие как AIXItl, агенты без моделей или агенты на основе глубокого обучения.

Активный вывод

Мы увидели, что AIXI включает в себя максимально информативную априорную вероятность, но эта априорная вероятность совершенно неструктурирована и не содержит никаких априорных знаний о мире, за исключением смещения метаотбора в пользу коротких или сжимаемых программ как наиболее вероятных. Мы также увидели, что это делает как AIXI, так и априорную вероятность Соломонова вычислительно сложными, что исключает возможность её реализации в полной форме.

Другое направление агентного моделирования, недавно получившее название «активный вывод», центральным элементом которого является принцип минимизации свободной энергии, направлено на интеграцию таких методов моделирования, как максимизация полезности, обучение с подкреплением, байесовский вывод, предиктивное кодирование, статистическая механика и динамика, далёкая от термодинамического равновесия, в единую модель иерархического генеративного байесовского агента. Оптимальность в генеративной байесовской модели активного вывода заключается в минимизации свободной энергии, которая определяется как ожидаемое удивление от совместного появления ощущений и их предполагаемых причин.

Проще говоря, генеративная модель предсказывает будущие восприятия на основе действий посредством прямой модели, которая оценивает причины этих ощущений на основе априорных данных, и, наоборот, оценивает или предсказывает действия, необходимые для достижения желаемых состояний, посредством обратной модели. Агент динамически перемещается в среде, используя циклы прямых и обратных моделей, или, проще говоря, циклы восприятия и действия. Свободная энергия возникает из-за несоответствия между прогнозами и обратной связью среды, минимизируемого посредством иерархического байесовского обновления априорных данных модели.

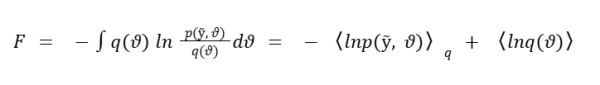

Формула ниже формально выражает вычисление вариационной свободной энергии как расхождение между плотностью распознавания (приблизительной апостериорной вероятностью) и условной плотностью (истинной апостериорной вероятностью), где ỹ обозначает наблюдаемые входные данные, 𝜗 — скрытые причины, p(ỹ, 𝜗) определяет генеративную модель как совместную плотность вероятности восприятий и скрытых причин, тогда как q(𝜗) определяет приблизительную апостериорную вероятность:

Первое выражение в формуле определяет дивергенцию Кульбака-Лейблера между приближенным апостериорным q(𝜗) и истинным апостериорным p(𝜗| ỹ) за вычетом логарифмического свидетельства модели log p(ỹ). В общем случае дивергенция Кульбака-Лейблера количественно определяет геометрическое расхождение между модельным распределением Q и фактическим распределением P. Свободная энергия возникает из-за информационно-теоретического расхождения между приближенным и истинным апостериорным смещением логарифмического свидетельства модели. Мы вычисляем вариационную свободную энергию, интегрируя логарифмическое отношение между приближенным и истинным совместным распределениями по скрытым причинам. Второй член выражает эту же величину как сумму энтропии приближенного апостериорного q(𝜗) и кросс-энтропии между апостериорным и генеративным моделями p( ỹ, 𝜗). Минимизация свободной энергии означает уменьшение дивергенции между моделью распознавания и условной плотностью.

И AIXI, и Active Inference предоставляют оптимальные байесовские агенты по-разному. Но в то время как AIXI формально невычислим в своей неограниченной форме, Active Inference позволяет получать гибкие аппроксимации с помощью вариационных байесовских моделей. Оптимизация в AIXI заключается в максимизации вознаграждения, тогда как в Active Inference — в минимизации свободной энергии. В первом случае точность модели неявно обусловлена максимизацией вознаграждения, тогда как во втором максимизация вознаграждения неявно обусловлена минимизацией ожидаемого сюрприза или свободной энергии. В этом отношении Active Inference представляет собой структурированную генеративную модель, которая иерархически оценивает скрытые причины, направляя выбор действий посредством вывода, а не перечисления, как в AIXI, которое выбирает действие, максимизирующее вознаграждение, из всех возможных сред. Тем не менее, активный вывод остается неполной структурой, поскольку он упускает из виду многие детали о конкретных агентах, такие как постановка целей, обучение модели (где оно крайне расплывчато) и жизнеспособное описание границы агента (формулировка Маркова недостаточна и неспособна отличать биологических агентов от физических систем, которые не являются реальными агентами).

Ссылки

Фристон, К., Килнер, Дж. и Харрисон, Л. (2006). Принцип свободной энергии для мозга. Журнал физиологии, Париж, 100(1–3), 70–87. https://doi.org/10.1016/j.jphysparis.2006.10.001

Хаттер, М. (2005). Универсальный искусственный интеллект: последовательные решения, основанные на алгоритмической вероятности (1-е изд.). Springer Berlin Heidelberg. https://doi.org/10.1007/b138233 SpringerLink+13SpringerLink+13Google Books+13

Соммаруга, Г. (ред.). (2009). Формальные теории информации: от теории Шеннона к семантической теории информации и общим концепциям информации (конспект лекций по информатике, том 5363). Springer Berlin Heidelberg. https://doi.org/10.1007/978-3-642-00659-3

Забелл, С. (2009). Философия индуктивной логики: байесовская перспектива. В книге Л. Хаапаранта (ред.), Развитие современной логики (стр. 725–774). Oxford University Press. https://doi.org/10.1093/acprof:oso/9780195137316.003.0044

Источник: towardsdatascience.com