В условиях, когда развитие инфраструктуры искусственного интеллекта достигает ошеломляющих масштабов, необходимость выжать максимум из имеющихся графических процессоров становится всё более острой. А для исследователей, обладающих опытом в определённой области, сейчас самое подходящее время для привлечения финансирования.

Это одна из движущих сил проекта Tensormesh, который на этой неделе был запущен из тайны, получив начальное финансирование в размере 4,5 млн долларов. Инвестиции возглавил Laude Ventures, а дополнительное финансирование было предоставлено пионером в области баз данных Майклом Франклином.

Tensormesh использует эти средства для создания коммерческой версии утилиты LMCache с открытым исходным кодом, запущенной и поддерживаемой соучредителем Tensormesh Ихуа Чэном. При правильном использовании LMCache может снизить затраты на вывод до 10 раз — эта способность сделала его основным инструментом для внедрения решений с открытым исходным кодом и привлекла внимание таких крупных игроков, как Google и Nvidia. Теперь Tensormesh планирует превратить эту академическую репутацию в жизнеспособный бизнес.

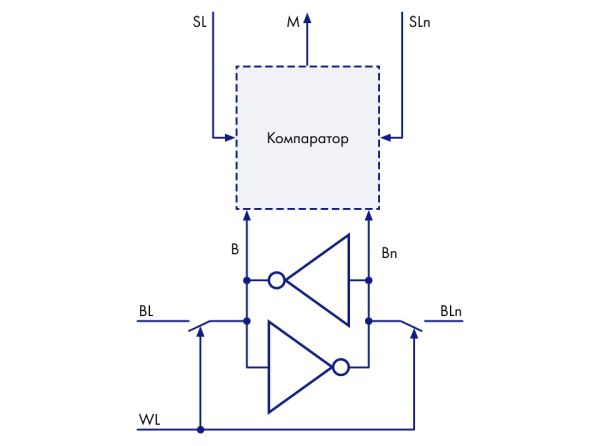

Основой продукта является кэш «ключ-значение» (или кэш KV) — система памяти, используемая для более эффективной обработки сложных входных данных путём сжатия их до значений ключей. В традиционных архитектурах кэш KV очищается после каждого запроса, но соучредитель и генеральный директор Tensormesh Цзюньчэнь Цзян утверждает, что это серьёзный источник неэффективности.

«Это как если бы очень умный аналитик считывал все данные, но после каждого вопроса забывал, чему научился», — говорит Цзян.

Вместо того, чтобы удалять этот кэш, системы Tensormesh сохраняют его, позволяя повторно использовать при выполнении моделью аналогичного процесса в отдельном запросе. Поскольку память графического процессора очень ценна, это может означать распределение данных по нескольким различным уровням хранения, но наградой за это становится значительно более высокая производительность вывода при той же нагрузке на сервер.

Это изменение особенно важно для интерфейсов чата, поскольку моделям необходимо постоянно обращаться к растущему журналу чата по мере развития разговора. Агентские системы сталкиваются с аналогичной проблемой: журнал действий и целей постоянно растёт.

Теоретически, компании, занимающиеся разработкой ИИ, могут реализовать эти изменения самостоятельно, но техническая сложность делает эту задачу непростой. Учитывая проделанную командой Tensormesh работу по исследованию процесса и сложность самих деталей, компания рассчитывает на большой спрос на готовый продукт.

«Хранить кэш KV во вторичной системе хранения и эффективно использовать его повторно, не замедляя работу всей системы, — очень сложная задача», — говорит Цзян. «Мы видели, как люди нанимали 20 инженеров и тратили три-четыре месяца на создание такой системы. Или же они могут использовать наш продукт и сделать это очень эффективно».

Источник: techcrunch.com