Современные мыслящие машины обязаны своим существованием открытиям в области физики сложных материалов. Сохранить статью Прочитать позже

Очки с S- образным креплением могут оказаться самыми полезными и бесполезными вещами, когда-либо обнаруженными.

Эти материалы, обычно состоящие из металла, а не стекла, демонстрируют загадочное поведение, которое привлекло внимание небольшой группы физиков в середине XX века. Сами спиновые стекла, как оказалось, не имеют никакого предполагаемого материального применения, но теории, разработанные для объяснения их странностей, в конечном итоге положили начало современной революции в области искусственного интеллекта.

В 1982 году физик-теоретик Джон Хопфилд, специализирующийся на физике конденсированного состояния, использовал принципы спиновых стекол для построения простых сетей, способных запоминать и воспроизводить воспоминания. Тем самым он вдохнул новую жизнь в изучение нейронных сетей — сложных сетей цифровых нейронов, от которых исследователи искусственного интеллекта в значительной степени отказались, — и вывел физику в новую область: изучение разума, как биологического, так и механического.

Хопфилд переосмыслил память как классическую задачу из статистической механики, физики коллективов: если взять некий ансамбль частей, как будет развиваться целое? Для любой простой физической системы, включая спиновое стекло, ответ даёт термодинамика: «в сторону меньшей энергии». Хопфилд нашёл способ использовать это простое свойство коллективов для хранения и извлечения данных с помощью сетей цифровых нейронов. По сути, он нашёл способ разместить воспоминания у подножия энергетических склонов. Чтобы вызвать воспоминание, сети Хопфилда, как они стали называться, не нужно ничего искать. Ей достаточно просто скатиться вниз.

Сеть Хопфилда стала «концептуальным прорывом», сказал Марк Мезар, физик-теоретик из Университета Боккони в Милане. Заимствуя знания из физики спиновых стекол, последующие исследователи, работающие над ИИ, смогли «использовать все инструменты, разработанные для физики этих старых систем».

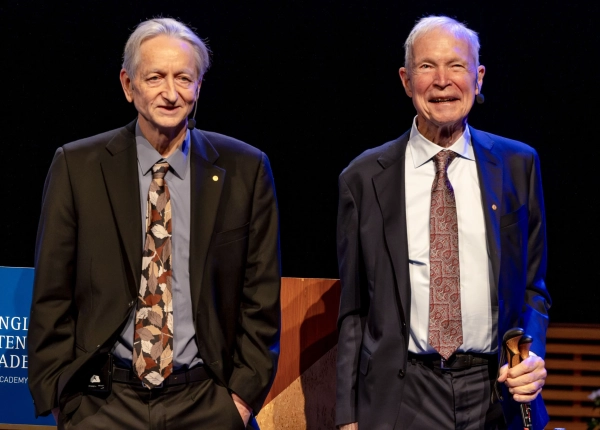

В 2024 году Хопфилд и его коллега, пионер искусственного интеллекта, Джеффри Хинтон, получили Нобелевскую премию по физике за работу по статистической физике нейронных сетей. Эта премия стала неожиданностью для многих; многие ворчали, что она, по всей видимости, стала победой исследований в области искусственного интеллекта, а не физики. Но физика спиновых стекол не перестала быть физикой, когда она помогла моделировать память и создавать мыслящие машины. И сегодня некоторые исследователи считают, что та же физика, которую Хопфилд использовал для создания машин с памятью, может быть использована для развития воображения и для проектирования нейронных сетей, которые мы действительно можем понять.

Эмерджентная память

Хопфилд начал свою карьеру в 1960-х годах, занимаясь физикой полупроводников. Но к концу десятилетия «у меня закончились задачи в физике конденсированного состояния, в решении которых мои таланты казались полезными», — написал он в эссе 2018 года. Поэтому он отправился на поиски чего-то нового. После экспериментов с биохимией, которые привели к созданию теории о том, как организмы «корректируют» биохимические реакции, Хопфилд остановился на нейронауке.

«Я искал ПРОБЛЕМУ, а не проблему», — вспоминал он в своём эссе, подчёркивая необходимость определить нечто действительно важное. «Как разум возникает из мозга, для меня — самый глубокий вопрос, поставленный человечеством. Определённо, ПРОБЛЕМА».

Хопфилд понял, что ассоциативная память является частью той проблемы, которую может решить его набор инструментов из физики конденсированного состояния.

В обычном компьютере данные хранятся статически, а доступ к ним осуществляется по адресу. Адрес не имеет никакого отношения к хранимой информации. Это всего лишь код доступа. Поэтому, если вы введёте адрес хотя бы немного неправильно, вы получите доступ к не тем данным.

Похоже, люди запоминают всё по-другому. Мы часто вспоминаем по ассоциации. Какой-то намёк или обрывок воспоминаний вызывает в памяти всё. Так происходит, когда чувствуешь запах сирени и вспоминаешь эпизод из детства в саду у дедушки, или когда слышишь первые строчки песни и ловишь себя на том, что выпеваешь каждое слово баллады, о которой даже не подозревали.

Хопфилд потратил годы на изучение ассоциативной памяти и её интерпретацию в нейронной сети. Он экспериментировал со случайно соединёнными нейронными сетями и другими потенциальными моделями памяти. Всё было не так радужно, пока, наконец, Хопфилд не нашёл неожиданный ключ к «ПРОБЛЕМЕ».

Джеффри Хинтон (слева) и Джон Хопфилд получили Нобелевскую премию по физике 2024 года на церемонии в Стокгольме в декабре. Премия была присуждена им за новаторскую работу над первыми моделями нейронных сетей, основанными на физике спиновых стекол.

Спиновые очки

В 1950-х годах учёные, изучавшие некоторые разбавленные сплавы, например, сплав железа с золотом, обнаружили, что их образцы ведут себя странно. Выше определённой температуры эти сплавы ведут себя подобно обычному материалу, например, алюминию. Сами по себе они не магнитны, но слабо взаимодействуют с внешними магнитными полями. Например, можно использовать очень сильный магнит, чтобы переместить алюминиевую банку, но сам алюминий не может быть магнитом. Обычно такие материалы, как алюминий, теряют намагниченность сразу после исчезновения внешнего магнита. Но ниже определённой температуры спиновые стекла ведут себя иначе. Их переходная намагниченность сохраняется, хотя и с меньшим значением. (Это не единственная странность спиновых стекол; их тепловые свойства также загадочны.)

Примерно в 1970 году физики, изучающие конденсированные вещества, начали получать теоретическое представление об этих материалах, немного доработав общепринятую модель коллективного магнитного поведения физиков: модель Изинга.

Модель Изинга выглядит как простая сетка стрелок, каждая из которых может быть направлена вверх или вниз. Каждая стрелка представляет собственный магнитный момент, или «спин», атома. Это упрощение реальной атомной системы, но, изменяя правила, по которым соседние спины влияют друг на друга, модель может генерировать удивительно сложное поведение.

В общем случае, соседние стрелки, указывающие в одном направлении, обладают низкой энергией, в то время как стрелки, указывающие в противоположных направлениях, обладают высокой энергией. Если спины могут свободно переворачиваться, состояние модели Изинга будет, таким образом, эволюционировать в сторону более низкоэнергетического состояния выравнивания, подобно мячу, катящемуся под гору. Магнитные материалы, такие как железо, в конечном итоге переходят в простые состояния со спинами, выровненными либо в положении «все вверх», либо в положении «все вниз».

В 1975 году физики Дэвид Шеррингтон и Скотт Киркпатрик разработали модель, которая могла бы описать более сложное поведение спиновых стекол, изменяя правила взаимодействия спинов. Они случайным образом изменяли силы взаимодействия между парами спинов и позволяли каждому спину взаимодействовать со всеми другими спинами, а не только с его ближайшими соседями. Это изменение привело к появлению сложного «ландшафта» возможных энергетических состояний. Существовали пики и впадины, соответствующие конфигурациям с более высокой и низкой энергией; в зависимости от того, где спиновое стекло начиналось в этом ландшафте, оно оказывалось в уникальной долине или состоянии равновесия с низкой энергией. Это сильно отличается от ферромагнетиков, таких как железо, которые «застывают» в одном из двух упорядоченных состояний со всеми выровненными спинами, и немагнитов, чьи спины флуктуируют случайным образом и вообще не стабилизируются. В спиновом стекле случайность замораживается.

Модель Изинга – во многом игрушечная модель. Использовать её для предсказания чего-либо о реальных материалах – всё равно что использовать человечка-палочку для планирования операции. Но, что примечательно, она часто работает. Модель Изинга стала рабочей лошадкой статистической механики. Вариации на её тему можно найти практически в каждом аспекте изучения сложных коллективных явлений, включая, благодаря Хопфилду, память.

Спиновая память

Упрощённое представление о взаимодействующих нейронах имеет много общего с моделью Изинга для магнитных спинов. Во-первых, нейроны часто моделируются как бинарные переключатели типа «вкл-выкл»: они либо активируются, либо нет. Спины, аналогично, могут быть направлены как вверх, так и вниз. Кроме того, активирующий нейрон может либо способствовать, либо препятствовать активации своего соседа. Эти переменные силы взаимодействия между нейронами напоминают переменные силы взаимодействия между спинами в спиновом стекле. «Математически можно заменить то, что было спинами, на атомы», — сказала Ленка Здеборова, физик и специалист по информатике из Швейцарского федерального технологического института в Лозанне. «Другие системы можно описать с помощью того же инструментария».

Чтобы создать свою сеть, Хопфилд начал с сети искусственных нейронов, которые могут быть либо «включены» (активны), либо «выключены» (отдыхают). Каждый нейрон влияет на состояние всех остальных нейронов, и эти взаимодействия можно регулировать. Состояние сети в любой момент времени определяется тем, какие нейроны активны, а какие находятся в состоянии покоя. Эти два состояния можно закодировать в двоичном коде: активирующий нейрон обозначается 1, а покоящийся — 0. Запишите состояние всей сети в любой момент времени, и вы получите строку битов. Сеть не «хранит» информацию в прямом смысле. Она сама является информацией.

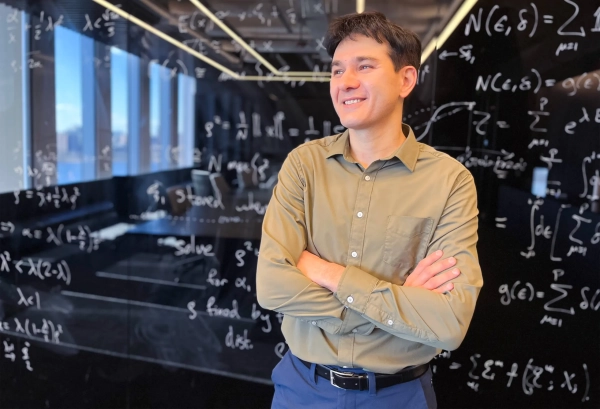

Ленка Здеборова, физик и специалист в области компьютерных наук из Швейцарского федерального технологического института в Лозанне, изучает, как физика материи может помочь моделировать поведение алгоритмов машинного обучения.

Чтобы «обучить» сеть шаблону, Хопфилд вылепил ее энергетический ландшафт, изменяя силы взаимодействий между нейронами так, чтобы желаемый шаблон попадал в устойчивое состояние с низкой энергией. В таком состоянии сеть перестает развиваться и стабилизируется только в одном шаблоне. Он нашел правило для этого, вдохновленное классическим правилом нейронов в нейронауке «нейроны, которые активируются вместе, связываются друг с другом». Он настраивал взаимодействия между нейронами, которые оба активируются (или оба отдыхают) в желаемом конечном состоянии, и уменьшал взаимодействия между несовпадающими парами. Как только сеть обучена шаблону таким образом, она может снова достичь шаблона, просто перемещаясь вниз по энергетическому ландшафту сети; она естественным образом достигнет шаблона, когда установится в равновесном состоянии.

«Хопфилд установил связь и сказал: «Послушайте, если мы сможем адаптироваться, настроить обменные связи в спиновом стекле, возможно, мы сможем сформировать точки равновесия таким образом, чтобы они стали воспоминаниями», — сказал Мезар.

Сети Хопфилда могут хранить множество воспоминаний, каждое из которых находится в своей собственной небольшой энергетической долине. То, в какую долину попадает сеть, зависит от того, где она находится в начале своего энергетического ландшафта. Например, в сети, хранящей изображение кошки и изображение космического корабля, начальное состояние, отдалённо напоминающее кошку, чаще всего скатывается в долину кошки. Аналогично, если сеть начинает работать в состоянии, напоминающем геометрические формы космического корабля, она обычно стремится к эволюции в сторону космического корабля. Именно это делает сети Хопфилда моделью ассоциативной памяти: имея искажённую или неполную версию воспоминания, сеть Хопфилда динамически восстанавливает его целиком.

Старая модель, новые идеи

С 1983 по 1985 год Хинтон и его коллеги развивали работу Хопфилда. Они нашли способы добавить случайность в сети Хопфилда, создав новый тип нейронных сетей, называемый машиной Больцмана. Вместо того, чтобы запоминать, эти сети изучают статистические закономерности в обучающих данных и генерируют новые данные, соответствующие этим закономерностям, — ранний вид генеративного ИИ. В 2000-х годах Хинтону удалось использовать урезанную версию машины Больцмана, чтобы наконец решить сложную задачу обучения «глубоких» нейронных сетей, состоящих из нескольких слоёв нейронов.

К 2012 году успех глубоких нейронных сетей, разработанных Хинтоном и другими пионерами, уже невозможно было игнорировать. «Стало ясно, что это действительно работает удивительно хорошо и буквально преобразует всю технологическую индустрию», — сказала Здеборова. Генеративные модели ИИ, с которыми многие из нас теперь взаимодействуют ежедневно, включая большие языковые модели, такие как ChatGPT, и модели генерации изображений, такие как Midjourney, — всё это глубокие нейронные сети. Их успех восходит к любознательным физикам 1970-х годов, которые не хотели оставлять без объяснения «бесполезные» свойства спиновых стекол.

Однако сети Хопфилда — это не просто часть прошлого искусственного интеллекта. Благодаря новым идеям эти старые модели могут вернуться.

В 2016 году Хопфилд и Дмитрий Кротов из IBM Research обнаружили, что сети Хопфилда — это не просто одна модель, а целое семейство моделей с разным объёмом памяти. Затем, в 2020 году, другая группа учёных показала, что ключевая часть архитектуры Transformer, лежащая в основе большинства современных успешных моделей искусственного интеллекта, принадлежит к этому расширенному семейству сетей Хопфилда.

Вооружённые этим пониманием, Кротов и его коллеги недавно разработали новую архитектуру глубокого обучения, названную «энергетическим преобразователем». Типичные архитектуры ИИ обычно разрабатываются методом проб и ошибок. Но Кротов считает, что преобразователи энергии можно проектировать более целенаправленно, с учётом конкретного энергетического ландшафта, например, более сложную версию сети Хопфилда.

Хотя сети Хопфилда изначально были разработаны для запоминания, сейчас исследователи изучают, как их можно использовать для создания чего-то нового. Генераторы изображений, такие как Midjourney, основаны на «диффузионных моделях», которые, в свою очередь, основаны на физике диффузии. Для их обучения исследователи добавляют шум к обучающим данным, например, изображениям кошек, а затем обучают модель удалять шум. Это очень похоже на работу сети Хопфилда, только вместо того, чтобы всегда попадать на одно и то же изображение кошки, диффузионная модель удаляет «некошачий» шум из зашумленного случайного начального состояния, создавая новую кошку.

Дмитрий Кротов, специалист по информатике из исследовательского центра IBM, показал, что некоторые из самых передовых моделей искусственного интеллекта, используемых сегодня, следуют тому же базовому принципу, который с самого начала использовали сети Хопфилда.

Оказывается, по мнению Кротова и его коллег, включая Бенджамина Гувера, Ючена Ляна и Бао Фама, диффузионные модели можно рассматривать как особый вид современной сети Хопфилда. Этот подход можно использовать для прогнозирования различных аспектов поведения этих сетей. Их работа предполагает, что подача всё большего количества данных в современную сеть Хопфилда не просто переполняет её память. Напротив, энергетический ландшафт модели становится настолько неровным, что она с большей вероятностью остановится на вымышленной памяти, чем на реальной. Она становится диффузионной моделью.

То, что простое изменение количества — в данном случае объёма обучающих данных — может вызвать неожиданное изменение качества, не является чем-то новым для физиков. Как писал ещё в 1972 году специалист по физике конденсированного состояния Филип Андерсон, «чем больше, тем лучше». В коллективных системах простое масштабирование сетей взаимодействий между частями может привести к появлению удивительных новых моделей поведения. «Тот факт, что [нейронная сеть] работает, — это эмерджентное свойство», — сказал Мезар.

Эмерджентность в архитектуре глубокого обучения — или в мозге — столь же увлекательна, сколь и загадочна; универсальной теории эмерджентности не существует. Возможно, статистическая физика, давшая первые инструменты для понимания коллективного поведения, станет ключом не только к использованию, но и к пониманию непостижимого машинного интеллекта, меняющего наш мир.

Источник: www.quantamagazine.org