Но они, безусловно, хотели бы, чтобы люди по-прежнему воспринимали их угрозы всерьез.

Сейчас странное время для тех, кто скептически относится к искусственному интеллекту.

Это небольшое, но влиятельное сообщество исследователей, ученых и экспертов в области политики считает, говоря простыми словами, что ИИ может стать настолько совершенным, что это может быть плохо — очень, очень плохо — для человечества. Хотя многие из этих людей скорее назвали бы себя сторонниками безопасности ИИ, чем буквальными предсказателями конца света, они предупреждают, что ИИ представляет собой экзистенциальную угрозу для человечества. Они утверждают, что без усиления регулирования отрасль может стремительно двигаться к системам, которые она не сможет контролировать. Они обычно ожидают, что такие системы появятся после создания искусственного общего интеллекта (AGI) — расплывчатого понятия, обычно понимаемого как технология, способная делать все, что могут делать люди, и даже лучше.

Эта статья является частью серии публикаций MIT Technology Review под названием «Коррекция ажиотажа» , которая призвана переосмыслить представления об искусственном интеллекте, его возможностях и направлениях нашего дальнейшего развития.

Хотя это далеко не общепринятая точка зрения в области ИИ, сторонники пессимистических прогнозов добились заметных успехов за последние несколько лет: они помогли сформировать политику в области ИИ со стороны администрации Байдена, организовали масштабные призывы к установлению международных «красных линий» для предотвращения рисков, связанных с ИИ, и получили более мощный (и влиятельный) рупор, поскольку некоторые из их сторонников получают самые престижные научные награды.

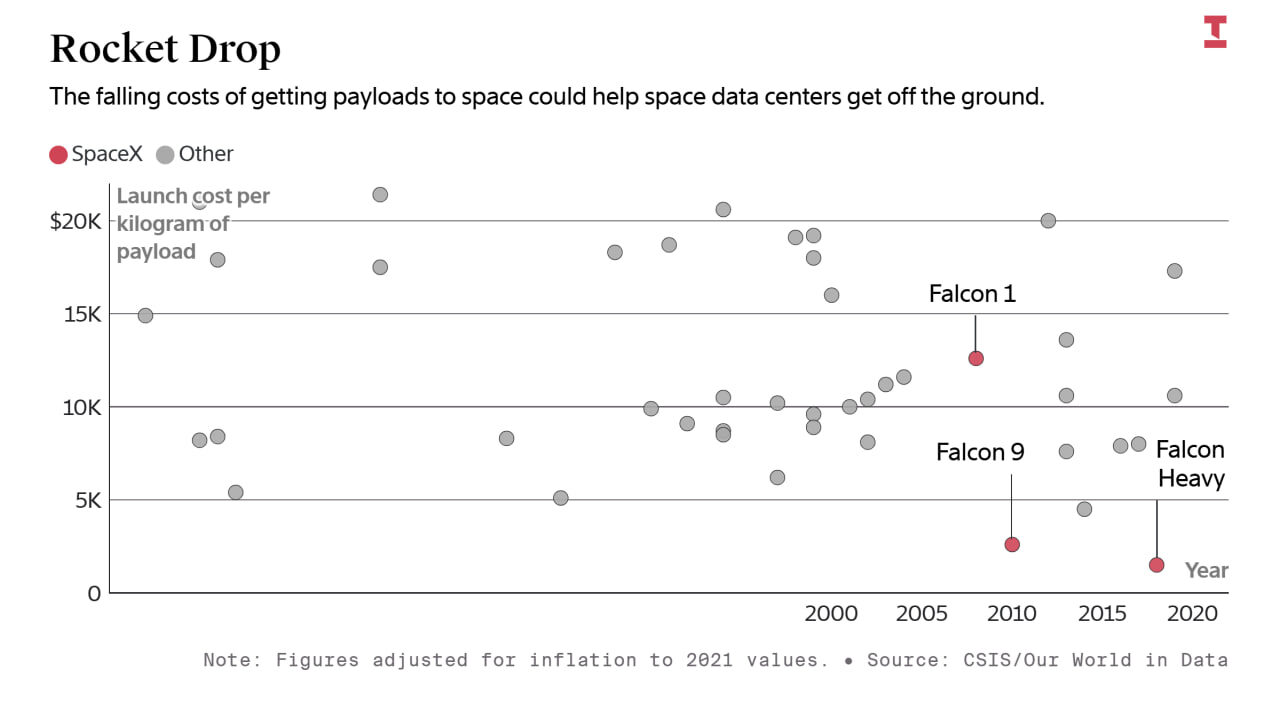

Однако ряд событий за последние шесть месяцев поставил их в невыгодное положение. Разговоры о «пузыре» искусственного интеллекта заполонили общественное обсуждение, поскольку технологические компании продолжают инвестировать в центры обработки данных, сопоставимые по масштабу с многочисленными проектами в Манхэттене, не имея никакой уверенности в том, что будущий спрос будет соответствовать объему их строительства.

Связанная статья

А затем последовал августовский релиз новейшей базовой модели OpenAI, GPT-5, который оказался несколько разочаровывающим. Возможно, это было неизбежно, поскольку это был самый разрекламированный релиз в области ИИ за всю историю; генеральный директор OpenAI Сэм Альтман хвастался, что GPT-5 ощущается «как эксперт уровня PhD» по каждой теме, и сказал подкастеру Тео Вону, что модель настолько хороша, что он чувствует себя «бесполезным по сравнению с ИИ».

Многие ожидали, что GPT-5 станет большим шагом на пути к созданию общего искусственного интеллекта (AGI), но любой прогресс, достигнутый моделью, был омрачен чередой технических ошибок и загадочным, быстро отмененным решением компании без предупреждения отключить доступ ко всем старым моделям OpenAI. И хотя новая модель показала самые передовые результаты в бенчмарках, многие, возможно, несправедливо, посчитали, что в повседневном использовании GPT-5 — это шаг назад.

Всё это, по-видимому, угрожает самим основам аргументов пессимистов. В свою очередь, конкурирующий лагерь сторонников ускорения развития ИИ, опасающихся, что ИИ на самом деле развивается недостаточно быстро и что отрасль постоянно находится под угрозой чрезмерного регулирования, видит новую возможность изменить наш подход к безопасности ИИ (или, точнее, к тому, как мы его не используем).

Это особенно верно в отношении представителей индустрии, перебравшихся в Вашингтон: «Печальные прогнозы были неверны», — заявил Дэвид Сакс, давний венчурный капиталист, ставший советником администрации Трампа по вопросам ИИ. «Идея скорого появления общего искусственного интеллекта была отвлекающим фактором и вредна, и теперь фактически доказана как неверная», — вторил ему старший советник Белого дома по вопросам ИИ и инвестор в технологии Шрирам Кришнан. (Сакс и Кришнан не ответили на запросы о комментариях.)

(Конечно, в дебатах о безопасности ИИ существует и другой лагерь: группа исследователей и сторонников, обычно ассоциируемая с термином «этика ИИ». Хотя они также выступают за регулирование, они склонны считать, что темпы прогресса ИИ преувеличены, и часто списывают ИИ как научно-фантастическую историю или аферу, отвлекающую нас от непосредственных угроз, исходящих от этой технологии. Но любой потенциальный пессимистический прогноз не даст им тех же возможностей, которые видят сторонники акселерационизма.)

Так что же остаётся пессимистам в этом случае? В рамках нашей программы «Коррекция ажиотажа» мы решили опросить некоторых из самых известных деятелей движения, чтобы выяснить, изменили ли недавние неудачи и общее изменение настроений их взгляды. Разочарованы ли они тем, что политики, похоже, больше не прислушиваются к их угрозам? Не корректируют ли они свои планы на случай апокалипсиса?

Недавние интервью с 20 людьми, изучающими или отстаивающими безопасность и управление ИИ, — включая лауреата Нобелевской премии Джеффри Хинтона, лауреата премии Тьюринга Йошуа Бенджио и таких известных экспертов, как бывший член совета директоров OpenAI Хелен Тонер, — показывают, что вместо того, чтобы чувствовать себя смиренными или заблудшими в дебрях, они по-прежнему глубоко привержены своему делу, веря, что искусственный общий интеллект остается не только возможным, но и невероятно опасным.

В то же время, они, кажется, борются с почти противоречием. Хотя они несколько обрадованы тем, что последние события указывают на то, что создание ИИ наступит раньше, чем они думали («Слава Богу, у нас больше времени», — говорит исследователь ИИ Джеффри Лэдиш), они также злятся на то, что власть имущие не воспринимают их достаточно серьезно (Дэниел Кокотайло, ведущий автор предостерегающего прогноза под названием «ИИ 2027», называет твиты Сакса и Кришнана «безумными и/или нечестными»).

В целом, эти эксперты рассматривают разговоры о «пузыре» ИИ не более чем как небольшую заминку, а разочарование в GPT-5 скорее отвлекает, чем проливает свет на ситуацию. Они по-прежнему в основном выступают за более жесткое регулирование и опасаются, что прогресс в политике — реализация Закона ЕС об ИИ; принятие первого крупного американского законопроекта о безопасности ИИ, калифорнийского SB 53; и новый интерес к рискам, связанным с искусственным интеллектом, со стороны некоторых членов Конгресса — стал уязвимым, поскольку Вашингтон чрезмерно реагирует на то, что пессимисты считают краткосрочными неудачами в оправдании ажиотажа.

Некоторые также стремились исправить, по их мнению, наиболее распространенные заблуждения о мире, склонном к пессимистическим прогнозам. Хотя их критики регулярно высмеивают их за предсказания о скором появлении искусственного общего интеллекта, они утверждают, что это никогда не было важнейшей частью их аргументации: «Дело не в неизбежности», — говорит профессор Беркли Стюарт Рассел, автор книги «Совместимость с человеком: искусственный интеллект и проблема управления». Большинство людей, с которыми я беседовал, говорят, что их представления о сроках появления опасных систем за последний год немного удлинились — важное изменение, учитывая, как быстро могут меняться политическая и техническая ситуация.

«Если бы кто-то сказал, что в 2067 году на Землю упадет астероид диаметром четыре мили, мы бы не сказали: „Напомните мне в 2066 году, и мы подумаем об этом“».

Многие из них, по сути, подчеркивают важность изменения сроков. И даже если сейчас они немного отошли на второй план, Тонер говорит мне, что одна из главных тенденций эпохи ChatGPT — это резкое сокращение этих оценок в мире ИИ. Долгое время, по ее словам, появление ИИ общего назначения ожидалось через несколько десятилетий. Теперь же, по большей части, прогнозируется на ближайшие несколько лет или даже 20 лет. Поэтому, даже если у нас есть немного больше времени, она (и многие ее коллеги) продолжают считать безопасность ИИ невероятно и жизненно важной задачей. Она говорит мне, что если бы ИИ общего назначения стал возможен хотя бы в ближайшие 30 лет, «это было бы чертовски важно. Над этим должно работать много людей».

Таким образом, несмотря на шаткое положение, в котором оказались пессимисты, их главный тезис остается неизменным: независимо от того, когда появится искусственный общий интеллект (и, опять же, они говорят, что это весьма вероятно), мир еще очень далек от готовности.

Возможно, вы согласны. А может быть, вы считаете, что такое будущее далеко не гарантировано. Или что это всего лишь научная фантастика. Возможно, вы даже думаете, что искусственный общий интеллект — это большая теория заговора. Конечно, вы не одиноки — эта тема вызывает неоднозначную реакцию. Но что бы вы ни думали о пессимистическом мышлении, нельзя отрицать тот факт, что некоторые люди в этом мире обладают огромным влиянием. Поэтому вот некоторые из самых известных людей в этой области, размышляющие об этом моменте своими собственными словами.

Интервью отредактированы и сокращены для краткости и ясности.

Лауреат Нобелевской премии, который не уверен, что его ждет.

Джеффри Хинтон, лауреат премии Тьюринга и Нобелевской премии по физике за новаторские разработки в области глубокого обучения.

Самое большое изменение за последние несколько лет заключается в том, что появились люди, которых трудно игнорировать, и которые говорят, что это опасно. Например, [бывший генеральный директор Google] Эрик Шмидт действительно осознал, что это может быть очень опасно. Недавно мы с ним были в Китае и разговаривали с членом Политбюро, секретарем партийной организации Шанхая, чтобы убедиться, что он действительно понимает ситуацию — и он понял. Я думаю, что в Китае руководство гораздо лучше понимает ИИ и связанные с ним опасности, потому что многие из них — инженеры.

Я сосредоточился на долгосрочной угрозе: когда ИИ станут умнее нас, можем ли мы действительно ожидать, что люди сохранят контроль или даже будут играть важную роль? Но я не думаю, что что-то неизбежно. Во всем огромная неопределенность. Мы никогда раньше не были в такой ситуации. Любой, кто уверен, что знает, что произойдет, кажется мне глупым. Я думаю, это очень маловероятно, но, возможно, окажется, что все, кто говорит, что ИИ сильно переоценен, правы. Возможно, окажется, что мы не сможем продвинуться дальше нынешних чат-ботов — мы уперлись в стену из-за ограниченности данных. Я в это не верю. Я думаю, это маловероятно, но возможно.

Я также не верю таким людям, как Элиэзер Юдковски, которые говорят, что если кто-нибудь это построит, мы все умрем. Мы этого не знаем.

Но если судить по совокупности доказательств, я думаю, справедливо будет сказать, что большинство экспертов, хорошо разбирающихся в ИИ, считают весьма вероятным появление сверхинтеллекта в течение следующих 20 лет. [Генеральный директор Google DeepMind] Демис Хассабис говорит, что, возможно, через 10 лет. Даже [известный скептик в отношении ИИ] Гэри Маркус, вероятно, сказал бы: «Ну, если вы создадите гибридную систему со старой доброй символической логикой… возможно, это и будет сверхинтеллект». [Примечание редактора: В сентябре Маркус предсказал, что искусственный общий интеллект появится в период с 2033 по 2040 год.]

И я не думаю, что кто-то верит, что прогресс застопорится на этапе создания общего искусственного интеллекта (AGI). Я думаю, что более или менее все считают, что через несколько лет после AGI у нас появится сверхинтеллект, потому что AGI будет лучше нас в создании ИИ.

Таким образом, хотя, на мой взгляд, очевидно, что условия становятся все сложнее, одновременно люди вкладывают гораздо больше ресурсов [в разработку передового ИИ]. Я думаю, прогресс будет продолжаться именно потому, что вкладывается гораздо больше ресурсов.

Пионер глубокого обучения, который сожалеет, что не осознал риски раньше.

Йошуа Бенджио, лауреат премии Тьюринга, председатель Международного доклада о безопасности ИИ и основатель LawZero.

Некоторые считали, что появление GPT-5 означает, что мы уперлись в тупик, но это не совсем то, что показывают научные данные и тенденции.

Некоторые люди преувеличивают идею о том, что искусственный общий интеллект (AGI) появится завтра утром, что с коммерческой точки зрения может иметь смысл. Но если посмотреть на различные бенчмарки, GPT-5 показывает результаты, которые и следовало ожидать от моделей на тот момент времени. Кстати, это касается не только GPT-5, но и моделей Claude и Google. В некоторых областях, где системы искусственного интеллекта были не очень хороши, например, в Humanity's Last Exam или FrontierMath, сейчас они показывают гораздо лучшие результаты, чем в начале года.

В то же время, общая ситуация с управлением и безопасностью ИИ неблагоприятна. Существует сильная сила, противодействующая регулированию. Это похоже на изменение климата. Мы можем прятать голову в песок и надеяться, что все будет хорошо, но это на самом деле не решает проблему.

Наибольшее расхождение во взглядах политиков заключается в непонимании масштабов изменений, которые, вероятно, произойдут, если тенденция развития ИИ сохранится. Многие представители бизнеса и правительств рассматривают ИИ просто как еще одну технологию, которая станет очень мощной в экономическом плане. Они не понимают, насколько сильно он может изменить мир, если тенденции сохранятся и мы приблизимся к уровню ИИ, сопоставимому с человеческим.

Как и многие, я в какой-то степени закрывал глаза на потенциальные риски. Мне следовало предвидеть это гораздо раньше. Но это по-человечески. Ты увлечен своей работой и хочешь видеть в ней положительные стороны. Это делает нас немного предвзятыми, поскольку мы не обращаем должного внимания на плохие вещи, которые могут произойти.

Даже малая вероятность — например, 1% или 0,1% — возникновения аварии, в которой погибнут миллиарды людей, неприемлема.

Ветеран в области искусственного интеллекта, который считает, что ИИ развивается, но недостаточно быстро, чтобы предотвратить крах этого «пузыря».

Стюарт Рассел, заслуженный профессор компьютерных наук Калифорнийского университета в Беркли и автор книги «Human Compatible».

Я надеюсь, что идея о том, что разговоры об экзистенциальном риске делают вас «пессимистом» или относятся к «научной фантастике», будет восприниматься как нечто маргинальное, учитывая, что большинство ведущих исследователей в области ИИ и большинство ведущих руководителей компаний, занимающихся ИИ, воспринимают это всерьез.

Высказывались утверждения, что ИИ никогда не сможет пройти тест Тьюринга, или что никогда не удастся создать систему, которая бы свободно использовала естественный язык, или систему, способную парковать автомобиль параллельно. Все эти утверждения в конечном итоге опровергаются прогрессом.

Люди тратят триллионы долларов на создание сверхчеловеческого искусственного интеллекта. Я думаю, им нужны новые идеи, но есть значительная вероятность, что они их придумают, потому что за последние несколько лет появилось много важных новых идей.

За последние 12 месяцев я довольно стабильно оценивал вероятность того, что эти прорывы не произойдут вовремя, чтобы спасти отрасль от краха пузыря, в 75%. Потому что инвестиции соответствуют прогнозу о том, что у нас будет гораздо более совершенный ИИ, который принесет гораздо больше пользы реальным клиентам. Но если эти прогнозы не сбудутся, то на фондовых рынках прольется много крови.

Однако вопрос безопасности не в неизбежности катастрофы. Он в том, что у нас до сих пор нет решения проблемы управления. Если бы кто-то сказал, что в 2067 году на Землю упадет астероид диаметром четыре мили, мы бы не сказали: «Напомните мне в 2066 году, и мы подумаем об этом». Мы не знаем, сколько времени потребуется для разработки технологии, необходимой для управления сверхинтеллектуальным искусственным интеллектом.

Если посмотреть на прецеденты, то допустимый уровень риска расплавления активной зоны атомной электростанции составляет примерно один случай на миллион в год. Гибель атомных электростанций — гораздо более серьезная угроза. Поэтому, возможно, допустимый уровень риска следует установить на уровне одного случая на миллиард. Но компании говорят, что это примерно один случай на пять. Они не знают, как сделать этот риск приемлемым. И это проблема.

Профессор пытается прояснить ситуацию с безопасностью ИИ.

Дэвид Крюгер, доцент кафедры машинного обучения в Университете Монреаля и Институте Мила Йошуа Бенджио, а также основатель компании Evitable.

Думаю, реакция на GPT-5 определенно была чрезмерной. Но ажиотаж был. Насколько я помню, несколько генеральных директоров с разной степенью детализации заявляли, что к концу 2025 года у нас появится автоматизированная замена удаленному сотруднику. Но, похоже, это не оправдало ожиданий, поскольку агентов пока еще нет.

Связанная статья

Меня удивило, насколько сильно общественное внимание привлекают эти прогнозы об искусственном общем интеллекте (ИИ) к 2027 году. Когда наступит 2027 год, если всё будет выглядеть относительно нормально, я думаю, люди почувствуют, что вся эта картина мира опровергнута. И меня очень раздражает, как часто, когда я говорю с людьми о безопасности ИИ, они предполагают, что я считаю, что у нас очень короткие сроки появления опасных систем, или что я думаю, что LLM-технологии или глубокое обучение приведут к появлению ИИ. Они приписывают мне все эти дополнительные предположения, которые не нужны для обоснования моей точки зрения.

Я думаю, на решение проблемы международной координации уйдут десятилетия. Поэтому, даже если до появления опасного ИИ ещё десятилетия, это уже неотложная задача. Многие, кажется, упускают этот момент из виду. Существует идея: «Давайте подождём, пока не появится действительно опасная система, а потом начнём ею управлять». Да уж, это уже слишком поздно.

Я по-прежнему считаю, что люди в сфере безопасности, как правило, работают за кулисами, с влиятельными людьми, а не с гражданским обществом. Это дает повод тем, кто утверждает, что все это просто афера или лоббирование со стороны инсайдеров. Это не значит, что в этих утверждениях нет правды, но лежащий в их основе риск все еще реален. Нам необходимо повысить осведомленность общественности и заручиться широкой поддержкой для эффективного реагирования.

Если вы действительно верите, что в ближайшие 10 лет существует 10% вероятность катастрофы — а я думаю, что разумный человек должен так считать, если присмотрится повнимательнее, — то первое, что вам подскажет: «Зачем мы это делаем? Это безумие». Это вполне разумная реакция, как только вы примете эту предпосылку.

Эксперт по вопросам управления выразил обеспокоенность по поводу доверия к безопасности ИИ.

Хелен Тонер, исполняющая обязанности исполнительного директора Центра безопасности и новых технологий Джорджтаунского университета и бывший член совета директоров OpenAI.

Когда я только начинал работать в этой области, безопасность ИИ представлялась скорее набором философских идей. Сегодня это процветающая группа подразделов машинного обучения, заполняющая пробел между некоторыми из самых «экстраординарных» опасений по поводу махинаций, обмана или стремления к власти со стороны ИИ и реальными, конкретными системами, которые мы можем тестировать и с которыми можем экспериментировать.

«Я опасаюсь, что некоторые завышенные оценки сроков создания общего искусственного интеллекта, сделанные специалистами по безопасности ИИ, готовят почву для ситуации, когда мальчик кричит «Волк!»».

Управление ИИ постепенно улучшается. Если у нас много времени на адаптацию, и управление может продолжать медленно совершенствоваться, я не думаю, что всё плохо. Если же времени мало, то, вероятно, мы движемся слишком медленно.

Я думаю, что GPT-5 в Вашингтоне в целом воспринимается как разочарование. Ведутся довольно поляризованные дискуссии на тему: получим ли мы искусственный общий интеллект и сверхинтеллект в ближайшие несколько лет? Или же ИИ — это всего лишь шумиха, бесполезный и мыльный пузырь? Маятник, возможно, слишком сильно качнулся в сторону «У нас очень скоро появятся сверхспособные системы». И теперь он снова качается в сторону «Это всё шумиха».

Я опасаюсь, что некоторые завышенные прогнозы сроков появления ИИ от специалистов по безопасности искусственного интеллекта готовят почву для ситуации, когда мальчик будет кричать «Волк!». Когда прогнозы о появлении ИИ в 2027 году не сбудутся, люди скажут: «Посмотрите на всех этих людей, которые выставили себя на посмешище. Вам больше никогда не следует их слушать». Это нечестный ответ с интеллектуальной точки зрения. Возможно, позже они передумали или посчитали, что вероятность составляет всего 20 процентов, и всё же решили обратить на это внимание. Думаю, это не должно стать препятствием для того, чтобы люди прислушались к вашему мнению позже. Но меня беспокоит то, что это сильно подорвет доверие. И это касается людей, которые очень обеспокоены безопасностью ИИ и никогда не говорили о сжатых сроках.

Исследователь в области безопасности ИИ, который теперь считает, что создание общего искусственного интеллекта (AGI) — это более отдаленная перспектива, и благодарен за это.

Джеффри Лэдиш, исполнительный директор Palisade Research.

За последний год два важных события внесли изменения в мои планы по созданию общего искусственного интеллекта.

Во-первых, отсутствие качественных данных оказалось гораздо большей проблемой, чем я ожидал.

Во-вторых, первая «рассуждающая» модель, o1 от OpenAI, выпущенная в сентябре 2024 года, показала, что масштабирование обучения с подкреплением оказалось более эффективным, чем я предполагал. А затем, спустя несколько месяцев, мы видим масштабирование от o1 до o3, и получаем невероятно впечатляющие результаты в математике, программировании и науке — областях, где результаты легче проверить. Но хотя мы наблюдаем постоянный прогресс, он мог бы быть гораздо быстрее.

Всё это повышает мою медианную оценку начала полностью автоматизированных исследований и разработок в области ИИ с трёх лет до, возможно, пяти или шести лет. Но это, в некотором смысле, вымышленные цифры. Это сложно. Хочу оговориться: «Чёрт возьми, здесь действительно очень трудно делать прогнозы».

Слава Богу, у нас есть больше времени. У нас есть, возможно, очень короткий промежуток времени, чтобы действительно попытаться понять эти системы, прежде чем они станут достаточно эффективными и стратегически важными, чтобы представлять реальную угрозу нашей способности контролировать их.

Но страшно видеть, как люди думают, что мы больше не продвигаемся вперед, хотя это явно не так. Я просто знаю, что это неправда, потому что я использую эти модели. Один из недостатков развития ИИ заключается в том, что скорость его развития делает его все менее понятным для обычных людей.

Конечно, в некоторых областях это не так — например, взгляните на Sora 2. Любому, кто на неё посмотрит, совершенно очевидно, что Sora 2 намного лучше предыдущих частей. Но если вы спросите GPT-4 и GPT-5, почему небо голубое, они дадут вам практически тот же ответ. И это правильный ответ. Способность объяснить, почему небо голубое, уже исчерпана. Поэтому я ожидаю, что сейчас лучше всего понимают прогресс в области ИИ те, кто непосредственно занимается разработкой с использованием ИИ или применяет ИИ для решения очень сложных научных задач.

Специалист по прогнозированию на основе искусственного интеллекта, предвидевший натиск критиков.

Дэниел Кокотайло, исполнительный директор проекта AI Futures Project, информатор OpenAI и ведущий автор книги «AI 2027», яркого сценария, согласно которому, начиная с 2027 года, искусственный интеллект за несколько месяцев превратится из «сверхчеловеческих программистов» в «невероятно сверхинтеллектуальные» системы.

Похоже, политика в отношении ИИ ухудшается, о чем свидетельствует суперкомитет политических действий «За ИИ» [запущенный в начале этого года руководителями OpenAI и Andreessen Horowitz для лоббирования программы дерегулирования], а также безумные и/или нечестные твиты Шрирама Кришнана и Дэвида Сакса. Исследования в области безопасности ИИ продвигаются обычными темпами, которые впечатляюще высоки по сравнению с большинством областей, но медленнее, чем должны быть.

Связанная статья

На первой странице нашего сценария «ИИ 2027» мы упомянули, что наши временные рамки несколько длиннее 2027 года. Поэтому, даже когда мы запустили «ИИ 2027», мы ожидали, что в 2028 году появится множество критиков, триумфально заявляющих о нашей дискредитации, как это было в твитах Сакса и Кришнана. Но мы думали и продолжаем думать, что взрывной рост интеллекта, вероятно, произойдет в течение следующих пяти-десяти лет, и что когда это случится, люди вспомнят наш сценарий и поймут, что он был ближе к истине, чем все остальное, доступное в 2025 году.

Предсказывать будущее сложно, но попытки полезны; люди должны стремиться выражать свою неуверенность в отношении будущего таким образом, чтобы это было конкретно и поддавалось проверке. Именно это мы и сделали, и очень немногие другие. Наши критики в основном не делали собственных прогнозов и часто преувеличивают и искажают наши взгляды. Они говорят, что наши временные рамки короче, чем они есть или когда-либо были, или что мы более уверены, чем мы есть или были.

Я довольно оптимистично настроен по поводу увеличения сроков до AGI. Кажется, мой врач просто дал мне более точный прогноз. Хотя, по сути, ситуация всё ещё остаётся прежней.

Гаррисон Лавли — журналист-фрилансер и автор онлайн-издания Obsolete, а также готовящейся к выходу книги, посвященной дискурсу, экономике и геополитике гонки за создание сверхинтеллектуальных машин (выход весной 2026 года). Его статьи об ИИ публиковались в New York Times, Nature, Bloomberg, Time, The Guardian, The Verge и других изданиях.

Источник: www.technologyreview.com