Ключевые выводы:

-

TPU обеспечивают в 4 раза лучшую производительность по стоимости, чем GPU Nvidia для задач по выводу искусственного интеллекта

-

Midjourney снизил стоимость вывода на 65% после перехода с Nvidia на Google TPU

-

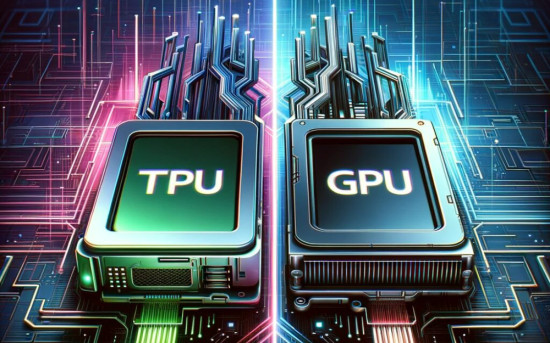

Вывод обходится в 15 раз дороже, чем обучение за весь срок службы модели и экспоненциально растёт

-

К 2030 году вывод будет потреблять 75% всех вычислительных ресурсов ИИ (рынок $255 миллиардов)

-

Крупные компании, занимающиеся ИИ, включая Anthropic, Meta и Midjourney, переходят на инфраструктуру TPU

В стремительной гонке за превосходство ИИ Nvidia давно царит как бесспорный король. Его GPU обеспечили стремительный рост машинного обучения, превращая абстрактные нейронные сети в реальность и поддерживая империю, оценённую в триллионы. Но по мере развития ландшафта ИИ в брони Nvidia появляются трещины. Переход от обучения моделей (оплот Nvidia) к выводу, применению этих моделей в реальном времени, меняет рынок. И в авангарде этой революции стоят Tensor Processing Units (TPU) от Google, обеспечивающие непревзойденную эффективность и экономию средств, что может означать конец монополии Nvidia.

К 2030 году выводы будут потреблять 75% вычислений ИИ, создавая рынок на 255 миллиардов долларов с ростом 19,2% в год. Тем не менее, большинство компаний всё равно оптимизируют расходы на обучение. Это не просто хайп; это экономика. Тренировки — это одноразовый спринт, а вывод — бесконечный марафон. Пока такие компании, как OpenAI, сталкиваются с стремительно растущими счетами за выводы (прогнозируемые в 2,3 миллиарда долларов только на 2024 год, что значительно превышает затраты на обучение GPT-4 в 150 миллионов долларов), TPU от Google становятся экономически эффективным гигантом. В этом глубоком анализе мы рассмотрим, как TPU выигрывают войну выводов, поддерживаемую реальными миграциями лидеров отрасли, и почему этот поворот сигнализирует о скором снижении Nvidia.

Разделение вычислений ИИ: обучение против вывода

Чтобы понять сейсмический сдвиг, происходящий, сначала нужно разобрать два столпа вычислений ИИ: обучение и вывод.

Обучение: Главное достижение Nvidia

Обучение — это интенсивный процесс подачи огромных массив данных в нейронные сети, чтобы «обучить» их паттернам, прогнозам и поведению. Он требует много вычислений, требует параллельной обработки на тысячах GPU для обработки умножения матриц и обратного распространения. Здесь Nvidia построила свою империю. Её программная экосистема CUDA и архитектура Hopper (например, графический процессор H100) отлично справляются с этой задачей брут-форса, обеспечивая такие прорывы, как GPT-4 и стабильная диффузия.

Но тренировки ограничены. После обучения модели тяжёлая работа прекращается. Затраты заранее загружены: один запуск может потреблять миллионы часов GPU, но это ограничено. Для GPT-4 этот одноразовый счет составил $150 миллионов. Видеокарты Nvidia благодаря своей универсальности для графики, симуляций и универсальных вычислений сделали их основным выбором на этом этапе. К 2023 году Nvidia контролировала более 80% рынка чипов на базе ИИ, получив доход в размере 60 миллиардов долларов только от продаж дата-центров.

Вывод: Вечная денежная яма

Вывод меняет ситуацию. Это этап развертывания: каждый запрос ChatGPT, генерация изображений или алгоритм рекомендации, запускающий обученную модель на новых данных. В отличие от обучения, вывод является вечным: каждый обработанный токен, каждое взаимодействие пользователя, каждая секунда работы понесены издержками.

Вот где математика становится беспощадной. Требования к выводу — это не единичный случай; Они масштабируются по использованию. Расходы OpenAI на выводы в 2024 году выросли до 2,3 миллиарда долларов, что в 15 раз превышало стоимость обучения GPT-4. Во всем мире затраты на выводы машинного обучения стремительно растут, поскольку ИИ интегрируется в приложения — от автономных автомобилей до персонализированной рекламы. Аналитики оценивают, что к 2026 году спрос на инференцию превзойдет обучение на 118 раз. К 2030 году он может занять 75% общего объема вычислительной мощности ИИ, что приведёт к инвестициям в инфраструктуру в размере 7 триллионов долларов.

Видеокарты Nvidia, оптимизированные для высокопроизводительного параллелизма обучения, здесь сбиваются. Они тратят энергию и память на текущие запросы, что приводит к неэффективности. Появляется вывод: будущее, где стоимость за запрос преобладает.

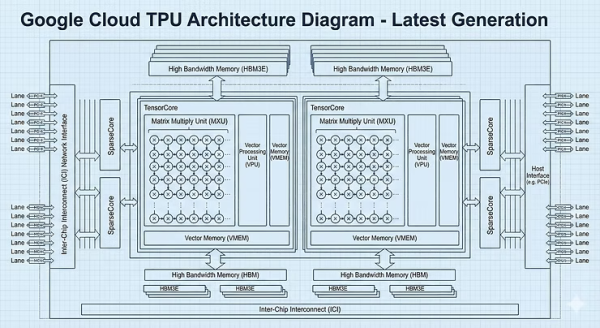

TPU от Google: разработаны для эпохи выводов

Google не наткнулся на TPU случайно; она спроектировала их для собственной империи, обеспечивая поиск, рекомендации на YouTube и Translate на планетарном уровне. Запущенные в 2016 году, TPU — это специализированные интегральные схемы (ASIC), адаптированные для тензорных операций — математики, лежащих в основе ИИ.

Архитектурное преимущество: почему TPU разрушают вывод

Подробный обзор первой тензорной обработочной единицы (TPU) от Google

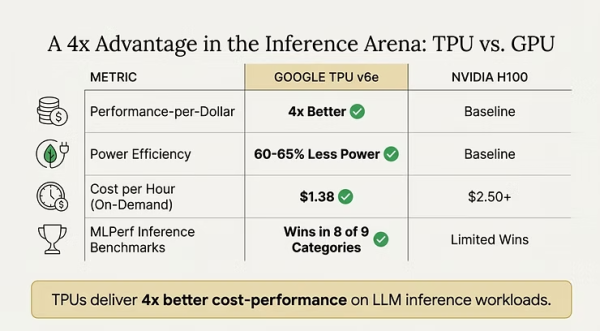

TPU блистают в систолических массивах — аппаратных сетках, которые эффективно передают данные без постоянной загрузки памяти, без резких задержек и энергопотребления. Nvidia GPU, универсальные швейцарские армейские ножи, инструкции для декодирования на лету, добавление накладных расходов. Для понимания: это означает, что TPU обеспечивают в 4 раза лучшую производительность на доллар, чем H100 от Nvidia при таких нагрузках, как LLM. Последний TPU Ironwood (v7) от Google может похвастаться скоростью в 4 раза выше, чем v6, и в 10 раз выше пиковой вычислительной мощности v5p, при этом каждое поколение даёт в 2–3 раза больше ценности.

Энергоэффективность — ещё одно отличное приложение. ТПУ используют вертикальную подачу питания, потребляя до 60-65% меньше энергии, чем GPU для поисковых запросов. В бенчмарках MLPerf TPU v5e лидирует в 8 из 9 категорий выводов, завершая такие задачи, как BERT, обслуживающий в 2,8 раза быстрее, чем A100 GPU.

Цены закрепляют ситуацию: TPU по запросу v6e начинается с $1,375/час, снижаясь до $0,55 с учётом обязательств, избегая лицензионных сборов Nvidia. Для v5e pod против восьми H100 пользователи отмечают «гораздо меньшие деньги» за превосходное соотношение цена-качество.

Сравнение AI-чипов 2025: TPU против GPU в лобовом противостоянии

|

Метрический |

TPU v6e |

Nvidia H100 |

Преимущество |

|

Стоимость за час |

$1.38 |

$2.50+ |

TPU на 45% дешевле |

|

Производительность вывода |

4 раза за доллар |

Базис |

TPU в 4 раза лучше |

|

Энергоэффективность |

60-65% меньше |

Базис |

TPU (зелёный ИИ) |

|

Побеждает вывод MLPerf |

8 из 9 категорий |

Ограниченный |

Доминирование TPU |

|

Гибкость экосистемы |

TensorFlow/JAX |

Универсальный CUDA |

Преимущество GPU |

|

Доступность на площадке |

Limited (начинающий) |

Широко распространенный |

Преимущество GPU |

Преимущество затухания Nvidia

Сила (гибкость) Nvidia становится недостатком при чистом выводе. GPU справляются с разными задачами, но тратят циклы на операции без ИИ. Поскольку доминирует вывод, специализированные ASIC, такие как TPU, разрушают этот ров. Руководители Google Cloud оценивают 10% доходов Nvidia только за счёт внедрения TPU. При валовой марже Nvidia в 70-80%, давление на цены со стороны эффективных конкурентов может сжать прибыль.

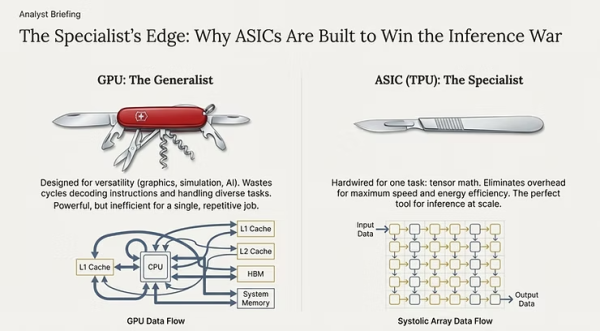

ASIC против GPU для ИИ: почему чипы, специфичные для приложений, доминируют в выводах глубокого обучения

Чтобы понять, почему TPU разрушают империю Nvidia, нам нужно понять фундаментальный архитектурный разрыв между ASIC (Application-Specific Integrated Circuits) и GPU (графическими процессорами). Это не только технические детали; Это поле битвы, где миллиарды вычислительных расходов будут выиграны или потеряны.

Что такое ASIC и чем они отличаются от GPU?

GPU — универсалы. Изначально разработанные для рендеринга графики (отсюда и название «Graphics Processing Unit»), Nvidia перепрофилировала их для искусственного интеллекта, используя возможности параллельной обработки. Видеокарта вроде H100 содержит тысячи ядер CUDA, способных справляться с различными нагрузками: игры, видеокодирование, научные симуляции, майнинг криптовалют и, да, нейронные сети. Эта универсальность сделала GPU швейцарским ножом ранней эпохи ИИ.

ASIC — это специалисты. Созданные с нуля для одной цели, ASIC жертвуют гибкостью ради чистой эффективности. TPU от Google запрограммированы для умножения матриц и тензорных операций — математического основы нейронных сетей. Каждый транзистор, каждая силовая рельс, каждый путь данных оптимизирован для одного: перемещения тензоров по вычислениям с молниеносной скоростью с минимальными потерьями энергии.

Подумайте так: GPU — это талантливый спортсмен, который компетентно играет в нескольких видах спорта. ASIC — это олимпийский спринтер, который делает одну вещь лучше всех на Земле. Для нагрузок на вывод, работающих 24/7/365, нужен спринтер.

Преимущество ASIC: почему специализация побеждает в масштабах

Энергоэффективность: ASIC устраняют накладные расходы на декодирование инструкций. GPU динамически загружают, декодируют и выполняют инструкции, сжигая циклы и питание. TPU выполняют фиксированные операции в аппаратном обеспечении, потребляя на 60-65% меньше энергии при одинаковых нагрузках. На уровне дата-центра это означает экономию миллионов долларов на электроэнергию и сокращение инфраструктуры охлаждения.

Снижение задержек: Систолические массивы в ТПУ создают детерминированные потоки данных. Информация течёт через чип в унисон, словно идеально поставленная конвейерная линия. GPU опираются на иерархии памяти (кэш L1/L2, HBM) с непредсказуемыми паттернами доступа, что приводит к скачкам задержек. Для вывода в реальном времени (чат-боты, автономные транспортные средства, финансовая торговля) важны миллисекунды.

Стоимость за операцию: Убирая неиспользуемую схему, ASIC обеспечивают больше вычислительной мощности на каждый доллар. ТПУ достигают в 4 раза лучшей производительности на доллар, чем H100 на моделях трансформаторов, потому что каждый квадратный миллиметр кремния зарабатывает на себя. GPU несут багаж: текстурные блоки, растровые операции, контроллеры дисплея — всё простоят во время AI-инференции.

Масштабируемость: ASIC можно тесно интегрировать в индивидуальные системы. TPU pods Google соединяют 4096 чипов с помощью собственных межсоединений, обеспечивая почти линейное масштабирование, невозможное с GPU с ограничением PCIe. Эта архитектурная свобода позволяет гиперскейлерам создавать фермы выводов, адаптированные под их конкретные нужды.

Компромисс: гибкость против эффективности

ASIC — это не магия. Их специализация также является их ограничением. Обучение новым архитектурам моделей, эксперименты с новыми слоями или выполнение не-AI рабочих нагрузок требуют гибкости GPU. Вот почему будущее — это не «ASIC против GPU», а стратегическое внедрение: GPU для исследований и обучения, ASIC для вывода продукции.

Новый ASIC-ландшафт: Помимо TPU, Trainium от Amazon, Microsoft Maia и стартапы вроде Cerebras и Groq заполняют рынок специализированными чипами. Каждая из них ориентирована на конкретные ниши (вывод LLM, обучение, редкие модели), фрагментируя то, что когда-то было единым королевством CUDA Nvidia.

Вердикт? Для будущего, где доминируют выводы (75% вычислений к 2030 году), ASIC — это не только конкуренция; Они неизбежны. Физика требует этого: по масштабу специализации не превзойти. Nvidia это понимает, поэтому активно продвигает оптимизированные для вывода архитектуры, такие как Blackwell. Но они пытаются сделать швейцарский армейский нож острее скальпеля. Удачи с этим.

Реальные победы: гиганты ИИ делают ставки на TPU

Доказательство — в миграциях. Ведущие мировые операторы ИИ отказываются от Nvidia в пользу TPU, сокращая затраты и масштабируя выводы как никогда прежде.

Переворот стоимости Midjourney на 65%

Генератор изображений Midjourney, основной для GPU, перешёл на TPU в 2024 году и больше не оглядывался назад. Затраты на вывод снизились на 65% — с 2 миллионов до 700 000 долларов в месяц. Используя TPU v6e, они достигли пропускной способности в 3 раза для генеративных задач, согласно аналогичным тестам Cohere. «Экономика TPU для нагрузок на выводы» оказалась преобразующим, освободив капитал для НИОКР.

Миллионный лунный вылет Anthropic

Anthropic, создатели Клода, взяли на себя обязательство создать до миллиона TPU в сделке на десятки миллиардов — крупнейшей для Google на сегодняшний день. Это открывает более 1 ГВт мощности к 2026 году, объединяя TPU с Amazon Trainium и Nvidia для диверсифицированного стека. Генеральный директор Томас Куриан указывает на «сильную цену-эффективность и эффективность» в качестве основного акцента. TPU работают в Claude с 2023 года.

Многомиллиардный поворот Meta

Meta, крупнейший клиент Nvidia (планируемое потрачение на $72 млрд в 2025 году), ведёт передовые переговоры по внедрению многомиллиардного TPU. Начиная с аренды через Google Cloud в 2026 году, Meta рассчитывает на локальную установку к 2027 году для нагрузок с высокой нагрузкой, такой как тонкая настройка Llama. Эта гибридная стратегия (Nvidia — для гибкости, TPU — для эффективности) сигнализирует о более широком исходе.

Это не исключения. Salesforce и Cohere сообщают о 3-кратном росте; Gemini от Google работает на десятках тысяч TPU. Закономерность? Сложные операторы бегут от премий Nvidia в сторону стоимости Google.

Когда выбирать TPU против Nvidia: матрица решений для инфраструктуры ИИ

Выбор между TPU и GPU Nvidia не является бинарным. Это зависит от вашей нагрузки, масштаба и стратегии инфраструктуры. Вот практическая структура, основанная на реальных внедрениях:

Выбирайте TPU, если вы соответствуете следующим критериям:

Порог стоимости: затраты на вывод превышают $50,000 в месяц. В этом масштабе экономия на основе ТПУ (40-65%) оправдывает миграционные накладные расходы.

Соответствие рабочей нагрузки: работа с LLM-сервисом, рекомендательные системы, генерация изображений или обработка видео в масштабе. Эти операции с интенсивностью тензоров являются оптимальными для TPU.

Облачные обязательства: уверены в экосистеме Google Cloud или готовы внедрить фреймворки TensorFlow/JAX.

Цели устойчивого развития: Приоритетом является экологическая и энергоэффективность. TPU потребляют на 60-65% меньше энергии, чем эквивалентные GPU, что критически важно для ESG-целей.

Предсказуемое масштабирование: Большой объем, производственный вывод с постоянными паттернами трафика, а не экспериментальными исследованиями.

Если нужно, используйте видеокарты Nvidia:

Гибкость обучения: создание индивидуальных архитектур, мультимодальных моделей или проведение исследований, требующих специфических для CUDA библиотек и инструментов.

Стратегия мультиоблака: требование аппаратной портативности между AWS, Azure и локальными дата-центрами без зависимости поставщика.

Разнообразные задачи: выполнение графического рендеринга, симуляции, игр или вычислений без искусственного интеллекта наряду с задачами машинного обучения.

Бюджетные ограничения: ежемесячные вычисления ИИ менее $20,000. Накладные расходы на установку и затраты на миграцию делают TPU менее оправданными на малых масштабах.

Передовые модели: эксперименты с архитектурами, ещё не оптимизированными для компиляции TPU или требующими кастомных ядер.

Гибридная стратегия: Корпоративный сценарий

Следуйте модели Meta: внедряйте Nvidia H100 для обучения, экспериментов и разработки моделей. Используйте TPU v6e/v7 для подачи производственного вывода. Это балансирует гибкость с оптимизацией затрат, достигая 40-50% общей экономии вычислительных затрат при сохранении гибкости исследований.

Сроки внедрения: ожидайте 2-6 месяцев для крупномасштабных миграций TPU, включая адаптацию кодовой базы, тестирование и постепенное перемещение трафика. Такие компании, как Midjourney, отражают ROI в течение 3-4 месяцев за счет снижения затрат.

Неоценённое будущее: 75% горизонт Inference и скрытые издержки ИИ в масштабах

Что никто не устанавливает цену полностью? Неограниченный масштаб вывода. Обучение — это веха; Вывод — это экономика. Каждый запрос (миллиарды в день) постоянно увеличивает затраты. Купюра OpenAI на $2.3B? Это только за 2024 год; Масштабируя до 75% доминирования в 2030 году, и это триллионы.

Прогнозы рисуют суровую картину:

Рост рынка: выводы по ИИ достигнут $255 млрд к 2030 году, CAGR 19,2%. Это затмевает рынок обучения, который застывает по мере развития базовых моделей.

Energy Crunch: кластеры по 5 ГВт для моделей фронтира, соперничающие с энергосетями малых стран. Дата-центры сталкиваются с ограниченной вместимостью по мере расширения ферм выводов.

Множитель стоимости: 15 раз больше базового уровня обучения, но использование увеличивает его ещё больше. Каждый дополнительный пользователь, каждая новая функция, каждое взаимодействие в реальном времени увеличивают счёт.

Общая стоимость владения (TCO): помимо аппаратного обеспечения, учитываются охлаждение, энергетическая инфраструктура и углеродные кредиты. Преимущество эффективности ТПУ увеличивается в 2–3 раза при учёте этих операционных затрат.

Нерешено: экологический ущерб. Выбросы Inference могут затмить тренировки. Только ChatGPT выделяет 12,8 тысячи метрических тонн CO2 в год, 25 раз по GPT-3 обучению. Эффективность TPU (до 15 раз выше предыдущих поколений) ставит Google в статус устойчивого выбора, что критично по мере ужесточения регулирования.

Задача оптимизации выводов в глубоком обучении — не только техническая; Это экзистенциально. Компании, игнорирующие этот сдвиг, рискуют структурой затрат, которые делают прибыльность невозможной в масштабе.

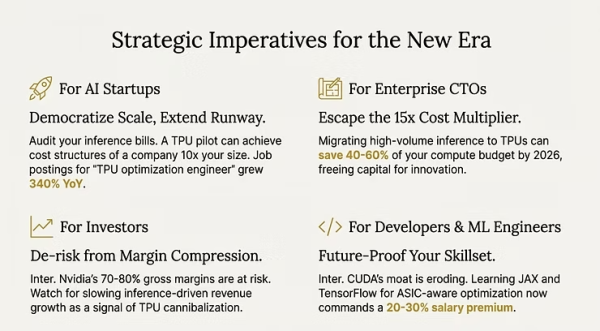

Что это значит для заинтересованных сторон: Последствия революции ТПУ

Борьба TPU против GPU не абстрактна; она меняет целые бизнес-модели, инвестиционные диссертации и карьерные траектории. Вот как должны реагировать разные игроки:

Для стартапов в области ИИ: Великое прокачивание

TPU демократизируют затраты на вывод, позволяя бережливым командам конкурировать с гигантами. 65% экономии Midjourney приводят к расширению взлётно-посадочных полос и более быстрому масштабированию. Компания на стартовой стадии, использующая инференцию на TPU, может достичь структуры затрат, ранее зарезервированных для игроков серии B+ с огромными бюджетами GPU.

Пункт действия: Проведите аудит ваших счетов по выводу. Если вы тратите более $20 тысяч в месяц на Nvidia, проведите пилотный проект TPU. Инструменты, такие как TensorFlow Model Optimization и JAX, делают миграцию более плавной, чем когда-либо.

Для корпоративных технических директоров: стратегический императив

Множитель затрат на 15-кратный вывод требует стратегического выбора оборудования сейчас, а не позже. Миграция высокообъёмного вывода на ТПУ может сэкономить 40-60% на вычислительных бюджетах к 2026 году, освободив капитал для инноваций, а не для инфраструктуры.

Скрытое преимущество: низкое энергопотребление ТПУ снижает затраты на охлаждение дата-центров на 30-40%, одновременно выполняя как бюджетные, так и экологические требования.

Риск: Задержка действий означает, что конкуренты получают преимущества по стоимости, которые увеличиваются ежеквартально. Конкурент, экономия $5 млн ежегодно на выводах, реинвестирует эти средства в более совершенные модели, создавая растущий разрыв.

Для инвесторов Nvidia: угроза сжатия маржи

В то время как выручка Nvidia в 2024 году достигла $60 млрд от дата-центров, внедрение TPU представляет долгосрочный риск для маржи. Если Google возьмёт на себя хотя бы 10% нагрузки по выводу (консервативная оценка с учётом текущих миграций), это будет $6B+ в год.

Контраргумент: архитектура Blackwell от Nvidia (запуск в 2025 году) обещает повышенную эффективность выводов. Однако ранние тесты показывают, что TPU сохраняют преимущество в 2-3 раза по стоимости чистого вывода в масштабе, что ограничивает влияние Blackwell.

Внимательно следите: прибыль Nvidia за первый квартал 2026 года. Если рост выручки, основанный на выводах, замедлится, ниже 15% по сравнению с кварталом, это говорит о реальности каннибализации TPU.

Для разработчиков и инженеров машинного обучения: как обеспечить свою карьеру в будущем

15-летний ров экосистемы CUDA разрушается. Изучение оптимизации JAX, TensorFlow и TPU теперь делает карьеру готовой к будущему по мере ускорения внедрения. Количество вакансий на позицию «инженер по оптимизации TPU» выросло на 340% по сравнению с прошлым годом в 2024 году.

Смена навыков: от общего программирования GPU к проектированию моделей с учётом ASIC. Понимание оптимизации компилятора для систолических массивов становится столь же ценным, как настройка ядра CUDA в 2020 году.

Возможности: Ранний опыт в TPU требует 20-30% повышения зарплаты, поскольку компании стремятся найти таланты для реализации миграций.

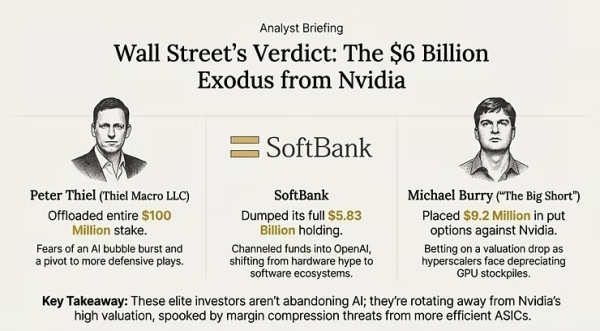

Исход Nvidia с Уолл-стрит: почему элитные инвесторы продают акции GPU на сумму 6 миллиардов долларов

По мере того как революция выводов ускоряется, некогда неоспоримое доминирование Nvidia сталкивается с резкой проверкой реальности со стороны самых острых умов Уолл-стрит, которые тихо уходят слева со сцены. Хедж-фонд Thiel Macro LLC под руководством технологического визионера Питера Тиля продал всю свою долю в 537 742 акции Nvidia в третьем квартале 2025 года (на конец сентября стоимостью около 100 миллионов долларов), реинвестируя вырученные средства в более оборонительные стратегии, такие как Apple и Microsoft, на фоне растущих опасений по поводу лопания пузыря ИИ. Это был не единичный ход; SoftBank, японский технологический конгломерат, всего несколько недель назад продал свои 32,1 миллиона акций за ошеломляющие 5,83 миллиарда долларов, направив средства в OpenAI, чтобы переключиться на программные экосистемы, а не на оборудование. Даже Майкл Бёрри, оракул «Больших шортов», предвидевший крах 2008 года, в конце 2025 года разместил опционы на пут на сумму 9,2 миллиона долларов против Nvidia, рассчитывая на обвал оценки, поскольку такие гиперскейлеры, как Meta и Oracle, будут бороться с перенасыщенными дата-центрами и обесценивающимися запасами GPU.

Эти элитные продавцы не отказываются от ИИ. Они отходят от пенистого 70-кратного P/E Nvidia, пугаясь усиливающейся конкуренции со стороны TPU Google и угрозой снижения издержек по мере того, как слава обучения угасает. С учетом того, что акции Nvidia упали на 12% по сравнению с октябрьскими пиками, несмотря на стабильные доходы, а институциональные оттоки сигнализируют о более широкой технической тревоге, этот исход более чем $6 миллиардов подчёркивает беспощадную истину: когда расчёты по выводам отдают предпочтение ASIC по сравнению с GPU, даже короли империи ИИ должны уступить волне разумного оттока капитала.

Расшифровка распродажи: три тревожных сигнала, которые видят Smart Money

Избыток предложения и амортизация: Гиперскейлеры запоевали H100 в 2023-2024 годах, наращивая потенциал для тренировочных бумов, которые так и не были полностью реализованы. Сейчас дата-центры работают на амортизационных активах (стоимость GPU падает на 30-40% ежегодно), а требования к выводу требуют более дешёвых ASIC. Это несоответствие пугает инвесторов роста, которые ценили постоянные обновления GPU.

Сжатие маржины впереди: TPU, атакующие выводы (75% будущих вычислений), заставляют Nvidia конкурировать по цене. Его валовая маржа 70-80%, любимая на Уолл-стрит, неизбежно сталкивается с сокращением. Даже маржа в 10 пунктов снижает стоимость при текущих мультипликаторах.

Реальность диверсификации: такие клиенты, как Meta, не полностью отказываются от Nvidia, но они активно диверсифицируют свою деятельность. Каждый доллар, потраченный на TPU, — это доллар, который Nvidia не забирает. С открытым открытием альтернатив Meta, Anthropic и Midjourney, риск концентрации доходов для Nvidia становится экзистенциальным фактором.

Противоположная точка зрения? Nvidia всё ещё контролирует 80% рынка, Blackwell приближается, и ров CUDA не рухнет за одну ночь. Но когда легенды вроде Берри и Тиля синхронизируют выходы, розничные инвесторы игнорируют это на свой страх и риск. Эпоха выводов не благосклонна к вчерашним чемпионам.

Трудности и будущее

TPU не безупречны. Их экосистема ограничивает гибкость по сравнению с универсальностью CUDA от Nvidia. Масштабирование подов (до 4 096 чипов) требует обязательств Google Cloud, а продажи на локальном уровне находятся в зачаточном росте. Гибриды сохранятся: Nvidia для обучающих крайних случаев, TPU для объёма вывода.

Новая конкуренция: чипы Amazon Trainium и Microsoft Maia ориентированы на схожие ниши, фрагментируя ландшафт ASIC. Однако ни одна из них не соответствует зрелости TPU (9 поколений) или проверенному масштабу (обеспечивающей триллионную инфраструктуру запросов Google).

Цепочка поставок: Google сотрудничала с Broadcom и TSMC для ускорения производства v7, решив проблемы с мощностями. К второму кварталу 2026 года доступность TPU должна соответствовать спросу, устранив барьеры для внедрения.

Тем не менее, динамика идёт на сторону Google. С ростом мощности ТПУ v7 в 2025 году и ускорением производства партнёрами, такими как Broadcom/TSMC, цепочки поставок совпадают. По мере роста выводов растёт и внедрение TPU.

Часто задаваемые вопросы: TPU против GPU Nvidia для AI-нагрузок в 2025 году

Являются ли TPU лучше GPU Nvidia для всех AI-нагрузок?

Нет. TPU превосходно справляются с выводами и тензорными операциями, предлагая в 4 раза лучшую экономичность для моделей, таких как LLM, генерация изображений и рекомендации. GPU Nvidia остаются превосходными для обучения разнообразных моделей, исследований, требующих гибкости, и нетензорных задач, таких как игры, графический рендеринг и универсальные вычисления. Лучшая стратегия часто гибридная: TPU для производственного вывода, GPU для экспериментов.

Могу ли я использовать TPU вне Google Cloud?

Будут ли чипы Nvidia Blackwell конкурировать с TPU по выводу?

Какова стоимость и сроки перехода от Nvidia к TPU?

Как TPU обрабатывают кастомные модели и архитектуры ИИ?

А как насчёт альтернатив GPU, таких как чипы AMD или Intel, для вывода из ИИ?

Заключение: Рассвет мира ИИ на основе TPU

Nvidia построила империю на прошлом обучения. Но выводы — это будущее, и на этом поле боя архитектурное преимущество Nvidia исчезает. TPU от Google, с производительностью в 4 раза на доллар, привлекают таких гигантов, как Midjourney (экономия 65%), Anthropic (1 миллион чипов) и Meta (многомиллиардные доклады). Математика беспощадна: коэффициенты затрат в 15 раз, доля вычислений 75% к 2030 году и экспоненциальные требования к масштабированию.

Для читателей AI News Hub это не просто технологические новости; Это переломный момент на рынке. Поскольку вывод поглощает бюджеты, TPU приносит спасение. Доминирование Nvidia? Она угасает на исходе. Самые умные операторы мира отходят от гиганта GPU в пользу Google и специализированных ASIC. Наступила эпоха выводов.

Вопрос не в том, нужно ли оптимизировать для выводов, а в том, когда. Компании, действующие сейчас, получают дополнительные преимущества: снижение затрат, устойчивую инфраструктуру и освобождение капитала для инноваций. Те, кто задерживает? Они будут наблюдать, как конкуренты прибыльно масштабируются, пока их счета за GPU стремительно растут.

Революция выводов уже здесь. Адаптируется ли ваша стратегия?

Источник: static.wixstatic.com

Источник: ai-news.ru