Упрощение всех концепций, необходимых для освоения обучения с подкреплением

Делиться

В этой статье объясняются основные концепции, которые вам необходимо знать для понимания обучения с подкреплением!

Мы перейдём от самых основ «что такое RL» к более сложным темам, включая исследование агентов, ценности и политики, а также разберёмся с популярными подходами к обучению. По ходу дела мы также узнаем о различных проблемах RL и о том, как исследователи их решают.

В конце статьи я также поделюсь видео на YouTube, которое наглядно объясняет все концепции статьи. Если вы не очень любите читать, можете посмотреть это видео!

Примечание: Все изображения созданы автором, если не указано иное.

Основы обучения с подкреплением

Предположим, вы хотите обучить модель искусственного интеллекта преодолевать полосу препятствий. Обучение с подкреплением (RL) — это раздел машинного обучения, где модели обучаются, накапливая опыт, выполняя действия и наблюдая за происходящим. Более формально, обучение с подкреплением состоит из двух компонентов: агента и среды.

Агент

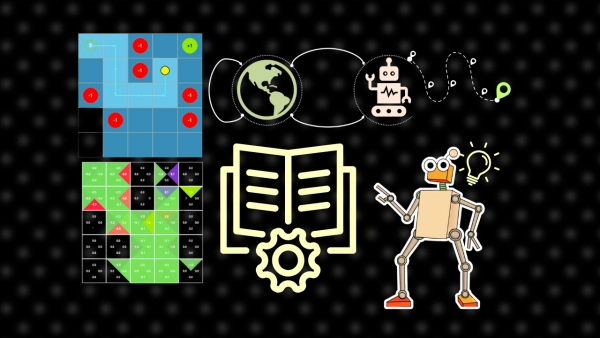

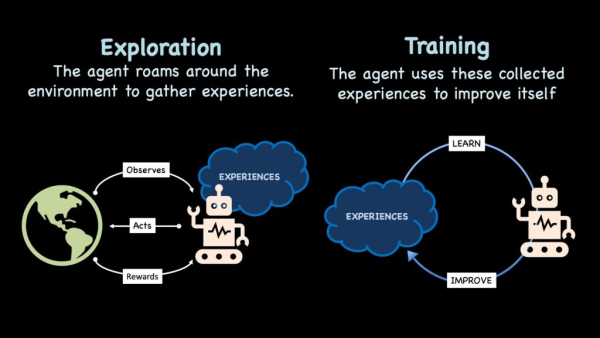

Процесс обучения включает в себя два ключевых вида деятельности, которые повторяются снова и снова: исследование и обучение . В ходе исследования агент накапливает опыт, выполняя действия и исследуя происходящие события. Затем, в ходе обучения, агент использует накопленный опыт для самосовершенствования.

Окружающая среда

После выбора агентом действия среда обновляется. Она также возвращает вознаграждение в зависимости от успешности действий агента. Разработчик среды программирует структуру вознаграждения.

Например, предположим, что вы работаете над средой, обучающей ИИ избегать препятствий и достигать цели. Вы можете запрограммировать среду на возврат положительного вознаграждения при приближении агента к цели. Но если агент сталкивается с препятствием, вы можете запрограммировать его на получение большого отрицательного вознаграждения.

Другими словами, среда обеспечивает положительное подкрепление (например, высокое положительное вознаграждение), когда агент делает что-то хорошее, и наказание (например, отрицательное вознаграждение), когда он делает что-то плохое.

Хотя агент не осознает, как на самом деле функционирует окружающая среда, он все равно может определить на основе своих моделей вознаграждения, как выбрать оптимальные действия, которые приведут к максимальному вознаграждению.

Политика

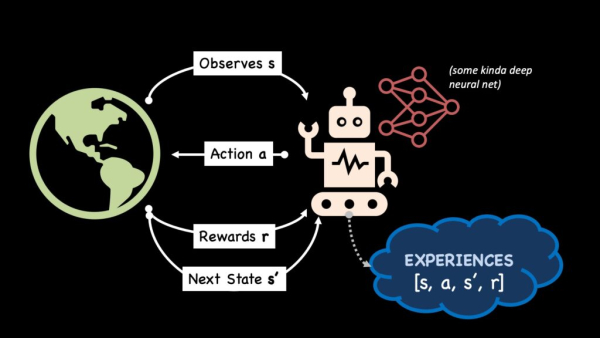

На каждом шаге агент ИИ наблюдает за текущим состоянием окружающей среды и выбирает действие. Цель обучения с подкреплением — научиться связывать наблюдения с действиями, то есть «учитывая наблюдаемое состояние, какое действие мне следует выбрать»?

В терминах RL это отображение состояния в действие также называется политикой.

Эта политика определяет, как агент ведет себя в разных состояниях, и в глубоком обучении с подкреплением мы изучаем эту функцию, обучая некую глубокую нейронную сеть.

Обучение с подкреплением

Понимание различий и взаимодействия между агентом, политикой и средой крайне важно для понимания обучения с подкреплением.

- Агент — это обучающийся, который исследует окружающую среду и предпринимает в ней действия.

- Политика — это стратегия (часто нейронная сеть), которую агент использует для определения действия, которое необходимо выполнить в зависимости от текущего состояния. В RL наша конечная цель — обучить эту стратегию.

- Окружающая среда — это внешняя система, с которой взаимодействует агент, которая обеспечивает обратную связь в виде вознаграждений и новых состояний.

Вот краткое определение, которое вам следует запомнить:

При обучении с подкреплением агент следует политике выбора действий в среде .

Наблюдения и действия

Агент исследует окружающую среду, выполняя последовательность «шагов». Каждый шаг — это одно решение. Агент наблюдает за состоянием окружающей среды. Принимает решение о действии. Получает награду. Наблюдает следующее состояние. В этом разделе давайте разберёмся, что такое наблюдения и действия.

Наблюдение

Наблюдение — это то, что агент видит из окружающей среды, — информация, которую он получает о её текущем состоянии. В среде навигации по препятствиям наблюдение может представлять собой проекции лидара для обнаружения препятствий. Для игр Atari это может быть история последних нескольких пиксельных кадров. Для генерации текста это может быть контекст сгенерированных на данный момент токенов. В шахматах это положение всех фигур, чей ход и т. д.

В идеале наблюдение содержит всю информацию, необходимую агенту для выполнения действия.

Пространство действий включает в себя все доступные решения, которые может принять агент. Действия могут быть дискретными или непрерывными. Дискретное пространство действий возникает, когда агенту приходится выбирать между определённым набором категориальных решений. Например, в играх Atari действиями могут быть кнопки контроллера Atari. При генерации текста это выбор между всеми токенами, присутствующими в словаре модели. В шахматах это может быть список доступных ходов.

Дизайнер окружения также может выбрать непрерывное пространство действий, в котором агент генерирует непрерывные значения для «шага» в окружающей среде. Например, в нашем примере навигации по препятствиям агент может выбирать скорости по осям x и y для точного управления движением. В задаче управления персонажем действие часто заключается в выдаче крутящего момента или целевого угла для каждого сустава скелета персонажа.

Самый важный урок

Но вот что очень важно понимать: для агента и политики окружающая среда и её особенности могут быть абсолютно чёрным ящиком. Агент получает информацию о векторе состояния как наблюдение, генерирует действие, получает вознаграждение и впоследствии обучается на основе этого.

Таким образом, вы можете рассматривать агента и среду как две отдельные сущности. Среда определяет пространство состояний, пространство действий, стратегии вознаграждения и правила.

Эти правила не связаны с тем, как агент исследует ситуацию, и как политика обучается на основе собранного опыта.

При изучении исследовательской работы важно прояснить, о каком аспекте обучения с подкреплением мы читаем. Речь идёт о новой среде? О новом методе обучения политике? О стратегии исследования? В зависимости от ответа, вы можете рассматривать другие вещи как чёрный ящик.

Разведка

Как агент исследует и собирает опыт?

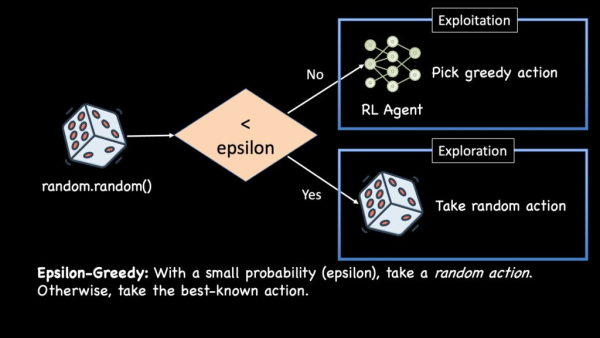

Каждый алгоритм RL должен решать одну из самых больших дилемм при обучении агентов RL — исследование против эксплуатации.

Исследование подразумевает использование новых действий для сбора информации об окружающей среде. Представьте, что вы учитесь сражаться с боссом в сложной видеоигре. Сначала вы будете пробовать разные подходы, разное оружие, заклинания, случайные вещи, просто чтобы посмотреть, что приживётся, а что нет.

Однако, как только вы начнёте получать награды, например, за постоянное нанесение урона боссу, вы перестанете исследовать и начнёте эксплуатировать уже освоенную стратегию. Эксплуатация означает жадный выбор действий, которые, по вашему мнению, принесут максимальную награду.

Хорошая стратегия разведки месторождений с помощью RL должна обеспечивать баланс между разведкой и эксплуатацией.

Популярной стратегией исследования является эпсилон-жадный (epsilon-Greedy) , при котором агент исследует, используя случайное действие лишь часть времени (определяемого параметром epsilon), а в остальное время использует наиболее известное действие. Значение epsilon обычно велико в начале и постепенно уменьшается, чтобы способствовать использованию действия по мере обучения агента.

Жадный алгоритм Эпсилон работает только в дискретных пространствах действий. В непрерывных пространствах исследование часто реализуется двумя распространёнными способами. Один из них — добавление случайного шума к действию, которое решает совершить агент. Другой популярный метод — добавление бонуса энтропии к функции потерь, что побуждает политику быть менее определённой в своём выборе, что, естественно, приводит к более разнообразным действиям и исследованию.

Вот еще несколько способов поощрения исследовательской деятельности:

- Спроектируйте среду так, чтобы в начале эпизодов использовалась случайная инициализация состояний.

- Методы внутреннего исследования, в которых агент действует, исходя из собственного «любопытства». Такие алгоритмы, как Curiosity и RND, вознаграждают агента за посещение новых состояний или выполнение действий, результат которых трудно предсказать.

Я рассказываю об этих увлекательных методах в своем видео Agentic Curiosity, так что обязательно посмотрите его!

Алгоритмы обучения

Большинство исследовательских работ и академических тем в области обучения с подкреплением посвящены оптимизации стратегии выбора действий агентом. Цель алгоритмов оптимизации — изучить действия, которые максимизируют ожидаемое вознаграждение в долгосрочной перспективе.

Давайте рассмотрим различные алгоритмические варианты по отдельности.

Основанный на моделях против не основанного на моделях

Итак, наш агент исследовал окружающую среду и накопил массу опыта. Что теперь?

Обучается ли агент действиям непосредственно на основе этого опыта? Или он сначала пытается моделировать динамику и физику окружающей среды?

Один из подходов — обучение на основе моделей. Здесь агент сначала использует свой опыт для построения собственной внутренней симуляции, или модели мира. Эта модель учится предсказывать последствия своих действий, то есть, при заданном состоянии и действии, каким будет следующее состояние и вознаграждение. Получив эту модель, он может практиковаться и планировать исключительно в рамках собственного воображения, запуская тысячи симуляций, чтобы найти наилучшую стратегию, не предпринимая ни одного рискованного шага в реальном мире.

Это особенно полезно в средах, где получение реального опыта может быть дорогостоящим, например, в робототехнике или беспилотных автомобилях. Примеры обучения на основе моделей: Dyna-Q, World Models, Dreamer и т. д. Я когда-нибудь напишу отдельную статью, чтобы подробнее рассказать об этих моделях.

Второй подход называется обучением без моделей (model-free learning) . Именно ему мы и посвятим оставшуюся часть статьи. В этом случае агент воспринимает окружающую среду как «чёрный ящик» и обучается политике непосредственно на основе накопленного опыта. Подробнее о обучении с подкреплением без моделей мы поговорим в следующем разделе.

Обучение, основанное на ценностях

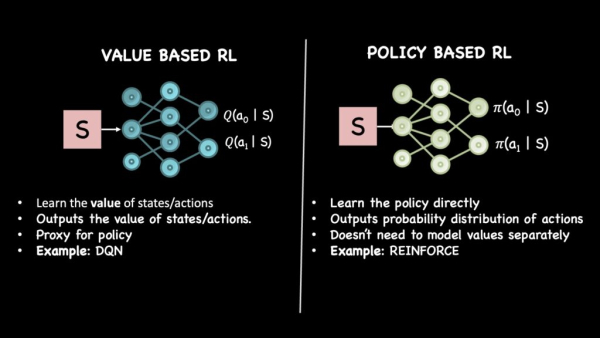

Существует два основных подхода к алгоритмам обучения с подкреплением без использования моделей.

Алгоритмы, основанные на ценностях, учатся оценивать, насколько хорошо каждое состояние. Алгоритмы, основанные на политике, напрямую учатся действовать в каждом состоянии.

В методах, основанных на ценностях, агент обучения с подкреплением изучает «ценность» пребывания в определённом состоянии. Ценность состояния буквально означает, насколько оно хорошо. Интуиция подсказывает, что если агент знает, какие состояния хороши, он может чаще выбирать действия, приводящие к этим состояниям.

И спасибо, что есть математический способ сделать это — уравнение Беллмана .

V(s) = r + γ * max V(s').

Это рекуррентное уравнение в основном говорит, что значение V(s) состояния s равно немедленной выгоде r от нахождения в этом состоянии плюс значение наилучшего следующего состояния s', которого агент может достичь из s. Гамма ( γ ) — это дисконтированный фактор (от 0 до 1), который ослабляет «качество» следующего состояния. По сути, он определяет, насколько агента заботят награды в отдалённом будущем по сравнению с немедленными. Значение γ, близкое к 1, делает агента «дальновидным», тогда как значение γ, близкое к 0, делает агента «близоруким», жадно заботящимся практически только о следующей награде.

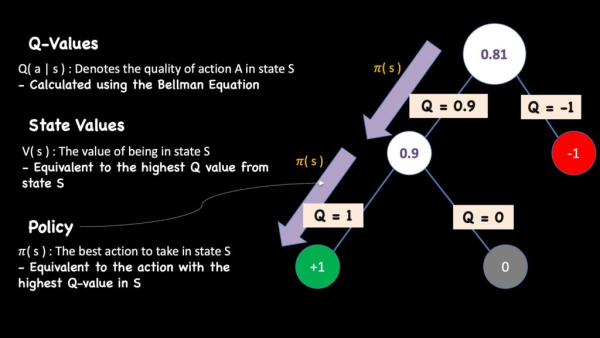

Q-обучение

Мы познали интуицию, лежащую в основе государственных ценностей, но как использовать эту информацию для обучения действиям? Уравнение Q-Learning даёт ответ на этот вопрос.

Q(s, a) = r + γ * max_a Q(s', a')

Значение Q (s,a) — это значение качества действия a в состоянии s. Вышеприведённое уравнение, по сути, гласит: качество действия a в состоянии s — это немедленное вознаграждение r, которое вы получаете, находясь в состоянии s, плюс дисконтированное значение качества следующего лучшего действия.

Итак, вкратце:

- Q-значения — это значения качества каждого действия в каждом состоянии.

- V-значения представляют собой значения определенного состояния; они равны максимальному Q-значению всех действий в этом состоянии.

- Политика π в определенном состоянии — это действие, которое имеет наибольшее значение Q в этом состоянии.

Чтобы узнать больше о Q-Learning, вы можете изучить Deep Q Networks и их производные, такие как Double Deep Q Networks и Dueling Deep Q Networks.

Обучение на основе ценностей тренирует агентов с подкреплением, изучая ценность пребывания в определённых состояниях. Однако существует ли прямой способ обучения оптимальным действиям без необходимости изучать ценности состояний? Да.

Методы обучения политике напрямую изучают оптимальные стратегии действий, не задавая явным образом значения состояний. Прежде чем мы научимся этому, нам необходимо изучить ещё одну важную концепцию: обучение по временным разностям и выборка Монте-Карло.

TD Learning против MC Sampling

Каким образом агент обобщает будущий опыт для обучения?

При обучении на основе временной разницы (TD) агент обновляет свои оценки значений после каждого шага, используя уравнение Беллмана. Он делает это, проверяя свою оценку Q-значения в следующем состоянии. Эта стратегия называется одношаговым TD-обучением, или одношаговым обучением на основе временной разницы. Вы делаете один шаг и обновляете свои знания на основе своих предыдущих оценок.

Второй вариант называется сэмплированием Монте-Карло. Здесь агент дожидается завершения всего эпизода, прежде чем что-либо обновлять. Затем он использует полный ответ из эпизода:

Q(s,a) = r₁ + γr₂ + γ²r₃ + … + γⁿrₙ

Компромиссы между TD-обучением и MC-выборкой

Обучение TD довольно эффективно, поскольку агент может чему-то научиться на каждом шаге, даже до завершения эпизода. Это означает, что вы можете сохранять накопленный опыт в течение длительного времени и продолжать обучение даже на старом опыте, но с новыми Q-значениями. Однако обучение TD сильно зависит от текущей оценки состояния агентом. Поэтому, если оценки агента неверны, он будет продолжать подкреплять эти неверные оценки. Это называется «проблемой самонастройки».

С другой стороны, обучение методом Монте-Карло всегда точно, поскольку использует истинные результаты реальных эпизодов. Но в большинстве сред обучения с подкреплением вознаграждения и переходы между состояниями могут быть случайными. Кроме того, по мере того, как агент исследует среду, его собственные действия могут быть случайными, поэтому состояния, которые он посещает во время развёртывания, также случайны. Это приводит к тому, что чистый метод обучения с обратным отсчётом страдает от проблем с высокой дисперсией, поскольку результаты могут существенно различаться между эпизодами.

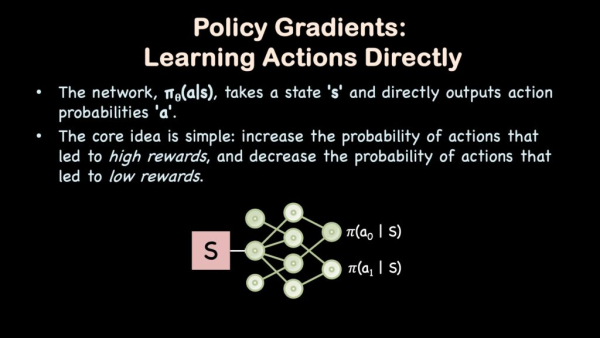

Градиенты политики

Хорошо, теперь, когда мы разобрались с концепцией TD-Learning и MC-выборки, пришло время вернуться к методам обучения на основе политики.

Напомним, что методы, основанные на ценностях, такие как DQN, сначала должны явно рассчитать ценность (Q-значение) для каждого возможного действия, а затем выбрать наилучшее. Но этот шаг можно пропустить, и методы градиента политики, такие как REINFORCE, делают именно это.

В REINFORCE сеть политики выдаёт вероятности для каждого действия, и мы обучаем её увеличивать вероятность действий, приводящих к положительным результатам. Для дискретных пространств методы PG выводят вероятность каждого действия в виде категориального распределения. Для непрерывных пространств методы PG выводят результаты в виде гауссовых распределений, предсказывающих среднее значение и стандартное отклонение каждого элемента вектора действий.

Итак, вопрос в том, как именно обучить такую модель, которая напрямую предсказывает вероятности действий на основе состояний?

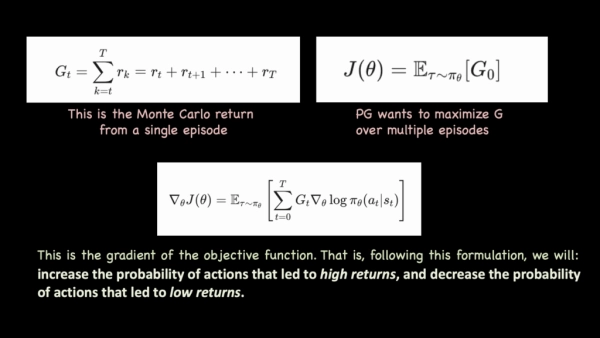

Вот тут-то и вступает в дело теорема о градиенте политики . В этой статье я объясню ее основную идею интуитивно.

- В литературе нашу модель градиента политики часто обозначают как pi_theta(a|s). Здесь тета обозначает веса нейронной сети. pi_theta(a|s) — это предсказанная тета-вероятность действия a в состоянии s нейронной сети.

- Из недавно инициализированной сети политик мы позволяем агенту отыграть полный эпизод и собрать все награды.

- Для каждого предпринятого действия вычислите общую дисконтированную доходность, полученную после него. Это делается с помощью метода Монте-Карло.

- Наконец, для фактического обучения модели теорема о градиенте политики требует от нас максимизировать формулу, представленную на рисунке ниже.

- Если доходность была высокой, это обновление повысит вероятность этого действия в будущем, увеличив pi(a|s). Если доходность была отрицательной, это обновление понизит вероятность этого действия, уменьшив pi(a|s).

Различие между Q-Learning и REINFORCE

Одно из основных различий между Q-Learning и REINFORCE заключается в том, что Q-Learning использует одношаговое TD-обучение, а REINFORCE — выборку Монте-Карло.

Используя одношаговую TD, Q-обучение должно определить значение качества Q для каждой возможности «состояние-действие». Напомним, что в одношаговой TD агент может сделать всего один шаг в среде и определить оценку качества состояния.

С другой стороны, при использовании метода Монте-Карло агенту не нужно полагаться на оценочную функцию для обучения. Вместо этого он использует фактические результаты, полученные в ходе исследования. Это делает REINFORCE «несмещенным», с той оговоркой, что для корректной оценки значения траектории требуется несколько выборок. Более того, агент не может обучаться, пока полностью не завершит траекторию (то есть не достигнет конечного состояния), и не может повторно использовать траектории после обновления сети политик.

На практике REINFORCE часто приводит к проблемам со стабильностью и неэффективности выборки. Давайте обсудим, как Actor Critic решает эти ограничения.

Преимущество Актер Критик

Если вы попытаетесь использовать обычный REINFORCE для решения большинства сложных проблем, возникнут трудности, и тому есть две причины.

Во-первых, он страдает от высокой дисперсии, поскольку использует метод выборки Монте-Карло. Во-вторых, у него нет базового уровня. Например, представьте себе среду, которая всегда даёт вам положительное вознаграждение, тогда доходность никогда не будет отрицательной, поэтому REINFORCE увеличит вероятность всех действий, пусть и непропорционально.

Мы не хотим вознаграждать действия только за получение положительной оценки. Мы хотим вознаграждать действия за результаты выше среднего .

И вот здесь концепция преимущества становится важной. Вместо того, чтобы использовать только исходную доходность для обновления нашей политики, мы вычтем ожидаемую доходность для этого штата. Таким образом, наш новый сигнал обновления будет выглядеть следующим образом:

Преимущество = Полученный доход – Ожидаемый доход

Хотя Advantage дает нам базовые данные для наших наблюдаемых доходов, давайте также обсудим концепцию методов Actor Critic.

Метод Actor Critic сочетает в себе лучшие черты методов, основанных на ценностях (например, DQN), и лучших из методов, основанных на политике (например, REINFORCE). Методы Actor Critic обучают отдельную нейронную сеть, которая обучается только для оценки состояний, подобно Q-сети, описанной ранее.

С другой стороны, метод актера изучает политику.

Объединяя критику Advantage и Actor, мы можем понять, как работает популярный алгоритм A2C:

- Инициализируем две нейронные сети: сеть политики (или акторную сеть) и сеть ценности (или критика). Сеть акторной сети принимает на вход состояние и выводит вероятности действий. Сеть критика принимает на вход состояние и выводит одно число с плавающей точкой, представляющее значение состояния.

- Мы создаем некоторые развертывания в среде, запрашивая субъекта

- Мы обновляем сеть критиков, используя либо TD-обучение, либо Монте-Карло. Существуют и более продвинутые подходы, такие как обобщенные оценки преимуществ, которые сочетают эти два подхода для более стабильного обучения.

- Мы оцениваем преимущество, вычитая наблюдаемую доходность из средней доходности, генерируемой Critic Network.

- Наконец, мы обновляем сеть политики, используя преимущество и уравнение градиента политики.

Методы «актор-критик» решают проблему дисперсии градиентов политики, используя функцию ценности в качестве базовой линии. PPO (Proximal Policy Optimization) расширяет A2C, добавляя концепцию «доверительных областей» в алгоритм обучения, что предотвращает чрезмерные изменения весов сети в процессе обучения. Мы не будем вдаваться в подробности о PPO в этой статье; возможно, когда-нибудь мы откроем этот ящик Пандоры.

Заключение

Эта статья — дополнение к видео на YouTube, которое я снял ниже. Если вам понравилось, обязательно посмотрите.

Каждый алгоритм делает определенные выборы для каждого вопроса, и эти выборы распространяются по всей системе, влияя на все: от эффективности выборки до стабильности и реальной производительности.

В конечном счёте, создание алгоритма RL — это решение этих задач посредством принятия решений. DQN-сети выбирают обучение значениям. Методы политики напрямую обучают **политику**. Методы Монте-Карло обновляются после полного эпизода, используя фактические результаты, что делает их беспристрастными, но имеют высокую дисперсию из-за стохастической природы исследования RL. TD-обучение, напротив, выбирает обучение на каждом этапе на основе собственных оценок агента. Методы Actor Critic объединяют DQN-сети и градиенты политики, обучая сеть актора и сеть критика по отдельности.

Обратите внимание, что сегодня мы многое не рассмотрели. Но это хорошая основа для начала работы с обучением с подкреплением.

На этом статья заканчивается, увидимся в следующей! По ссылкам ниже вы можете познакомиться с другими моими работами.

Мой Patreon:

https://www.patreon.com/NeuralBreakdownwithAVB

Мой канал на YouTube:

https://www.youtube.com/@avb_fj

Подписывайтесь на меня в Twitter:

https://x.com/neural_avb

Прочитайте мои статьи:

https://towardsdatascience.com/author/neural-avb/

Источник: towardsdatascience.com