SpikingBrain

Все привыкли, что современные нейронки это прожорливые цифровые монстры. Чтобы обучить одну, нужно спалить годовой бюджет маленькой страны на электричество. А стоит загрузить ей что-то длиннее короткой инструкции, она тут же теряется и тупит.

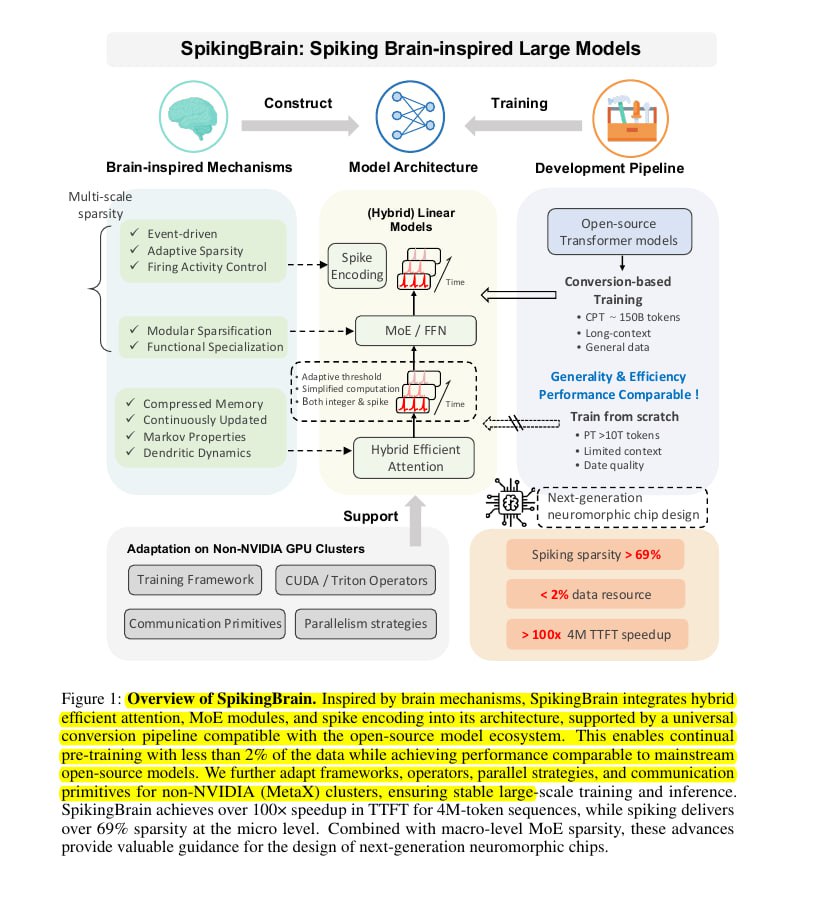

Китайские братушки придумали как это непотребство побороть. Идея проста: зачем заставлять всю систему работать на 100% мощности 24/7, если можно просто… не заставлять? Человеческий мозг работает по принципу «нет задачи — я сплю». Нейроны стреляют импульсами («спайками») только по делу. SpikingBrain делает то же самое: вместо постоянного гула вычислений используются короткие «выстрелы» там, где реально нужно.

Результаты, вроде как, хорошие:

Обучение на минималках. Модель натаскали всего на ~2% от данных, которые нужны привычным нам трансформерам.

Скорость. В тестах на длинный текст (до 4 млн токенов) SpikingBrain оказался в 100 раз быстрее.

Энергоэффективность. Экономия по сравнению с обычными методами — до 70%.

Но как обычно, не без ложки дёгтя:

— Самая быстрая и экономная версия (SpikingBrain-7B) работает почти на уровне обычной модели, но всё же теряет в качестве. Хороший «хорошист», но не отличник.

— Чтобы дотянуться до топ-результатов, пришлось собрать гибрид из линейного, локального и обычного внимания, да ещё нашпиговать все это Mixture-of-Experts. Так появился монстр SpikingBrain-76B. Он умнее, но куда сложнее и прожорливее.

— И вообще, пока это экспериментальная технология: вся магия со «спайками» по-настоящему раскроется только на специальных чипах, которых у нас пока нет.

Есть шанс, что на фоне дефицита энергии и подорожания железа именно такие подходы и выживут. Не дата-центры размером с город, а модели, которые учатся экономить. И тогда ИИ наконец перестанет делать вид, что он умнее мозга, и начнёт хотя бы его копировать. А там и до AGI недалеко: сначала модельки научатся «лениться правильно», а потом и думать осмысленно.