Как методы поиска и ансамблирования делают проверку фактов более быстрой, масштабируемой и надежной в цифровом мире

Делиться

От утопии к реальности: почему нам нужна автоматизированная проверка фактов

По сравнению с традиционными СМИ, где статьи редактируются и проверяются перед публикацией, социальные сети полностью изменили подход. Внезапно каждый мог высказать своё мнение. Публикации мгновенно распространяются, открывая доступ к идеям и точкам зрения со всего мира. По крайней мере, это была мечта.

То, что изначально задумывалось как идея защиты свободы слова, дающая людям возможность выражать свое мнение без цензуры, привело к компромиссу. Проверяется очень мало информации. И это как никогда усложняет задачу определения достоверности информации.

Дополнительная проблема возникает, поскольку ложные заявления редко появляются один раз. Они часто публикуются на разных платформах, часто с измененной формулировкой, форматом, длиной или даже языком, что ещё больше затрудняет обнаружение и проверку. Поскольку эти варианты распространяются между платформами, они могут показаться читателям знакомыми и, следовательно, правдоподобными.

Первоначальная идея пространства для открытой, не подвергающейся цензуре и достоверной информации столкнулась с парадоксом. Сама открытость, призванная расширять возможности людей, одновременно способствует распространению дезинформации. Именно здесь на помощь приходят системы проверки фактов.

Развитие каналов проверки фактов

Традиционно проверка фактов представляла собой ручной процесс, в рамках которого эксперты (журналисты, исследователи или организации, занимающиеся проверкой фактов) проверяли утверждения, ссылаясь на источники, такие как официальные документы или экспертные заключения. Этот подход был очень надёжным и тщательным, но также требовал много времени. В результате этой задержки ложные нарративы дольше распространялись, формировали общественное мнение и способствовали дальнейшим манипуляциям.

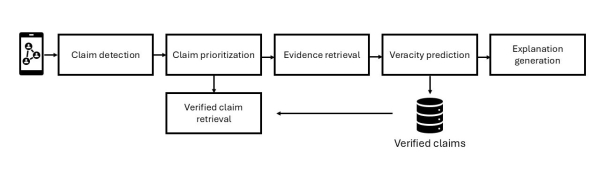

Именно здесь на помощь приходит автоматизация. Исследователи разработали конвейеры фактчекинга, которые действуют как эксперты-люди, но могут масштабироваться для обработки больших объёмов онлайн-контента. Конвейер фактчекинга представляет собой структурированный процесс, который обычно включает следующие пять этапов:

- Обнаружение утверждений – поиск утверждений, имеющих фактические последствия.

- Приоритизация претензий — ранжируйте их по скорости распространения, потенциальному вреду или общественному интересу, отдавая приоритет наиболее значимым случаям.

- Сбор доказательств — сбор подтверждающих материалов и предоставление контекста для их оценки.

- Прогнозирование достоверности — определите, является ли утверждение истинным, ложным или чем-то средним.

- Формирование объяснения – создание обоснования, понятного читателям.

В дополнение к пяти этапам многие конвейеры добавляют шестой этап: поиск ранее проверенных фактов (PFCR). Вместо того, чтобы переделывать работу с нуля, система проверяет, было ли утверждение, даже переформулированное, уже проверено. Если да, то оно связывается с проверкой фактов и вердиктом по нему. Если нет, конвейер переходит к поиску доказательств.

Этот метод экономит усилия, ускоряет проверку и обеспечивает дополнительные преимущества в многоязычных настройках, поскольку позволяет проводить проверку фактов на одном языке для поддержки проверки на другом.

Этот компонент известен под разными названиями: поиск проверенных заявлений, сопоставление заявлений или поиск ранее проверенных заявлений (PFCR). Независимо от названия, идея одна и та же: повторное использование уже имеющихся знаний для более быстрой и эффективной борьбы с дезинформацией.

Проектирование компонента PFCR (извлекательного трубопровода)

По своей сути, поиск ранее проверенных фактов (PFCR) представляет собой задачу поиска информации : имея утверждение из публикации в социальной сети, мы хотим найти наиболее релевантное совпадение среди большого количества уже проверенных фактов (подтверждённых) утверждений. Если совпадение найдено, мы можем сразу же связать его с источником и вердиктом, поэтому нет необходимости начинать проверку с нуля!

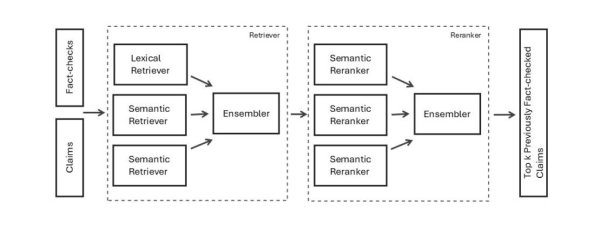

Большинство современных систем поиска информации используют архитектуру «извлекатель-реранкер» . Извлекатель выступает в качестве фильтра первого уровня, возвращая более широкий набор документов-кандидатов (top k) из корпуса. Затем реранкер выбирает эти документы-кандидаты и уточняет ранжирование, используя более глубокую и ресурсоёмкую модель. Такая двухступенчатая архитектура обеспечивает баланс между скоростью (извлекатель) и точностью (реранкер).

Модели, используемые для поиска , можно разделить на две категории:

- Лексические модели : быстрые, интерпретируемые и эффективные при наличии большого количества дублирующихся слов. Но они неэффективны, когда идеи сформулированы по-разному (синонимы, парафразы, переводы).

- Семантические модели : передают смысл, а не поверхностные слова, что делает их идеальными для PFCR. Они понимают, что, например, «Земля вращается вокруг Солнца» и «наша планета вращается вокруг звезды в центре Солнечной системы» описывают один и тот же факт, хотя формулировки совершенно разные.

После того, как кандидаты найдены, на этапе реранжирования применяются более мощные модели (часто кросс-кодировщики) для тщательной переоценки лучших результатов, что гарантирует более высокий рейтинг наиболее релевантных фактчеков. Поскольку реранжировщики обходятся дороже, они применяются только к меньшему числу кандидатов (например, к 100 лучшим).

В совокупности конвейер ретривера и реранкера обеспечивает как охват (распознавая более широкий диапазон возможных совпадений), так и точность (присваивая более высокий ранг наиболее похожим). Для PFCR этот баланс критически важен, поскольку он обеспечивает быстрый и масштабируемый способ обнаружения повторяющихся заявлений, но с высокой точностью, чтобы пользователи могли доверять прочитанной информации.

Создание ансамбля

Конвейер «ретривер-реранкер» уже обеспечивает высокую производительность. Но по мере оценки моделей и проведения экспериментов стало ясно: ни одна модель сама по себе не является достаточно эффективной .

Лексические модели, такие как BM25, отлично справляются с точными совпадениями ключевых слов, но как только утверждение формулируется по-другому, они терпят неудачу. Именно здесь на помощь приходят семантические модели. Они без проблем обрабатывают парафразы, переводы или кросс-языковые ситуации, но иногда испытывают трудности с прямыми совпадениями, где формулировка имеет наибольшее значение. Не все семантические модели одинаковы, у каждой из них своя ниша: одни лучше работают на английском языке, другие — в многоязычной среде, третьи — для улавливания тонких контекстных нюансов. Другими словами, подобно тому, как дезинформация мутирует и появляется в бесчисленных вариациях, семантические модели поиска также обладают разными преимуществами в зависимости от того, как они были обучены. Если дезинформация адаптируема, то и система поиска должна быть такой же.

Вот тут-то и возникла идея ансамбля . Вместо того, чтобы делать ставку на одну «лучшую» модель, я объединил прогнозы нескольких моделей в ансамбль, чтобы они могли взаимодействовать и дополнять друг друга. Вместо того, чтобы полагаться на одну модель, почему бы не позволить им работать в команде?

Прежде чем углубляться в проектирование ансамбля, я вкратце объясню процесс принятия решения при выборе ретриверов.

Установление базовой линии (лексические модели)

BM25 — одна из самых эффективных и широко используемых моделей лексического поиска, часто используемая в качестве базовой модели в современных исследованиях в области информационных технологий. Прежде чем оценивать модели, основанные на встраивании (семантические), мне было интересно узнать, насколько хорошо (или плохо) работает BM25. И, как оказалось, совсем неплохо!

Технические подробности:

BM25 — это функция ранжирования, основанная на TF-IDF. Она улучшает TF-IDF, вводя функцию насыщения и нормализацию длины документа. В отличие от оценки частоты встречаемости термина, BM25 учитывает повторные появления термина, предотвращая несправедливое предпочтение длинных документов. Она также включает параметр (b), который контролирует вес, присваиваемый частоте встречаемости термина и длине документа.

Семантические модели

В качестве отправной точки для семантических (основанных на внедрении) моделей я обратился к бенчмарку Massive Text Embedding Benchmark (MTEB) от HuggingFace и оценил ведущие модели, учитывая ограничения ресурсов графического процессора.

Выделились две модели: E5 (intfloat/multilingual-e5-large-instruct) и BGE (BAAI/bge-m3). Обе показали хорошие результаты при извлечении 100 лучших кандидатов, поэтому я выбрал их для дальнейшей настройки и интеграции с BM25.

Ансамблевой дизайн

После того, как ретриверы были готовы, встал вопрос: как их объединить? Я протестировал различные стратегии агрегации, включая большинствоное голосование, взвешивание по экспоненциальному убыванию и слияние обратных рангов (RRF).

RRF показал наилучшие результаты, поскольку он не просто усредняет оценки, но и поощряет документы, которые стабильно занимают высокие позиции в различных рейтингах, независимо от того, какая модель их сформировала. Таким образом, группа отдавала предпочтение утверждениям, с которыми «согласились» несколько моделей, при этом позволяя каждой модели вносить свой вклад независимо.

Я также экспериментировал с количеством кандидатов, выбранных на первом этапе (обычно называемым гиперпараметром k). Идея проста: если вы выбираете только очень небольшой набор кандидатов, вы рискуете полностью пропустить важные факт-проверки. С другой стороны, если вы выбираете слишком много кандидатов, перераннеру придётся обрабатывать много шума, что увеличивает вычислительные затраты, не повышая при этом точность.

В ходе экспериментов я обнаружил, что с увеличением k сначала производительность росла, поскольку у ансамбля появлялось больше шансов найти правильные фактчекеры. Но после определённого момента добавление новых кандидатов перестало помогать. Переранжировщик уже видел достаточно релевантных фактчекеров для принятия правильных решений, а дополнительные фактчекеры в основном были нерелевантными. На практике это означало поиск «золотой середины», где пул кандидатов был достаточно велик для обеспечения покрытия, но не настолько, чтобы это снижало эффективность переранжировщика.

На последнем этапе я скорректировал веса каждой модели . Уменьшение влияния BM25 и увеличение веса семантических ретриверов повысило производительность. Другими словами, BM25 полезен, но основную работу выполняют E5 и BGE.

Кратко рассмотрим компонент PFCR: конвейер состоит из поиска и переранжирования, где для поиска мы можем использовать лексические или семантические модели, а для переранжирования — семантическую модель. Кроме того, мы заметили, что объединение нескольких моделей в ансамбль повышает эффективность поиска/переранжирования. Итак, куда мы интегрируем ансамбль?

Какое место занимает ансамбль?

Ансамбль не ограничивался одной частью конвейера. Я применил его как при поиске, так и при реранжировании.

- Этап ретривера → Я объединил списки кандидатов, созданные BM25, E5 и BGE. Таким образом, система не полагалась на «представление» одной модели о том, что может быть релевантным, а вместо этого объединила их точки зрения в более сильный начальный набор.

- Этап реранжирования → Затем я объединил рейтинги, полученные от нескольких реранжировщиков (снова имея в виду MTEB и ограничения моей видеокарты). Поскольку каждый реранжировщик учитывает немного разные нюансы сходства, их смешивание помогло уточнить окончательный порядок проверки фактов с большей точностью.

На этапе извлечения набор позволил расширить пул кандидатов, гарантируя, что меньше соответствующих утверждений ускользнет от внимания (повышение отзыва). В то время как этап повторного ранжирования сузил фокус, выдвинув наиболее релевантные проверки фактов наверх (повышение точности).

Собираем все воедино (TL;DR)

Короче говоря, предполагаемая цифровая утопия открытого обмена информацией не работает без проверки и может даже создать противоположность — канал для дезинформации.

Это стало движущей силой разработки автоматизированных механизмов проверки фактов, которые помогли нам приблизиться к изначальному обещанию. Они упрощают быструю и масштабную проверку информации, поэтому при появлении ложных утверждений в новых формах их можно обнаружить и незамедлительно устранить, что способствует поддержанию точности и доверия в цифровом мире.

Вывод прост: разнообразие — ключ к успеху . Подобно тому, как дезинформация распространяется, принимая различные формы, устойчивая система проверки фактов выигрывает от взаимодействия различных точек зрения. Благодаря взаимодействию всех точек зрения, система становится более надёжной, адаптивной и, в конечном итоге, способствует созданию надёжного цифрового пространства.

Для пытливых умов

Если вам интересно более глубокое техническое погружение в стратегии поиска и ансамблирования, лежащие в основе этого конвейера, вы можете ознакомиться с моей полной статьей здесь. В ней рассматриваются выбор модели, эксперименты и подробные метрики оценки в системе.

Источник: towardsdatascience.com