В этой беседе Хелен Уоррелл, журналистка FT по расследованиям и бывший редактор по вопросам обороны и безопасности, и Джеймс О'Доннелл, старший журналист MIT Technology Review по вопросам ИИ, рассматривают этические дилеммы и финансовые стимулы, связанные с использованием ИИ военными.

Добро пожаловать в «Состояние ИИ» — новый совместный проект Financial Times и MIT Technology Review. Каждый понедельник авторы обоих изданий обсуждают один из аспектов генеративной революции ИИ, меняющей расклад сил в мире.

В этой беседе Хелен Уоррелл, журналистка FT по расследованиям и бывший редактор по вопросам обороны и безопасности, и Джеймс О'Доннелл, старший журналист MIT Technology Review по вопросам ИИ, рассматривают этические дилеммы и финансовые стимулы, связанные с использованием ИИ военными.

Хелен Уоррелл, репортер FT по расследованиям

На дворе июль 2027 года, и Китай стоит на пороге вторжения на Тайвань. Автономные беспилотные летательные аппараты с искусственным интеллектом (ИИ) готовы преодолеть противовоздушную оборону острова, поскольку серия мощных кибератак, сгенерированных искусственным интеллектом, привела к отключению энергоснабжения и ключевых коммуникаций. Тем временем масштабная кампания дезинформации, развёрнутая прокитайской мемо-фермой на базе искусственного интеллекта, распространяется по всему миру, заглушая возмущение по поводу агрессии Пекина.

Подобные сценарии привнесли антиутопический ужас в дебаты об использовании ИИ в войне. Военные командиры надеются на цифровые силы, которые будут быстрее и точнее, чем в бою, где всё большее влияние оказывает человек. Но существуют опасения, что по мере того, как ИИ будет играть всё более важную роль, эти же командиры потеряют контроль над конфликтом, который обостряется слишком быстро и не поддаётся этическому и правовому контролю. Генри Киссинджер, бывший госсекретарь США, провёл последние годы своей жизни, предупреждая о грядущей катастрофе войны, управляемой ИИ.

Понимание и минимизация этих рисков является военным приоритетом нашей эпохи — некоторые назвали бы это «моментом Оппенгеймера». На Западе формируется консенсус, что решения о развертывании ядерного оружия не следует передавать на аутсорсинг ИИ. Генеральный секретарь ООН Антониу Гутерриш пошёл ещё дальше, призвав к прямому запрету полностью автономных систем летального оружия. Крайне важно, чтобы регулирование шло в ногу с развитием технологий. Но в ажиотаже, подпитываемом научной фантастикой, легко упустить из виду реальные возможности. Как отмечают исследователи из Гарвардского центра Белфера, оптимисты в отношении ИИ часто недооценивают сложности развертывания полностью автономных систем оружия. Вполне возможно, что боевые возможности ИИ преувеличиваются.

Энтони Кинг, директор Института стратегии и безопасности Эксетерского университета и один из ключевых сторонников этого аргумента, предполагает, что ИИ будет использоваться не для замены людей, а для повышения уровня понимания военных действий. Даже если характер войны меняется, а дистанционные технологии совершенствуют системы вооружения, он настаивает, что «полная автоматизация войны — это всего лишь иллюзия».

Из трёх текущих вариантов военного применения ИИ ни один не предполагает полной автономности. Он разрабатывается для планирования и логистики, кибервойны (диверсий, шпионажа, взлома и информационных операций) и, что вызывает наибольшие споры, для нацеливания оружия, что уже применяется на полях сражений в Украине и секторе Газа. Войска Киева используют программное обеспечение на базе ИИ для управления беспилотниками, способными уклоняться от российских систем глушения при приближении к секретным объектам. Армия обороны Израиля разработала систему поддержки принятия решений на основе ИИ, известную как «Лаванда», которая помогла идентифицировать около 37 000 потенциальных целей в секторе Газа.

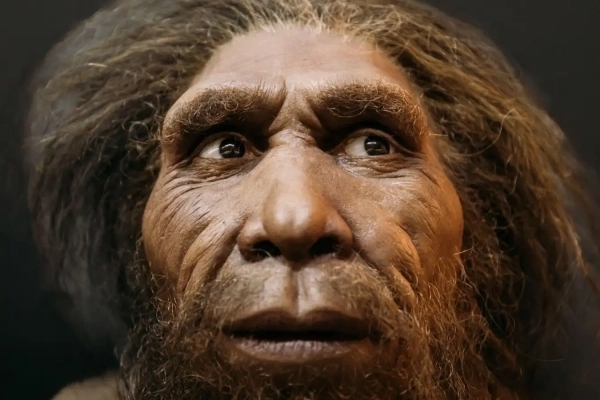

ОБЗОР ТЕХНОЛОГИЙ FT/MIT | ADOBE STOCK

ОБЗОР ТЕХНОЛОГИЙ FT/MIT | ADOBE STOCKОчевидно, существует опасность, что база данных Lavender воспроизводит предвзятость данных, на которых она обучается. Но и у военнослужащих есть предвзятость. Один из израильских разведчиков, использовавших Lavender, утверждал, что больше верит в справедливость «статистического механизма», чем в справедливость скорбящего солдата.

Технооптимисты, разрабатывающие ИИ-оружие, даже отрицают необходимость каких-то новых средств управления для контроля его возможностей. Кит Дир, бывший британский военный, ныне руководитель компании стратегического прогнозирования Cassi AI, говорит, что существующих законов более чем достаточно: «Вы должны убедиться, что в данных обучения нет ничего, что могло бы привести к сбою системы… когда вы уверены в её готовности к применению, — и вы, человек-командир, несёте ответственность за любые её возможные ошибки».

Интересно, что страх и шок от использования ИИ в войне могут исходить от тех, кто не знаком с суровыми, но реалистичными военными нормами. Что вы думаете, Джеймс? Не связано ли некоторое сопротивление применению ИИ в войне не столько с использованием автономных систем, сколько с аргументом против самой войны?

Джеймс О'Доннелл отвечает:

Привет, Хелен,

Я заметил, что отношение компаний, занимающихся разработкой ИИ, к военному применению своих продуктов резко изменилось. В начале 2024 года OpenAI однозначно запретила использование своих инструментов в военных целях, но к концу года подписала соглашение с Anduril о помощи в уничтожении дронов на поле боя.

Этот шаг — конечно, не полностью автономное оружие, но вполне реальное применение ИИ на поле боя — ознаменовал собой радикальное изменение того, насколько технологические компании могут публично связывать себя с обороной.

Что произошло по ходу дела? Во-первых, это шумиха. Нам говорят, что ИИ не только принесёт с собой сверхразум и научные открытия, но и сделает войну более точной, продуманной и менее подверженной человеческим ошибкам. Например, я разговаривал с морскими пехотинцами США, которые испытывали во время патрулирования южной части Тихого океана некий тип ИИ, который, как рекламировалось, анализировал разведданные других стран быстрее человека.

Спросите ИИ, почему это важно для вас? БЕТА-ВЕРСИЯ. Вот почему эта история может быть важна для вас, по мнению ИИ. Это бета-версия функции, и у ИИ бывают галлюцинации — это может быть странно . Местоположение, которое меня интересует, — . Узнайте больше о том, как мы используем ИИ.

Во-вторых, деньги решают всё. OpenAI и другим компаниям нужно начать окупать невообразимые суммы, потраченные на обучение и эксплуатацию этих моделей. И мало у кого есть карманы поглубже, чем у Пентагона. И европейские военные, похоже, тоже не прочь раскошелиться. Между тем, объём венчурного финансирования оборонных технологий в этом году уже удвоился по сравнению с общим объёмом за весь 2024 год, поскольку венчурные капиталисты надеются извлечь выгоду из вновь обретённой военными готовности покупать у стартапов.

Я действительно считаю, что противники войны с использованием ИИ делятся на несколько лагерей, один из которых просто отрицает идею о том, что более точное нацеливание (если оно вообще более точное) приведёт к уменьшению числа жертв, а не просто к усилению войны. Вспомните первую эпоху применения дронов в Афганистане. Поскольку удары с помощью дронов стали дешевле, можно ли сказать, что это уменьшило кровопролитие? Вместо этого они просто увеличили разрушения на доллар?

Но второй лагерь критиков (и вот теперь я наконец-то перехожу к вашему вопросу) исходит от людей, которые хорошо знакомы с реалиями войны, но имеют весьма конкретные претензии к фундаментальным ограничениям этой технологии. Например, Мисси Каммингс — бывший лётчик-истребитель ВМС США, а ныне профессор инженерии и информатики в Университете Джорджа Мейсона. Она открыто заявила о своей убеждённости в том, что именно большие языковые модели склонны совершать серьёзные ошибки в военных условиях.

Типичный ответ на эту жалобу заключается в том, что результаты работы ИИ проверяются человеком. Но если модель ИИ опирается на тысячи входных данных для своего вывода, может ли этот вывод действительно быть проверен одним человеком?

Технологические компании дают невероятно многообещающие обещания относительно возможностей ИИ в этих высокорискованных приложениях, при этом давление, связанное с необходимостью его внедрения, невероятно велико. Для меня это означает, что пришло время для большего, а не меньшего скептицизма.

Хелен отвечает:

Привет, Джеймс,

Нам определённо следует продолжать подвергать сомнению безопасность систем ИИ-войны и тот контроль, которому они подвергаются, а также привлекать политических лидеров к ответственности в этой области. Я предлагаю также скептически отнестись к тому, что вы справедливо называете «необычайно большими обещаниями», данными некоторыми компаниями о том, чего ИИ может достичь на поле боя.

То, что предлагает военным относительно молодая (хотя и бурно развивающаяся) сфера оборонных технологий, таит в себе как возможности, так и опасности. Опасность заключается в том, что в условиях стремительной и скрытной гонки вооружений в сфере ИИ-оружия эти новые возможности могут остаться без должного внимания и обсуждения, в которых они так отчаянно нуждаются.

Дополнительное чтение:

Майкл С. Горовиц, директор Perry World House при Пенсильванском университете, в своей статье в FT объясняет необходимость ответственности при разработке военных систем искусственного интеллекта.

В подкасте Financial Times о технологиях задаётся вопросом, что может рассказать нам экосистема оборонных технологий Израиля о будущем войны.

В этой статье MIT Technology Review анализируется, как OpenAI совершил поворот к использованию своих технологий на поле боя.

MIT Technology Review также раскрыл, как американские солдаты используют генеративный ИИ для поиска информации в тысячах фрагментов открытых источников.

Источник: www.technologyreview.com