В начале этого месяца Microsoft запустила Copilot Health, новое пространство в своем приложении Copilot, где пользователи смогут подключать свои медицинские записи и задавать конкретные вопросы о своем здоровье. Несколькими днями ранее Amazon объявила, что Health AI, инструмент на основе LLM, ранее доступный только участникам сервиса One Medical, теперь станет широко доступен. Эти продукты присоединяются к ChatGPT Health, выпущенному OpenAI в январе, и Claude от Anthropic, который может получать доступ к медицинским записям пользователей при наличии соответствующего разрешения. Доступность Health AI для широких масс официально стала трендом.

Существует явный спрос на чат-боты, предоставляющие медицинские консультации, учитывая, насколько сложно многим людям получить к ним доступ через существующие медицинские системы. Некоторые исследования показывают, что существующие чат-боты способны давать безопасные и полезные рекомендации. Однако исследователи утверждают, что эти инструменты должны быть более тщательно оценены независимыми экспертами, в идеале — до их широкого распространения.

В такой ответственной области, как здравоохранение, доверять компаниям оценку собственной продукции может оказаться неразумным, особенно если результаты этих оценок не предоставляются для внешней экспертной оценки. И даже если компании проводят качественные, тщательные исследования — а некоторые, включая OpenAI, похоже, именно это и делают — у них всё равно могут быть «слепые пятна», которые более широкое научное сообщество могло бы помочь заполнить.

«Поскольку потребность в медицинском обслуживании всегда будет расти, я думаю, нам определенно следует искать все возможные пути решения проблемы», — говорит Эндрю Бин, аспирант Оксфордского института интернета. «Мне кажется вполне вероятным, что эти модели достигли того уровня, когда их действительно стоит внедрять».

«Но, — добавляет он, — доказательная база действительно должна быть достаточной».

Переломные моменты

По словам разработчиков, эти медицинские продукты выпускаются потому, что большие языковые модели действительно достигли того уровня, когда они могут эффективно предоставлять медицинские рекомендации. Доминик Кинг, вице-президент по вопросам здравоохранения в Microsoft AI и бывший хирург, называет развитие ИИ основной причиной создания медицинской команды компании и существования Copilot Health. «Мы наблюдаем огромный прогресс в возможностях генеративного ИИ, позволяющий отвечать на вопросы о здоровье и давать качественные ответы», — говорит он.

Но это лишь половина истории, по словам Кинга. Другой ключевой фактор — спрос. Незадолго до запуска Copilot Health компания Microsoft опубликовала отчет и сопроводительную запись в блоге, в которых подробно описывалось, как люди использовали Copilot для получения советов по здоровью. Компания заявляет, что ежедневно получает 50 миллионов вопросов о здоровье, и здоровье является самой популярной темой для обсуждения в мобильном приложении Copilot.

Связанная статья

Другие компании, занимающиеся ИИ, заметили эту тенденцию и отреагировали на нее. «Еще до появления наших продуктов для здравоохранения мы наблюдали стремительный рост числа людей, использующих ChatGPT для вопросов, связанных со здоровьем», — говорит Каран Сингхал, руководитель команды OpenAI по разработке ИИ для здравоохранения. (У OpenAI и Microsoft давнее партнерство, и Copilot работает на основе моделей OpenAI.)

Вполне возможно, что люди просто предпочитают обращаться со своими проблемами со здоровьем к непредвзятому боту, доступному им круглосуточно. Но многие эксперты интерпретируют эту тенденцию в свете текущего состояния системы здравоохранения. «Есть причина, по которой эти инструменты существуют и занимают определенное место в общей системе», — говорит Гириш Надкани, главный специалист по искусственному интеллекту в системе здравоохранения Маунт-Синай. «Это потому, что доступ к медицинской помощи затруднен, и особенно это касается определенных групп населения».

Перспектива создания ориентированных на потребителя медицинских чат-ботов для студентов магистратуры в области здравоохранения основана на возможности улучшения здоровья пользователей при одновременном снижении нагрузки на систему здравоохранения. Это может включать помощь пользователям в принятии решения о необходимости медицинской помощи — задача, известная как сортировка пациентов. Если сортировка с помощью чат-ботов окажется эффективной, то пациенты, нуждающиеся в неотложной помощи, смогут обратиться за ней раньше, чем это было бы возможно в противном случае, а пациенты с менее серьезными проблемами смогут чувствовать себя комфортно, справляясь со своими симптомами дома с помощью советов чат-бота, вместо того чтобы без необходимости обращаться в отделения неотложной помощи и кабинеты врачей.

Однако недавнее широко обсуждаемое исследование Надкани и других исследователей из больницы Маунт-Синай показало, что ChatGPT Health иногда рекомендует слишком много лечения при легких заболеваниях и не выявляет экстренные случаи. Хотя Сингхал и некоторые другие эксперты предположили, что методология исследования может не давать полного представления о возможностях ChatGPT Health, оно вызвало опасения по поводу того, насколько мало внешней оценки получают эти инструменты перед выпуском в открытый доступ.

Большинство опрошенных для этой статьи академических экспертов согласились с тем, что медицинские чат-боты для студентов магистратуры могут иметь реальные преимущества, учитывая ограниченный доступ к медицинской помощи для некоторых людей. Однако все шесть экспертов выразили обеспокоенность тем, что эти инструменты запускаются без независимой проверки их безопасности. Хотя некоторые рекламируемые способы использования этих инструментов, такие как рекомендации по планам упражнений или подсказки вопросов, которые пользователь мог бы задать врачу, относительно безвредны, другие несут в себе явные риски. Один из них — сортировка пациентов; другой — просьба к чат-боту поставить диагноз или составить план лечения.

Интерфейс ChatGPT Health содержит заметное предупреждение о том, что он не предназначен для диагностики или лечения, и в анонсах Copilot Health и Amazon Health AI также присутствуют аналогичные предупреждения. Но эти предупреждения легко игнорировать. «Мы все знаем, что люди будут использовать его для диагностики и лечения», — говорит Адам Родман, врач-терапевт и исследователь в Медицинском центре Бет Израэль Диконесс, а также приглашенный исследователь в Google.

Медицинское обследование

Компании заявляют, что тестируют чат-боты, чтобы убедиться в их безопасности в подавляющем большинстве случаев. OpenAI разработала и выпустила HealthBench — бенчмарк, оценивающий LLM по их реакции в реалистичных разговорах на темы здоровья, хотя сами разговоры генерируются самими LLM. Когда в прошлом году был выпущен GPT-5, на основе которого работают ChatGPT Health и Copilot Health, OpenAI сообщила о результатах модели в HealthBench: она показала значительно лучшие результаты, чем предыдущие модели OpenAI, хотя её общая производительность была далека от идеальной.

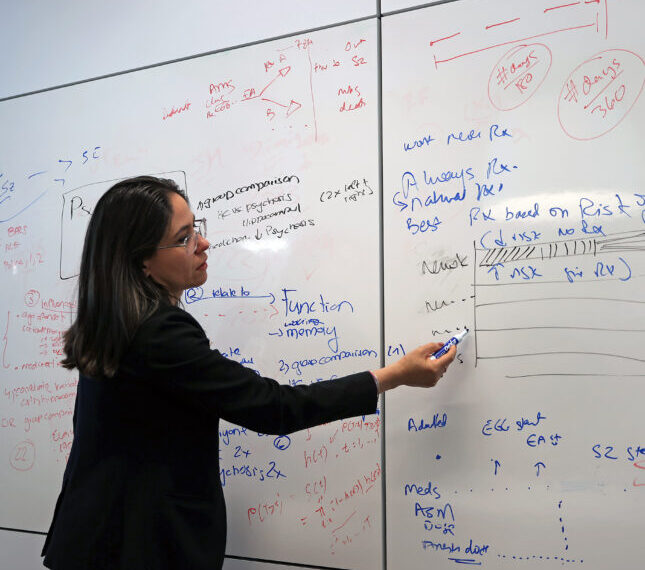

Однако у таких оценочных инструментов, как HealthBench, есть ограничения. В исследовании, опубликованном в прошлом месяце, Бин — аспирант Оксфордского университета — и его коллеги обнаружили, что даже если специалист по медицинскому праву (LLM) может самостоятельно точно определить медицинское состояние по вымышленному письменному сценарию, пользователь, не являющийся экспертом, которому предоставлен этот сценарий и которого просят определить состояние с помощью LLM, сможет сделать это только в трети случаев. Если у пользователей отсутствует медицинская экспертиза, они могут не знать, какие части сценария — или их реальный жизненный опыт — важно включить в подсказку, или они могут неправильно истолковать информацию, которую им предоставляет LLM.

Бин утверждает, что этот разрыв в производительности может быть существенным для моделей OpenAI. В первоначальном исследовании HealthBench компания сообщила, что ее модели показали относительно низкую эффективность в диалогах, требующих от них получения дополнительной информации от пользователя. Если это так, то пользователи, не обладающие достаточными медицинскими знаниями, чтобы предоставить чат-боту по вопросам здоровья необходимую информацию с самого начала, могут получить бесполезные или неточные советы.

Связанная статья

Сингхал, руководитель направления здравоохранения в OpenAI, отмечает, что текущая серия моделей GPT-5, которая еще не была выпущена на момент проведения первоначального исследования HealthBench, гораздо лучше справляется с поиском дополнительной информации, чем их предшественники. Однако OpenAI сообщила, что GPT-5.4, нынешняя флагманская модель, на самом деле хуже справляется с поиском контекста, чем GPT-5.2, более ранняя версия.

В идеале, говорит Бин, медицинские чат-боты должны проходить контролируемые испытания с участием людей, как это было в его исследовании, прежде чем их выпустят в открытый доступ. Это может оказаться непростой задачей, особенно учитывая, как быстро развивается мир ИИ и сколько времени могут занять исследования с участием людей. В собственном исследовании Бина использовался GPT-4o, который вышел почти год назад и сейчас устарел.

В начале этого месяца Google опубликовал исследование, соответствующее стандартам Бина. В исследовании пациенты обсуждали свои медицинские проблемы с медицинским чат-ботом Articulate Medical Intelligence Explorer (AMIE), который пока недоступен для широкой публики, прежде чем встретиться с врачом. В целом, диагнозы AMIE были такими же точными, как и диагнозы врачей, и ни один из разговоров не вызвал серьезных опасений по поводу безопасности исследователей.

Несмотря на обнадеживающие результаты, Google не планирует выпускать AMIE в ближайшее время. «Хотя исследования продвинулись, существуют значительные ограничения, которые необходимо устранить, прежде чем системы для диагностики и лечения будут внедрены в реальную практику, включая дальнейшие исследования в области равенства, справедливости и безопасности», — написал в электронном письме Алан Картикесалингам, научный сотрудник Google DeepMind. Недавно Google сообщила, что Health100, платформа для здравоохранения, которую она разрабатывает в партнерстве с CVS, будет включать в себя ИИ-помощника на базе флагманских моделей Gemini, хотя этот инструмент, предположительно, не будет предназначен для диагностики или лечения.

Родман, возглавлявший исследование AMIE вместе с Картикесалингамом, считает, что такие масштабные многолетние исследования не обязательно являются правильным подходом для чат-ботов, подобных ChatGPT Health и Copilot Health. «Есть множество причин, по которым парадигма клинических испытаний не всегда работает в генеративном ИИ», — говорит он. «И именно здесь начинается дискуссия о бенчмаркинге. Существуют ли бенчмарки от надежной третьей стороны, которые мы можем признать значимыми, и которым лаборатории могут следовать?»

Ключевое слово здесь — «третья сторона». Как бы тщательно компании ни оценивали свою собственную продукцию, трудно полностью доверять их выводам. Оценка третьей стороны не только обеспечивает беспристрастность, но и, если в ней участвует много третьих сторон, помогает избежать «слепых зон».

Сингхал из OpenAI говорит, что он решительно выступает за внешнюю оценку. «Мы стараемся изо всех сил поддерживать сообщество, — говорит он. — Одна из причин, по которой мы выпустили HealthBench, заключалась в том, чтобы дать сообществу и другим разработчикам моделей пример того, как выглядит действительно хорошая оценка».

Учитывая высокую стоимость проведения высококачественной оценки, он скептически относится к возможности создания, по его словам, «единственной универсальной оценки, которая превзойдёт все остальные». Однако он высоко оценивает усилия академических групп по объединению существующих и новых методов оценки в комплексные наборы инструментов — такие как разработанная в Стэнфорде система MedHELM, которая тестирует модели на широком спектре медицинских задач. В настоящее время наивысший балл в системе MedHELM принадлежит GPT-5 от OpenAI.

Нигам Шах, профессор медицины Стэнфордского университета, возглавлявший проект MedHELM, говорит, что у него есть ограничения. В частности, он оценивает только отдельные ответы чат-бота, но человек, ищущий медицинскую консультацию у чат-бота, может вступить с ним в многоэтапный диалог. Он говорит, что он и некоторые его коллеги готовятся создать систему оценки, которая сможет анализировать такие сложные диалоги, но это потребует времени и денег. «У нас с вами нет никакой возможности остановить эти компании от выпуска [продуктов, ориентированных на здоровье], поэтому они будут делать все, что им вздумается», — говорит он. «Единственное, что могут сделать такие люди, как мы, — это найти способ профинансировать этот эталон».

Никто из опрошенных для этой статьи не утверждал, что магистерские программы в области здравоохранения должны безупречно проходить независимые оценки, чтобы быть опубликованными. Сами врачи совершают ошибки — и для человека, имеющего лишь эпизодический доступ к врачу, постоянно доступная магистерская программа, которая иногда допускает ошибки, все равно может стать огромным улучшением по сравнению с существующим положением дел, если эти ошибки не слишком серьезны.

Однако, исходя из имеющихся на данный момент данных, невозможно с уверенностью сказать, действительно ли доступные инструменты представляют собой улучшение, или же их риски перевешивают преимущества.

Источник: www.technologyreview.com